告别纯视觉时代!开普勒国内首发VTLA全感知原生力触觉全栈数采方案

四月北京亦庄机器人马拉松盛大开赛,全网目光聚焦机器人运动炫技与前沿展示,行业迎来新一轮技术狂欢。

当赛道奔跑、舞台表演成为行业主流热度,机器人赛道已分化出截然不同的发展方向:一众企业深耕运动竞技、交互表演,竞相展示亮眼性能;而另一边,有这样一个企业,始终坚守工业本心,深耕产线实干,专注打造真正落地、真正创收、真正可用的实用型工业人形机器人。

它,就是开普勒机器人。

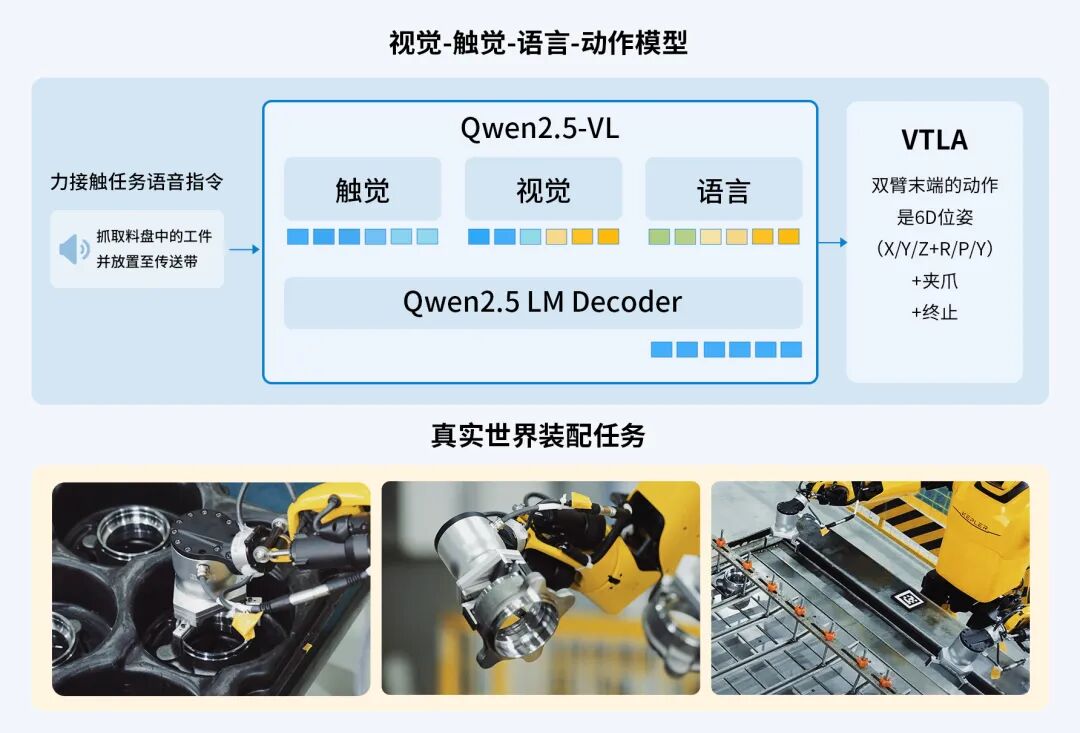

近日,上海开普勒机器人正式发布国内首个原生适配VTLA全感知模型的力触觉全栈数采解决方案——Kepler-OmniTac™。方案由开普勒全栈自研,涵盖新一代数采套件、Kepler-OmniVTLA大模型及原生数据集,可直接采集原生力触觉全模态数据,实现机器人边工作、边数采,在真实工业场景里边训练、边进化。

这一发布,标志着工业人形机器人正式从以视觉为主的VLA时代,迈入更贴合生产实际的OmniVTLA时代。开普勒始终专注工业落地场景,致力于构建真正实用的全感知智能机器人体系,补齐机器人长期缺失的 “物理交互能力”,推动行业从炫技展示走向务实量产,向更智能、更可用、更能干活的方向持续迈进。

01.

开普勒具身智能迈入Gen3.0时代

开普勒机器人对具身智能的探索,始终以落地价值为核心锚点。开普勒CEO宋华曾多次公开表示:“早期大模型等 AI 技术尚未成熟,行业内多数数据采集停留在实验室环境,产出的‘完美数据’与真实工业场景脱节,既无法支撑机器人完成复杂操作,也导致企业投入产出比极低,难以形成规模化落地能力。”

基于这一判断,开普勒为自研的KeplerBrain类脑系统™ 规划了清晰的三阶演进路线:

· 2021–2023具身智能Gen1.0:以规则驱动模型为核心,聚焦封闭场景完成基础作业验证,实现 “无泛化但稳定可靠” 的核心目标,夯实工业级稳定基础;

· 2024–2025具身智能Gen2.0:升级为数据驱动AI模型,在原有封闭场景中实现 “有条件泛化”,可适配同类场景下的小幅变量调整,实现场景内灵活适配。

如今,人形机器人行业迎来关键拐点:执行器、整机控制、灵巧手等硬件已实现规模化突破,躯体成熟,智能待启。但行业仍被三大痛点牢牢束缚:

· 感知维度缺失-纯视觉方案无法捕捉接触力、摩擦力等物理交互信息;

· 力触觉数据稀缺-缺乏全维度接触数据支撑精细操作;

· 模型与数据不匹配-主流模型原生不支持触觉模态。

机器人普遍 “看得清、摸不准、做不精”。依托早些年已完成的本体全栈布局与大量封闭场景落地经验,开普勒正式宣告:迈入KeplerBrain具身智能Gen3.0时代—— 以海量真实数据驱动端到端大模型,实现通用场景、完全泛化。

开普勒明确判断:工业人形机器人的下一程,不再拼硬件,而拼感知与数据。物理世界感知+高保真交互数据,将成为真正的核心竞争力。

为此,公司坚定采用“具身智能大脑+力触觉全栈数采” 双轮驱动战略,放弃 “广而浅” 的横向泛化,深耕工业垂类纵向泛化路径,用真实场景数据破解行业智能瓶颈,让机器人真正实现 “会摸、会懂、会做”,升级为具备真实物理世界感知与决策的工业智能体。

02.

原生VTLA,打造触觉+六维力全感知

本次推出的Kepler-OmniTac™ 力触觉全栈数采解决方案,由自研Kepler-OmniTac 数采套件、Kepler-OmniVTLA数据集、KEPLER OmniVTLA大模型端到端打通,核心是 “人机同源感知”,国内首个实现 “硬件-数据-模型” VTLA原生适配的工业级方案。

不止能看见,更懂推拉拧

Kepler-OmniTac数采套件为开普勒全栈自研,采用双方案并行架构,整体轻量化设计,可快速适配各类真实工业场景。

1. 开普勒同构力触数采套件

由 “同构力反馈外骨骼+力触反馈手部套件(夹爪 / 五指手套)+开普勒人形机器人(夹爪版 / 灵巧手版)”组合而成。

核心优势:动作空间与机器人高度一致,可原位采集高保真力控与接触数据,减少人机形态差异,在滑移、稳定性、材料区分、顺应控制等信号采集上表现优异。同时通过本地 - 边缘部署、通信优化、温度补偿、自校准等技术,有效抑制延迟、温漂与噪声,数据稳定可靠。

2. 类UMI触觉手套数采套件

以五指触觉采集手部套件为核心,可灵活搭配外骨骼扩展使用。

双套件协同,高质高效全覆盖

· 同构外骨骼搭配力触手部采集套件实现精准动作映射与力觉反馈,保障遥操作数据高保真;

两者互补配合,可灵活覆盖不同场景、不同精度需求的全品类数据采集任务,为OmniVTLA大模型训练提供高质量、高多样性的多模态数据支撑。

海量真实数据,筑牢感知底座

Kepler-OmniVTLA数据集,基于自研采集设备原生采集构建,自带 “真实无虚、多元覆盖、全模融合、规模领先” 四大特质,数据储备堪称丰厚:累计收录10万+条真人实采全模态场景数据,覆盖商业、工业、办公、家居等多行业核心场景,囊括20+种专属工业技能与40+种真实应用场景,真实还原核心场景全链路任务。

从VLA到VTLA,一脑适配多机

KEPLER OmniVTLA大模型,实现VLA→VTLA关键升级,将力触觉模态提升至与视觉、语言、动作同等核心地位,原生支持力触觉编码与跨模态深度融合:

· 核心突破:从 “被动看” 到 “主动摸”,精准理解接触力度、材料软硬等物理属性,柔性 / 易碎工件操作 “不翻车”;

· 能力跃迁:模仿学习2.0落地,告别单纯 “抄动作”,深度 “懂逻辑”,复杂任务泛化能力 “翻倍涨”;

· 实用价值:一脑多机高效适配,通过多机型目标映射与策略蒸馏,一套模型可兼容不同自由度、不同结构的人形机器人,无需重复开发,大幅降低部署成本;

· 工业实效:接触密集型任务成功率提升10%-20%,试错成本 “砍一刀”,已在汽车、3C等行业真实工厂完成POC验证,彻底补齐工业人形机器人感知短板。

03.

边工作、边数采、边训练、边进化

当前机器人训练的核心数据,多以纯视觉数据和虚拟合成数据为主。虚拟数采场、集中式基地产出的理想化数据,脱离了工厂的真实环境 —— 不同材质的零件、复杂的光照遮挡、动态的生产流程,让这类数据在工业场景的泛化成功率仅【25%-30%】;而纯视觉数据存在天然盲区,无法感知力、触等物理信息,在精密装配、多材质抓取等精细操作中,几乎不具备实用价值。

传统遥操作数采作为 “人工主导的离线采集模式”,同样未能解决数据与真实场景脱节的核心问题,而Kepler-OmniTac™凭借于 “硬件 - 数据 - 模型” 端到端原生打通:硬件实时采集不卡顿,数据管线秒级处理无延迟,模型原生适配力触觉模态,三者形成高效闭环,大幅减少人工参与,快速完成 “采集-处理-训练-迭代” 全流程。率先实现 “干活即采数、采数即训练、训练即进化” 的革命性突破,彻底打破行业 “采集-训练-部署” 割裂的痛点。开普勒的优势不止于技术逻辑,更在汽车、3C 等真实产线得到验证。

产线实测:从能用,到好用

汽车精密装配:1000次零失误,成功率98%

· 行业痛点:传统遥操作数采与虚拟/纯视觉数据难以精准还原精密装配的力控细节与真实场景,采集数据适配性差,泛化成功率仅25%-30%,导致机器人实际作业易卡滞、错位,依赖人工补位,效率低、成本高;

· 技术突破:VTLA模型通过六维力传感器+触觉反馈,动态修正姿态,实现亚毫米级精准对齐,采集数据与实际作业场景1:1匹配;

· 落地数据:某汽车工厂1000次连续装配,成功率达98%,较虚拟/纯视觉数据的25%-30%泛化成功率实现质的飞跃,产线产能提升30%,人工成本降低40%,大幅减少人工干预。

多材质抓取:零滑落,成功率99%

· 行业痛点:传统遥操作数采与虚拟 / 纯视觉数据无法精准捕捉不同材质零件的受力差异与真实场景特性,采集数据通用性差,机器人抓取时易出现抓碎、滑落问题,人工干预率高,几乎不具备实用价值;

· 技术突破:VTLA模型通过力触觉实时反馈,动态调节抓取力度(重物抓牢、轻物轻柔、易碎品控力),采集数据覆盖全场景材质特性与复杂环境;

· 落地数据:某制造工厂多品种小批量零件抓取及放置,抓取成功率99%,连续作业零滑落。

开普勒K2大黄蜂目前已成功实现自主拆垛,显著降低人工干预,推动产线自动化升级,彻底解决纯视觉与虚拟数据的实用化难题。

04.

从人工采集,到自主成长,补齐感知短板

传统遥操作数采与虚拟/纯视觉数据仅解决 “数据怎么采”,但无法解决 “数据怎么用、机器人怎么升级” 的核心问题;而我们的方案实现全链路高效闭环:

1. 补齐感知短板:首次实现 “视觉+力触觉” 全维度物理感知,让机器人不止 “看见”,更能 “触摸真实”,解决遮挡、反光、柔性物体等场景失效问题;

2. 降低数据门槛:提供开箱即用的工业力触觉数采方案,大幅降低企业获取高保真交互数据的成本与周期,加速具身智能迭代;

3. 加速场景落地:原生适配VTLA模型,数据与模型深度协同,提升机器人在精密制造、汽车装配、物流分拣等场景的作业精度与稳定性,助力工业人形机器人规模化商用。

05.

以数据为芯,从工业出发,向万物智能延伸

开普勒深耕工业人形机器人领域,旗下K2 “大黄蜂” 机器人已在工业制造、物流作业、高空作业等场景完成稳定验证。本次力触觉全栈数采方案的发布,是公司从 “硬件研发” 向 “硬件+数据+模型” 全栈智能公司升级的关键一步。

未来,开普勒将立足工业、跳出工业,持续迭代VTLA模型与力触觉数采体系,以工业级高可靠能力为根基,不断拓展全场景智能边界;联合生态伙伴共建「场景-数据-模型」正向循环,让机器人真正具备人类级物理感知与交互能力,从赋能智能制造,走向服务万物智能。

免责声明

文章来源:开普勒机器人

凡资讯来源注明为其他媒体来源的信息,均为转载自其他媒体,并不代表本网赞同其观点,也不代表本网对其真实性负责,转载请联系原出处。您若对该文章内容有任何疑问或质疑,请立即与后台小编联系,平台将迅速给您回应并做处理。注明本公司原创内容,转载与商务合作请联系慕老师159 0176 7989(微信同号)。