全球最顶级机器人团队,都离不开这款灵巧手!

发布时间:2026-04-30来源:人形机器人洞察研究

温馨提示:扫描文末二维码,加入知识星球,免费下载2800+行业报告(包含海外投行报告);商务和研究咨询合作请联系16620948826(同微信)自从英伟达在机器人模拟与学习领域持续发力以来,仿真环境与现实世界的鸿沟,即Sim-to-Real Gap,始终是困扰灵巧操作进阶的顽疾。在这个技术演进的关键节点上,Sharpa与英伟达的深度合作提供了一套极具启发性的范式。双方不仅在数据规模上通过EgoScale验证了灵巧操作的Scaling Law,更在触觉感知的本质建模上提出了Tacmap这一极具创新性的解决方案。朱雪洲在GTC的演讲中明确指出,触觉AI是解锁高自由度灵巧操作的钥匙,而这一系列学术成果正标志着机器人从粗放的视觉引导步入精细的触觉闭环时代。在人形机器人与灵巧操作的产业演变中,Sharpa通过一系列深度的学术布局,不仅在硬件上定义了22自由度(DoF)的高度拟人化标准,更在触觉AI、多模态学习及大规模仿真等软件层面,与英伟达(NVIDIA)、加州大学伯克利分校等顶级机构的机器人团队共同突破了多项行业瓶颈。DexEMG:

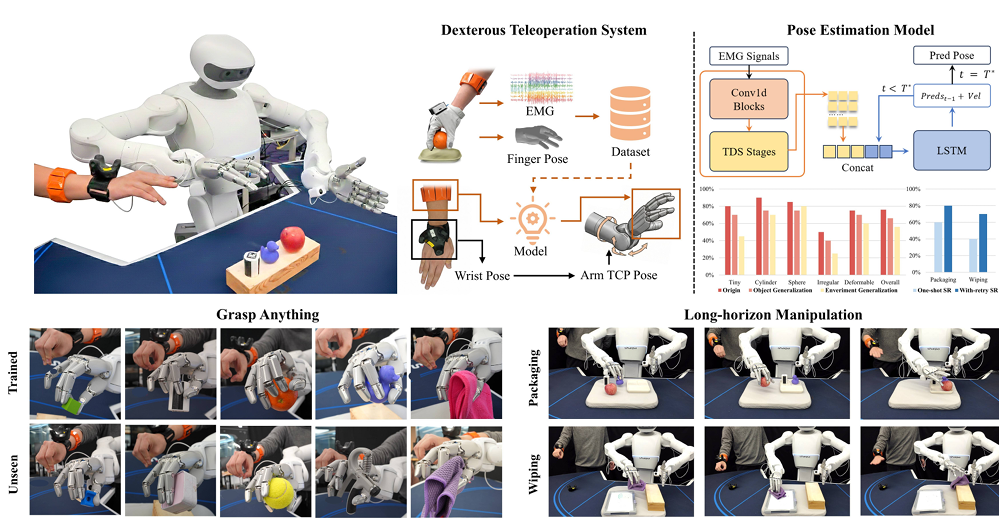

通过EMG2Pose推广实现灵巧远程操作系统

核心问题:如何克服现有灵巧手遥操作系统在性能与便携性之间的固有矛盾,即视觉捕捉系统易受视线遮挡且成本高昂,而机械外骨骼设备又过于笨重且容易造成操作者的物理疲劳,进而探索并解决如何利用低成本、抗遮挡的可穿戴表面肌电图(sEMG)设备,攻克肌肉电信号与高维骨骼运动之间复杂、非线性的连续映射难题,最终实现对多指机器人灵巧手进行高保真、实时且具备强泛化能力的意图控制。核心创新点:提出了一种名为 DexEMG 的轻量级、低成本灵巧手遥操作系统。针对传统视觉动作捕捉易受视线遮挡、机械外骨骼笨重且存在物理限制的痛点,该系统创新性地采用可穿戴的表面肌电图(sEMG)设备作为核心感知输入。它利用 EMG2Pose 神经网络模型,将人类前臂复杂的原始肌肉电信号直接且连续地解码为22自由度的高维手部运动姿态。结合实时且具备防碰撞机制的运动学重定向算法,该系统无需依赖外部摄像头或复杂的机械手套,即可实现对多指机器人的高保真、抗遮挡控制,并且对未见过的抓取对象和复杂的非结构化环境展现出了极强的泛化能力。Sharpa核心贡献与能力体现:采用sEMG肌电信号捕捉前臂神经肌肉信号,EMG2Pose模型直接映射为SharpaWave 22-DoF灵巧手目标姿态。标准抓取MAE仅0.09弧度;复杂桌面操作任务第二次尝试成功率达80%。防碰撞重定向算法确保安全执行。论文地址:https://arxiv.org/abs/2603.05861EgoScale:

利用多样化的以自我为中心的人类数据来衡量灵巧操作能力

合作机构:NVIDIA、加州大学伯克利分校(UC Berkeley)、马里兰大学(UMD);Sharpa(提供核心硬件平台)核心问题:如何将海量的人类行为视频数据,有效地转化为多指机器人进行高保真、高自由度灵巧操作的控制能力。尽管人类行为是学习物理智能极具潜力的可扩展数据源,但此前的人到机器人迁移研究通常受限于较小的数据规模(仅数十到数百小时),且往往聚焦于简单的夹爪或低自由度机械手,缺乏细粒度的手指关节动作控制。因此领域内亟需探明:大规模的真实人类视频数据能否真正支撑起复杂的高自由度灵巧手操作,以及在这个跨形态的数据学习过程中,是否遵循可预测的数据缩放定律(Scaling Law)。核心创新点:首次在灵巧手操作中验证了数据规模与性能之间的对数线性缩放定律,并设计了一套极具成效的“两阶段迁移”训练范式。首先,研究团队利用超过 20854 小时的第一人称(Egocentric)人类视频进行大规模预训练,通过提取手腕相对运动并将其重定向到22自由度机器人的关节空间,提取出具有泛化性的动作先验 。其次,模型进入轻量级的中期训练阶段(Mid-training),仅需利用少量对齐的人类-机器人数据(如50小时人类结合4小时机器人数据),就能将预训练学到的表征精准锚定到机器人的实际传感与控制空间中。这种将数据规模吸收与物理形态对齐相解耦的创新策略,不仅使机器人在高度复杂的灵巧任务上成功率提升了54%,还赋予了模型强大的少样本(One-shot)泛化能力,甚至能够无缝跨形态迁移到结构完全不同的低自由度机器人(如 Unitree G1 的三指手)上执行任务。Sharpa核心贡献与能力体现:SharpaWave 22-DoF关节结构与人手高度匹配,支持从20854小时人类第一视角视频直接映射关节空间。证明灵巧操作同样遵循Scaling Law(R²=0.9983);仅1次演示即达折叠衣物88%成功率;可迁移至低自由度机器人(Unitree G1)。论文地址:https://arxiv.org/abs/2602.16710SimToolReal:

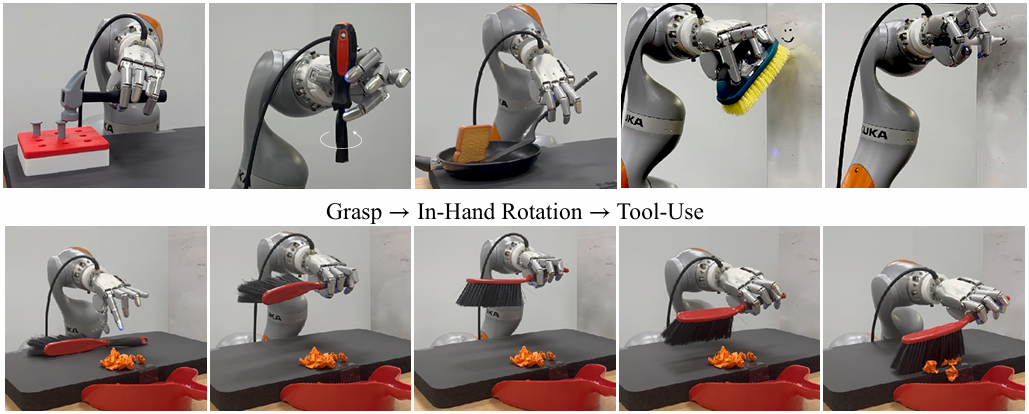

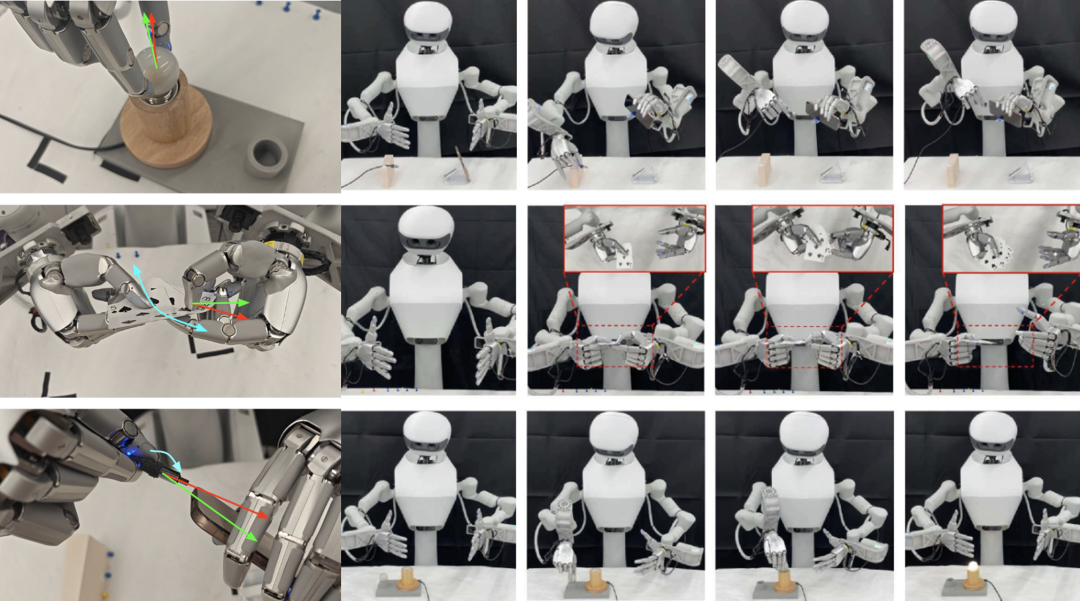

一种面向对象的零样本灵巧工具操作策略

合作机构:康奈尔大学(Cornell University)、斯坦福大学(Stanford University);Sharpa(提供硬件平台)核心问题:主要致力于解决在多指灵巧手的零样本(Zero-Shot)工具操作中,如何克服传统的“仿真到现实(Sim-to-Real)”强化学习方法过度依赖逐任务工程调整的痛点 。以往的方法在面对多样的工具和复杂的物理交互时,往往需要为每一个具体的任务和物体建立精确的仿真模型,并进行繁琐的奖励函数设计 ;同时,由于人体与机械手之间存在运动学差异且缺乏力反馈,通过人类遥操作来收集高质量的灵巧工具使用数据也极其困难 。因此,领域内亟需一种能够摆脱特定物体和任务绑定、无需繁复仿真设定的通用策略,以实现机器人对未见过的真实工具和轨迹序列的泛化操作。核心创新点:提出了SimToolReal框架,创新性地将复杂的工具操作转化为一种以物体为中心(Object-Centric)的通用目标位姿追踪任务。在仿真训练阶段,研究团队不再针对特定任务或具体物体进行训练,而是程序化生成海量具有各种几何形状与物理属性的类工具原始几何体(如手柄与头部的组合) ,并利用目标条件强化学习训练单一的通用策略,驱动机器人将这些几何体移动到随机采样的目标位姿。在现实部署阶段,该系统借助视觉基础模型(如 SAM 3D和 FoundationPose),仅需从单个人类演示的RGB-D视频中提取出粗略的3D抓取边界框和连续的6D目标位姿序列作为输入。这种将任务抽象为随机位姿追踪的设计,促使模型在训练中自发涌现出稳定抓取和手中重定向(In-hand Reorientation)等必要的灵巧操作技能,在完全无需任务级微调或真实物体精确建模的情况下,即可零样本泛化完成多种真实的日常工具使用任务。Sharpa核心贡献与能力体现:SharpaWave高保真关节摩擦、反驱性和传感器反馈建模,使仿真(MuJoCo)策略可无缝零样本迁移到物理手。拟人手指布局使从人类演示视频提取工具位姿更自然,尤其适合手内重定向(如旋转螺丝刀)。论文地址:https://arxiv.org/abs/2602.16863Tacmap:

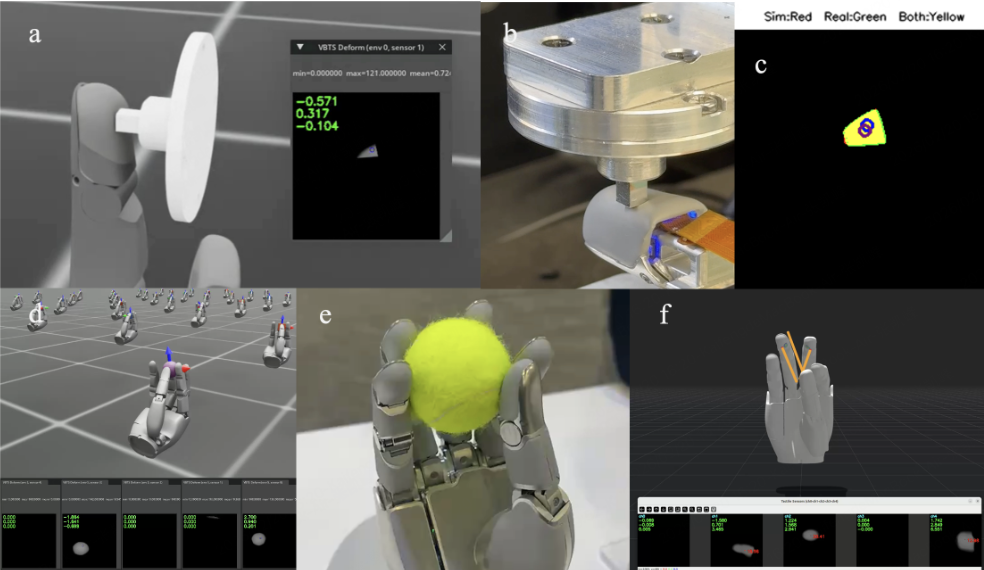

通过几何一致性穿透深度图弥合触觉模拟与现实之间的差距

合作机构:Sharpa、香港科技大学(HKUST)、英伟达(NVIDIA)核心问题:致力于解决基于视觉的触觉传感器(VBTS)在机器人灵巧操作中面临的仿真到现实(Sim-to-Real)触觉差异这一根本性瓶颈。目前主流的触觉仿真方法普遍陷入两难境地:分析型方法(如简单的几何深度投影)缺乏真实的物理形变反馈,导致仿真与现实差距过大;高保真度的物理学方法(如有限元分析 FEM)计算成本极其高昂,无法满足大规模强化学习(RL)所需的并行采样速度;而经验型(数据驱动)方法则严重依赖特定数据集,难以泛化到未见过的物体几何形状。此外,现有的触觉仿真器大多专为平面传感器设计,在应用于多指灵巧手常见的曲面指尖时,会产生严重的投影失真和物理失真。因此,如何开发一种既能保持高物理逼真度、又能满足大规模计算效率,且能完美兼容曲面传感器的触觉仿真框架,成为了该领域亟待解决的核心痛点。核心创新点:提出了Tacmap框架,通过引入一种统一的几何一致性穿透深度图(Deform Map)来巧妙地弥合触觉领域的Sim-to-Real差距。在仿真端,研究团队摒弃了计算高昂的有限元分析,采用高效的几何光线投射算法(Ray-casting),直接计算刚体与弹性体在传感器表面法线方向上的3D穿透深度;这种方法不仅自然兼容了曲面指尖的形态,还能在GPU加速下实现支持数千个环境并行的极高渲染吞吐量。在现实端,团队构建了自动化数据采集平台,并训练了一个深度学习翻译模型,将包含复杂光学效应(如内部反射、光散射)的原始真实触觉图像,精准转化为与仿真端完全一致的穿透深度图。通过将虚拟和现实双端强制对齐到这个纯几何的共享表征空间中,Tacmap成功将接触物理学与特定传感器的光学伪影彻底解耦,使得完全在仿真环境中依赖Tacmap训练的复杂灵巧操作策略(如手中旋转物体),能够零样本(Zero-Shot)直接部署到真实的物理机器人上。Sharpa核心贡献与能力体现:提出几何一致穿透深度图方法,统一仿真与真实触觉感知到同一几何表示空间。针对SharpaWave曲面触觉传感器优化,GPU加速支持数千环境并行,实现零样本迁移(无需真实世界微调)。论文地址:https://arxiv.org/abs/2602.21625核心问题:致力于解决现有视觉-触觉(visuo-tactile)学习框架在处理需要亚毫米级几何精度的多指灵巧操作时所面临的瓶颈限制。在复杂的灵巧操作(如自由空间中插拔USB-C、安装灯泡、滑动卡片)中,接触瞬间往往伴随严重的视觉遮挡,微小的空间姿态误差会不断累积并最终导致任务失败。尽管基于视觉的触觉传感器能够提供丰富的局部接触几何、变形和力学特征,但目前的学习方法未能将这些触觉信号与机械手的运动学空间框架有效结合。这导致当前的策略模型往往只能简单地感知是否发生了接触,却无法在手部坐标系下准确推断接触点的局部空间关系和几何上下文,从而严重缺乏进行高精度几何推理和实时姿态微调的能力。核心创新点:核心创新点在于提出了名为 SaTA(Spatially-anchored Tactile Awareness)的端到端灵巧操作策略框架,首次将触觉特征显式且精准地空间锚定到机械手的运动学坐标系(腕部参考系)中。在具体网络设计上,SaTA通过正向运动学(Forward Kinematics)实时计算每个触觉传感器的6D位姿,利用傅里叶特征编码(Fourier encoding)来捕获多尺度的空间变化信息,并采用特征线性调制(FiLM)机制将这些空间上下文与原始的触觉图像特征进行深度融合。这种创新架构在保留触觉感知丰富细节的同时,赋予了每一个触觉测量明确的几何物理意义,使得策略模型完全无需依赖显式的物体3D建模或复杂的位姿估计算法,就能直接在端到端学习中涌现出极强的几何推理能力,从而大幅提升了高精度接触密集型任务的操作成功率与执行效率。Sharpa核心贡献与能力体现:SaTA框架通过前向运动学实时计算指尖6D姿态,傅里叶编码多尺度空间特征,FiLM调制融入触觉特征提取。USB-C插入(基线成功率0%)达35%成功率;整体成功率提升30%,任务完成时间减少27-28%。论文地址:https://arxiv.org/abs/2510.14647MoDE-VLA:

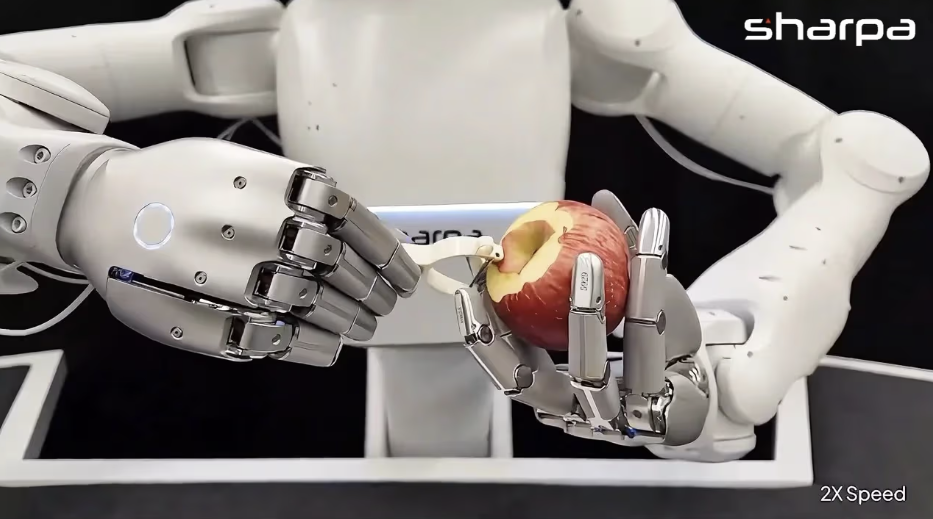

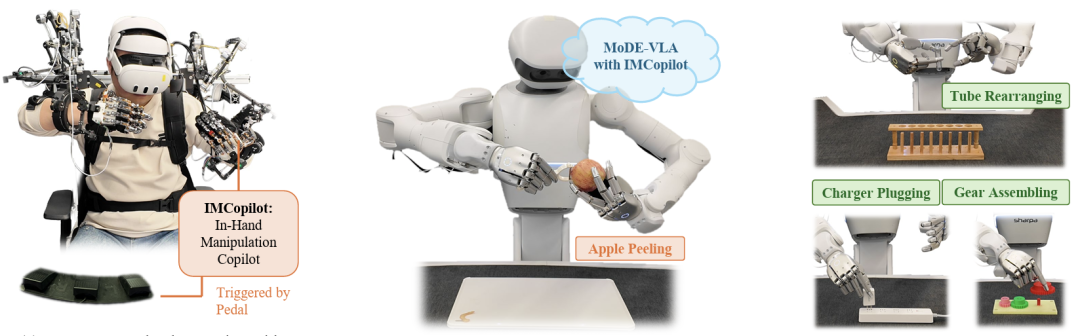

通过强化学习增强型远程操作和混合灵巧专家实现类人操作 VLA

合作机构:Sharpa(主导)NUS, 上海交大,上海AI Lab核心问题:现有的视觉-语言-动作(VLA)模型虽然在机器人操作中取得了显著进展,但其应用大多局限于低自由度末端执行器(如平行夹爪)和简单的视觉引导抓放任务。当尝试将这些模型扩展到类人的双臂灵巧操作,特别是接触密集的手中操作(in-hand manipulation)时,面临着三大严重瓶颈 :第一,数据采集瓶颈。对包含63个自由度的双臂系统进行遥操作极其困难,收集用于精确多指协调的高质量演示数据甚至超出了人类专家的操作极限。第二,多技能学习挑战。像削苹果这样的复杂任务跨越了视觉引导的粗略运动、力引导的精细运动和触觉引导的手中旋转,单一策略很难在高维动作空间中同时掌握这些截然不同的技能。第三,模态异构性挑战。力觉和触觉信号与视觉/语言在时间动态和物理语义上存在异构性,简单地将它们拼接到预训练的VLA主干网络中往往会适得其反,破坏模型原有的性能。核心创新点:提出了一种集成框架来突破上述瓶颈,其核心创新包含两个协同发挥作用的组件。首先是 IMCopilot(手中操作副驾驶),这是一套通过强化学习训练的原子级手中操作技能,具有双重作用。在数据采集阶段,它作为共享自主助手,允许操作员通过脚踏板将困难的手中操作阶段委托给它,从而高效获取高保真演示数据;在自主执行阶段,它作为VLA可调用的底层执行基元,形成了一种类似于人类运动控制的分层架构。其次是 MoDE-VLA(混合灵巧专家VLA),该架构专门为力觉和触觉输入设计了独立的处理通道 。它利用稀疏混合专家(MoE)路由针对不同时间步进行动态特征提取,并采用残差注入(residual injection)机制将微调信息融合到动作生成中。这种设计使得模型能够基于接触感知对动作进行精确修正,同时完美保留了VLA主干网络的原有预训练知识,最终成功实现了双臂机器人自主削苹果等极具挑战性的高复杂度灵巧操作。Sharpa核心贡献与能力体现:IMCopilot通过强化学习训练低层级技能(如手中旋转),作为VLA可调用的原子动作;MoDE-VLA混合专家模型对力/触觉与视觉分别稀疏路由与残差注入;SharpaWave 22-DoF灵巧手+十指6-DoF力/触觉反馈。削苹果任务73%完成率,精细任务成功率比基线提升1倍。论文地址:https://arxiv.org/abs/2603.08122LDA-1B:

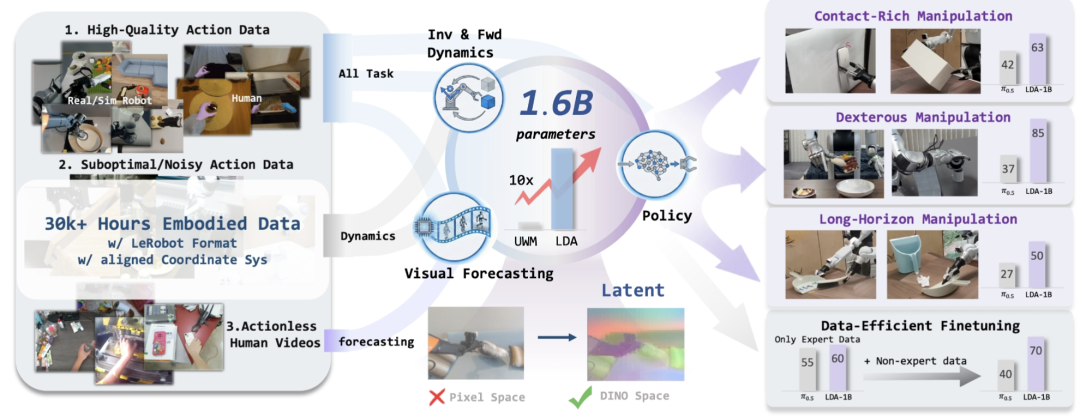

通过通用具身数据摄取扩展潜在动态动作模型

合作机构:北京大学、银河通用等;Sharpa(提供硬件平台)核心内容:银河通用机器人在其最新LDA模型中,专门为多指灵巧手设计了统一的动作空间表达方式——通过末端执行器在腕坐标系下的关键点来描述手部构型,而非绑定于特定机械结构的关节参数。这一设计使灵巧手的操作意图(抓取、旋转、插入等)能够在不同机器人本体之间共享,正是Sharpa Wave灵巧手所代表的精细化手部控制能力的重要应用场景。LDA的实验结果显示,配备灵巧手执行任务的成功率显著优于同类基线模型(GR00T-N1.6、π₀.₅),验证了Sharpa灵巧手在真实操作中的执行稳定性与精度优势。更重要的是,LDA能够从低质量甚至失败的操作数据中持续学习,意味着Sharpa灵巧手在实际部署中产生的所有数据——包括探索性失败——都可以转化为模型能力的提升燃料。Sharpa核心贡献与能力体现:像Sharpa这样具备高自由度、高精度的灵巧手,不仅是具身智能末端执行的关键硬件,更是驱动世界-动作模型持续进化的核心数据来源。论文地址:https://arxiv.org/abs/2602.12215结合朱雪洲在GTC的分享,我们可以清晰地看到Sharpa的技术野心:将触觉AI视为解锁通用操作的唯一路径。传统的视觉方案只能解决“看”的问题,但无法解决做的精细度。通过上述学术突破,Sharpa正在构建一个名为System 0的手感层,这不仅仅是代码,更是一套关于物理交互的数据分布。当机器人掌握了这种跨场景的手感规律,具身智能才算真正开启了它的ChatGPT时刻。免责声明

1、我们整理、翻译和转载此文出于传播更多资讯之目的,不代表本号观点,亦不构成任何投资观点,由此做出的投资决策与本人本文无关!2、本文所用的视频、图片、文字如涉及作品版权问题,请第一时间联系小编:16620948826(同微信),我们将立即删除,无任何商业用途!

# 扫描上方二维码,添加小编微信 #

# 申请请备注公司+姓名+职位

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。