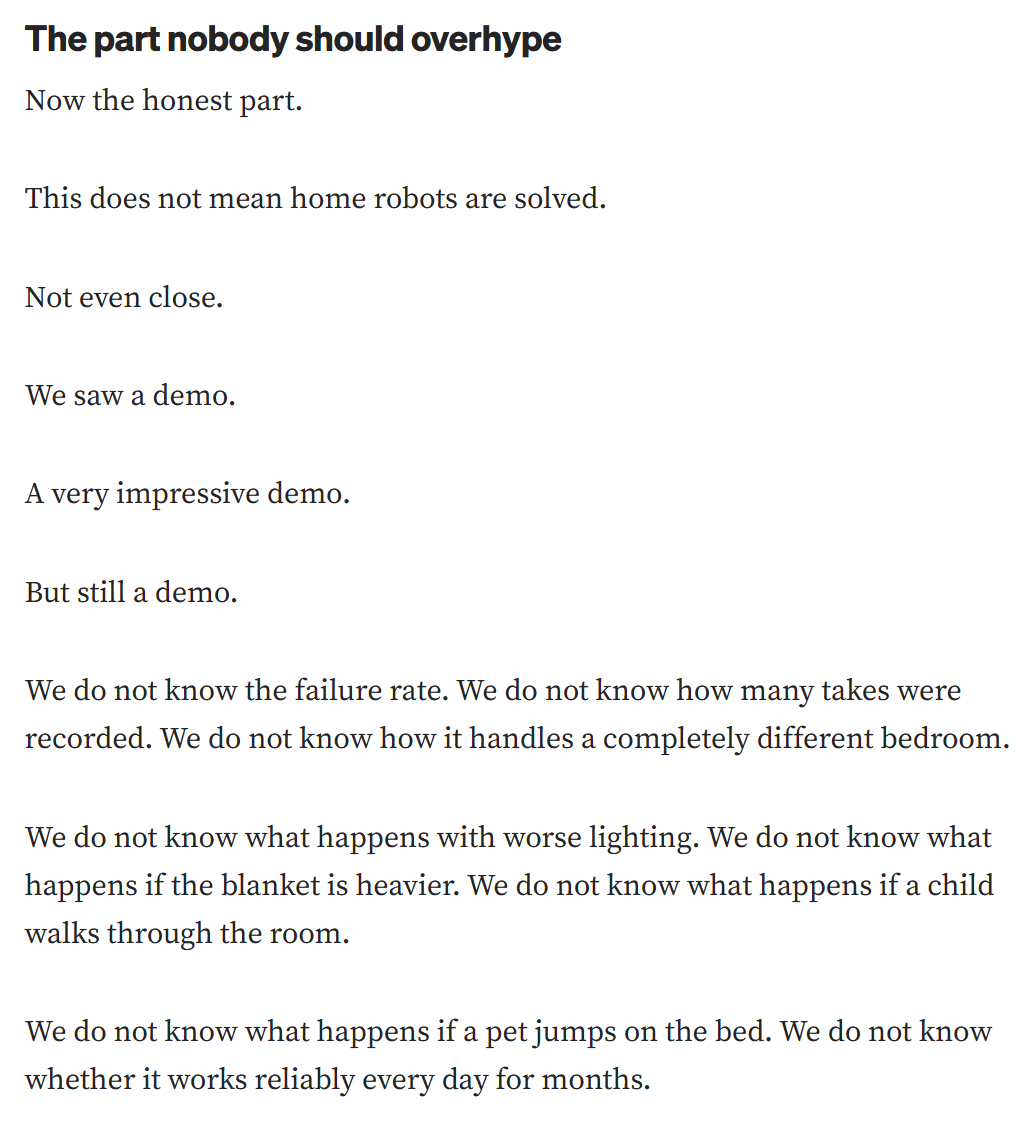

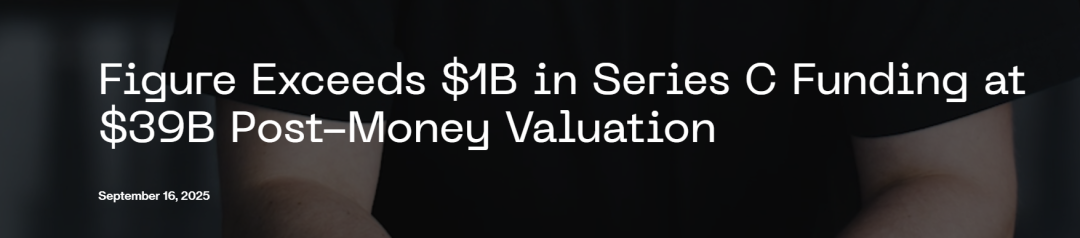

温馨提示:扫描文末二维码,加入知识星球,免费下载2800+行业报告(包含海外投行报告);企业广告、推文宣传和研究咨询合作请联系16620948826(同微信)。当地时间5月8日,Figure AI发布了一段 2分13秒的人形机器人演示视频。视频中,两台Figure 03人形机器人在Helix-02系统驱动下进入卧室,用不到2分钟完成开门、挂衣服、归置耳机、合上书本、丢垃圾、推椅子,以及共同整理床铺等动作。基础文章也提到,这次视频延续了Figure AI对“家庭场景机器人”的叙事,但市场反馈比之前更冷静。这次演示没有选择工厂搬运,也不是单台机器人执行简单抓取,而是把两台机器人放进卧室。卧室是家庭空间里更难标准化的场景,床铺、衣物、桌椅、垃圾桶、耳机、书本对应不同的感知和操作方式。Figure AI官方称,两台Helix-02机器人运行同一个学习得到的Vision-Language-Action 策略,并完成了多个连续任务。但外网反应没有完全跟随Figure AI的叙事走。很多评论承认这段演示有研发价值,同时追问几个更现实的问题:这是不是完整自主?视频是否经过筛选?房间是否过于规整?换成真实家庭还能不能跑?两台昂贵机器人铺床,商业账是否成立?这次演示的核心不只是“机器人会铺床”。Figure AI表示两台机器人之间没有共享规划器、没有消息传递、没有中央协调器。每台机器人通过自己的摄像头读取房间状态,并根据另一台机器人的动作推断其意图。Figure AI还称,这是其所知范围内首次由单一学习神经网络直接从像素到动作,执行多人形机器人协作移动操作的演示。演示里的任务序列并不短。机器人需要开门、挂衣服、收纳耳机、合上书本、丢垃圾、推椅子,并共同整理床铺。Figure AI解释说,Helix-02通过新增数据学会了这些任务,核心算法本身没有改变。官方文章还列出了开门、推家具、挂衣服、耳机重定向、双手合书等能力点。床铺整理是整段视频里最能体现难度的部分。被子不是刚体,没有固定形状、固定抓取点,也没有清晰的左右边界。两台机器人要站在床的两侧,同时作用在同一个大尺寸柔性物体上。每一次拉动都会改变被子的形状、褶皱和受力状态,另一台机器人看到的场景也会变化。Business Insider对这段视频的报道也提到,Figure AI 把难点归纳为三类:两台机器人需要实时理解对方动作;被子没有固定形状,机器人必须不断调整;机器人还要在房间内移动,并在多个任务之间切换。报道同时提到,Figure AI 方面强调视频为1倍速,两台机器人没有遥操作,而是通过视觉信号协调。此次的更新,同时包含多机协作、柔性物体操作、双臂操作、全身平衡、移动操作和长任务序列。问题在于,外界现在已经不会只因为一段完成视频,就接受“家庭机器人快来了”的判断。1)它到底有多自主。Figure AI 和 Brett Adcock 在公开帖中都强调,这次演示是fully autonomous,运行Helix-02。Business Insider也引用Figure AI相关说法称,两台机器人没有遥操作,而是通过视觉信号进行协调。但在相关论坛的讨论中,仍有人直接质疑这些机器人看起来像是遥操作,也有人回应称问题可能不是遥操作,而是对当前房间和任务过拟合。另外有人提出,希望看到有人随机布置房间、制造杂乱,再观察机器人会如何处理。这类怀疑并不等于认定 Figure AI造假。它真正指向的是公开信息缺口:我们没有看到完整测试过程,没有看到失败片段,没有看到重试次数,也不知道同一任务在多轮随机测试中的成功率。对机器人来说,一次顺利完成的视频和一套稳定可复现的能力,中间差了很多工程验证。2)卧室太整洁,像样板间。部分网友认为视频中的卧室环境过于整洁,任务难度有限,更像“精心设计的展示间”,而不是真实家庭环境。也有人认为,两台机器人互相点头的细节过于工整,容易让人感觉是被设计过的协作信号。

Reddit上的质疑更直接。有评论说并不确信它的自主性,希望看到机器人清理一个真实卧室,而不是家具展厅;房间里应该有随机杂物,并且要换到另一个家具、位置、光线都不同的房间继续测试。

Startup Fortune的一篇文章把这个问题说得比较清楚。这段Helix-02 Bedroom Tidy 视频确实让Figure AI的家庭机器人叙事重新获得关注,但投资者应关注更清楚的自主性说明、场景设置细节,以及polished demo之外的证据。文章还指出,卧室和仓库、厨房不同,它更私人、更混乱,软物体更多,空间更窄,也更经常变化。3)铺床不是完整家务,整理也不等于清洁。这次演示容易被传播为“机器人会做家务了”。但从任务分解看,它主要展示的是tidying,也就是整理、归置和床面拉平。它没有展示真正清洁任务,例如吸尘、擦污渍、处理湿垃圾、清理卫生间、换床笠、拆洗被套、套枕套、处理脏衣物。Brett Adcock的LinkedIn发布帖评论区里,有人直接提出下一步应该让两台机器人一起换 fitted mattress sheet,看它们从哪个角开始;也有人认为,移动一下被子是否就能算making the bed仍可讨论,并建议下一次展示取下旧床品、放进洗衣机、换上干净床单、整理被套和枕套。这些评论不是简单调侃。床品处理是家庭服务机器人里非常难的一类任务。床笠有弹性边,四角需要定位;被套涉及大面积柔性物体的翻转、插入和拉平;枕套需要对齐和推进。它们比“拉平床面”更接近真实家政任务,也更容易暴露机器人在触觉、力控、视觉遮挡和失败恢复上的短板。4)缺少成功率、失败模式和未剪辑测试。Let’s Data Science 针对这条 Helix-02 视频的分析比较克制。文章承认它展示了两台 F03 机器人在 staged bedroom中自主整理房间和铺床,也提到Figure AI声称两台机器人没有共享规划器、没有消息传递、没有中央协调器。但文章同时指出,外界仍需要更多信息,例如成功率、鲁棒性、失败模式、计算预算、泛化能力等。Medium 上一篇针对这条视频的技术分析也给出了类似判断。作者认为,这段 demo显示了多机协作、柔性物体操作和全身控制的进展,但它并不意味着家庭机器人问题已经解决。文章明确提到,我们不知道失败率,不知道拍了多少条,不知道换一个卧室会怎样,也不知道光线变差、被子更重、孩子走进房间时系统会如何处理。机器人演示的问题在于,观众看到的是完成时刻,不是测试分母。一次视频里没有摔倒、没有抓空、没有卡住、没有人工重置,并不能说明这些情况没有发生。工程团队当然会剪掉失败片段,这本身不奇怪。但市场如果要判断产品化程度,就必须看到失败率,而不是只看最好的一次。5)家庭场景比视频里的卧室更难。家庭场景远比工厂复杂。工厂环境标准化程度高、任务重复性强,而家庭空间充满随机性:杂物摆放无规律,物体材质多样,空间狭窄,动态变化频繁。这意味着机器人不只要有运动控制能力,还要持续感知、决策和容错。Medium 技术分析也把这个问题写得很直接:工厂是为机器人准备的,地面平整、光线固定、物体已知、动作重复;家庭正好相反,物品永远不会在同一个位置,衣服会折成不同形状,门的开合会受到力的影响,椅子会滑动,耳机会在手中旋转,被子会起皱。Figure AI 从工厂叙事切到家庭叙事,技术要求不是降低,而是提高。在工厂里,一个零件、一条产线、一个工位可以反复采集数据、调参、加视觉标记、限制人流动线。家庭里,用户不会为了机器人重构卧室,也不会每天把物品摆成训练集里的样子。机器人要适应人,而不是让人适应机器人。从研发角度看,外界质疑的不是“机器人会不会动”。Helix-02 当然展示了运动控制、视觉感知、双臂操作和协作策略上的进展。真正被追问的是泛化、鲁棒性和失败恢复。机器人在一个熟悉卧室里完成一次任务,和它在十个陌生家庭里每天稳定工作,是两件事。从产品角度看,家庭机器人不是实验室能力展示,而是长期服务系统。用户不会关心某一次演示是否顺利,只会关心每天能不能用、出错后能不能自己恢复、会不会弄坏家具、维修找谁、价格是否合理。Startup Fortune 对这条视频的分析也提醒,要把能力和呈现方式分开看,polished demo 之外的证据才更能说明问题。从资本角度看,Figure AI 的估值已经很高,达到390亿美元。对这样体量的公司,市场不会只满足于更精致的视频。市场需要看到的是付费客户、部署规模、可靠性数据、制造成本下降曲线,以及从demo 到收入的路径。所以,Figure AI把能力边界往前推了一步,但它还没有回答产品化所需的问题。卧室整理演示证明了系统可以在设定场景里完成复杂组合动作,却还不能证明它已经具备家庭服务机器人的稳定交付能力。Helix-02 卧室整理进展值得关注。两台人形机器人围绕同一个柔性物体协作,完成移动、抓取、整理、平衡和多步骤任务,对当前人形机器人研发有实际意义。但外网“不买账”也有充分理由。它追问的不是视频好不好看,而是这套能力能不能复现,能不能换房间,能不能处理更乱的家庭环境,能不能承受长时间运行,能不能以可接受的成本部署。对Figure AI,也对所有人形机器人公司来说,下一阶段最有说服力的材料不是更精致的短视频,而是未剪辑长时间测试、随机环境测试、失败率数据、第三方评测和真实客户部署。人形机器人进入家庭,不会靠一次铺床演示完成。它需要用大量可靠性数据,证明自己真的能在人的生活空间里工作。免责声明

1、我们整理、翻译和转载此文出于传播更多资讯之目的,不代表本号观点,亦不构成任何投资观点,由此做出的投资决策与本人本文无关!2、本文所用的视频、图片、文字如涉及作品版权问题,请第一时间联系小编:16620948826(同微信),我们将立即删除,无任何商业用途!