1 万可重构原子量子比特运行 Shor 算法?工程现实远未闭环,“有用时刻”从何谈起

发布时间:2026-04-09来源:量子前哨

长期以来,一个核心问题始终悬而未决:要在现实密码规模上运行 Shor 算法,究竟需要多大规模的量子计算机?

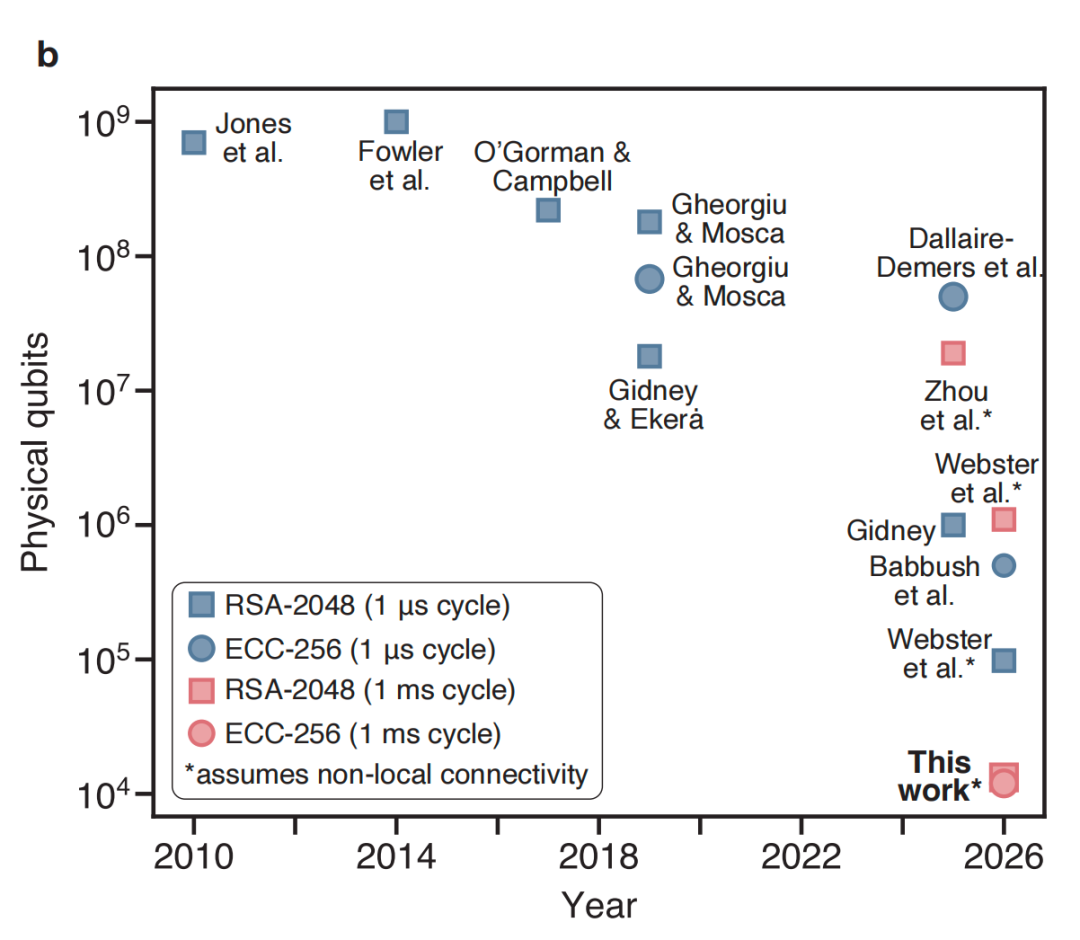

过去十余年,学界的主流判断相对一致:需要上百万物理量子比特,且必须建立在完整容错体系之上。这一门槛之高,使得“量子破解密码”更多停留在理论层面。

在这一共识之上,一篇发布在 arXiv 上的论文迅速引爆讨论,标题为《Shor 算法只需少至 10,000 个可重构原子量子比特即可实现》(Shor's algorithm is possible with as few as 10,000 reconfigurable atomic qubits)。

论文给出的结论极具冲击力:所需资源可能从“百万级”压缩至“万级”。

也正因此,它在发布后几乎第一时间引发两种截然不同的反应:一方宣传“量子破解密码大幅提前”,另一方则在专业社区中发起多重质疑。

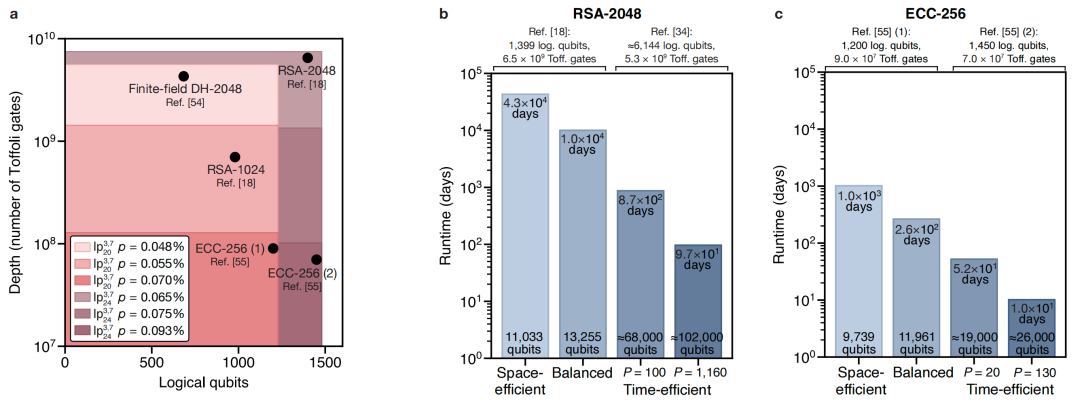

事实是:该论文 1 万比特的结论是“空间最优化”方案的数字,而 10 天破译的结论是“时间最优化”方案的数字,这两个最优解目前无法在同一个“1 万比特”的系统里同时实现。

如果用一句话概括这篇论文最扎实的贡献,那不是“1 万比特”,而是它把量子破解密码所需的规模,从“百万级”压到了“万级”。这听起来像是一次简单的优化,但实际上,它改变的是一个长期被默认的前提。在过去十多年里,学界对肖尔算法(Shor's algorithm)的主流判断非常一致:如果要在现实密码规模(如 RSA-2048)上运行,需要上百万个物理量子比特。这个数量级之所以被认为“合理”,不是算法本身复杂,而是因为量子系统太容易出错,必须用大量冗余来纠错。在传统方案中,一个“可用的逻辑比特”,往往需要数百甚至上千个物理比特来支撑,而这篇论文真正做的,就是在这一点上动刀。一方面,它采用了一种更高编码效率的纠错方法(qLDPC)。如果把传统方案比作“用很多备用零件保证机器不坏”,那么这种新方法更像是用更聪明的结构,让同样的可靠性,用更少的冗余实现。另一方面,它结合了中性原子系统的一个关键特性:量子比特可以被“移动”和“重排”,从而实现更灵活的连接关系。这听起来是个细节,但在量子计算中非常关键,因为很多高效编码之所以用不了,正是因为它们需要“远距离连接”。而这种架构,恰好让这些原本“难以计算”的编码,变得“可以用来计算”。当这两点结合在一起时,带来的就不再是渐进优化,而是对资源需求的一次整体重估。不同发表年份下运行Shor算法所需物理量子比特数量的估计(对比既有研究与本文结果):图源论文从“百万级”到“万级”,意味着什么?不是“更容易一点”,而是从“几乎不可想象的工程规模”,进入“可以被认真讨论的范围”。这也是为什么这篇论文在专业社区内部,会被当作一个重要进展来看待:它改变了问题的尺度。很多人看到论文中的“1 万量子比特”,很容易产生一种直觉:这不过是把今天的量子芯片,从几百、几千比特,继续往上扩展一到两个数量级。但是,论文中的“1 万比特”,其实指向的是一件完全不同的东西。它不是“更多的量子比特”,而是一整台已经可以稳定运行复杂算法的容错量子计算机。换句话说,这个数字隐含的前提,并不是“规模更大”,而是系统已经完成了一次质变:这些条件在论文中被一笔带过,但在现实中,它们恰恰是最难跨越的门槛。一个直观的类比是,今天的量子计算如果是“可以飞几秒钟的实验飞行器”,那么论文中的“1 万比特系统”,已经是“可以跨洲飞行的客机”。两者的差别,不在于“发动机再大一点”,而在于是否具备完整、可靠、可持续运行的系统能力。因此,论文真正回答的问题是:“一台成熟的量子计算机,需要多大规模?”如果忽略这一点,“1 万比特”就会被误读成一个即将到来的技术节点,仿佛只要继续堆叠 qubit 数量,就能自然抵达。可现实却是,从“能控制量子比特”,到“能用它稳定计算”,中间隔着一整套尚未完成的工程体系。即便我们暂时接受论文的前提,假设真的可以用约 1 万量子比特来运行 Shor 算法,问题也并没有结束。限制它进入现实世界的,还有另一件更直接的事情:时间。在论文中,那些约束更严格、结构更完整的方案给出的结果其实并不“惊艳”:这些数字的意义,不是“慢”,而是已经慢到失去现实应用意义。现代密码系统的安全性,并不要求“永远无法破解”,而是要求在可预见的时间窗口内无法被破解。一旦计算时间本身就达到数年甚至数十年,那么即使算法在理论上可以完成,它也不会构成实际威胁。因为在结果出来之前,密钥早已更新,系统早已替换。因此,这些方案更接近于一种“原则上可行”的证明,而不是“现实中可用”的能力。同时,这也揭示了一个经常被忽略的关键区别:“能运行 Shor 算法”与“能够破解密码”,中间隔着的除了技术细节,还有时间是否在有效区间内。如果时间不可接受,那么规模再小,理论再优,也无法改变一个事实:这台机器,依然无法在现实世界中完成它被期待完成的任务。如果说“1 万比特”只是让人重新评估规模,那么真正让这篇论文引发轰动的,是另一个更具冲击力的结果:在优化架构下,可以在约 10 天量级破解 ECC。这个结论的重要性不言而喻。它意味着,一旦时间瓶颈被打破,量子计算将从“理论可行”跃迁为“现实威胁”。但也正因为如此,这一结果最容易被误读。一个关键但常被忽略的事实是:这个“10 天结果”,并不来自前面那套相对完整、约束更严格的架构,而是依赖论文中另一条更激进的路径,可以理解为一套“加速版本”。换句话说,论文实际上做了两件不同的事:一条路径,证明“可以用更少的比特完成计算”;另一条路径,尝试证明“可以用更短的时间完成计算”。“10 天”这个数字,属于后者。这条加速路径的核心思路并不复杂:通过大规模并行,把原本需要逐步执行的计算压缩到更短时间。为此,它依赖了一整套能力:理论层面,这些方向都是成立的,也是当前量子计算研究的重要方向。可问题在于,这些能力,目前并没有在同一系统中被完整实现。这意味着,这条路径当前的状态更接近于“如果这些工具都具备,可以达到的性能上限”,而不是“沿着现有技术路线即将实现的能力”。换一个更直观的理解方式就是,前面的结果是在回答“这件事需要多大的机器”,而这一部分则是在假设“如果这台机器还能以理想方式运行,它能有多快”。问题在于,这个“理想方式”本身,尚未被证明可以实现。为了实现“10 天破解 ECC”,物理比特数必须从约 1 万个增加到 2.6 万个;而为了实现“97 天破解 RSA”,物理比特数甚至需要增加到约 10.2 万个,经典的“空间与时间博弈”操作:如果你坚持只要 1 万个比特,就要付出“等一个世纪”的代价;如果你想要在 10 天内破译,你就得支付“10 倍比特数”的账单。因此,“10 天破解 ECC”真正的含义,并不是“时间已经被压缩到这个量级”,而是在一组尚未闭环的工程前提下,理论上存在这样的加速空间。上面所有这些前提,都是决定它能否从“惊艳结果”,走向“现实能力”的关键。如果进一步深入到硬件层面,我们可以看到更具体、也更关键的挑战。“1ms 纠错周期”与“物理尺寸扩展”之间的潜在冲突

论文假设量子纠错循环可以在约 1 ms 内完成,这一参数直接决定了整体运行时间。但回到现实,当前实验演示通常仍停留在“数毫秒”量级。更重要的是,在中性原子体系中,量子比特依赖光镊进行移动与重排,而这一过程的时间会随着阵列线性尺寸(L)的增加而增长。这意味着,当系统为了提升并行度而从几千、几万比特继续扩展时,其物理尺寸的扩大,很可能反过来拉长每一轮纠错循环的时间。也就是说系统规模越大,单步操作未必更快,反而可能更慢。这种“规模扩展与操作速度之间的张力”,使得固定的 1 ms 周期更像一个需要持续追赶的目标,而不是已经被验证的工程基线。一旦这一假设无法在大规模系统中成立,论文中的时间估算就会整体放大。论文中最具吸引力的“10 天级提速”,高度依赖所谓的高率手术(high-rate surgery),即在高编码率纠错码中并行执行复杂逻辑操作的能力。但在实际工程中,这类操作的构造与验证极其困难,需要对大量高权重算子进行精确控制与数值验证。目前来看,论文仅展示了成千上万个所需算子中的极少数示例,而大量关键组件仍依赖尚未完整公开或验证的后续工作,全文包含了多达 11 处关键假设。这意味着,支撑并行加速的“操作工具箱”,还没有真正建立起来。当前高保真量子门操作主要在数百比特规模内实现,将其扩展到万比特,不仅需要显著提升激光功率与占空比,还需要在更大系统中维持一致的控制精度与稳定性。同时,大规模并行操作还会带来巨大的经典控制与调度开销,这部分成本在理论估算中往往被低估,但在工程实现中不可回避。如果这些底层的“水电煤”(如激光、控制系统与调度能力)无法同步提升,那么再精巧的容错设计,也难以在现实系统中闭合。这些因素叠加在一起,使问题从“是否存在一种可行设计”,转变为这种设计,是否能够在真实硬件中稳定、可扩展地运行。如果只看传播层面的表述,它似乎在暗示一件事:量子计算正在逼近破解现代密码的现实临界点。但当我们把所有前提逐一拆开之后,会发现一个更克制、也更准确的结论:这篇论文真正完成的是一件重要但有限的工作,即重新定义了“这件事需要多大规模”。通过更高效的纠错编码与特定架构设计,它证明量子破解密码所需的资源,可能远低于过去“百万级”的普遍认知。这是一次实质性的进展,因为它改变了问题的“尺度”。但与此同时,它并没有完成另一件同样关键的事情:证明这条路径已经接近现实。无论是运行时间、并行计算能力,还是底层硬件与控制系统,这些决定“能否真正实现”的关键环节,仍然停留在假设、推演或局部验证之中。换句话说,论文回答的是:“如果一切条件理想,这件事可以做到什么程度”?而不是“按照当前技术,我们距离做到这件事还有多远”?因此,更准确的总结应该是它让问题变小了,但没有让我们更接近答案。在量子计算这样一个高度依赖工程落地的领域中,真正决定进展的,往往不是“最优方案是否存在”,是这条方案,否在现实世界中被稳定、可扩展地实现。而这,正是这篇论文留给未来、也留给工程实践的真正问题。

1、https://arxiv.org/pdf/2603.286272、https://scirate.com/arxiv/2603.28627

WAIC 2025 对未来智能的深刻拷问:从辛顿的 AI 洞见,到玻尔兹曼机的量子新生

海外量子股狂热上涨!产业、生态齐发力,一场全球 AI+ 量子算力融合战已打响

10 亿澳元投光量子路线!史上最全面分析澳大利亚政府为何最爱 PsiQuantum

量子计算“拐点”已至!英伟达的未来不止GPU,黄仁勋指向了一个新“Q”

播客访谈实录|量子计算今天就已经能够为客户创造可量化的商业价值

光子芯片新时代即将到来!专访上海交通大学陈险峰教授

移动正谋划一盘量子计算的大棋?中国移动集团级首席专家钱岭谈算力网络

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。