边运行边“回血”!哈佛展示 3000 比特中性原子新架构:每秒补充 3 万量子比特,直指通用容错

发布时间:2026-04-16来源:量子前哨

长期以来,中性原子量子计算始终受困于“原子丢失”与“脉冲运行”的瓶颈,如同一场因频繁故障而被迫中断重启的演出。

哈佛大学与 MIT 联合团队发表在《Nature》上的研究,打破了这一僵局:他们构建起规模超 3,000 个比特的宏大阵列,实现了长达 2 小时的连续相干运行。

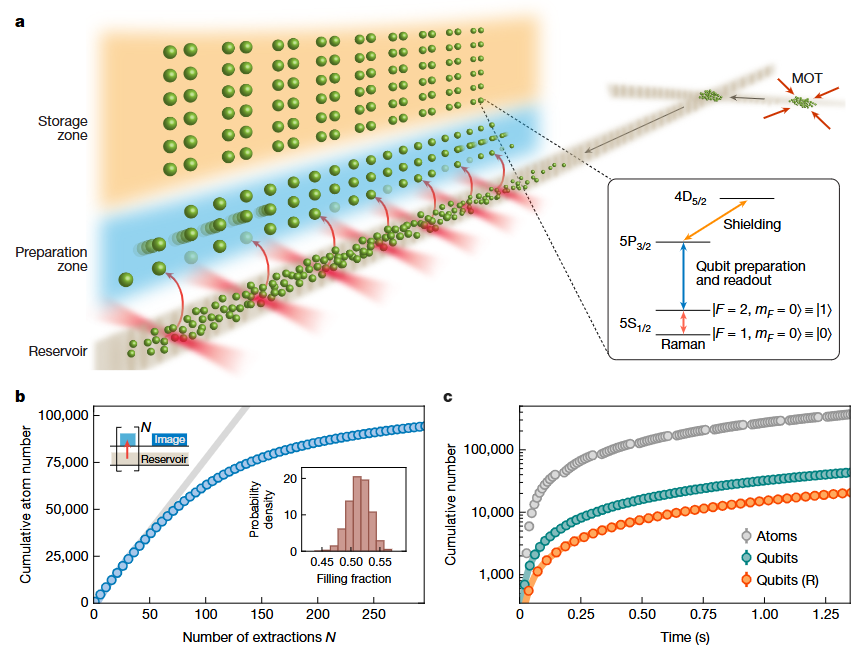

通过革命性的“双光晶格传送带”与“光学屏蔽”架构,该系统实现了在计算不停机的状态下,以每秒 3 万个比特的速度精准“补位”,不仅补齐了容错量子计算缺失的运行机制拼图,更宣告了“连续模式”时代的到来。当量子比特不再是易耗品,而是成为源源不断的“资源”,它又会将量子计算推进到哪一步?过去几年,量子计算的进展常常被一些耀眼的数字定义:更多的量子比特、更复杂的计算任务、甚至是“量子优势”。只是,这些进展中混入了一个很反常的特点:计算的确加速了,但很难一直算下去。很多时候,一台量子计算机已经进入状态,计算也在推进,但还没等结果出现,系统本身就开始“衰退”:有的量子比特悄悄消失,有的逐渐失去相干性,还有的在操作过程中累积误差。于是整套系统不得不停止,重新准备,再来一遍。如同一场本该持续数小时的演出,却因为舞台不断出现小故障,被迫反复中断重启,这势必会打断原有节奏,令更复杂的“剧情”无法展开。这就是量子计算长期面临的一个隐性瓶颈:如何在不被打断的情况下,一直算下去。这个问题之所以重要,是因为量子计算真正有价值的任务,往往都依赖“长时间连续运行”。无论是量子纠错、复杂材料模拟,还是高精度测量,本质上都需要系统在稳定状态下持续演化,而不是一段一段拼接完成。在中性原子体系中,每一个量子比特都是被光束束缚住的单个原子,它们会因为操作、测量或环境影响逐渐丢失。系统因此被迫采用一种近似“分段运行”的方式:准备一批原子,运行一段时间,然后全部重来。如果量子比特注定会损耗,那么与其试图“让它不坏”,能不能换一种思路,比如在系统运行的同时,悄悄把坏掉的部分补上?这听起来像是一个工程细节,但其意义却非常深远。因为一旦这件事成立,量子计算的运行方式就会发生变化:从“每次重来”,变成“持续运行”。哈佛大学物理系、麻省理工学院物理系与电子学研究实验室发表在《Nature》上的研究,正把这种设想变成现实。他们构建了一个包含 3000 多个量子比特的系统,可以连续运行超过 2 小时,并在运行过程中持续补充新的量子比特,且不会破坏已有的量子信息。这不仅是一个规模或时间的突破,更重要的是,它让一个长期悬而未决的问题有了答案:量子计算具备了“不断电运行”的能力。一句话概括量子计算方式,大致可以理解为:先把一切准备好,再开始计算。系统需要预先完成一整套流程,装载原子、冷却、排列、初始化,然后才能进入计算阶段。一旦中途出现原子丢失或状态破坏,通常的做法是:全部停下,重新来过。这种方式有点像搭一座积木塔:每一块都要摆好,才能继续往上堆。但问题是,塔在过程中会不断“掉块”,于是你不得不反复推倒重来。但这篇论文改变了这种思路。研究团队不再试图“把系统一次性搭好”,而是把整个过程拆开,让不同步骤可以同时进行。他们把系统划分成三个彼此分离、却持续协作的区域:- 最外层,是一个持续“生产原子”的区域。这里不断产生冷原子,并通过两段光晶格构成的“传送带”,把它们从约半米之外源源不断送入系统深处。这个过程是连续发生的,就像一条不会停下的供给线。

- 中间区域负责“加工”:新到达的原子在这里被冷却、筛选,并被整理成整齐的阵列,同时被赋予初始的量子状态。整个过程快速而高效,就像一个自动化装配环节。

- 最核心的区域,则专门用于“运行”:这里存放着已经参与计算的量子比特,它们的状态需要被尽可能稳定地维持。

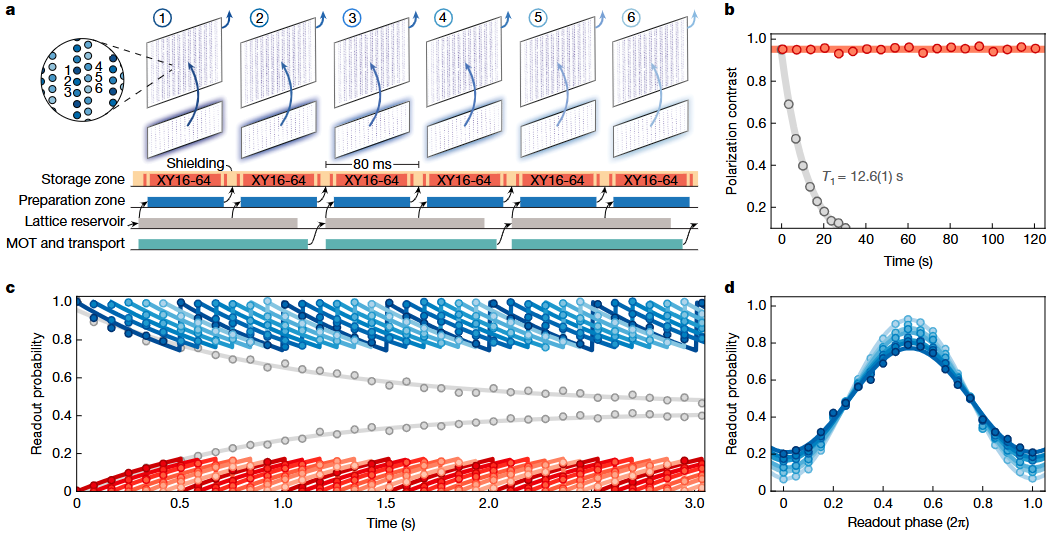

这三个区域的设计带来了一个非常重要的变化,那就是新原子的准备,不再需要等待旧系统结束。换句话说,系统不再是“准备好一切再启动”,而是变成了一个持续流动的过程:一边运行,一边有新的“组件”被生产出来。更关键的一步,是他们解决了“如何在不打扰系统的情况下补充原子”。传统方法需要使用激光冷却,而激光不可避免地会产生散射光,这些光会干扰甚至破坏已有的量子态。研究团队采取了一种更“克制”的方式:在加载原子时不使用额外的冷却光,而是让光镊直接从原子云中“抓取”原子,这依赖于随机重叠(Stochastic overlap)原子碰撞机制实现。这个看似细微的改变,实际上意义重大,因为它让“补充”这件事变得几乎“无声无息”,不会打断正在进行的量子演化。在这样的机制下,系统获得了稳定而高速的“补给能力”:每秒可以准备数万个新的量子比特,并持续送入系统。这就带来了一个本质上的变化,量子比特不再是“用完就没”的消耗品,而是成了可以不断流入系统的资源。更进一步的,量子计算也更趋于一个“在运行中不断更新、在更新中持续存在”的系统。前面的设计解决了“量子比特不够用”的问题,接下来还有另一个更隐蔽、也更关键的挑战:补原子的动作,会不会把正在运行的量子计算毁掉?量子态极其脆弱。在实验中,任何对原子的操作,尤其是成像、冷却、操控,几乎都离不开光,而光一旦被原子吸收和散射,就会像“噪声”一样,把精心维持的量子相干性迅速打乱。因此在传统方案里,“补原子”这件事,本身就是一种干扰。你越频繁地补,系统就越难保持稳定,这也是为什么过去的量子系统往往只能在“安静状态”下运行,一旦需要补充或重置,就必须整体停下来。这篇论文真正突破的地方是,研究团队让两件原本互相冲突的事情,第一次同时成立了:系统在被不断“修复”的同时,仍然保持量子相干,并持续运行。在保持存储量子比特相干性的同时进行连续操作:图源论文首先是空间上的隔离。制备区和存储区之间没有直接的光路连接,从结构上减少干扰。但仅靠这一点还远远不够,因为光总会以各种方式散射。我们可以把它理解为:研究人员用特定波长的激光,悄悄改变了存储区原子的“响应方式”,让它们对某些频率的光变得不再敏感。这样,即使在制备区进行成像、冷却等操作,产生的散射光也很难影响到这些已经在“工作”的量子比特。实验结果非常直观。如果没有这种屏蔽,只要在旁边进行一次成像操作,量子相干就会迅速崩溃,而加入屏蔽之后,相干时间几乎恢复到系统本来的水平。在此基础上,研究团队又加入了一层“动态保护”,通过精心设计的脉冲序列,不断抵消环境带来的扰动,让量子态维持得更久。此外,研究团队对“量子叠加态”的处理方式,同样令人印象深刻。叠加态比简单的“0 或 1”更脆弱,也更有价值。在系统需要替换某一部分原子时,研究人员会先把这些量子态暂时“转存”到一个更稳定的形式,完成替换后,再恢复回原本的叠加状态。整个过程就像是在运行中做一次“热备份”,然后再无缝切回,这在技术上被称为“相干映射到布居数”。结果是,在不断补充和替换的过程中,系统仍然有大约 90% 的时间保持在相干状态,这意味着量子计算不再需要“暂停维护”,而是可以在维护中继续进行。就像一台正在高速运转的机器,你可以在它运行时更换零件,还不会影响它正在执行的任务。在量子世界里,这一步极其困难,而这篇论文证明是可以做到的。如果只看表面,这项研究的成果已经足够惊艳:3000+ 量子比特、超过 2 小时的连续运行、每秒数万级别的补充能力。再往深探究,它还补上了量子计算发展过程中长期缺失的一环。一直以来,人们谈论量子计算,往往集中在几个指标:量子比特数量够不够多,量子门操作是否足够精确,算法是否能够展现优势。这些当然重要,但它们都隐含了一个前提,那就是系统必须能够稳定运行。量子计算真正的难点,除了“把系统做出来”,还有就是要让它在长时间内保持可用。尤其是在容错量子计算中,系统需要不断执行纠错循环,这就得经历成千上万、甚至更多轮操作,如果系统在计算过程中频繁中断,那么再精妙的设计也无从发挥。从这个角度看,这篇论文所解决的问题,并不在传统的性能指标之中,而是补上了量子计算走向实用所需的“运行机制”,让量子系统具备持续运行的能力。把量子计算看作一个完整系统,大致需要几块关键拼图:可靠的量子门操作、可扩展的硬件架构、成熟的纠错理论,以及能够支撑这些过程持续发生的运行能力。过去几年,前三块拼图已经逐渐清晰,但最后一块长期缺位。这项工作,恰恰填上了这一空白。论文中给出了一个非常关键的工程判断:按照当前的补充速率,系统已经可以支持大约一万个物理量子比特规模的持续运行,这正是许多容错方案开始变得可行的量级。当然,这项研究工作还无法直接等同于“通用量子计算已经实现”。从完整的工程路径来看,它更像是跨过了一道关键门槛,后面的路依然存在挑战。例如在中性原子体系中,双比特量子门的精度仍需进一步提升,才能满足严格的容错要求。再比如,真正意义上的逻辑量子比特(通过纠错编码得到的稳定信息单元),还没有在这一架构中完整展示。此外,这套系统本身的复杂度也不容忽视。从长距离原子输运,到多区域协同,再到实时的补充与调度,它已经不仅仅是一套实验装置,更是一个高度复杂的运行系统。如何在保持性能的同时简化和稳定这些流程,是走向更大规模时必须面对的问题。回到开篇,量子计算面临的瓶颈之一,是一种可以持续运转的方式。而现在,新的形态开始出现,系统在运行的同时不断更新,在更新中维持自身,在维持中继续计算。这种变化,也许不像“量子优势”那样直观,但它更接近一个根本问题的答案:当量子计算不再频繁停下来,这种“持续存在”的能力更能助其在真实场景中释放潜力。

https://www.nature.com/articles/s41586-025-09596-6

WAIC 2025 对未来智能的深刻拷问:从辛顿的 AI 洞见,到玻尔兹曼机的量子新生

海外量子股狂热上涨!产业、生态齐发力,一场全球 AI+ 量子算力融合战已打响

10 亿澳元投光量子路线!史上最全面分析澳大利亚政府为何最爱 PsiQuantum

量子计算“拐点”已至!英伟达的未来不止GPU,黄仁勋指向了一个新“Q”

播客访谈实录|量子计算今天就已经能够为客户创造可量化的商业价值

光子芯片新时代即将到来!专访上海交通大学陈险峰教授

移动正谋划一盘量子计算的大棋?中国移动集团级首席专家钱岭谈算力网络

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。