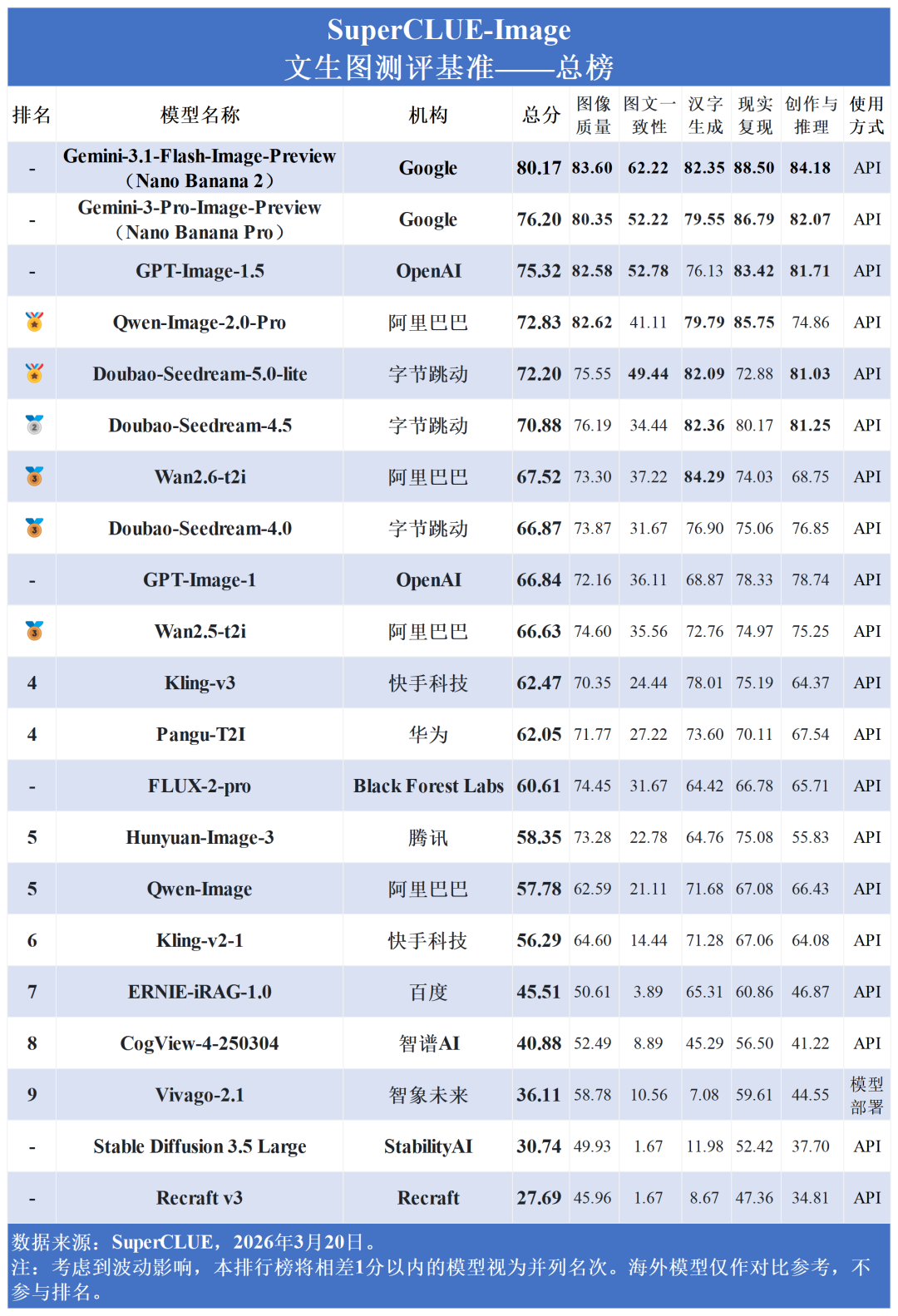

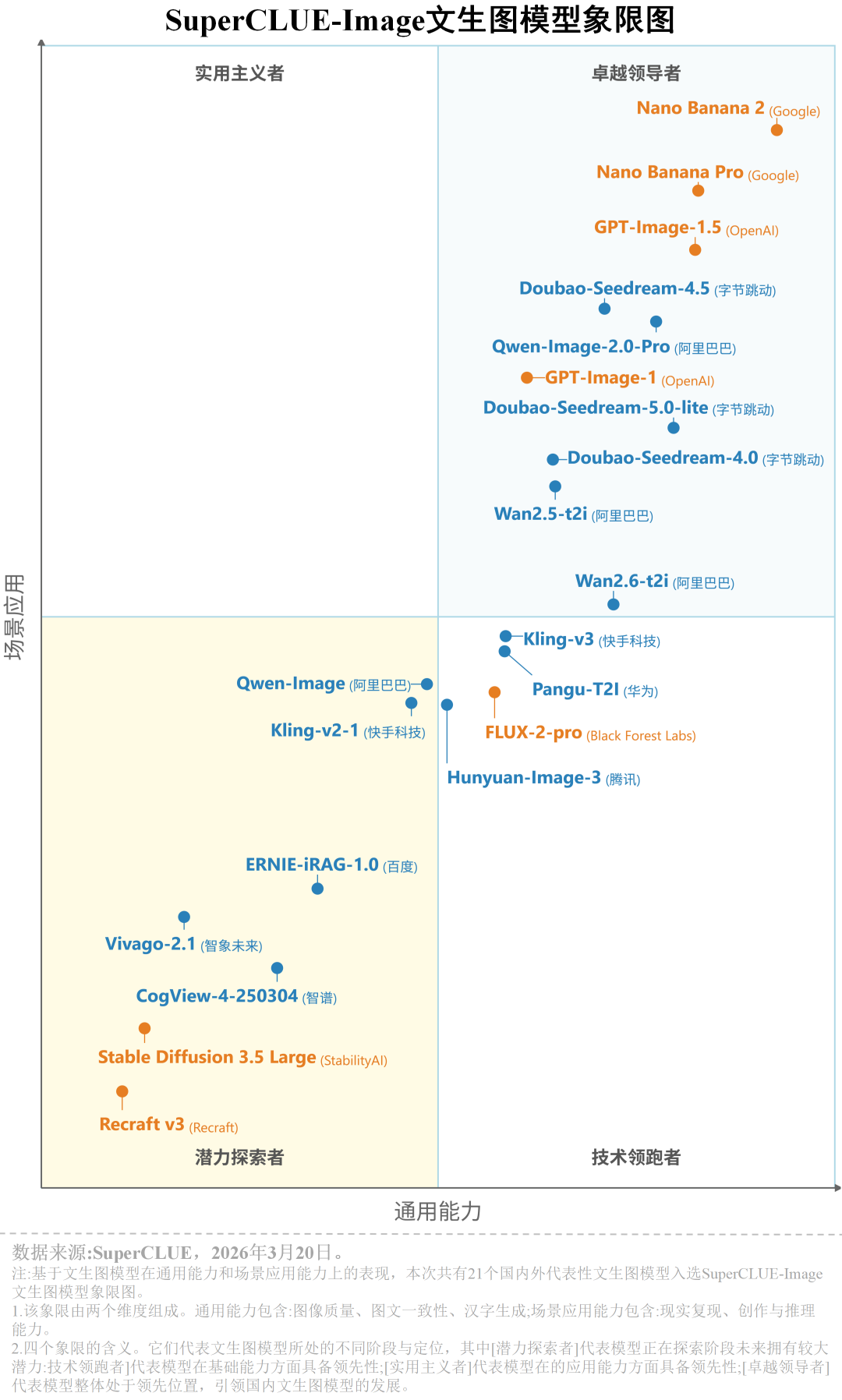

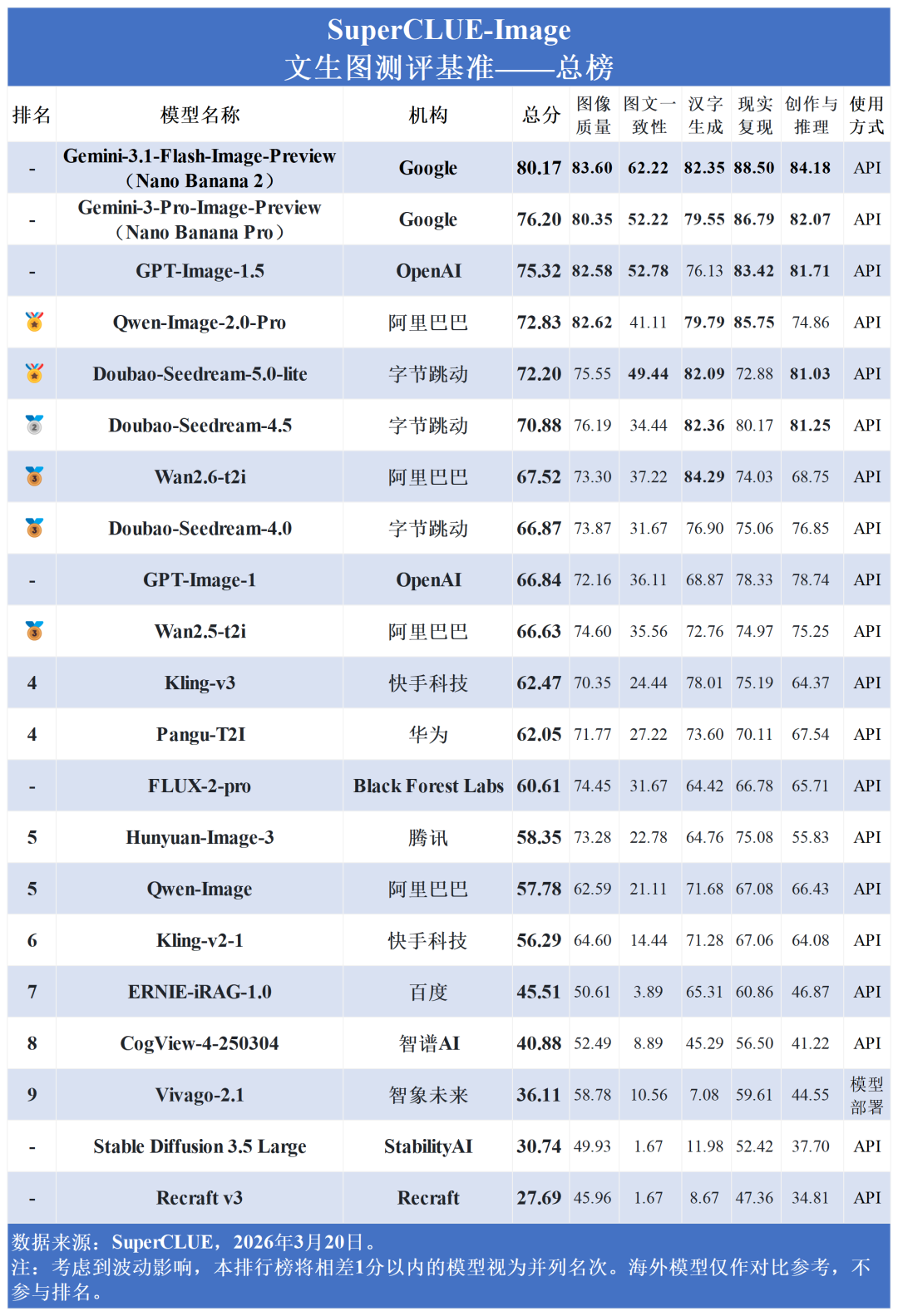

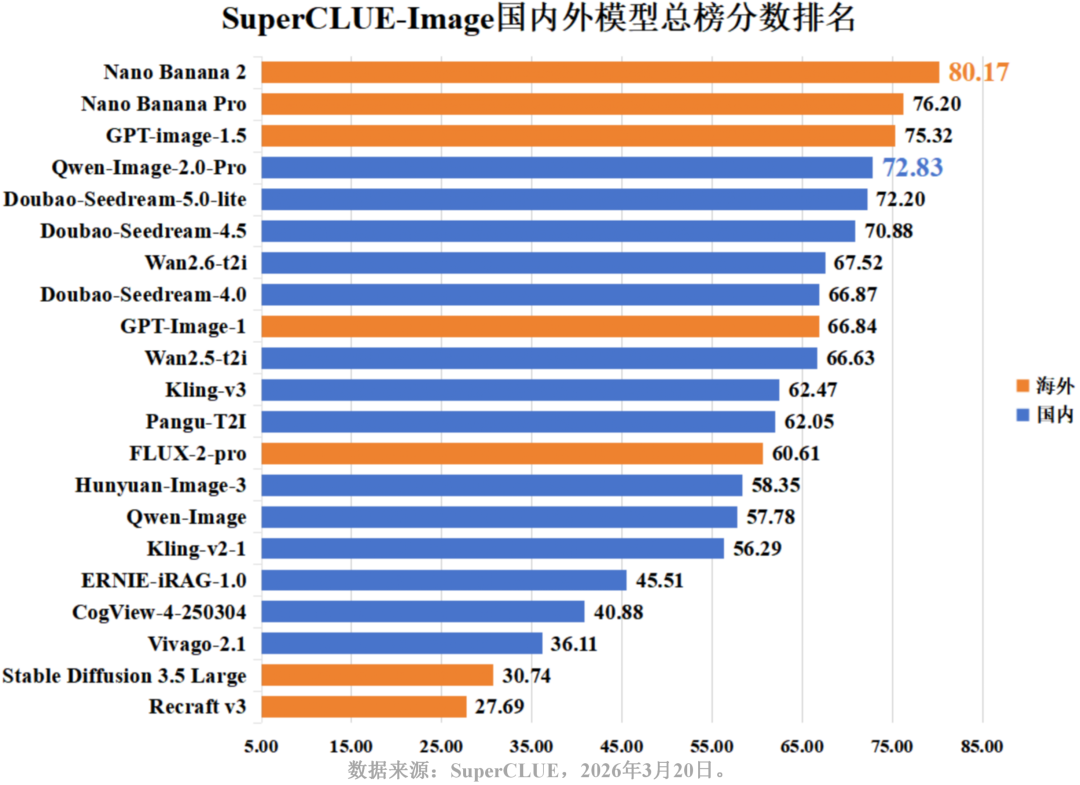

3月文生图榜单发布!Nano Banana2断层领跑,千问、字节强势追赶!

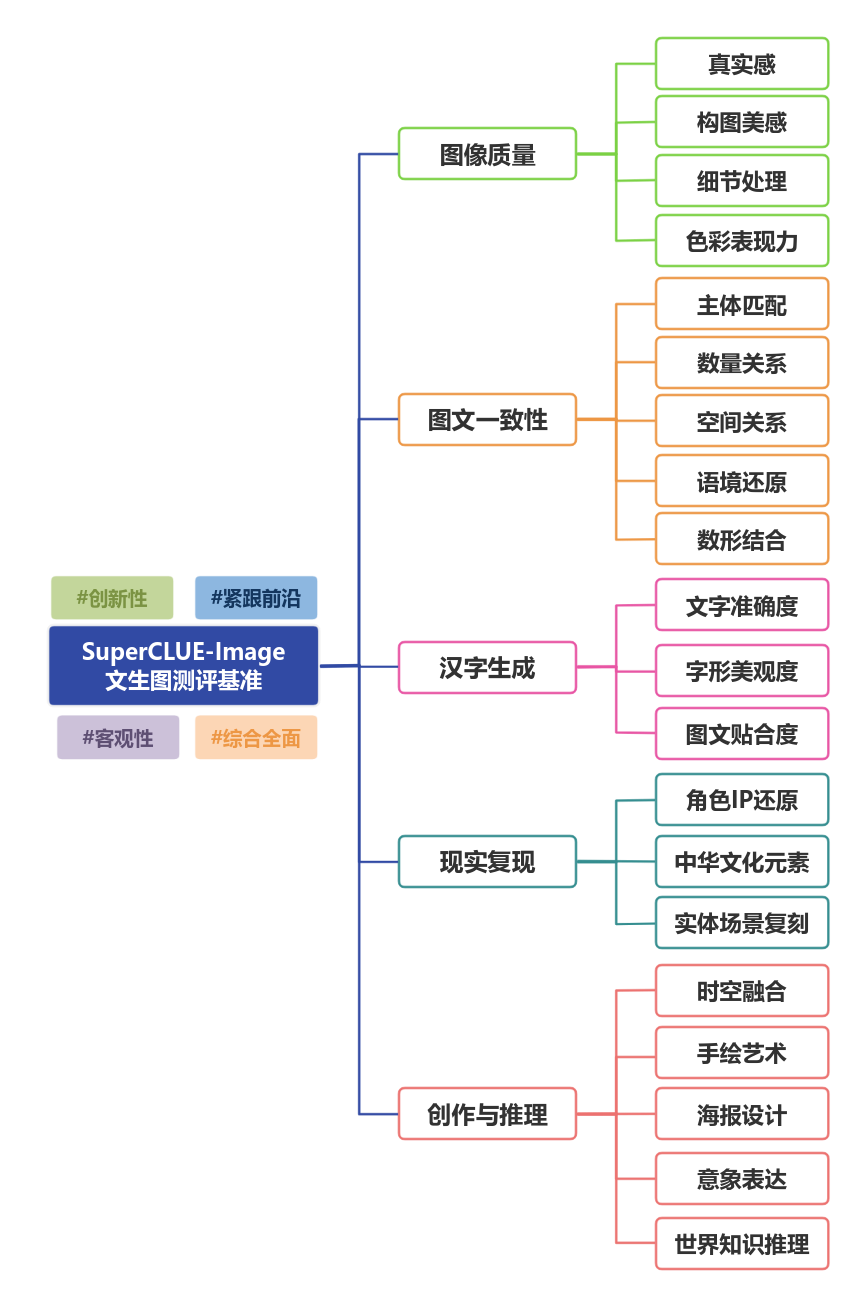

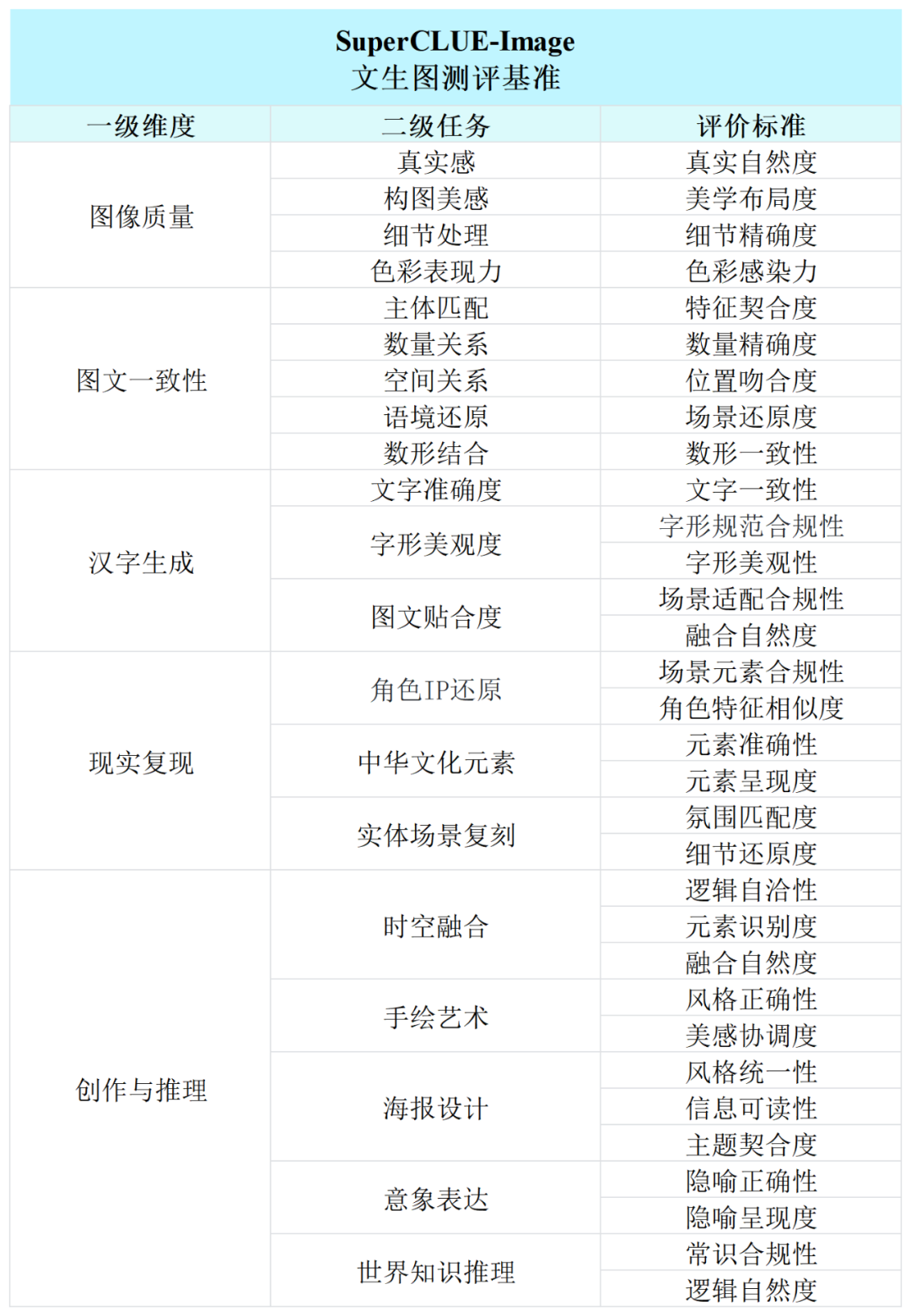

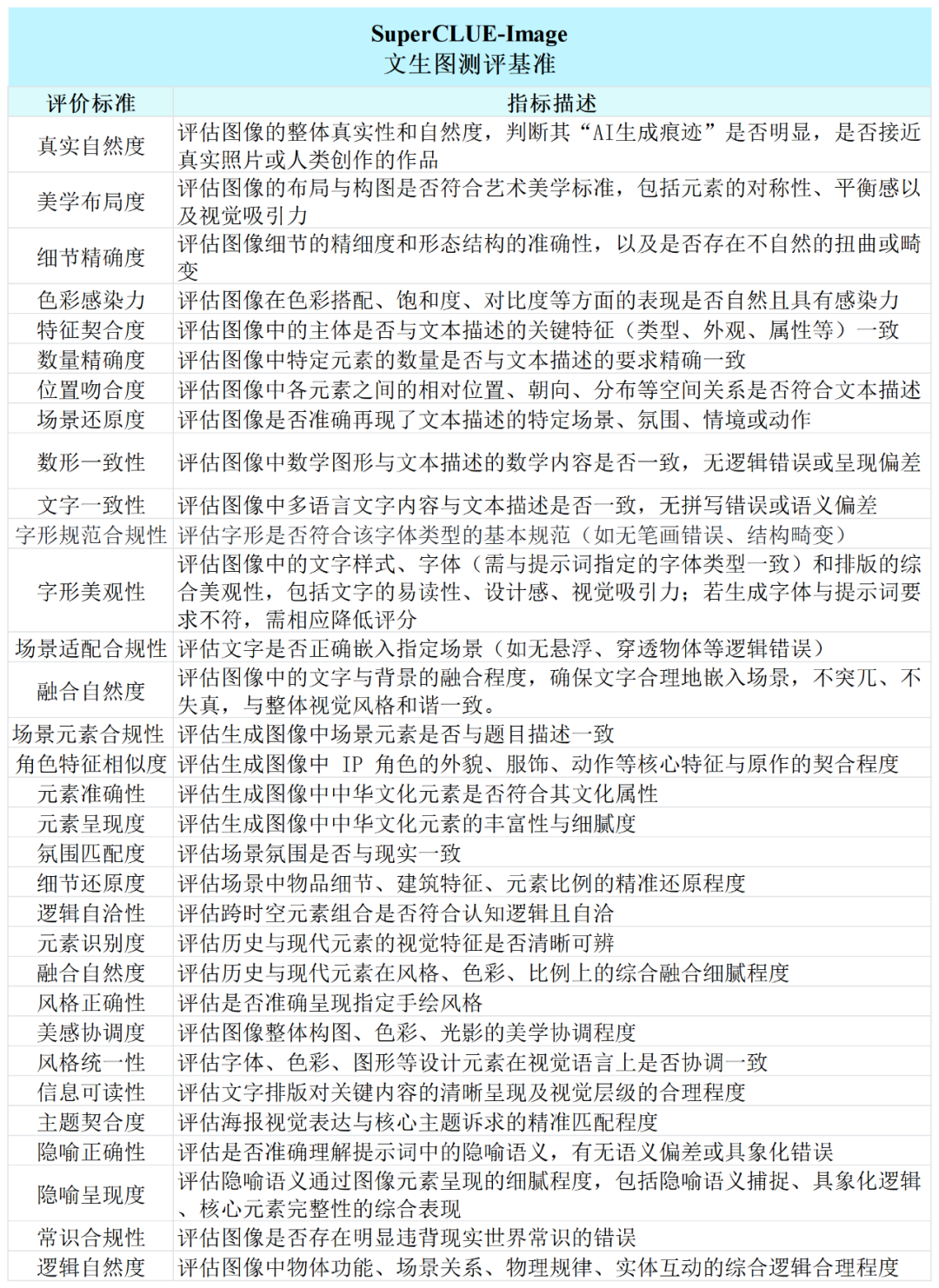

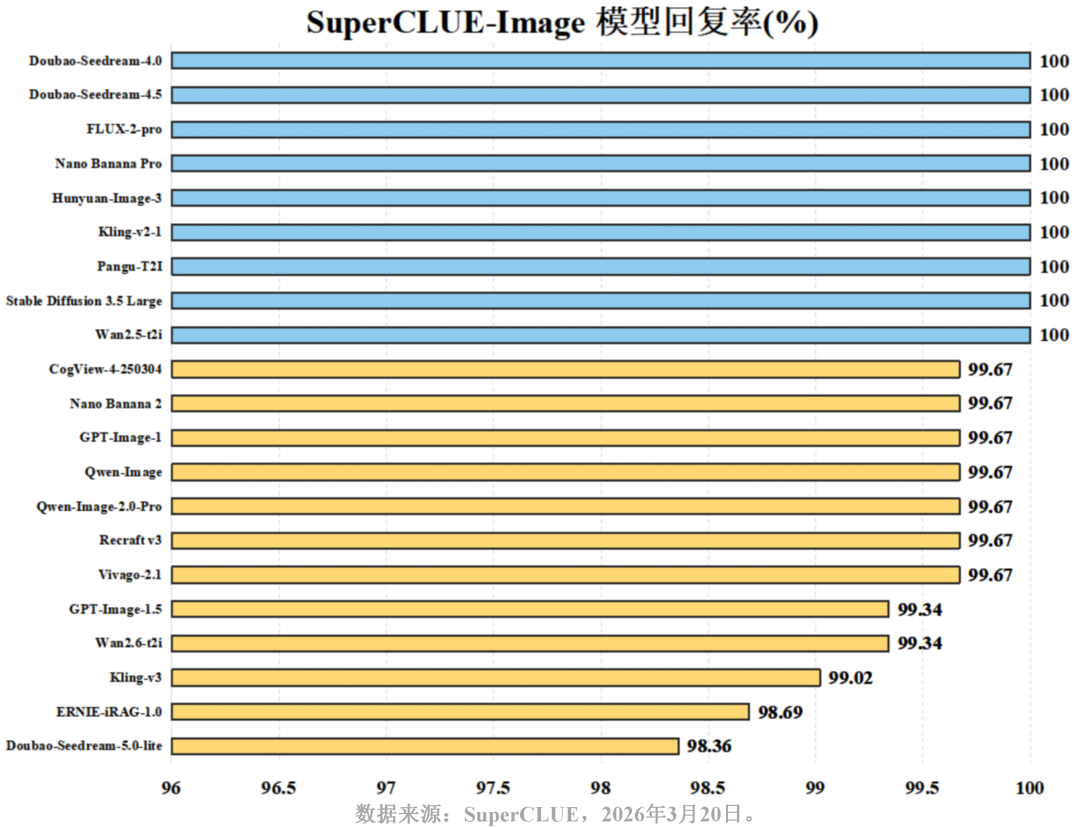

2026 年 3 月,SuperCLUE-Image 中文原生文生图最新测评榜单发布。本次沿用升级后的 “基础能力 + 应用能力” 多维测评框架SuperCLUE-Image最新测评基准,覆盖图像质量、现实复现、创作与推理等关键维度,并进行人类一致性评估。

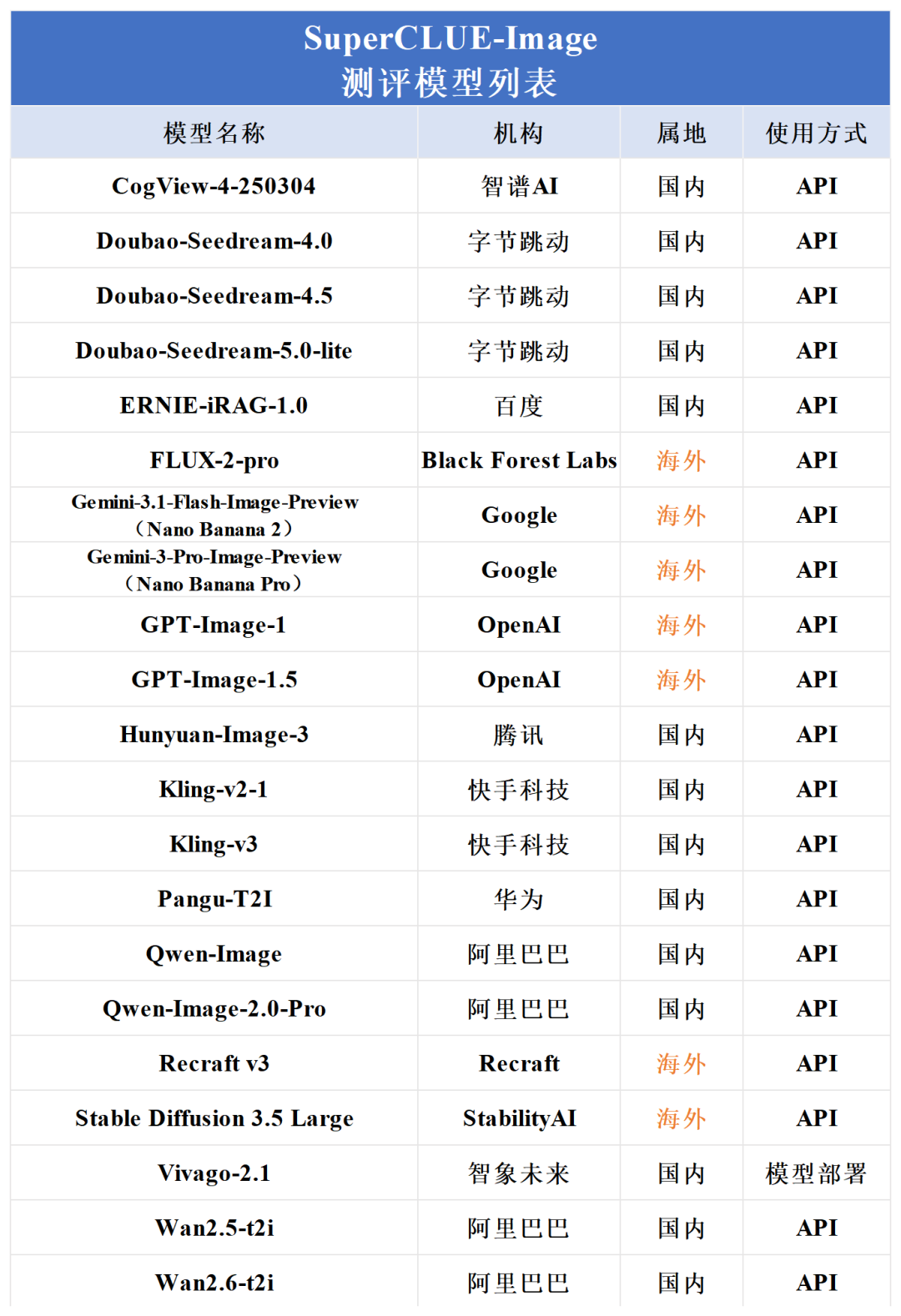

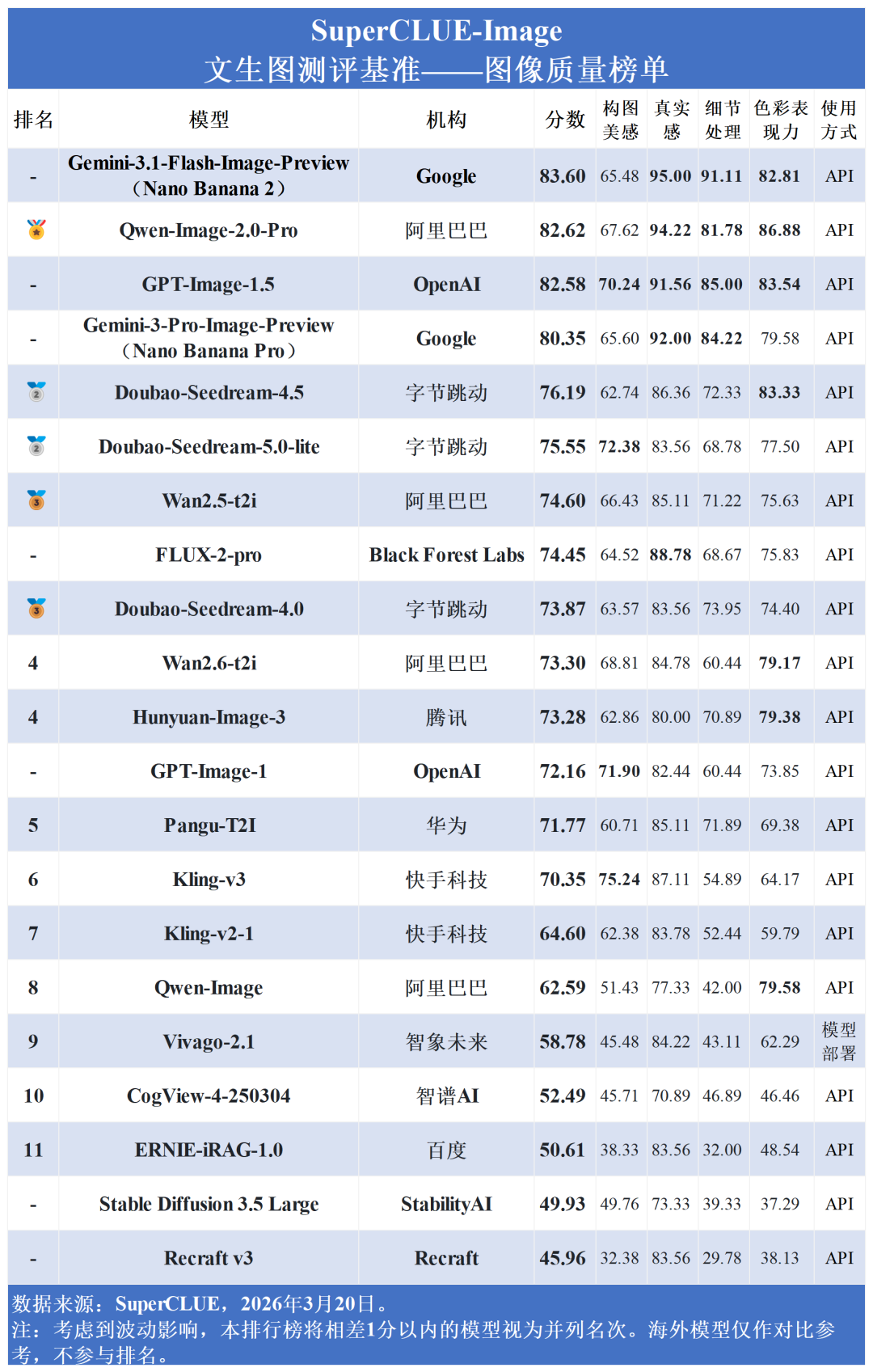

本次评测涵盖了国内外21个具有代表性的文生图模型,并对其综合能力进行了深入测评。以下为详细测评报告:

「过往文章介绍」

1.【Nano Banana 2 文生图测评文章】Nano Banana 2霸榜出世 | 文生图全球第一,最强多边形战士!

2.【Qwen-Image-2.0 文生图测评文章】Qwen-Image-2.0登顶国内第一 | 超强画质与现实复现,赋能国内AI视觉新高度!

3.【2025年11月SuperCLUE-Image 文生图测评榜单参考文章】11月文生图月榜:Nano Banana Pro 领跑,国内头部厂商跻身前五

提示词:生成彩色纸鹤串。彩色纸鹤串浅粉渐变深紫的羽翼,鹅黄描边的翅膀末端,悬挂在半透明白色纱帘前,午后暖橙色阳光透过纱帘在纸鹤表面形成鎏金光斑,旁边木质书架上垂落的翠绿常春藤与淡蓝色陶瓷小罐相映成趣。

测评核心内容摘要

摘要1:海外领先,国内厂商强力追赶!

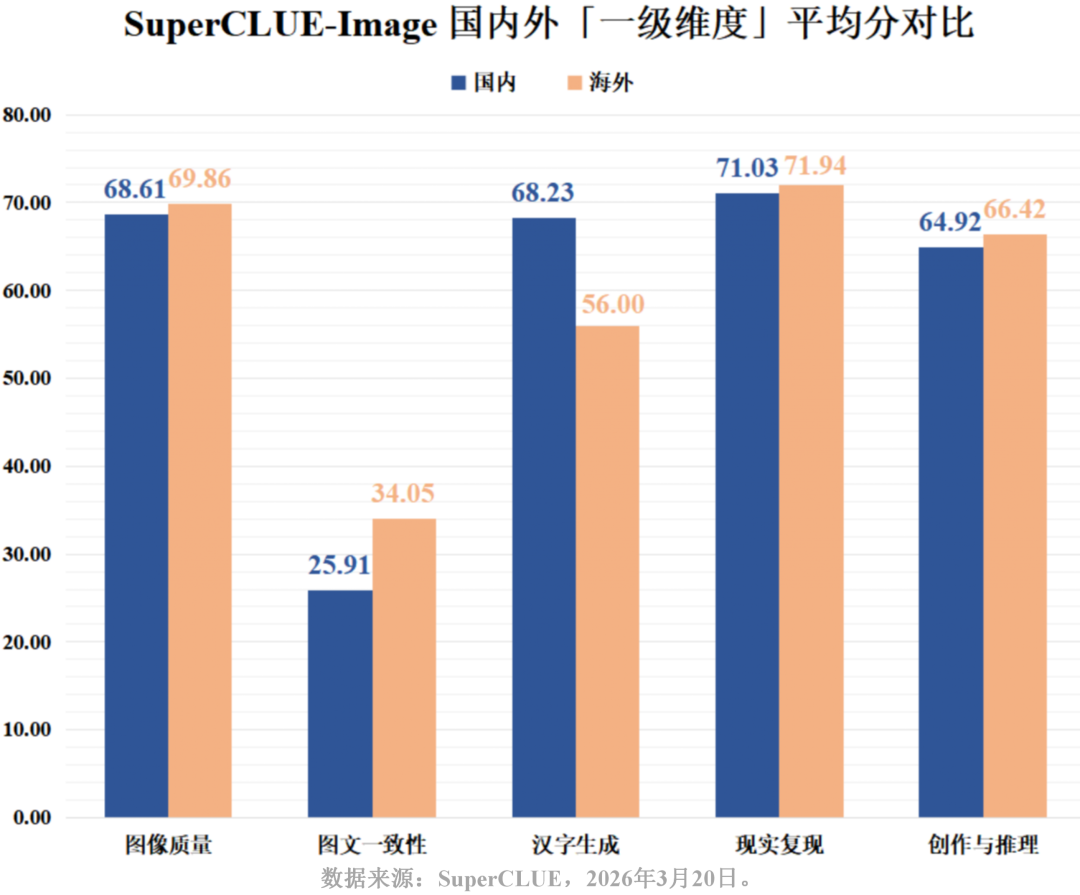

摘要2:国内汉字生成强,趋于领先地位。

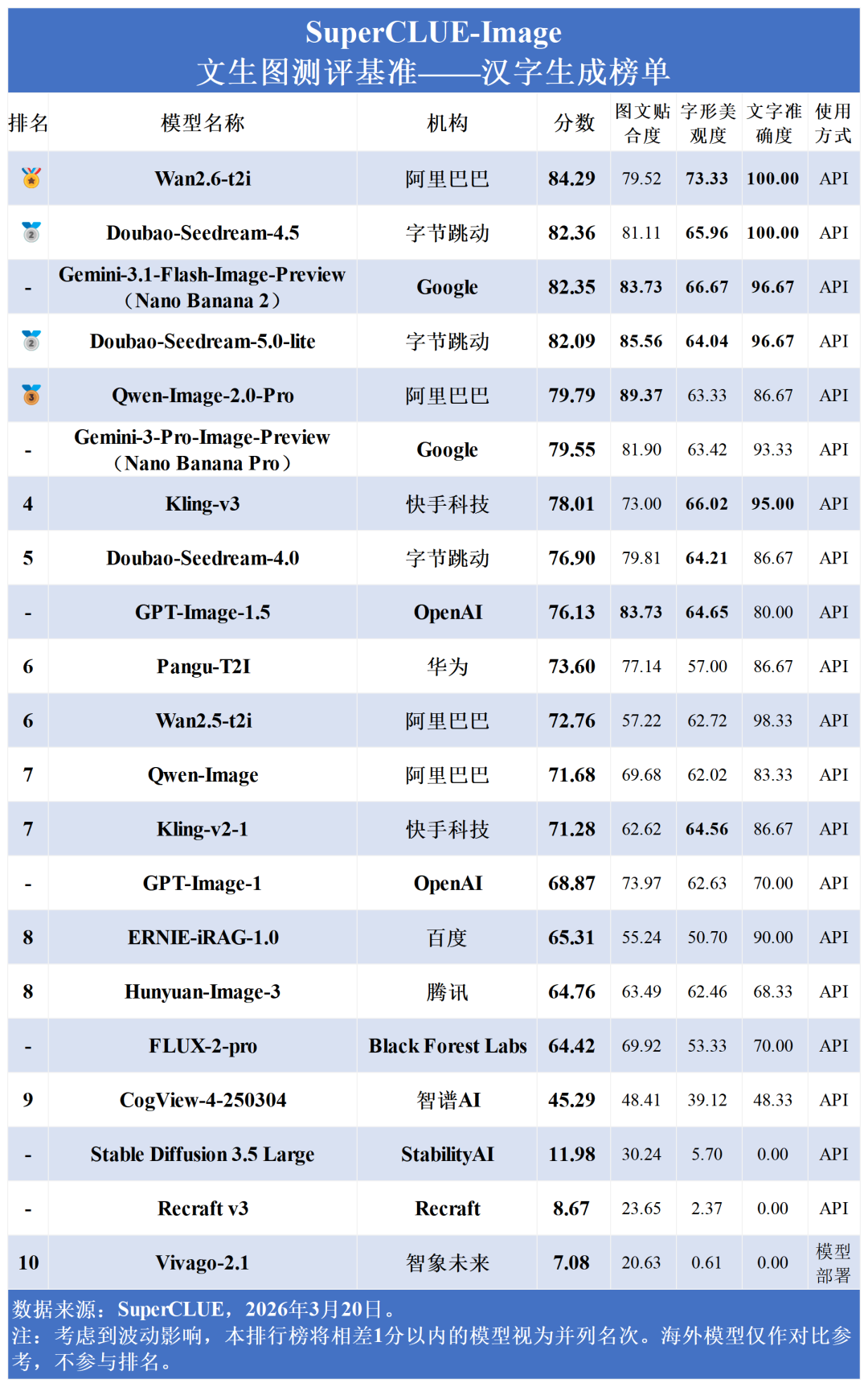

国内汉字生成平均水平超海外,阿里的Wan2.6-t2i (84.29分)与字节的 Doubao-Seedream-4.5 (82.36分)位列一二。此外,Nano Banana 2 (82.35分) 杀入前三,打破“海外模型不懂中文”的刻板印象。

# SuperCLUE 文生图中文竞技场排行榜

本竞技场是一个大众投票的匿名评测平台,榜单汇聚最新投票数据,定期更新排名。诚邀您参与评测,在原生中文语境下用实际体验为模型能力提供真实反馈,共同完善文生图模型的评估标准。

访问地址:https://www.superclueai.com

SuperCLUE-Image 是一个专为文生图模型设计的评测基准,旨在为文生图领域提供全面且多维的能力评估参考。

# 测评方法和评估示例

评估示例

-----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀(0.8-1.0档) **基础要求检查:** 图像完全满足基础要求。核心主体、场景、细节均与Prompt高度吻合,无任何逻辑或常识性错误。 1. **标准1 <色彩感染力> 的评价:** 图像的色彩表现力堪称典范。它不仅准确地复现了Prompt中描述的所有颜色元素,更重要的是,它将这些颜色以一种极其自然、和谐且富有美感的方式组合在一起。多肉植物上复杂的色彩渐变(橙红-嫩绿-深褐)被完美呈现,这是衡量色彩能力的关键难点,而该图完成得非常出色。背景的浅灰、米白、淡蓝三色搭配,为鲜活的主体提供了一个沉静而有质感的衬托,使得整个画面的色彩情绪饱满且富有感染力。光线透过窗户洒在物体上,形成的明暗与色彩变化也处理得非常真实。 之所以给出0.9分而不是1.0分,唯一的扣分点在于,为了追求极致的区分度,我认为叶片上的“白色粉末”质感可以有更强的表现力,从而在色彩层次上增加更多细节。但这已是吹毛求疵。该图的色彩表现远超“良好(0.7)”和“优秀(0.8)”的水平,是“卓越”的代表。 基于标准1的得分:【0.90】 **综合得分计算:** 计算过程:(0.90) / 1 = 0.90 综合得分:【0.90】 -----评价结束----- 第二轮评价: -----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀(0.8-1.0档) **基础要求检查:** 图像完全满足基础要求。核心主体(一盆多肉植物)和场景元素(窗台、花盆、桌布)均与Prompt的核心意图高度一致,无任何逻辑或常识性错误。 1. **标准1 <色彩感染力> 的评价:** 图像的色彩表现力极为出色。首先,它精准地复现了Prompt中所有指定的颜色:多肉植物从顶端橙红色到中部嫩绿色再到底部深褐色的色彩过渡自然且层次分明,视觉效果非常逼真;叶片上的白色粉末质感通过色彩和光影得到了很好的体现;背景中的浅灰色窗台、米白色花盆和淡蓝色桌布,颜色准确,饱和度适中,共同构建了一个柔和、明亮的视觉环境。其次,整张图片的色彩搭配极具美感和感染力,冷暖色调对比和谐,主体突出,氛围宁静舒适,光线柔和地洒在物体上,使得各种颜色都显得非常自然生动。这种表现力不仅是技术的准确还原,更达到了艺术上的赏心悦目。 - **为何不能给1.0分**:尽管表现卓越,但1.0分代表着无可挑剔的典范。如前所述,底部叶片的“深褐色”略带红调,虽然这在现实中很常见,但与文字描述存在最细微的差别,因此保留了极小的扣分空间。 - **为何远高于0.8分**:该图不仅准确还原了所有指定颜色,更重要的是将这些颜色融合成一个极具感染力的整体画面。对“白色粉末”这一高难度细节的色彩表现,以及色彩之间平滑自然的过渡,都使其品质超越了“优秀”的范畴,达到了“卓越”的水平。 基于标准1的得分:【0.9】 **综合得分计算:** 计算过程:(0.9) / 1 = 0.90 综合得分:【0.90】 -----评价结束----- 第三轮评价: -----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀(0.8-1.0档) **基础要求检查:** 图像完全满足基础要求。核心主体(一盆多肉植物)和场景元素(窗台、花盆、桌布)均与Prompt的核心意图高度一致,无任何逻辑或常识性错误。 1. **标准1 <色彩感染力> 的评价:** 图像的色彩感染力极强,表现卓越。 **具体证据**:首先,它完美地捕捉了Prompt中对多肉植物本身色彩的复杂要求——“莲座状叶片顶端呈橙红色,中部过渡为嫩绿色,底部泛深褐色”,这个从暖到冷再到暗的渐变被处理得非常平滑和逼真。其次,背景元素的色彩也完全符合描述,“浅灰色水泥窗台”、“米白色粗陶花盆”、“淡蓝色棉麻桌布”,这些低饱和度的颜色为色彩鲜明的主体提供了极佳的衬托,使得整个画面的色彩和谐统一,主次分明,具有很高的美学价值和视觉吸引力。光线柔和,使得所有颜色看起来都非常自然、舒服,没有过饱和或失真的情况。 **评分理由**:该图像在色彩表现上几乎无可挑剔,精准还原了Prompt中所有关于色彩的描述,并且通过和谐的色彩搭配营造出了极具感染力的视觉效果。它远超“良好”(0.7)或“优秀”(0.8)的水平,因为它不仅准确,而且在色彩的运用上展现了相当高的“审美”。因此,给予其接近完美的分数是恰当的。它不能得1.0分,仅仅是因为1.0分代表着绝对的、超越性的完美,而此图虽极其出色,但仍是基于现实的精准复现,保留了极微小的提升空间。它比0.8分更好,在于其对“白色粉末”这一细微色彩质感的精准呈现和整体色彩构图的和谐度。 基于标准1的得分:【0.9】 **综合得分计算:** 计算过程:(0.9) / 1 = 0.9 综合得分:【0.90】 -----评价结束-----

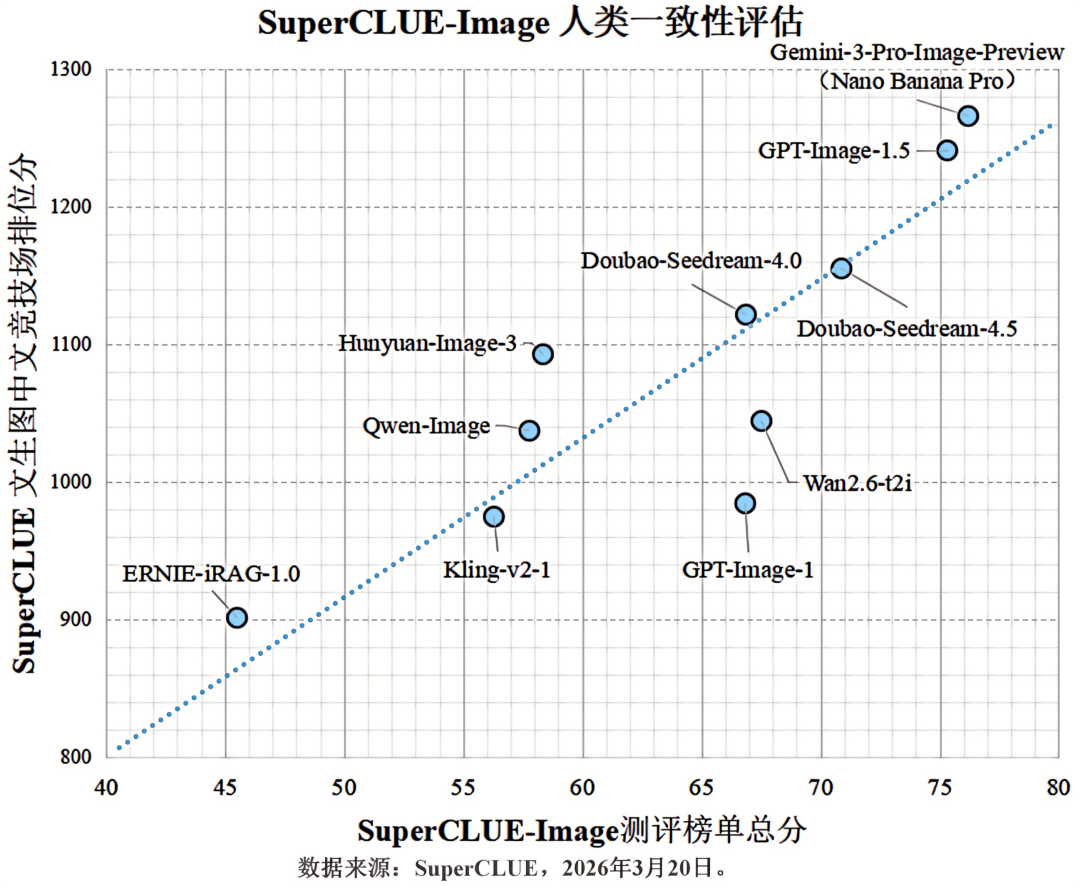

# 人类一致性评估

# SuperCLUE 文生图中文竞技场排行榜

为验证测评体系的公信力,我们将SuperCLUE文生图中文竞技场排位分与本次SuperCLUE-Image测评榜单总分进行交叉分析。结果显示,客观测评体系精准反映了真实用户的感官体验,具体统计指标如下:

皮尔逊(Pearson)相关系数: 0.9124,P值:1.0543e-04。表明测评分与排位分存在极强的正线性相关性,P值远小于0.05说明相关性极其显著。

斯皮尔曼(Spearman)相关系数: 0.9364,P值:2.6328e-05。表明测评分与排位分的排名顺序几乎完全一致,榜单排位具有极高可信度。

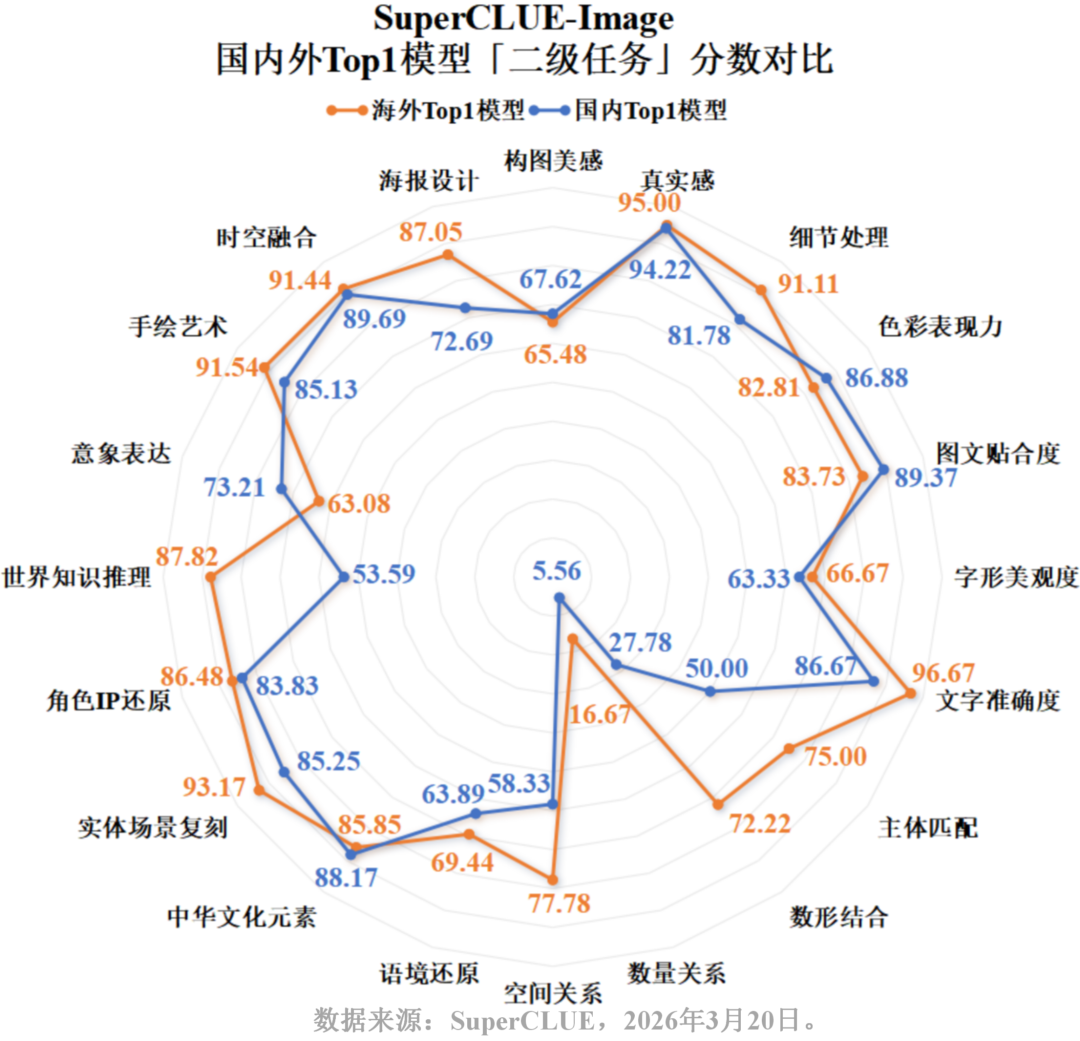

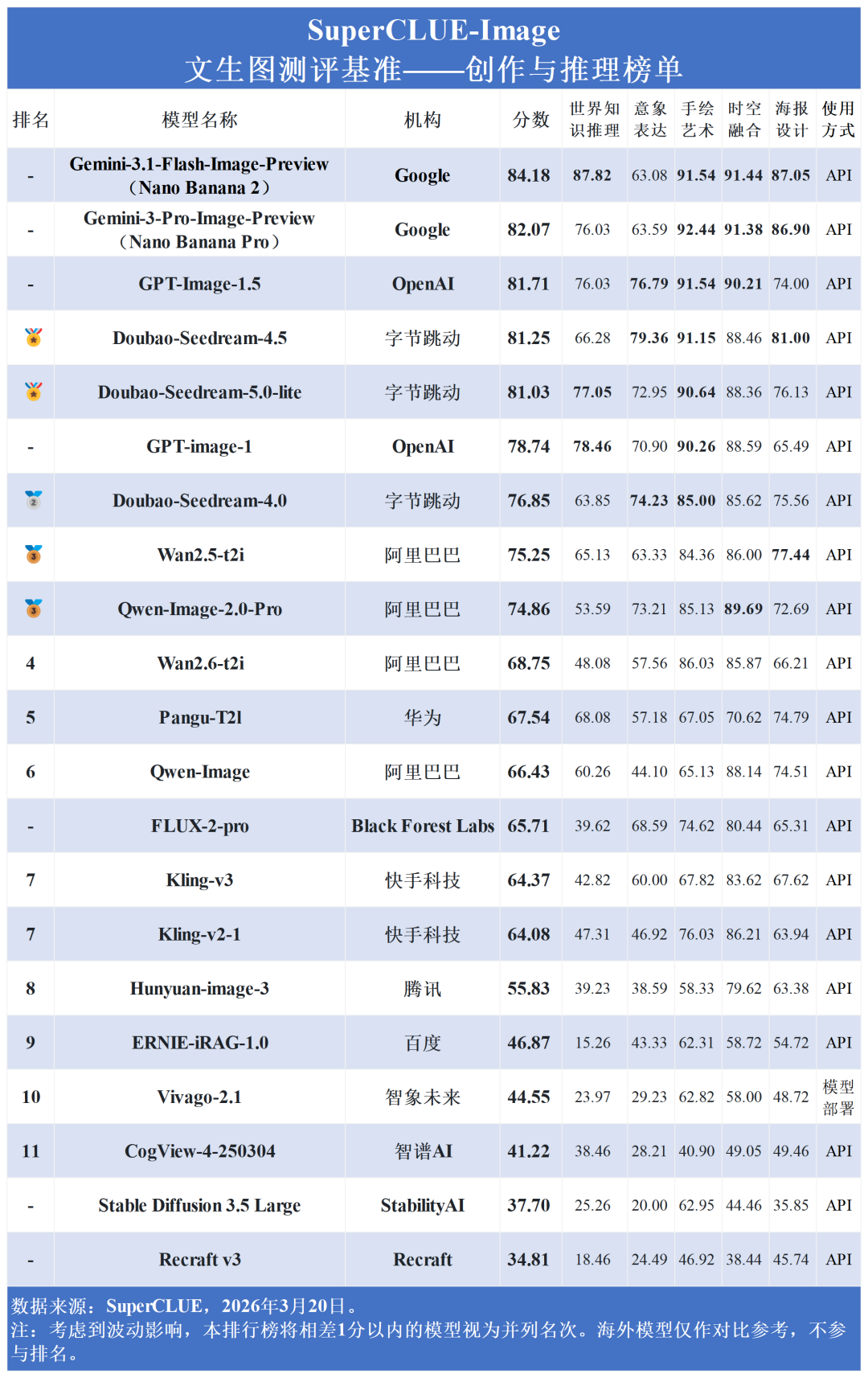

从国内外对比来看,国内大模型在“汉字生成”上稳稳压制海外(68.23 > 56.00)。在“图像质量”(68.61)、“现实复现”(71.03)与“创作与推理”(64.92)上与海外差距已压缩至个位数。然而,“图文一致性”上,国内平均分 (25.91)显著落后于海外 (34.05),说明在复杂语义的精准理解上,国内模型仍有较大进步空间。

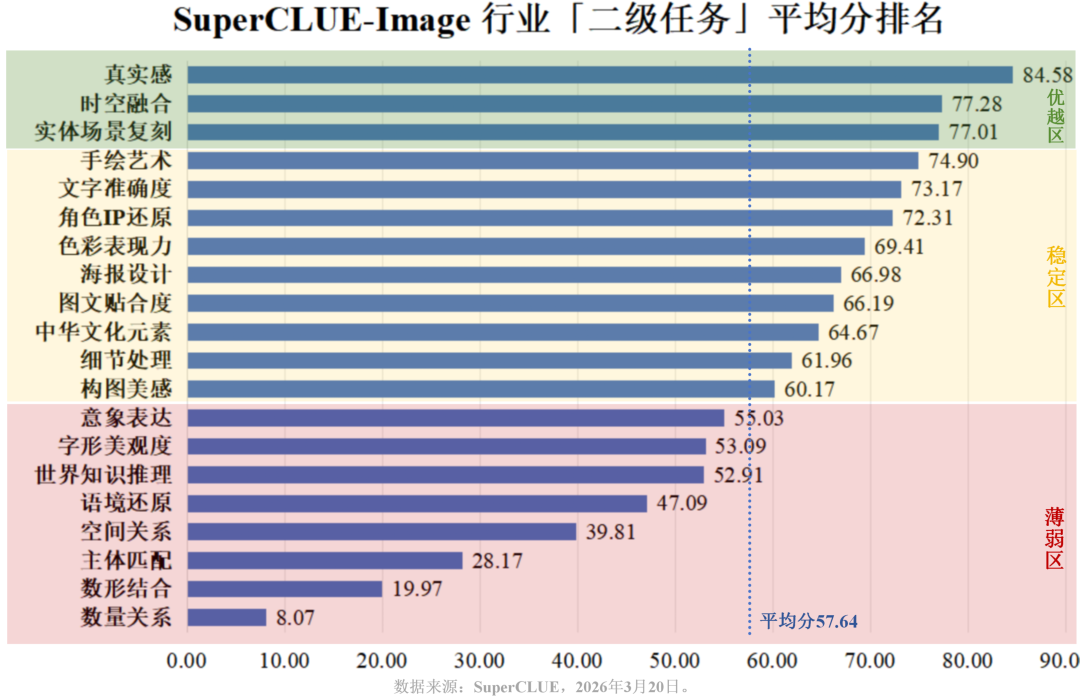

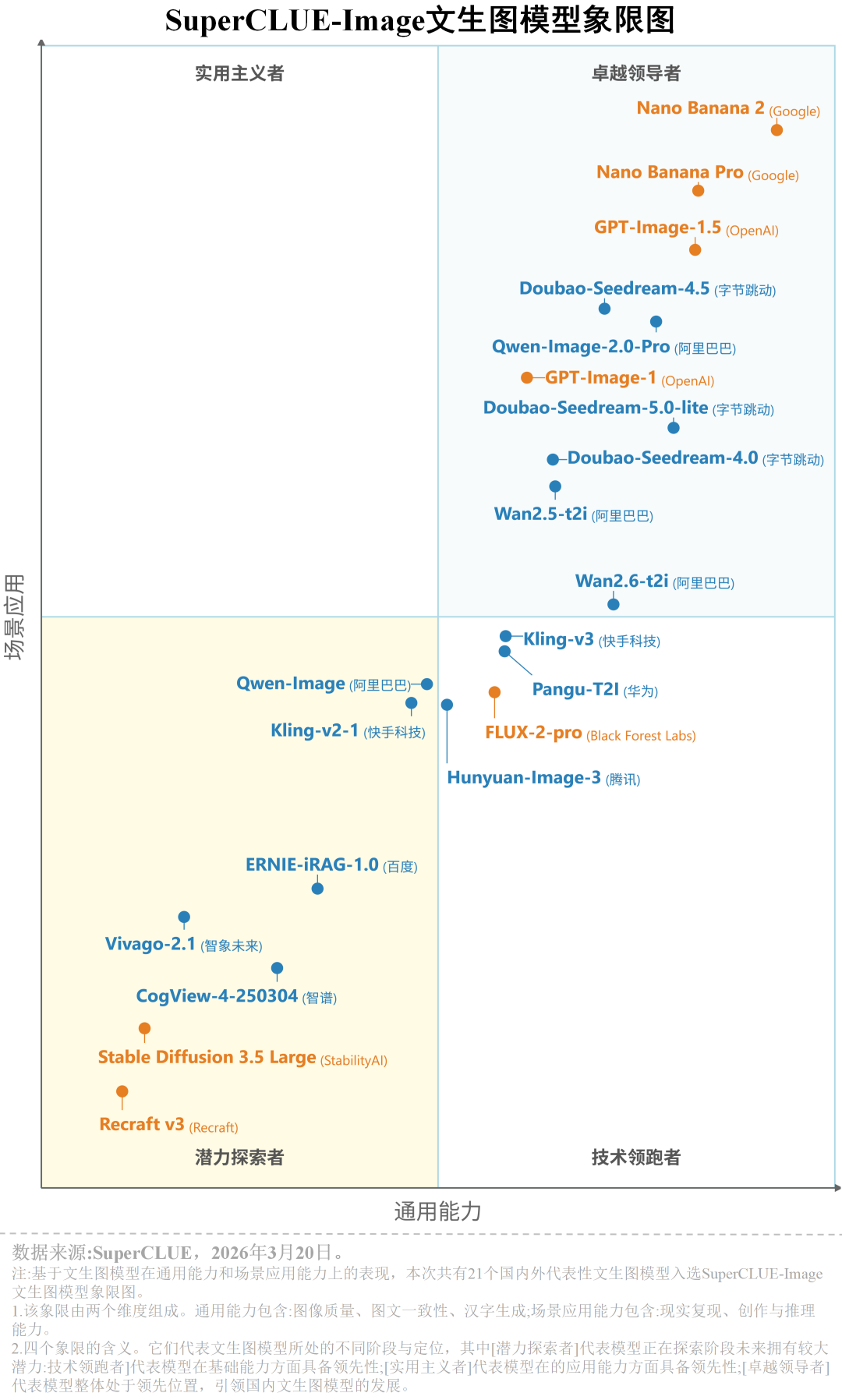

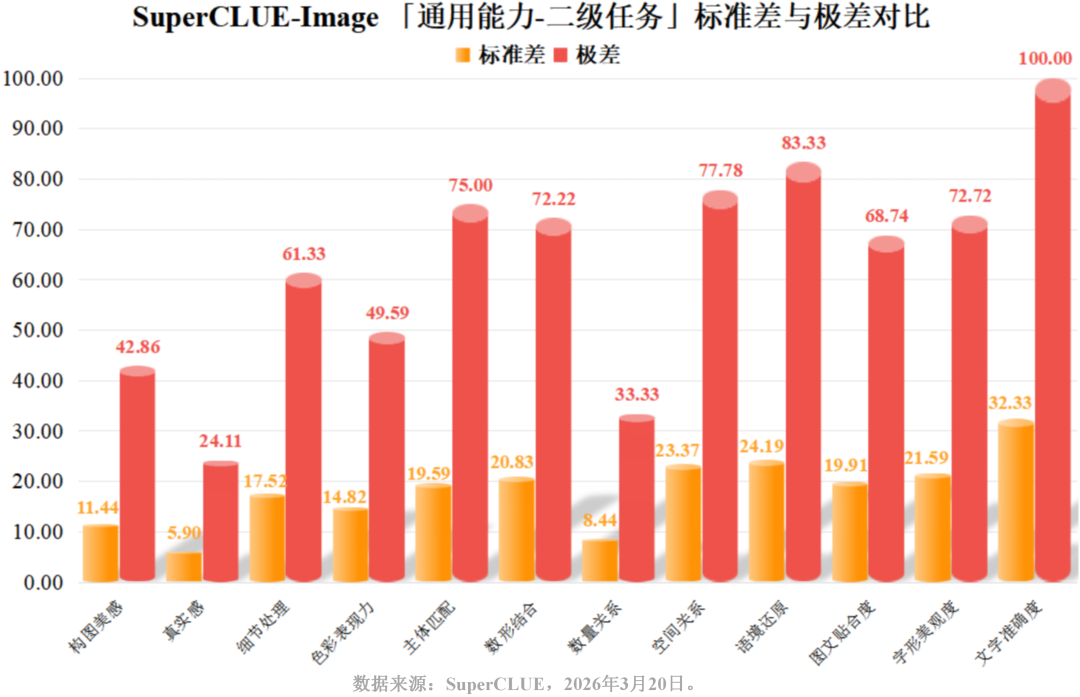

当前模型发展呈现出极其不均衡的偏科现象。行业在浅层的视觉表现力上已经达到了高度成熟的水准,但在深层的多模态语义对齐以及逻辑推理上,不仅整体水平堪忧,且各模型之间的能力形成了明显的断层。

通用能力:图像质量、图文一致性、汉字生成

在“图像质量”方面,行业表现高度一致且成熟,极差仅为 (24.11),标准差低至(5.90);在“汉字生成”中,“文字准确度”的极差飙升至满额的 (100.00),标准差达到 (32.33),这意味着尾部模型在汉字生成上依有乱码问题;“图文一致性”的各项任务中,“语境还原”极差达 (83.33)、“空间关系”极差达 (77.78),说明在复杂指令遵循上,行业出现了严重的实力两极分化。

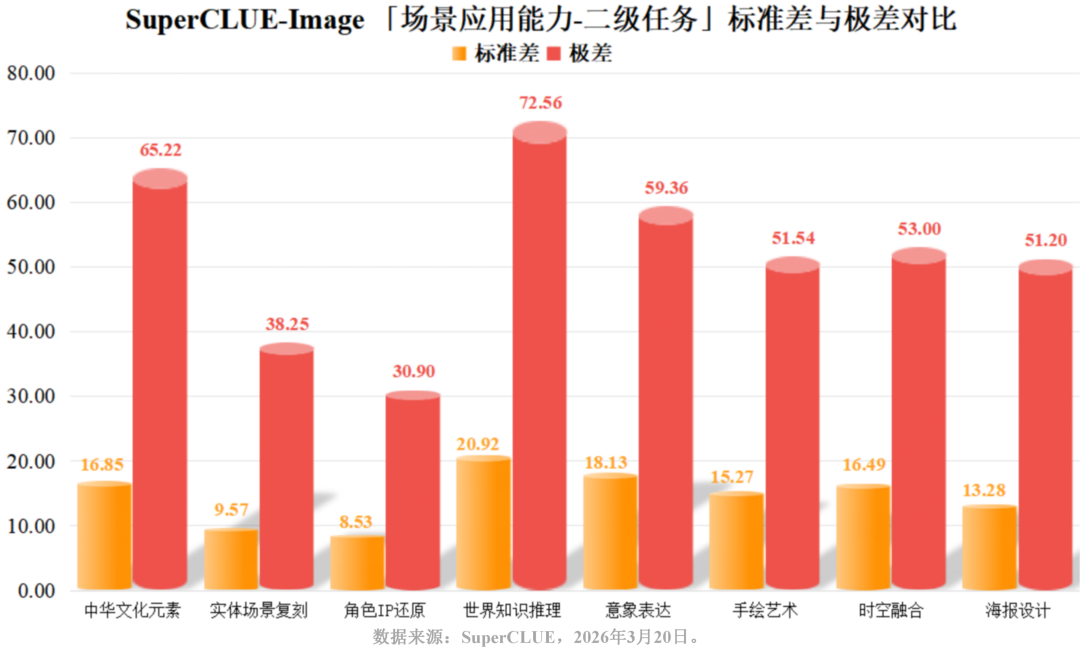

场景应用能力:现实复现、创作与推理

现实复现的“实体场景复刻”和“角色IP还原”极差较小(分别为 (38.25) 和 (30.90)),标准差也不足 (10.00),说明模型已经掌握了较好的模仿与还原能力;但创作与推理的“世界知识推理”和“中华文化元素”极差分别高达 (72.56) 和 (65.22),这表明当面对需要跨模态知识调用和文化底蕴理解的复杂应用场景时,头部模型能力拉开实力差距。