Z Waves|对话陈佳玉:AtomVLA 刷爆基准,真机完成高难度柔性物体操作,具身智能长程任务进入深水区

具身智能的长程任务天花板,正在被捅破。

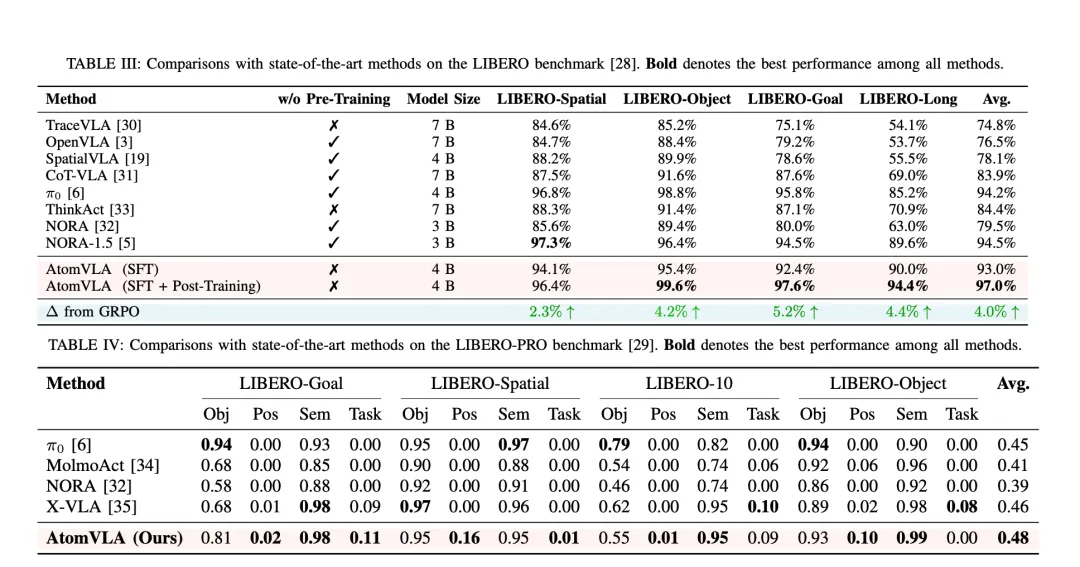

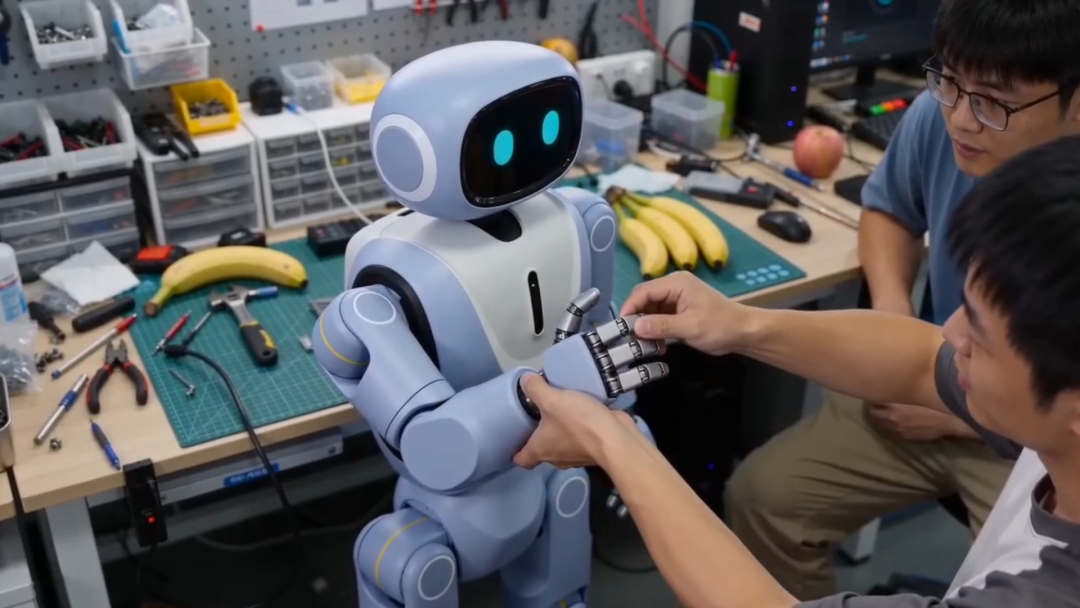

就在近日,大模型圈和机器人圈被一个名为 AtomVLA 的模型刷屏了。这个由原力无限团队发布的最新战果,不仅直接在 LIBERO 权威基准上刷出了 97.0% 的惊人成功率,更是在真机演示中,丝滑地完成了叠 T 恤、折毛巾等“地狱级难度”的柔性物体操作。

围绕‘为机器人打造真正理解世界的大脑’这一核心方向,原力无限当前正以端到端 VLA 多模态大模型与因果世界模型为技术底座,并以全栈 AI Infra 构建数据与模型飞轮,推动机器人在虚拟世界学习、在真实世界进化。

带队人,正是原力无限资深研究科学家——陈佳玉教授。

论文传送门:

更重要的是,AtomVLA开创性地提出了“原子子任务分解 + 预测型世界模型离线评估 + 离线GRPO后训练”的完整范式,实现了不依赖昂贵真机在线交互的高效策略优化。

在全球VLA后训练研究竞争日趋白热化的当下,这一框架提供了一条兼顾性能、效率与可扩展性的全新技术路径,标志着VLA后训练正在从“依赖真机试错”走向“世界模型驱动的离线进化”新范式。

AtomVLA 的惊艳成绩,源于陈佳玉教授对“复杂控制”十余年的深耕。从自动驾驶到核聚变等离子体控制,再到如今的具身智能,这位 ISTJ 科学家始终在追问:如何用数学和逻辑,让机器拥有类人的进化能力?

以下是ZF对于陈佳玉教授的深度访谈实录。

Jane:这期节目我们邀请到了一位非常年轻的科学家——陈佳玉陈老师。陈老师现在是原力无限资深研究科学家,欢迎陈老师!先简单一两句话介绍一下自己吧。

陈佳玉:好的。我是陈佳玉,目前是香港大学数据与系统工程系的助理教授,研究方向是应用强化学习到复杂控制,目前专注于具身智能方向的研究。

Jane:陈老师虽然很年轻,但在机器人、自动驾驶、强化学习相关的研究上已经非常资深了。那接下来进入我们的快问快答环节——你的星座和 MBTI 是什么?

陈佳玉:星座是天秤座,MBTI 好像是一个叫"物流师"的类型,ISTJ 之类的。

Jane:如果不用"助理教授"和"强化学习"这些标签,你一般会怎么向一个不懂 AI 的朋友介绍自己?

陈佳玉:我会说,我做的方向是解决一些比较复杂的控制问题。比如人形机器人控制,还有核聚变中等离子体的控制。总结来说,我是一个专注于复杂控制问题的人,可能用数学方法去解,也可能用人工智能方法去解。

Jane:复杂系统的控制问题。最近一两周你刷得比较多的论文,或者看得最多的相关项目是什么?

陈佳玉:最近看得比较多的是多模态大模型,还有基于应用的世界模型这一块。

Jane:如果不做科研,你现在有可能在做什么?

陈佳玉:如果不做科研,我可能做一个体育新闻记者吧。

Jane:同行!你觉得自己最大的非学术型能力是什么?

陈佳玉:我觉得我最强的是逻辑能力,做梳理的工作会比较好。其实这个能力有点类似 AI——你给我一个问题,我大量阅读相关的东西,然后把它梳理成一个像报告一样的东西。我最强的是逻辑部分,最强的非学术性能力可能就是这种总结和协作能力。但这个好像也偏学术,所以我也不太清楚怎么回答这个问题。

第一部分:个人经历与强化学习的十年流变

Jane:好,那我们直接切到个人经历这块吧。先聊一下你整个研究经历,包括小时候是什么时候对智能机器人这些产生兴趣的,最终又是怎么一步步开始自己的研究的。

陈佳玉:我的研究经历应该具体是从大学二年级开始。那时候选择研究方向,其实也比较讨巧——当时 ImageNet 和 AlphaGo 都刚出来,深度学习的一些成果引起了很大的轰动,所以我就萌生了做人工智能的想法。

但人工智能涉及很多领域,比如计算机视觉、智能决策、自然语言处理。我比较喜欢那些具象化的东西,所以一开始选了自动驾驶这个方向,在北大做自动驾驶相关的研究。刚开始做的是感知层的工作,就是怎么让自动驾驶汽车理解周围的环境——明白它看到的这一块是灌木丛,那一块是行人。

后来我接触到了自动驾驶汽车决策层的东西。决策就是说,依据你的观测,你要做自动驾驶汽车油门的控制或方向的控制,这涉及到一些决策算法。我渐渐发现,结合我在北大和博士期间两段经历来看,我其实更喜欢的是比较抽象的决策算法这一部分。

具体用到的算法是两大类:一类是模仿学习,从示例数据中学习;一类是强化学习,从仿真中学习。到了博士阶段,我就开始研究这种比较抽象的决策算法,不再依赖于具体的应用了。做了很多理论研究和算法设计,这些算法和理论虽然抽象,但应用范围比较广,也奠定了我对这种技术更深层次的理解。因为技术到更深层次的话,其实就是数学——一种依据数学、依据场景以及一些直觉所做出来的东西。这段经历让我对决策算法,特别是对强化学习有了更本质的认识。

等到做博后的时候,我又意识到,纯理论的强化学习研究已经做得七七八八了。从 AlphaGo 之后强化学习热潮就开始了,等我2024年毕业的时候,其实都已经做得差不多了。大家的研究兴趣慢慢转向了强化学习在其他领域的应用。比较耀眼的应用有两个:一个是在大模型上的应用,大模型的后训练依赖于强化学习;另一个是在人形机器人或其他物理过程上应用强化学习。

我想,如果我要继续做强化学习研究,就得给它找一个应用。相比大语言模型,我选择了物理控制这个领域,但我并没有直接去做人形机器人,而是选择了复杂的物理过程——具体讲就是核聚变里的等离子体控制,应用强化学习的方法去做。等到博后结束,开始做自己实验室的时候,我依然沿着这个思路——给强化学习找一个应用场景。考虑到现实条件,我没有办法在香港继续做核聚变研究,所以就把研究转向了人形机器人,或者说具身智能上面的应用。

总体来讲,我的思路就是:从一个比较具象的技术出发——自动驾驶,慢慢找到自己对决策算法的兴趣——强化学习。到后期为了让研究兴趣真正有 impact,我开始想它具体的应用,最终锚定了具身智能。

做具身智能一段时间之后,我发现它实际上是一个非常综合的领域。你想把具身智能做好,基本上就要解决 AI 领域所有的大问题:你要让感知做得好,就得做计算机视觉;你想让它既能听懂语言,又能看懂图片,还能感受到力,这就涉及多模态融合;你想让机器人比较通用,就得喂给它很多数据并用大模型,这涉及大模型的问题;你想让机器人很敏捷,又涉及机械工程的问题。所以具身智能这个领域包含了人工智能基本上所有大的挑战,我就越来越觉得它有意思,也想把它做一个长期攻坚的方向。

最后一点,它不仅是多项技术的集合,更代表着一个未来——给人工智能装一个身体。它不仅在思维上更像人,在行为上也更像人。以具身智能为载体,你会研究很多与类人智能相关的问题。从长远来看,这是一个非常有前景的方向。

陈佳玉:对。

Jane:你大概是16年入学,那一年 AlphaGo 基本上点燃了整个第一波中国自动驾驶公司和地平线等公司,就是那个时候诞生的。你经历了整个强化学习不断融入先自动驾驶、后来又融入机器人的过程。你觉得强化学习这么多年,过程中那些关键的问题,所谓的"真问题",究竟在发生什么变化?

陈佳玉:这是一个好问题。我这么来回答吧——强化学习的研究大概分为几派。

第一派是理论派。大家研究你需要多少采样才能学到最终的 policy,在数学上进行推演。其实相关的研究在上个世纪就开始了,只不过那时大家依赖比较强的假设以及不太切实际的 policy,研究的更多是有限的状态和动作空间。这一波理论研究的话,大家就越来越把它推向无限的状态动作空间下采样效率的问题。但整体上会发现,数学结果越漂亮的那些算法,离实际就越远。

第二派是以DeepMind 为代表的算力派。他们在推算力对强化学习算法的影响,代表成果就是 AlphaGo、AlphaZero——把强化学习里的值学习和蒙特卡洛树搜索(MCTS)结合在一起,用来解决非常复杂的决策问题,用算力来堆。这肯定是非常有用的,他们已经造出了那种超越人类智能的系统——AlphaGo、AlphaFold、AlphaChip 等等,用算力结合强化学习堆出了很多实际上很有用的东西。但问题是他们的研究不太适合学术界,因为学术界没那么多算力。

第三派是以学术界和伯克利为代表的深度强化学习派。没那么理论,对算力要求也没那么大,但做出了很多有代表性的深度强化学习算法。比如 Soft Actor-Critic(SAC),这是在线强化学习的代表性算法。然后慢慢做到了离线强化学习(Offline RL),代表算法有 CQL,也是他们这些组做出来的。再后来,大家又开始基于生成模型来做强化学习算法,代表性工作就是 Decision Transformer 和 Diffusion Policy。总的来说,这一派没那么理论,也不像 DeepMind 那样依赖强算力,但诞生了一系列非常有代表性的深度强化学习算法。

大概在2022到2023年这个区间,大家就发现你再做更多的纯强化学习算法,也比不了 PPO 有用,所以单纯的强化学习算法研究遇到了瓶颈。大家逐渐转向了强化学习的应用。这时候特别是强化学习在大模型的后训练上有了非常好的效果,也就是我们说的 RLHF。第四波就起来了,以大模型公司为代表,做 RLHF 取得了很好的进展。又过了一两年,几乎是同时,大家发现强化学习算法,特别是 PPO,在人形机器人的控制上有非常好的效果,具体案例就像宇树科技的那些跳舞或打太极的展示,大部分都是基于 RL 做出来的。所以我认为现在更像是一个强化学习的应用时代。

如果再展望一下,之后强化学习会怎么样?我认为有一个特别关键的点——持续性的强化学习。就是你如何在学习新任务的时候不忘掉旧的任务,在学习新任务时能基于旧任务中学到的知识快速学习。这实际上很重要。另一个点是,你在进行强化学习的时候如何利用 Foundation Model 已有的知识进行高效的强化学习。强化学习是一个很本质的技术——你给它一个奖励信号,然后期待它把完成那个奖励信号的最好策略学出来。它的缺陷在于太本质了、太像人了,以至于我们想真正发挥出它的威力,就得做出那种类人智能来,才能很好地应用强化学习。这需要我们在算法设计上有新的突破。

Jane:你刚说了强化学习接下来值得继续研究的问题,一个是持续性的学习,一个是把知识利用做得更有效率,这有点像大语言模型的记忆问题,殊途同归。

陈佳玉:对。人也是基于奖励信号在学习我们的策略——比如你的奖励信号是考上一个大学,然后我们每天调整自己的行为。强化学习大致也是这样,你给它一个目标,比如走出迷宫,然后它不断探索,直到学到那个行为。

但人和 Agent 的不同点在于,我们人是一个持续学习的过程。完成上大学的目标之后,还有读研究生、读博士或找好工作这一系列的目标。而且我们在学新任务的时候,实际上是依赖过去知识的,我们在探索的时候也不是无目的的探索,是有先验知识来指导的。但这些先验知识和持续学习的过程,在当今主流的 RL 算法中都还没有做到。这是之后需要攻克的点。

Jane:回到你个人研究的话,我看你发的论文涉及逆强化学习、Offline RL 等等,都属于深度强化学习里的一些分支,是不是?

陈佳玉:是的,深度强化学习。我也做一些强化学习理论相关的东西,也做过强化学习在大语言模型中的应用,还做过强化学习在人形机器人上的应用。整体思路就是随着强化学习社区的迁移,从理论到算法,再从算法到应用。

Jane:你刚说到你从理论最后还是想做具体的应用,你还记得是哪一刻觉得不想停留在理论阶段了,想把它真正放到机器人身上或一些具体的事情来看到效果?

陈佳玉:要说具体哪一刻,应该很难讲。我做过一些理论工作,每次做理论工作的时候,不仅要推数学,还要把算法写成代码,然后在实验上去跑。就发现你推出来数学结构好的,写成代码运行起来效果不一定好;反而是一些理论直觉上更差的东西,实际表现反而更好。这是一个点。

另一个点是,在做理论的过程中,你为了得到结果要引入一些假设,但那些假设隐隐约约会感觉到与实际非常不相符。所以你可能花了很大精力做数学推导,得到的结果可能没太大实际意义。我觉得这是最大的一个 pain point。

而且还有一个 pain point——PPO 是2017年做出来的,现在大家用得最多的算法,无论在大语言模型还是机器人本体上,还是 PPO。所以我们应该比较清晰地意识到这个问题:你再做出新的算法来,可能也不太会有人用。

Jane:你其实是想看到更多真正落到实际上有意义和有价值的东西,这在你做的事情上是非常重要的一个衡量维度。

陈佳玉:对,因为你花很多时间在做研究,总希望自己的研究能真的用在社会中的某一个角落里。把技术应用到一个具体的领域里边,这是非常重要的。我觉得对于做科研、做技术来讲,这是非常重要的一个成就。

Jane:然后讲一下你在 CMU 机器人研究所的经历吧,它其实就是完全跟机器人相关的?

陈佳玉:是跟控制相关的。具体来说,我们跟美国的通用原子公司进行合作,他们有核聚变设施。核聚变是要在一个装置里,以水为燃料,产生一个比太阳里还要热、压强还要高的运行环境。在那个环境里,会有一团温度和压强都极高的等离子体。你要控制那个等离子体,不让它接触装置壁,因为一旦接触到壁,就相当于失败了。所以这是一个难度非常大的控制问题。

由于它是非常极端的条件——高温高压——物理过程不完全清楚。一方面物理过程不清楚,另一方面控制问题又很难。所以我们的解决方法就是用他们提供的大量数据,去学一个控制策略出来。

主要的技术栈就是强化学习。这也是强化学习吸引我的点——几乎所有的决策问题,不管是离散的还是连续的,不管是过程控制问题还是机器人控制问题,只要它能被建模成一个马尔可夫过程,就可以用强化学习去求解一个好的策略。

Jane:我理解它是一个物理系统,强化学习是一套软件系统,中间是通过软件操控硬件,把这个用在上面。如果用通俗的方式来讲,怎么能让读者更具象地感受到这件事?

陈佳玉:强化学习要学到的是一个策略,具体来讲就是一个神经网络。这个神经网络的输入是当前的观测,输出是控制量。在核聚变装置里,输入是等离子体的速度、角度、压强等,输出是怎么用那些中子束去控制等离子体。如果放到人形机器人上面,仍然是一个神经网络,输入可能是机器人看到的东西和接受的指令,输出是机器人的关节角度。

也就是说,强化学习学的就是一个神经网络,但这个神经网络根据应用场景,可以改变它的输入和输出。

Jane:它其实是一个元技术。核聚变是一个具体范畴的东西,但不管什么领域,都可能涉及到决策。

陈佳玉:对,强化学习的应用场景就是持续决策和控制。

Jane:具体到场景的话,自动驾驶你早期研究过,还有机器人。这两类系统在决策和控制方面,有哪些共性的难题,又有哪些不一样的地方?

陈佳玉:共性难题是它们都是一个 Sensory-Motor System。都有传感器去获取观测——比如汽车有视觉摄像头、RGB-D 摄像头,有的还有激光雷达去感知周围的公路、草丛、行人;输出可能就是当前的速度和转向。机器人本质上也是这样,只不过需要控制的维度更多——不是简单控制速度和转向,而是要控制每一个关节。

区别在于,我认为可以把自动驾驶当成是机器人问题中的一个子集。城市场景下的自动驾驶是一个结构化或半结构化场景中的问题——马路的形状是可以事先获取的,交通规则是固定的,车道线也是固定的。但机器人的范围很广,比如家居场景的机器人要处理的是非结构化的环境——每个人家都不一样,没有统一化的规则。所以我更倾向于把自动驾驶看作是机器人问题中的一个子问题,相对于通用机器人来讲,是一个稍微简单一些的问题。

Jane:确实,从机器人场景适应的复杂性上来说,确实要比自动驾驶完全不是一个量级。

陈佳玉:对,因为机器人范围很广。工厂里有机械臂,深海探测有深海探测机器人,靶向用药有纳米机器人。机器人范畴很广,自动驾驶可能就是机器人中的一个问题,它们并不是并列关系。

Jane:现在你觉得在研究也好、产业也好,发展通用机器人的技术路径上还有哪些非共识的地方?

陈佳玉:我认为在发展通用机器人的路径上,看似收敛,但方向对不对大家还不知道。

看似收敛是因为大家好像都在用 VLA 在做。这可以理解,有两个原因:第一,VLA 这个路径本质上是对大语言模型路径的一个复制——用大数据、大算力、大模型得到一个通用的 Foundation Model。大家看到了大语言模型的成功,所以想走 VLA 这条路。第二,国外有一些领先的公司,比如 Physical Intelligence,确实做出了很好的 VLA 模型,导致特别是国内公司基本上都在做 VLA,把精力放在采大量数据、堆算力、训 VLA 模型、做 demo。

但实际上,正确的路是什么,大家现在还不知道。因为现在 VLA 还走不出 demo——任何一个公司发布了一个 VLA 之后,如果让大家随便去试,很容易发现它泛化性的问题。

VLA 成立的假设是你有无限多的数据,就能学到一个像大语言模型那样无所不能的东西。但这不太成立,因为大语言模型之所以成功,是因为它处理的语言是单一模态。而 VLA 是一个多模态的问题,所需的数据要远远高于大语言模型,但我们拥有的视觉、触觉数据以及包含 action 的数据非常少,采集成本非常高。也就是说,VLA 相比大语言模型需要更多的数据,但采集成本更高。所以这个模式听起来不太 work——你照搬了大语言模型的路,但照搬得不太对。

那如果不走这条路,我们怎么走向通用智能体?就像我刚才讲的,它是一个非常复合的技术,大家对这方面的技术路线还没有形成共识。从我自己来讲,我认为要真走到那一步,就得真的去做类人智能的研究——持续性的强化学习以及很好地融合先验知识的强化学习过程,是很必要的。

第二部分:职业选择与产学研合作

Aaron:陈老师,我们现在聊一下职业选择上的变化吧。你在港大之外,其实也加入了原力无限。我们比较好奇的是,从助理教授到正教授基本上已经是大多数人觉得非常好的路径了,特别是在港大这个平台上。您为什么没有走一条完全纯学术的道路,而是选择加入一家创业公司呢?

陈佳玉:因为我们要做的东西——通用的具身智能,实际上是一个需要很多很多资源的事情。比如你需要大量的研发资金来购买机器人和招学生,同时也需要很多算力来训那些基础模型。最重要的是你得有做实验的场地。但作为一个 Junior Faculty 来讲,在经费、算力和场地上都是非常窘迫的状态。这是一个共有的问题,特别是场地问题——在港大,我们没有实验的 space,基本上做不了任何真机的 Robot 实验,这是一个现实的困境。

其实在接触到原力无限之前,我就已经给香港政府写了一个 proposal 要做通用型家务机器人,但心里也有 concern,就是经费、算力和场地的问题。和原力无限合作的话,他们可以提供算力、场地以及研究经费。相当于双方在资源禀赋与研究能力上形成了互补,这使很多原本难以推进的真机研究得以加速展开。我觉得更像是一种产学研结合,不是说对港大这个平台不满意,而是我们确实需要更多资源来推进我们想做的研究。

Aaron:明白。这种算力和资源的稀缺,应该是现在学术界一个非常普遍的状况。不管是大语言模型的研发还是具身智能的研发,其实是由产业界来主导的,因为他们既有算力也有钱也有人。学术界可能反而稍微滞后了一些,所以就会采用这种产学合作的模式。

陈佳玉:对,是这样。

陈佳玉:我觉得在于双方合作中互相表现出的诚意。我认为最重要的一点是愿景一致——我在接触他们之前就写了做家务机器人、通用机器人的 proposal,而他们想做的正好是具身大脑,以及商业、制造、文旅、家庭等多场景落地,这与我长期关注的通用机器人和家务场景研究方向能够形成很好衔接。第二是他们的商业化做得很好,有充足的资金来支持研究,能给我们实验室提供比较稳定的支持。第三是大家互相表现出诚意——公司给了我很大的信任,让我去主导一个联合实验室,投入了很多资源,让我去探索我想探索的方向。愿景一致,又给了很多的支持和信任,Why not?

Aaron:我比较好奇,从 PhD 阶段在导师实验室里,到博后阶段,到现在作为独立 faculty 建立自己的实验室并主动选择和产业界合作,这里面最大的变化是什么?

陈佳玉:做 PhD 期间主要就是埋头研究,锻炼独立研究的能力,这是最大的 focus。到博后阶段,就多了一些写 proposal 和指导学生的经历,在为做 faculty 做准备。到真正开始做独立 faculty,我发现最重要的是能够有自己的研究哲学——清楚自己可能很长的一段研究生涯要解决一个什么大问题。然后围绕这些大问题去搭建自己的团队:最根本的是拿到足够的研究经费,基于经费去布置实验室的硬件,招相关方向的人。简单来讲就是拿钱,还有构建自己的实验室,和做 PhD 以及做 PostDoc 还是蛮不一样的。

Aaron:您刚也提过有自己的研究哲学,跟原力无限之间有非常匹配的 mission。能展开讲一下吗?包括你提到要做家务场景机器人,这是你们未来发展的方向?

陈佳玉:对的。最大的 match 是,我们都希望去解决通用机器人的核心问题。对公司而言,是围绕具身大脑做多场景落地;对我个人而言,家庭/家务场景是其中一个最具挑战也最有长期价值的方向。技术路线上,他们给了我比较大的信任,支持我做我本来就想做的技术路线。具体来说就是研究基于 VLA 的一个持续学习过程,以及融合世界模型、VLA 和一些多模态知识库的类人智能。这是在探索一个和当前大家做的都不太一样的、但更接近类人智能的方向。我们想做的东西一致,研究方向上他们也给了很大的支持和信任。

Aaron:那陈老师,在你眼里,目前具身智能领域最被高估的一类问题是什么?哪些问题可能被误以为是核心问题,但实际上对行业本质发展的贡献是有限的?

陈佳玉:我认为现在大家对具身智能最高估的一点,就是把Scaling Law 从大语言模型搬到 VLA 上。因为 Scaling Law 在大语言模型上得到了验证——更多的数据、更大的模型、更多的 test-time computation,效果就更好。现在大家想把那一套搬到 VLA 里,觉得采更多数据效果就会更好。

但我认为这个东西非常贵——采数据贵,算力也贵,关键是它还没那么 promising。你看现在 GPT-4o 和 GPT-5 的研发周期非常长,但效果不明显。这说明即使在大语言模型这种有海量数据、单一模态的建模问题上,Scaling 都不会是最终解决方案。应用到 VLA 上大概率也不是,因为 VLA 是非常多模态的、数据非常稀少的、采集成本非常高的。

我认为大家应该想一想——人工智能怎么在数据有限的情况下进行学习?这才是一个性价比更高的方向。现在大家都做 Data-Driven Research,一个方向是拼命搞更多的数据,但大家普遍比较忽视的是怎么在数据有限的情况下更高效地学习,也就是在学习机制上的研究。我认为这是一个 misleading 的点。

陈佳玉:而且具身智能和大语言模型不一样的另一个点是——大语言模型即便犯再离谱的错误,它也只是生成文本,用不用还是由人来决定。而具身智能如果在部署过程中出现大的错误,比如在工厂里或家里,实际上是很危险的。也就是说,它必须有可保证的泛化性、鲁棒性和安全性。但目前这条路线要 copy 大语言模型,是没办法给出这种保证的。

Aaron:明白。那你觉得长期被低估的硬核问题又是哪些?

陈佳玉:我认为被低估的问题是——做更类人的智能。大家要去想人是怎么学习的,然后把它搬到机器上。这是一个非常被低估的方向,也是一个特有意思的方向。你去观察那些婴儿,他们接触到很少很少的数据就能表现得非常 robust 和 general。人类比机器好的点就是——它的 robustness 和 generalization 都非常好,而且只依赖非常少的数据。

所以我认为一个真正投入不足的点,就是怎么更类人地去学习。大家现在也在做类人——做人形机器人,但做的内容是像人的形态一样。大家没有去考虑类人的学习机制。这是一个被低估的方向。类人不能只是形态上的类人,我们必须要有学习机制上的类人。

Aaron:你怎么理解现在具身智能的发展阶段?如果用 GPT 来类比,现在算是 GPT-3、GPT-4 还是能到 GPT-5 这个阶段了?

陈佳玉:我觉得还远远没到 ChatGPT 那个程度,我觉得大概是 GPT-1、GPT-2 差不多。因为 ChatGPT 刚出来的时候就已经比较 capable 了,我当时还试了一下,让它证明数学分析里的一些定理,它出来之后一度引起 OpenAI 服务器宕机——说明它是真的有用了,而且能经得住大家的测试。但现在的具身智能都走不出 demo,甚至 demo 都是精心剪辑才能做出来,更不要说能经得住大家的测试了。

Aaron:那你觉得具身智能的 ChatGPT 时刻还有多久?

陈佳玉:我不知道,但我之前看了杨立昆的一个 talk,他的愿景就是更类人,和我很一致。他给主持人的答复是五到二十年。我认为要想真正做出可以用的具身智能,在算法方面还需要另一层突破——得更类人,达到像人那样的数据效率、泛化性和鲁棒性。这需要算法上的突破,我不知道需要多少年,但杨立昆说是五到二十年,所以 let's see。

Aaron:你刚也提到很多机器人走不出 demo 场景。很多机器人在视频里可能看起来非常科幻,叠衣服或者跳舞,但真正在一个陌生场景里就基本不太能 function 了。你怎么理解这种巨大的落差?到底是算法的问题,还是工程的问题?

陈佳玉:是算法上的问题。当前算法依赖大量的数据,但跨场景的数据需求是指数级增长的。当前算法最大的弊病就是得有非常海量的数据才会有泛化性,数据不足就自然不会有泛化性。所以肯定是算法上的问题。

Aaron:你想做的是家庭场景机器人,为什么选择这个方向?你觉得现在很多机器人场景中,什么场景在短期内比较 promising?

陈佳玉:其实分三类场景——工业、商业和家庭。短期内我认为最好做的是商业场景。我们分析一下:工业场景要引入机器人,得有非常高的效率,有一个效率门槛;家庭场景有一个 safety 的问题——机器人不能出问题,撞坏家具是小事,撞坏人就是大事了。商业场景反而是对效率要求不高、对安全性要求也不高的,所以实际上最有可能率先落地。

从公司实践来看,原力无限已经在商业、制造、文旅等场景形成多类机器人产品和解决方案落地,短期更容易跑通的是结构更清晰、容错更高的商业化场景。

但我们之所以做家庭场景,是从长期来看。我们在选场景的时候得想,最希望机器人部署在哪?如果让机器人部署在流水线上或工厂里替代蓝领工作,实际上是一件非常残酷的事情。我们更希望机器人出现在危险的场景下,或者出现在家庭场景下——假如人们都不需要做家务了,那就是一个非常大的 relief。做家庭机器人是从我们自身的愿景出发,并不是单纯认为它短期内好落地。

Aaron:所以工业场景在你的理解中,是处于商业场景和家庭场景中间?最难的是家庭场景,因为安全性最高?

陈佳玉:也不能这么说。工业场景对效率要求比较高,这是它的难点;家庭场景对安全性要求比较高,这是另一个难点。但它们怎么比,不好比。

第三部分:具身大脑、世界模型与产业格局

Aaron:在你看来,机器人要真正变得足够能干,或者跟人一样能干,最重要需要的能力项是什么?是需要更好的感知、更强的世界理解,还是真正的决策能力?

陈佳玉:我觉得它得更好地理解这个世界,理解这个世界的一些基础因果。现在的学习方法更像是——你给它一个视频,你拿着杯子,突然撒手,杯子掉了。它很容易就学习到:你拿一个杯子,如果撒手就会掉。但如果它学到因果,它就会明白这个杯子掉是因为有重力,如果没有一个向上的力,它就会掉。如果它学到因果,就可以很好地泛化——你把杯子换成一个壶,它也明白如果撒手也会掉。

也就是说,机器人如果真的理解了这个世界,就往类人方向进了一大步。基于这个理解,再连接它的小脑部分——更敏捷、更精确的控制,这个实际上是相对好做的。我认为比较难做的是大脑这部分,就是真的有那种类人的、对世界的理解。

Aaron:具有这种世界理解能力的世界模型,大概发展到什么阶段了?

陈佳玉:世界模型比较特殊,它和 VLA 不一样——世界模型的技术路线还没有收敛。

比较有代表性的一派是**杨立昆(Yann LeCun)**之前在 Meta 做的 JEPA(Joint Embedding Predictive Architecture),他认为训练过程中不能有生成的部分——学术上讲就是只能用 encoder,不能用 decoder。由于不能用 decoder,它就不能是一个监督学习,而是一个自监督学习。这是一派。

另一派像李飞飞做视觉这一派,或者 OpenAI 做的 Sora 那种视频生成模型,他们是用海量的视频数据进行监督学习来训世界模型。

两派各自有自己的成果,但只能说技术路线还没有收敛。而且比较成功的世界模型 demo,基本上就是用世界模型去生成视频,或者用世界模型生成一个模拟器。它的逻辑和大语言模型没有什么区别——给它输入、给它输出,做监督学习。监督学习本质上就是一个 regression 问题,那它仍然会和大语言模型面临一样的问题:对数据依赖很强,方法没有保证。

我认为现在世界模型还得再问深一点——有没有一种学习机制,让世界模型真的明白这个世界的一些物理定律或者因果?大家对这方面的研究还不深,我认为这也是技术目前还没有收敛的原因。

Aaron:所以世界模型现在也跟大语言模型一样,还在大力出奇迹的阶段,算法也没有特别有效率的出现。

陈佳玉:对。我认为具身智能的下一步,绝对需要不同于 VLA 或世界模型的技术出现。而且研究重点应该在大脑这一块。

Aaron:说回到决策上面,现在很多多模态大模型已经能看懂很多东西了,但你觉得"看懂"和"会决定"之间大概是什么样的差距?

陈佳玉:看懂和会决定,实际上就差一个策略——你得依据你看懂的东西,得出当前应该执行的一个动作。这个策略可以通过模仿学习去学,也可以通过强化学习去学。问题在于:如果用模仿学习,你就得提供专家示例,那就是一个数据驱动的方法,依赖很多数据;如果用强化学习,就还是我刚才说的问题——当前的强化学习算法每学一个新任务都要从头学,不是一个持续学习的过程。它不能应用以前学到的知识,什么都得从头学,导致采样效率非常低。

所以从能读懂这个世界到能做出好的决策之间,我们其实还需要一个好的持续强化学习的算法。

Jane:现在机器学习的能力还是没有办法做到快速迁移、适应不同环境,对吧?

陈佳玉:还不能。迁移就是泛化。泛化的话,大语言模型已经做得很好了,因为它数据量够大,而且是单一模态的任务。但具身智能的泛化性还是很差,因为图片包含的信息比文字要多得多。这意味着你要实现很好的泛化性,就要提供比文本数据多得多的视频数据。但视觉数据又恰恰比文本数据更难获取。所以泛化很难,以现在的算法途径来看,迁移或适应也很难。

Jane:好,前面世界模型跟 VLA 是密不可分的,而且我觉得这两个在定义层面都是极其非共识的地方。你怎么理解所谓的世界模型?有人甚至觉得它就是一个理论名词。以及它和 VLA 之间的关系到底是什么?

陈佳玉:VLA 是依据当前观测得到当前的动作;世界模型是依据当前的观测和当前的动作,得到下一个时刻状态的预测。

我这么解释吧:你观察到面前有一个杯子,然后你把它举起来——这是一个从观测到动作的过程,可以用 VLA 来实现。然后你想知道,把杯子举起来之后它会是什么状态?得到这个预测是通过世界模型来实现的。

也就是说,它们是两个函数,功能不一样。

Jane:现在各家公司都在做这块,但背后各自的算法技术其实完全不一样吧?

陈佳玉:我认为恰恰相反。大家的算法其实是很相似的,不一样的是数据和工程上的一些 tricks,但算法上相似度极高。

Jane:你之前提到你们做的类人智能研究,它是哪个 part 的事情?

陈佳玉:实际上就是怎么去训 VLA。大家现在训 VLA 就是给它输入数据、输出数据,做一个拟合——得到大量数据,像训练大语言模型一样训练一个 VLA。我们不一样的点是,我们想用一种持续学习的机制来训 VLA。他们用监督学习方法来训,我们想用持续学习方法来训,这是区别点。

我们做的另一个不同点是,怎么去用世界模型。我们是把世界模型作为机器人知识库的一部分,来辅助 VLA 的训练。

总结一下:第一,我们 VLA 的训练方式不一样——大家普遍用监督学习,我们在探索一种持续学习的方式。第二,怎么用世界模型来训 VLA,我们和大家做的也不太一样。现在大家用世界模型训 VLA 基本上两个路径:一个是用世界模型去生成数据,然后用生成数据去训 VLA;另一个是把世界模型当做一个模拟器,在模拟器里训 VLA。我们则是要建立一个知识库,知识库里包含实体之间的联系以及层次抽象,我们把世界模型作为层次抽象的一部分,用来训 VLA。

Jane:你自己的研究方向坚定会认为这条路是有效的?

陈佳玉:对,因为更类人。我们人不就是一个持续学习的过程嘛——你今天学数学物理,明天学 Robotics,学 Robotics 的时候就是在应用你学的数学和物理。人就是一个持续学习的过程,那你想做出一个类人的机器人来,为什么不用一个持续学习的过程呢?

Jane:你们已经在这条路上看到一些泛化能力的变化了吗?

陈佳玉:对,我们在同时进行好几项关于持续学习的研究,后面会陆陆续续出来。因为我们这个合作其实也刚刚开始。

Jane:还有一个数据的问题。大家坚持不同的数据路线,可能导致规模化不成立的点是什么?每条路线的问题是什么?你们的选择又是什么?

陈佳玉:数据方面,大家现在确实存在分歧。

以Physical Intelligence 为代表的一派认为真实数据为王——必须给模型足够多的真实数据,才可能训出来比较好的 VLA。

以英伟达为代表的一派认为仿真数据为王——因为采集真实数据成本太高,得依赖高度可信的仿真来并行化、低成本地产生大量数据。

还有一类,像李飞飞为代表的,认为数据应该是世界模型生成的——生成的环境更可控,给一个 text prompt 就能立刻生成一个环境,然后在里面生成数据。

大家这方面还没有形成共识。目前来看最有效的是用真实数据,以及真实数据和仿真数据联合训练。

我们目前不太做 data-centric research,我们会观察哪种数据的成功率更好,follow 他们的研究用一样的数据。因为我们的研究重点不在于用什么数据,而是采用什么样的学习机制,可以更有效地应用这些数据。

Jane:关于真实数据,之前有人提出一个质疑——如果真实数据是真机采集的,一旦机器迭代,那些数据可能就完全没用了,数据规模化非常难实现。

陈佳玉:对,所以你在采数据的时候,数据的形式要比较 general 一些,不能和采集设备绑得太死。比如你的输入是图片,输出是归一化之后的关节位置,这种通用格式的数据是可以迁移、甚至迁移到不同本体上的。

但我认为大家还得想清楚一个问题:能不能在采数据之前,对需要采集的数据量进行一个估算?如果估算出来采多少数据都不会达到最终目的,那你还要不要采这个数据?这是一个 question mark。

Jane:而且不同机型的数据采集出来,也不是行业可以共用的,因为现在机型差别太大——身高大小、有没有臂、轮子还是脚。

陈佳玉:对,你可以做一些 retargeting——比如两个人形机器人大小不一样,但参数你都有,比如臂长、身高,你可以用 retargeting 把小机器人的数据 retarget 到大机器人身上,这是可以做到的。但如果跨得再厉害一些,比如人形机器人和机器狗之间,就不太好共用了。不过如果是同一类型的机器人只是大小不一样,是可以做到一定程度的共用的。

Jane:目前你们最缺的是哪种类型的数据?

陈佳玉:最缺的是那些真的需要人去采集、不能通过仿真来生成的数据。比如叠衣服、系鞋带、拧螺丝这种——必须得用人来采,很难通过仿真或者生成的方式获得。

Jane:我突然意识到,遥操作作为一个商业模式产品,在这个时候其实非常成立。

陈佳玉:对,因为就是为了采数据。逻辑是这样的:大语言模型验证了 Scaling Law 成立——从模型到 Scaling,从 Scaling 到数据,从数据再到遥操作,它这个需求链条就是这样的。

Jane:然后原力无限是"一脑多身多场景",为什么选择这个范式?

陈佳玉:因为要做通用机器人,最难的部分就是做大脑——对世界的理解。如果你想做的是一个大脑,你就没有必要限制它的应用场景。只不过在具体的商业计划中会一个一个场景地攻克——比如先做家居场景,再做商业场景,再做工业场景。但如果大脑做得很成熟了,就没有必要限制应用场景,它的应用范围会是非常广的。这也是原力无限当前‘聚焦具身大脑、赋能多形态本体、驱动场景规模化’的核心逻辑。

Jane:现在大家锚定某个场景的核心原因,是因为确实大脑也只能用在那个场景中。

陈佳玉:是的。你做出来的模型只能用于一个场景,但你用来训那个模型的方法是可以跨场景应用的。另外,如果你针对每一个场景都训练了模型,把它们分别部署到所属的场景,它们就会日夜产生数据,你就拥有了大量跨场景的数据。那你能不能运用这些跨场景的数据去得到一个跨场景的模型呢?这是第二阶段的问题了。

Jane:现在大家都还在第一阶段。

陈佳玉:对,先做出单场景好用的模型,部署下去产生数据,然后再把一个多场景的模型做出来。这是第一阶段和第二阶段的关系。

Jane:这个底层变化会不会有一个类似 Transformer 级别的技术架构,能突然让这件事变成一个可以统一的事情?

陈佳玉:架构和学习方法还是两种东西。架构的话,就是你用 Diffusion 还是 Transformer,这是架构选择上的问题。我倒觉得这个不是那么本质。本质的还是说,你怎么去学——你是用监督学习、还是强化学习、还是一种持续性的学习?我认为学习机制是一个比架构更本质的问题。

Jane:那你觉得整个产业格局大概会走向什么样的形态?

陈佳玉:我觉得最终可能会走向大公司做大脑,小公司做场景化的小脑。为什么?因为做大脑需要大量的算力和数据投入,这不是小公司能承受的。小公司做什么呢?针对具体场景去落地——做场景化的小脑,用大公司的基础大脑去适配特定场景。有点类似大语言模型的格局:OpenAI 做基础模型,然后大量的应用公司在上面做各种应用。

Jane:所以你觉得具身智能最终也会形成这种分层的格局?

陈佳玉:我觉得是有可能的。但也有可能不一样——因为具身智能涉及到硬件,它不像大语言模型纯粹是软件。硬件上的差异化可能导致小公司也有机会,因为你在特定的硬件本体上积累了足够多的数据和经验,这本身就是壁垒。

Jane:好。然后聊一下海外,你了解到的海外一些做具身智能的同行,他们现在在做什么?

陈佳玉:海外比较有意思的公司,除了 Physical Intelligence 之外,还有一些比较小但很有追求的公司。比如有一些公司是从前 OpenAI 的人出来创立的,他们的追求不是做一个产品,而是追求算法上的突破——希望做出真正的类人智能。这种公司在海外还是有一些的。

Jane:比如?

陈佳玉:比如SSI(Safe Superintelligence Inc.),虽然他们主要是做大语言模型方向,但他们的追求就是纯粹做算法突破。在具身智能领域也有一些类似的公司,虽然规模不大,但追求的是真正的算法创新而不是快速商业化。

Jane:你怎么看中美在具身智能方面的差异?

陈佳玉:中美差异还是比较明显的。美国的优势在于算力和学术驱动——他们有最强的算力资源,也有最好的高校和研究机构在推动基础研究。中国的优势在于本体和数据成本——中国有非常好的机器人本体制造能力,比如宇树科技在本体上做得非常好,硬件成本也比较低。另外,中国的数据采集成本也比较低,因为人力成本相对较低。

所以如果你要做大脑这种需要大算力的研究,美国可能更有优势。但如果你要做硬件或者做场景化落地,中国的供应链和成本优势是很明显的。

Jane:波士顿动力现在的定位你怎么看?

陈佳玉:波士顿动力是一家非常有特点的公司。它的控制做得非常好,但在 AI 这一块,至少从公开信息来看,还没有特别多的成果。它更像是一家以机械控制见长的公司,而不是以 AI 见长的公司。

Jane:我们来聊一下人形机器人。你觉得人形是通用机器人的最佳载体吗?

陈佳玉:人形这个事情有两面。一面是它确实有一些独特的优势——人类的生活环境都是为人体设计的,门的高度、椅子的高度、楼梯的尺寸,所以一个人形的机器人可以更自然地适应人类的生活环境。这是一个很好的愿景。

但另一面是,现在的人形机器人和人的差距实在太大了。你看那些人形机器人,它的灵巧手跟人的差距非常大,它的运动能力跟人的差距也很大。所以通用本体是一个好愿景,但现在和人差太远。

我的看法是,你不一定非要用人形——取决于你的场景。如果你在家庭场景里,人形可能确实有优势。但如果在工厂里,一个机械臂可能比人形机器人效率高得多。所以本体的选择应该是跟场景匹配的,而不是一刀切地认为人形就是最好的。

Jane:你之前有提到一个观点——大家不应该只在形态上追求类人,学习机制上的类人可能更重要。

陈佳玉:对,这是我一直强调的。你的外表像人不代表你的智能像人。真正要像人的地方,是你的学习过程——能持续学习、能迁移、能从很少的数据中学到东西。这才是类人智能的核心。形态上的类人当然有它的价值,但如果你的学习机制不类人,那你就只是一个外观像人的传统机器人。

Aaron:最后一个比较大的问题——你觉得未来人和机器人的关系会走向什么样的状态?

陈佳玉:我觉得未来机器人会更可见地融入我们的日常生活。现在你在日常生活中很少能看到机器人——除了扫地机器人。但未来可能你去商场、去酒店、去停车场,都会看到各种各样的机器人在工作。再远一点的话,家庭里可能也会有机器人。

我不觉得机器人会取代人,更像是人和机器人的一种共生。机器人做那些人不愿意做的、危险的、重复性的工作,人做更有创造性的、需要情感和社交的工作。这是一个比较理想的状态。

但这个过程是渐进的。不会突然有一天你家里就出现一个人形机器人在做饭。它是一步一步来的——先是简单场景,再到复杂场景,先是辅助角色,再到更独立的角色。

收尾:给年轻人的建议

Jane:最后我们来做一个收尾。如果现在有年轻人想进入具身智能领域,不管是做学术研究还是做产业,你会给什么样的建议?

陈佳玉:首先我觉得要聚焦真问题。不要跟风做别人做的东西,要去想什么是这个领域真正的瓶颈,然后聚焦在那个瓶颈上。比如现在大家都在做 VLA,你再去跟着做 VLA 可能已经晚了,但如果你能看到 VLA 之后的问题——比如怎么做持续学习、怎么做更好的泛化——这才是有价值的方向。

第二是要大胆探索。这个领域还非常早期,很多方向都还没有被充分探索。不要被现有的框架限制住,要敢于去试不同的东西。

Jane:那你觉得具体哪些细分方向比较值得年轻研究者去投入?

陈佳玉:我推荐三个方向。第一个是Manipulation——灵巧操作,就是怎么让机器人的手像人一样灵活。这是一个非常难但也非常重要的问题,现在做得好的人还不多。

第二个是多模态大模型——怎么把视觉、语言、触觉等多种信息融合在一起,让机器人有更全面的感知和理解。

第三个是我一直在说的——Robo Brain,就是机器人的大脑。怎么做出一个真正理解世界的、能持续学习的大脑。这个方向可能需要更长的时间才能看到成果,但它的价值也是最大的。

Aaron:非常感谢陈老师今天的分享,信息量非常大。

陈佳玉:谢谢,很开心。

Jane:谢谢陈老师!

稿件经采用可获邀进入Z Finance内部社群,优秀者将成为签约作者,00后更有机会成为Z Finance的早期共创成员。