获2亿美元A轮融资,Eridu破解万卡集群的“互连瓶颈”|AlphaFounders

AI算力基础设施有一个隐藏的瓶颈,网络传输。就在上周的GTC,黄仁勋发布了Vera Rubin平台,在这个算力平台里,NVLink 6交换机,ConnectX 9网卡,Spectrum-6以太网交换机都与网络传输相关。还有Vera Rubin平台内的Rubin GPU+Groq 3 LPU,它们的协同,也需要网络传输。

但是就是行业标杆的英伟达,它的NVL72机架也只能有72个GPU,这不是因为它不想把机架做的更大(单个机架的GPU更多,对训练和推理都更好),而是因为现在的网络传输能力只能支撑这个规模,要下一代的NVLink,才能让这个规模翻倍到144个GPU。

而一家叫做Eridu的公司,试图颠覆这种数量的限制,它的技术能将单个机架的GPU数量扩展到数千张,将整个AI算力中心的GPU数量扩展到数十万张,还能做到低延迟、低功耗。

它近日获得超额认购的2亿美元A轮融资,领投方包括Socratic Partners、John Doerr、Hudson River Trading、Capricorn Investment Group以及Matter Venture Partners。

参投方包括Bosch Ventures、Eclipse Capital、Fusion Fund、Osage University Partners、SBVA、TDK Ventures、VentureTech Alliance和Zelda Ventures等。Eridu的累计融资达到2.3亿美元,

互联网基石协议的发明人再创业,要从底层革新AI网络传输

Eridu的创始人Drew Perkins(CEO)是作为互联网基石的点对点协议 (PPP)核心发明人,他自1999年以来多次创业,其中光交换机公司Lightera Networks以逾5亿美元的价格被收购;他在创办Infinera期间,研发了全球首款硅光子集成电路,后来这家公司不仅成功上市,最终还被Nokia以23亿美元巨资收购。

Drew Perkins ,图片来源:Eridu

公司联合创始人Omar Hassen曾先后在Broadcom与Marvell担任核心领导职务,此外他曾负责Arm服务器芯片先驱AppliedMicro的产品开发,其Arm服务器CPU业务直接为后来的Ampere Computing奠定了技术基石。

以这两位创始人为核心,Eridu组建了一支在网络ASIC、先进封装、光电技术、系统工程及软件架构等领域拥有深厚的专业积淀的团队,他们曾主导过数十次芯片流片。

无论是现在火热的Agentic AI还是具身智能,都要求模型训练与推理的性能及可扩展性。这导致数万亿美元涌入AI基础设施领域,据彭博社的预估,仅在2026年,单是Alphabet、Amazon、Meta和Microsoft等科技巨头,在AI基础设施领域的支出就将达到约6500亿美元。

但另一方面,投入AI基础设施领域的数万亿美元,其中有很大一部分会被浪费。这是因为算力中心的网络,成为掣肘AI潜能的瓶颈:现代AI算力集群极度依赖于在GPU之间高速、大规模地传输海量数据。

AI处理的几个关键步骤,例如模型层同步、KV Cache轮换以及All-to-All操作,都要求数据在机架内、跨机架甚至跨建筑的所有GPU之间进行同步传输。

在这种数据交换中,最慢的节点会拖垮全局,导致大批GPU陷入闲置。据Omar Hassen介绍,在如今的许多计算环境中,GPU的利用率可能只有50%左右。

低效的网络不仅拖累了设备利用率和计算性能,还急剧推高了能耗,让数兆瓦的电力被徒耗于臃肿的多层级网络架构的数据搬运中。

AI技术的发展则加剧了这种网络瓶颈:当模型规模突破万亿参数、上下文窗口激增至100万Token以上、多模态与MoE模型得到广泛应用,以及预填充 (Prefill) 和解码 (Decode) 等处理步骤被解耦至独立硬件执行时(NVIDIA的新方案正采用这个思路),系统对网络的需求呈现出爆炸式增长。

650 Group的创始人Alan Weckel认为:“以太网交换是AI网络的核心基石。在AI与跨节点用例激增的推动下,该市场在未来十年有望冲击2000亿美元大关。

将端口基数提高10倍,1台新型交换机抵30台旧交换机

网络传输在AI算力中心领域分为两种类型Scale-up(机架内GPU-GPU的传输)和Scale-out(机架/算力中心之间的传输)。

Scale-up集群的规模对于提升AI模型性能至关重要,因为GPU之间的通信,本身就比机架之间的通信更快、延迟更低。Scale-up集群的规模越大,在单个集群内,就能承载更大参数尺寸模型的训练与推理,提高训练和推理的效率。

但目前NVIDIA最先进的NVL72机架也仅能容纳72张GPU,这是因为现有的网络解决方案在单一低延迟层级中所能支持的容量已达极限。

NVIDIA还有576卡的SuperPOD,但它是8个NVL72机架组合的,不再是单层网络,而是双层网络,网络传输会更慢。

Scale-out集群同样受制于网络,例如马斯克打造的Colossus,确实达到了10万卡级别,但是这必须引入更多的网络层级、交换机和光模块,集群的性能、延迟(以及可靠性)均会大打折扣。

造成这种网络瓶颈的原因,本质上是网络技术的发展速度,落后于GPU算力的指数级数量飙升GPU的算力已从2022年的约4 PFLOPS跃升至如今的20+ PFLOPS。

然而,网络技术每24到36个月容量才翻一番。在过去四年中,网络交换机的带宽仅从25.6Tbps提升至51.2Tbps,102.4 Tbps的产品直到最近才开始出现,还没有进入大规模使用。

沿着现有的网络架构路径,算力基础设施的进一步扩大,也只能加剧延迟、推高能耗与散热需求,最终导致全局效率的低下。

AI算力的网络传输,需要根本的改革。

尽管目前Eridu的产品还未面世,但是它们的技术路线图很清晰。

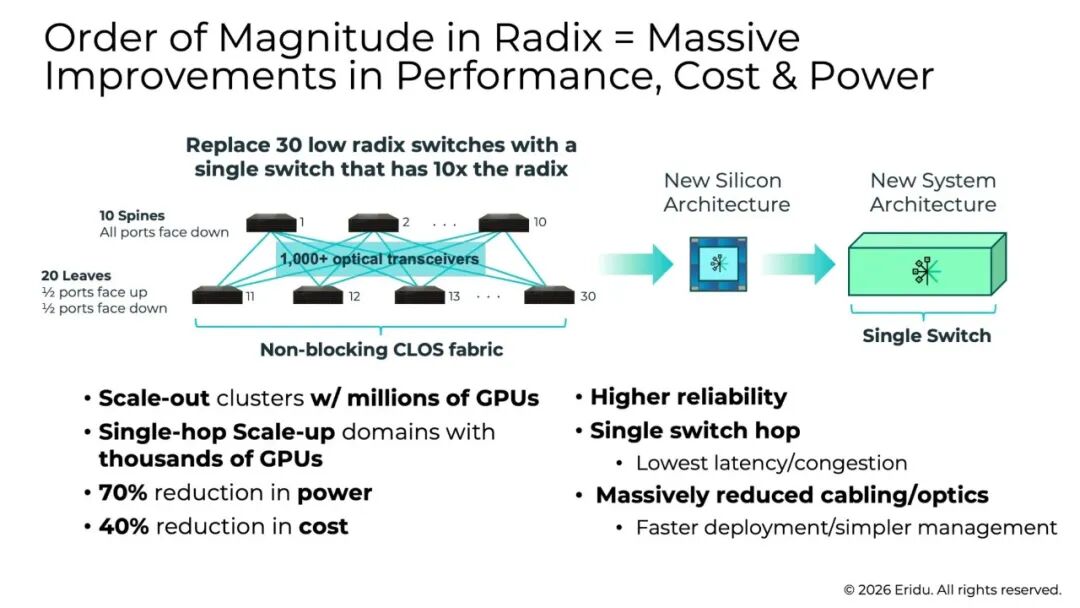

首先,它们要在交换机端口基数、吞吐量和可扩展性上实现数量级的飞跃。

为此,它们会从芯片、系统和软件等层级协同起来,结合多领域最新技术成果,进行白纸式设计 (Clean-sheet design),只有将芯片、光器件、先进封装以及系统架构深度统一的全局设计,才能通过在系统各个层面协同优化设计与落地决策,确保每一个组件都在高效率和高性能下运行。

图片来源:Eridu

Eridu会在Scale-up和Scale-out两个层面都布局。

在Scale-up层面,它将数量级地提升网络的端口基数和吞吐量,这将使单一Scale-up域内容纳数千张GPU成为现实,因为它们可以由单层网络架构直接支撑,这不仅为训练更大参数的AI模型提供稳定的低延迟网络保障,还能让整个AI集群的规模扩大,结构层级更少。

在Scale-out层面,Eridu希望打破对多层Spine交换机的依赖,仅凭两层网络架构,便能支撑超过一百万张现行规格的GPU。

Eridu表示,它们的将交换机的端口基数提高了10倍,这样一台新型交换机可以替代30台现有交换机,这直接使得所需交换机总数量骤降90%,从而将资本支出 (CapEx) 削减40%,网络能耗降低70%。

在经济层面算一笔账,在一个拥有20万张GPU的超大集群中,GPU利用率每提升10%,就意味着能省下超过10亿美元的隐形成本。

Token经济爆发,AI基础设施领域有大的创业机会

OpenClaw(俗称:龙虾)的火爆,让Token经济进入大众视野。一些科技大厂已经把Token消耗量作为“薪酬”的一部分发放给员工,甚至会规定他们的Token消耗量级。

Token经济的底层,是各种AI模型,再往下挖,则是AI基础设施。从经济层面,关键则在于成本。对应的核心指标就是每瓦Token输出率和每1块钱Token输出率。

无论是算力层面,还是网络传输层面,创业公司和大厂们都在试图优化这些指标。例如此前我们介绍过的算力芯片MatX,也包括Eridu。

在网络传输层面,除了Eridu外,NexthopAI、Ayar Labs等创业公司,最近也都获得了大额投资。尤其是NexthopAI,已经推出了新型交换机产品(针对Scale out层面),其指标能够对标及部分超过NVIDIA目前最先进的产品。而Cisco等传统公司,在这个领域的进步速度就相对较慢。

那么在中国市场,像AI数据中心传输这种AI基础设施层面的机会存在么?答案是肯定的,因为中国的Token经济也在如火如荼进行中,“龙虾热”规模似乎比硅谷更大。在硅谷,“龙虾”在极客和程序员圈子里流行,中国却是全民性的。而且就在这几日,火山引擎的云端大模型日均调用量破百万亿Tokens,证明了AI在中国市场的真实需求。

阿尔法公社已经完成对AgentEarth、共绩科技和万格智元等AI/Agent基础设施领域初创公司的早期投资,我们看到有更多的优秀企业围绕着AI产业革命这个叙事不断涌现。

本文由阿尔法公社原创。

✦

✦