大模型养虾中文排行榜来了!SuperCLUE-OpenClaw

一、OpenClaw介绍

OpenClaw(前身为 ClawdBot/Moltbot)是一个开源的AI Agent框架,由Peter Steinberger创建,它是目前GitHub上最受欢迎的AI Agent项目之一,拥有超过325000stars。用户称其为"龙虾",因为它像一个24小时常驻电脑里的数字助理,能够接收指令、调用工具、读写文件、执行脚本,甚至编写临时工具和召唤子代理分工协作。

二、SuperCLUE-OpenClaw介绍

PinchBench作为面向AI Agent能力评估的开源基准,以其高质量的任务设计和标准化的评估流程,在英文环境下为Agent研究提供了重要参考。然而,其任务场景与评估逻辑深度依赖于海外互联网生态与应用习惯,导致其在面向中文真实场景时存在适配性不足的问题——不仅体现在自然语言层面的语种差异,更关键的是任务逻辑、工具使用方式及交互范式难以覆盖中文用户的实际需求。

为了解决这一问题,我们在PinchBench基础上进行了系统性、深度的本土化重构,推出SuperCLUE-OpenClaw,旨在构建一个真正贴合中文生态的AI Agent评估基准。具体而言,我们在以下方面进行了深入改造与优化:

1. 任务的中文本土化重构

我们对PinchBench全部任务进行了场景级的中文泛化处理,我们不仅将输入输出转化为中文,更从任务目标、操作路径、依赖工具到上下文背景进行了全面重构,使其符合中国用户在日常生活与工作中使用数字服务的真实习惯。

2. 任务的独立验证与质量保障

为确保重构后任务的可执行性与评估准确性,我们对所有任务进行了多轮人工与自动化结合的校验与修正。具体包括:

(1)任务逻辑验证:确保任务目标清晰、步骤合理,能够在中文环境下被Agent完整执行;

(2)自动化评测脚本优化:对原有评测脚本进行适配性重写,确保其在中文任务场景下的运行稳定性和结果可比性;

(3)评估标准对齐:结合中文语境对模型输出的评价标准进行细粒度调整,避免因语言风格或表达差异带来的评估偏差,提升评估结果的可信度与区分度。

3. 评测执行说明

本次评测采用Gemini-3.1-Pro-Preview作为裁判模型,对每个参评模型进行单次评估。后续我们将持续扩展评测范围,进一步提升评测结果的稳定性和代表性。

后续计划

1. 多轮评测与榜单动态更新

我们将对已纳入评测的模型进行多次重复评估,以降低单次评测波动性带来的影响,并同步更新SuperCLUE-OpenClaw榜单,提供更具参考性的性能对比;

2. 持续扩展模型覆盖

后续我们将陆续引入更多国内外主流模型,持续丰富评测维度和对比视角。

SuperCLUE-OpenClaw致力于成为中文Agent能力评估的重要基础设施,欢迎学界与产业界同仁的关注、使用与贡献。

# SuperCLUE-OpenClaw榜单概览

SuperCLUE-OpenClaw榜单地址:https://superclueai.com/openclaw

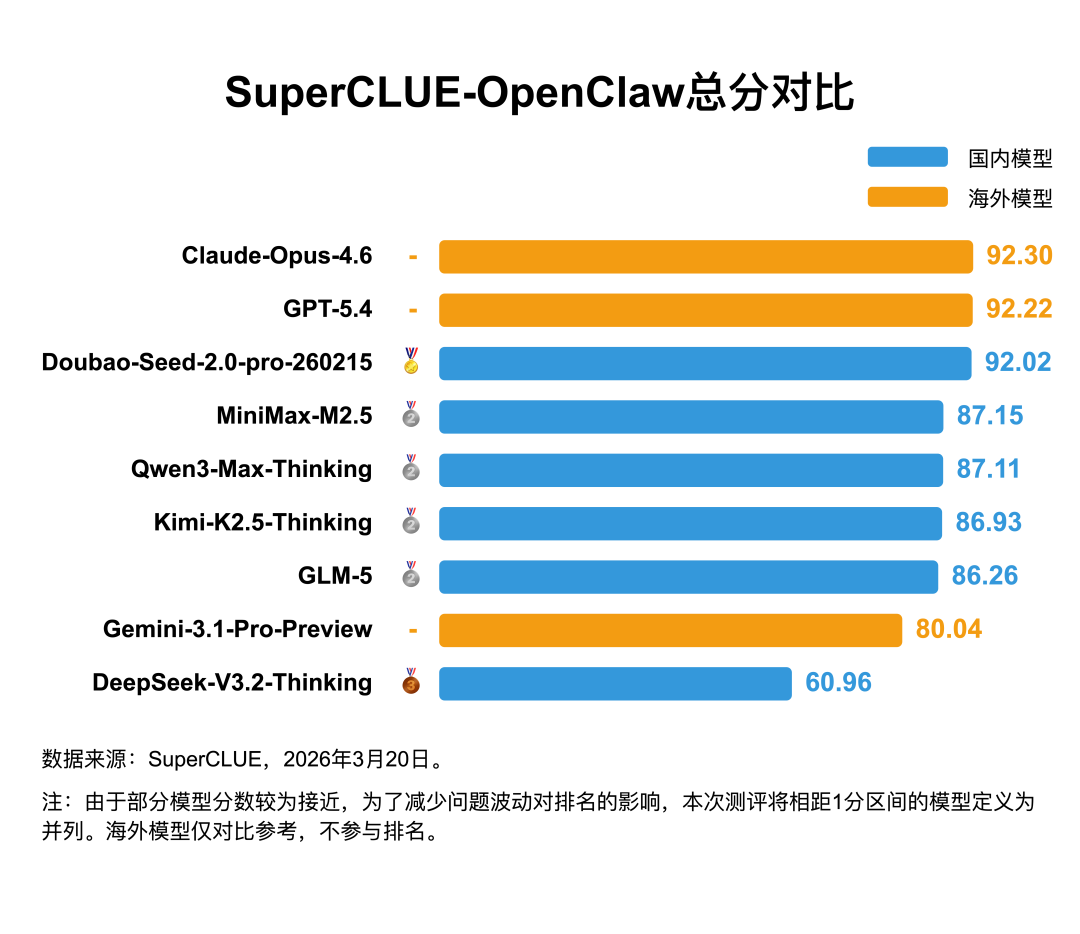

1. 总分对比

2. 各维度对比

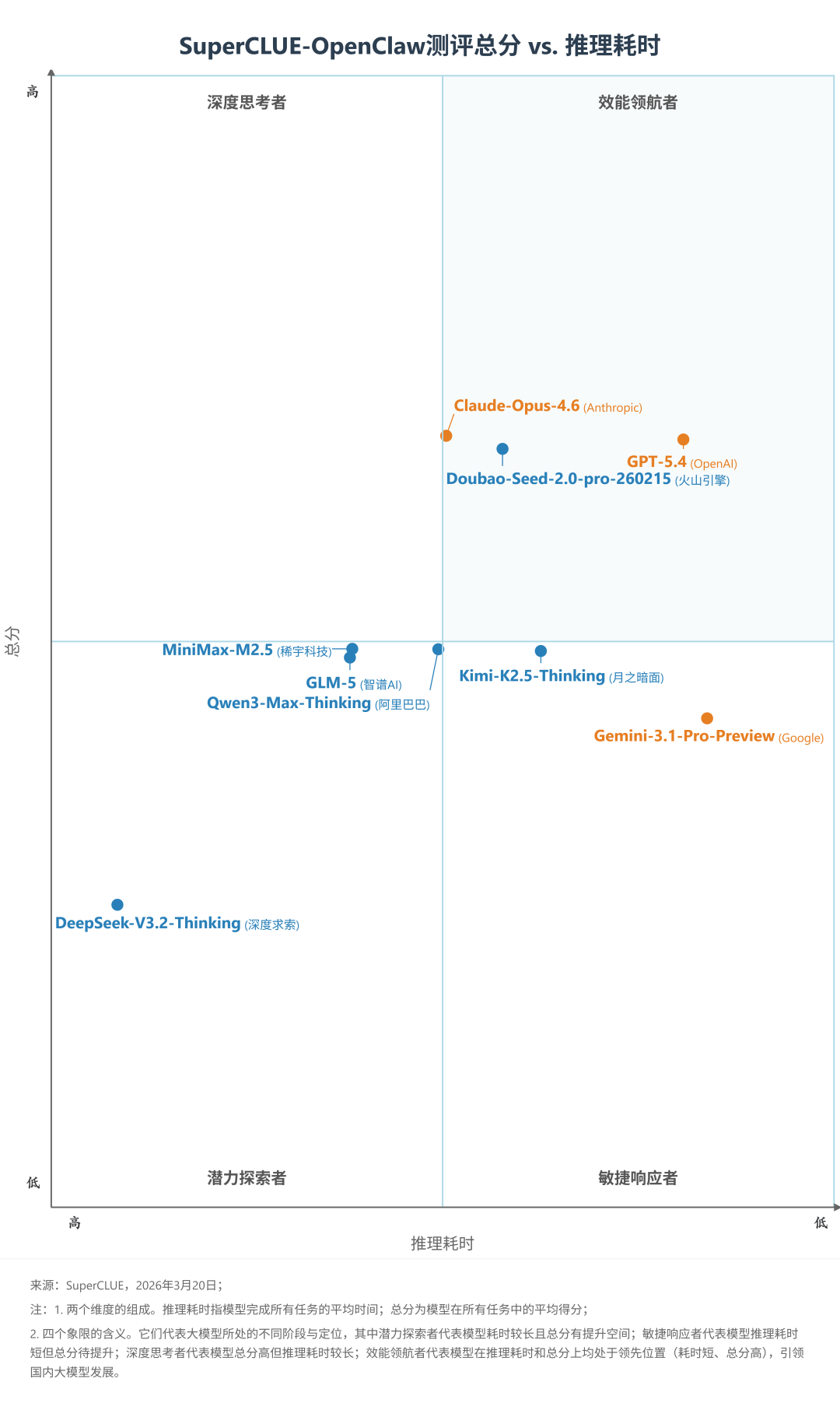

3. 推理效能(总分 vs. 耗时)

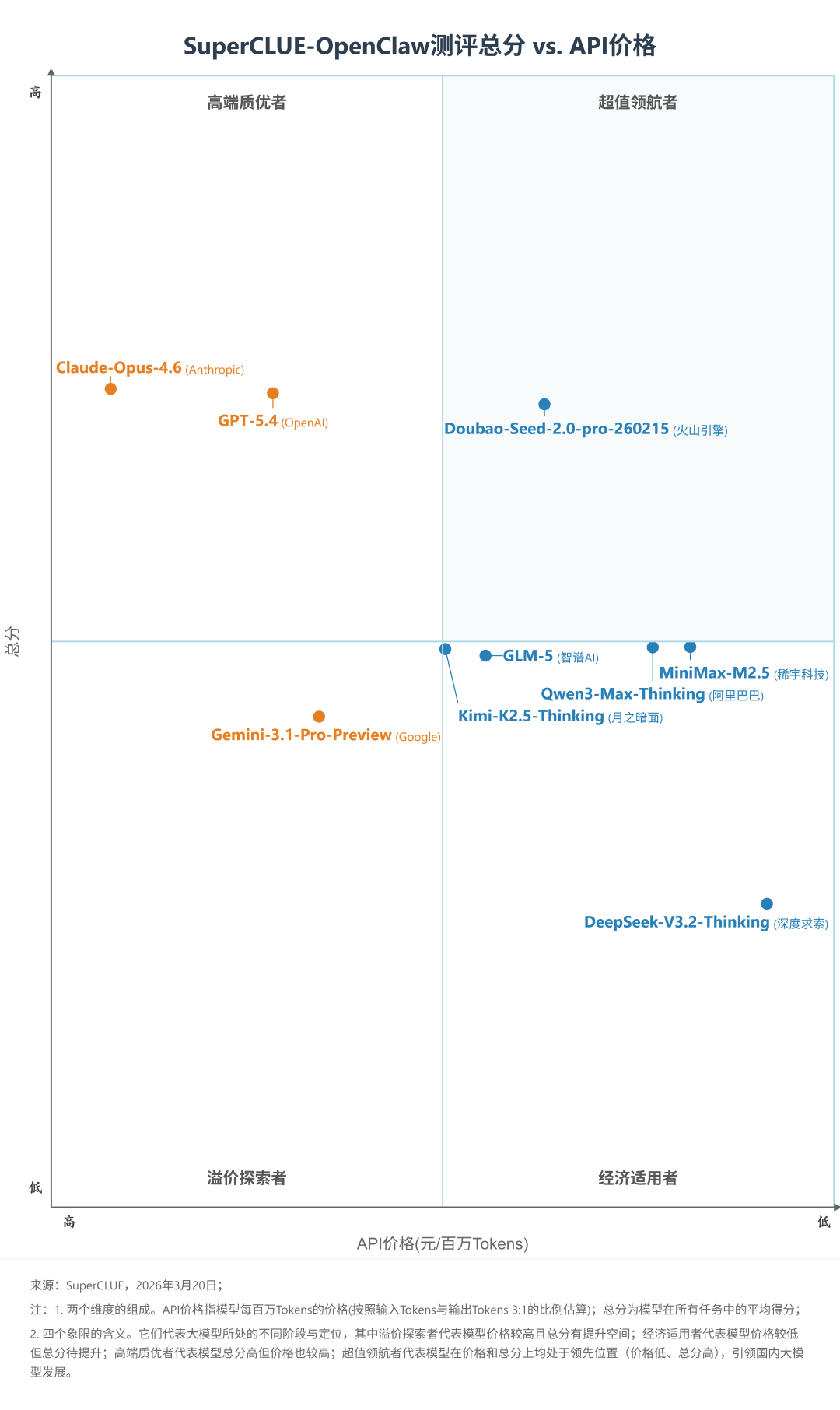

4. 性价比(总分 vs. 价格)

SuperCLUE-OpenClaw测评摘要

本次测评榜单前三名分别为Claude-Opus-4.6(92.30)、GPT-5.4(92.22)和Doubao-Seed-2.0-pro-260215(92.02)。其中,Doubao-Seed-2.0-pro作为唯一跻身该梯队的国产模型,在数据处理(96.09)和研究分析(93.67)维度表现尤为突出,数据处理得分甚至超越Claude-Opus-4.6(95.77),充分证明了国产头部模型在真实任务上的执行能力已具备对标国际顶尖水平的实力。

摘要2:国内模型竞争激烈,性价比突出。

国内四款模型——MiniMax-M2.5、Qwen3-Max-Thinking、Kimi-K2.5和GLM-5——表现十分接近,得分均在86至87分之间,分差控制在一分以内,整体领先于海外模型Gemini-3.1-Pro-Preview,表现可圈可点。相较于海外模型,这些国产模型在价格上普遍更具优势,且在中文场景下的性能表现也相当不错,对国内“养虾人”而言具有较高的性价比,是理想的选择,尤其适合作为高频业务流量的“经济型主力”。

摘要3:海外模型能效比更佳,国产模型豆包2.0成功突围。

在右上角的“效能领航者”象限(高得分、低耗时)中,仅有GPT-5.4、Claude-Opus-4.6和Doubao-Seed-2.0-pro-260215三款模型入围,展现了极高的能效比和真实的业务落地潜力。相比之下,国内模型如GLM-5、Qwen3-Max-Thinking、MiniMax-M2.5尽管在性能上已超越Gemini-3.1-Pro-Preview,但由于推理耗时较高,在能效优化方面仍有提升潜力。

# 基准介绍

一、任务划分

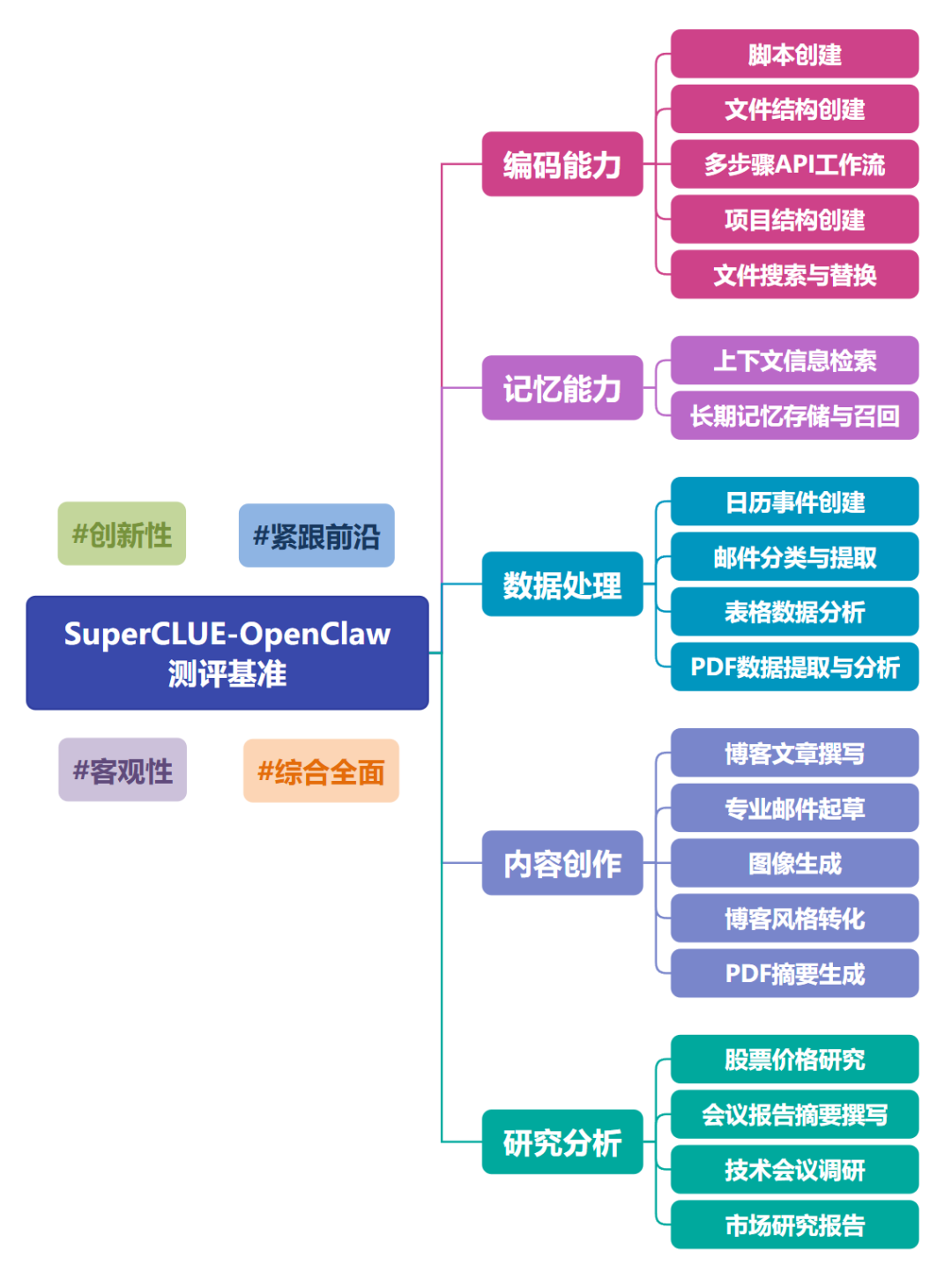

本次 SuperCLUE-OpenClaw 测评包括5大任务类型,共有23个子任务,以下是详细的任务说明:

类型一:编码能力

主要考察智能体在真实软件开发场景中的代码编写、脚本执行、项目搭建及工程文件的批量管理能力。

类型二:记忆能力

主要考察大模型在单轮上下文或跨越多个会话时,对事实信息的留存、检索与一致性保持能力。

类型三:数据处理

主要考察智能体对结构化数据文件(CSV, Excel, 规范化文档)的解析、计算、格式化输出以及逻辑分类能力。

类型四:内容创作

主要考察智能体根据特定场景、受众、语气生成高质量文本或多媒体内容的能力。

类型五:研究分析

主要考察智能体主动获取外部知识、从海量或分散文本中提炼关键洞察、并输出专业研报的能力。

二、评分方法

参考原项目的测评方法,本次 SuperCLUE-OpenClaw 测评我们仍然使用三重评分架构,即:自动化脚本评估+大模型评估+二者混合评分。以下是详细介绍:

1. 自动化脚本评估

这是一种针对客观题的评分方式。当任务的结果可以被明确、无歧义地验证时,就会采用这种机制,我们为这类任务预置了专门的Python评分脚本。当模型完成任务后,脚本会自动检查任务产出的结果。

分数设定:0或1分制。

1分:脚本验证通过,所有检查点都完全正确,任务被判定为成功。

0分:脚本验证失败,任何一个检查点未通过(如文件未生成、日期错误、格式不对),任务被判定为失败。

2. 大模型评估

这是一种针对主观题的评分方式。当任务的评价标准涉及内容质量、逻辑深度、创造性等难以用代码量化的方面时,就会引入一个大模型来打分。我们选择一个本身能力非常强大的大语言模型(Gemini-3.1-Pro-Preview)作为评审员。这个裁判模型会拿到:

原始任务指令:例如,“写一篇关于可再生能源未来发展的博客文章,要求论点清晰,论据充分”。

模型生成的结果:也就是待评测模型写出来的那篇博客文章。

详细的评分规则:例如,“论点是否清晰(1-5分)”、“论据是否充分且相关(1-5分)”、“文章结构是否逻辑通顺(1-5分)”、“是否有独特的见解(1-5分)”等。

分数设定:1到5分制。

裁判模型会严格按照评分规则,对模型的输出结果在多个维度上进行打分。最终,这个任务的得分是多个维度分数的平均,这种机制能更细腻地捕捉到模型在复杂任务上的表现差异。

3. 混合评估

这是一种针对复杂综合题的评分方式。在真实的智能体应用中,很多任务既包含客观执行的步骤,也包含主观创造的部分。混合评分就是为了应对这种情况。

工作机制:它会分两步走,结合前两种机制。

第一步:自动化检查客观部分。例如,一个任务是“搜索过去一周关于AI芯片的5条重要新闻,并整理成一份简报”。脚本会首先自动检查:模型是否确实输出了5条新闻?新闻是否确实来自过去一周?如果连数量和时间范围都不对,客观部分就无法通过。

第二步:LLM评审主观部分。如果第一步通过了,再让“AI裁判”来评价:这5条新闻是否真的“重要”?简报的摘要是否提炼得准确、清晰?简报的整体排版和可读性如何?

分数设定:0或1分(客观检查) + 1到5分(主观评审)。

这种机制下的最终得分往往是一个组合或者有特定的权重。但关键在于,它不是一个简单的单一分数。它首先要求模型必须正确地执行命令(产出5条新闻),然后才评价它执行得好不好(新闻质量和摘要水平)。如果客观检查(第一步)失败了,整个任务可能直接判为0分,不再进行后续的主观评审。这体现了在真实工作中,“做对”是“做好”的前提。

总结来说,通过这三种分数设定,构建了一个从“非对即错”的硬性指标,到“好坏优劣”的软性指标,再到“先做对再做好”的综合指标的全方位评价体系。这样得出的最终成功率、速度和成本,才能更真实地反映一个模型在实际工作中“干活”的能力。

# 参评模型

本次 SuperCLUE-OpenClaw 测评基准共测评了9个模型,包括6个国内模型,3个海外模型,以下是具体的测评模型列表:

# 测评总榜

# 测评分析及结论

一、总体结论

1. 头部竞争格局:海外模型领跑:Claude-Opus-4.6(92.30)与GPT-5.4(92.22)占据前两位,分差仅0.08,呈现胶着态势。豆包紧追第一梯队:Doubao-Seed-2.0-pro以92.02分位列国内第一,与GPT-5.4仅差0.2分,已具备冲击顶尖水平的能力。

2. 国内竞争胶着:MiniMax-M2.5、Qwen3-Max-Thinking、Kimi-K2.5-Thinking、GLM-5四款模型分数密集分布在86.26-87.15区间,差距不足1分,形成明显的"并列第二"阵营,与头部存在约5分差距。

3. 显著性能断层:DeepSeek-V3.2-Thinking以60.96分大幅落后,与上述阵营存在超过25分的断层,在执行实际任务时表现明显不足。

二、各维度对比

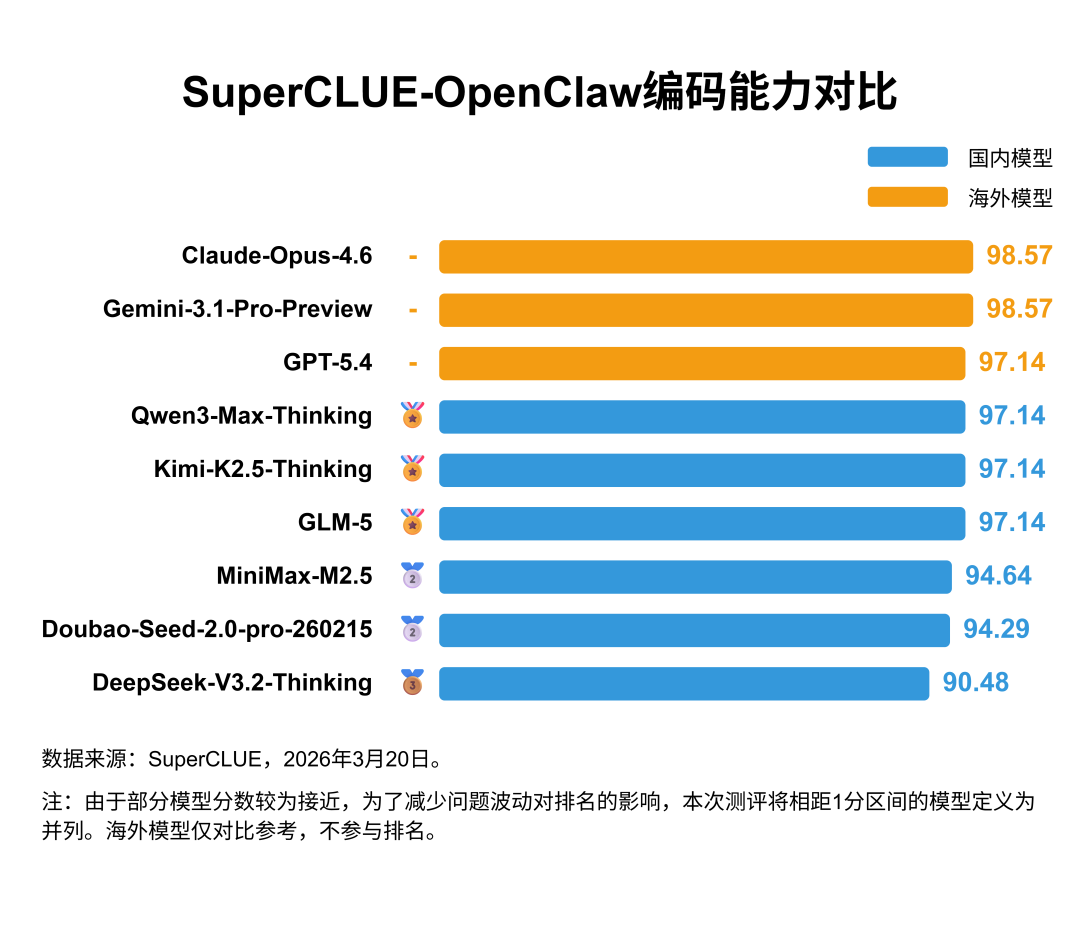

1. 编码能力

海外顶尖略占上风,国内头部紧追不舍。海外三巨头(Claude-Opus-4.6、Gemini-3.1-Pro-Preview、GPT-5.4)占据绝对高分区间(97.14-98.57)。国内第一梯队(Qwen3-Max-Thinking、Kimi-K2.5-Thinking、GLM-5)以 97.14分 并列国内榜首,与GPT-5.4持平,显示国内顶尖模型已触及国际一流水平。

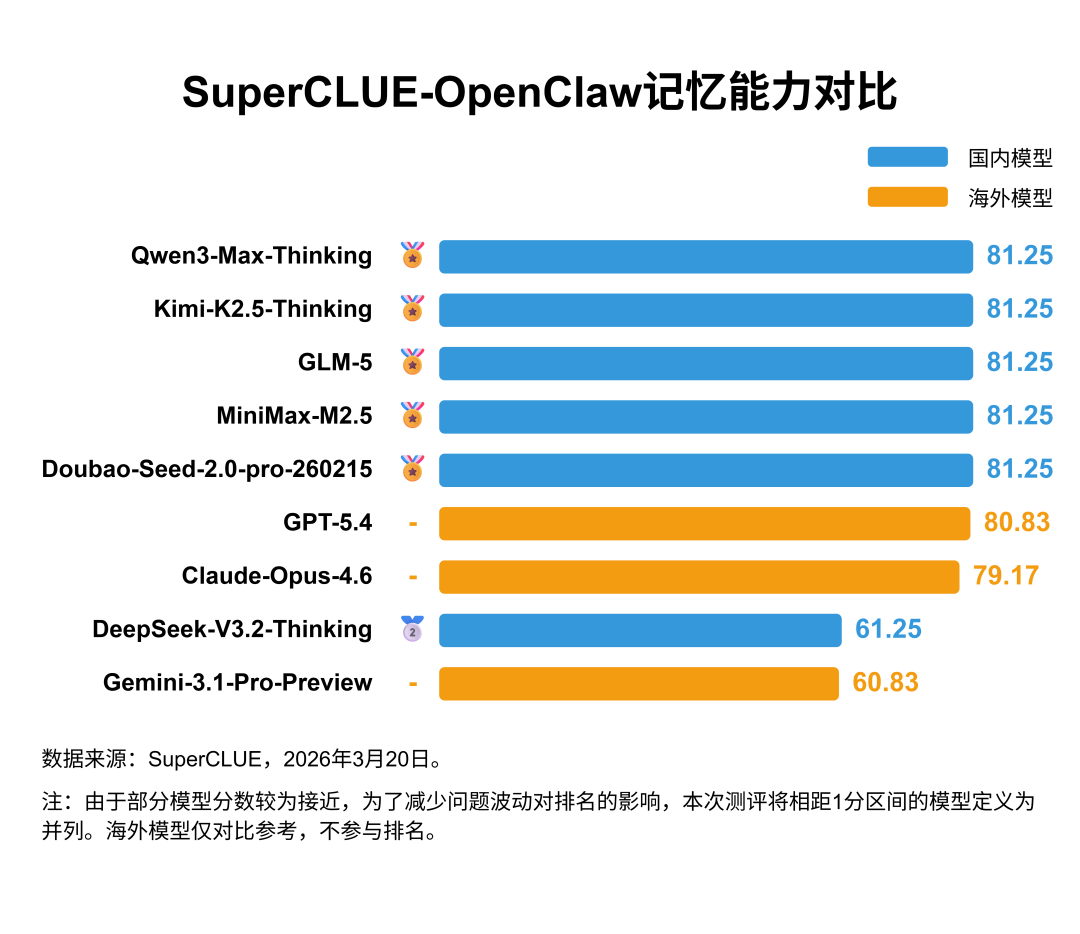

2. 记忆能力

(1)国内模型记忆能力全面登顶。国产头部模型Qwen3-Max-Thinking、Kimi-K2.5-Thinking、GLM-5、MiniMax-M2.5、Doubao-Seed-2.0-pro均获得81.25分,在OpenClaw记忆能力评测中形成"第一梯队"并列领先,整体略胜海外主流模型。

(2)海外模型表现参差。GPT-5.4(80.83)和Claude-Opus-4.6(79.17)紧随其后,但略低于国产第一梯队;Gemini-3.1-Pro-Preview(60.83)表现显著掉队,与DeepSeek-V3.2-Thinking(61.25)同处第二梯队。

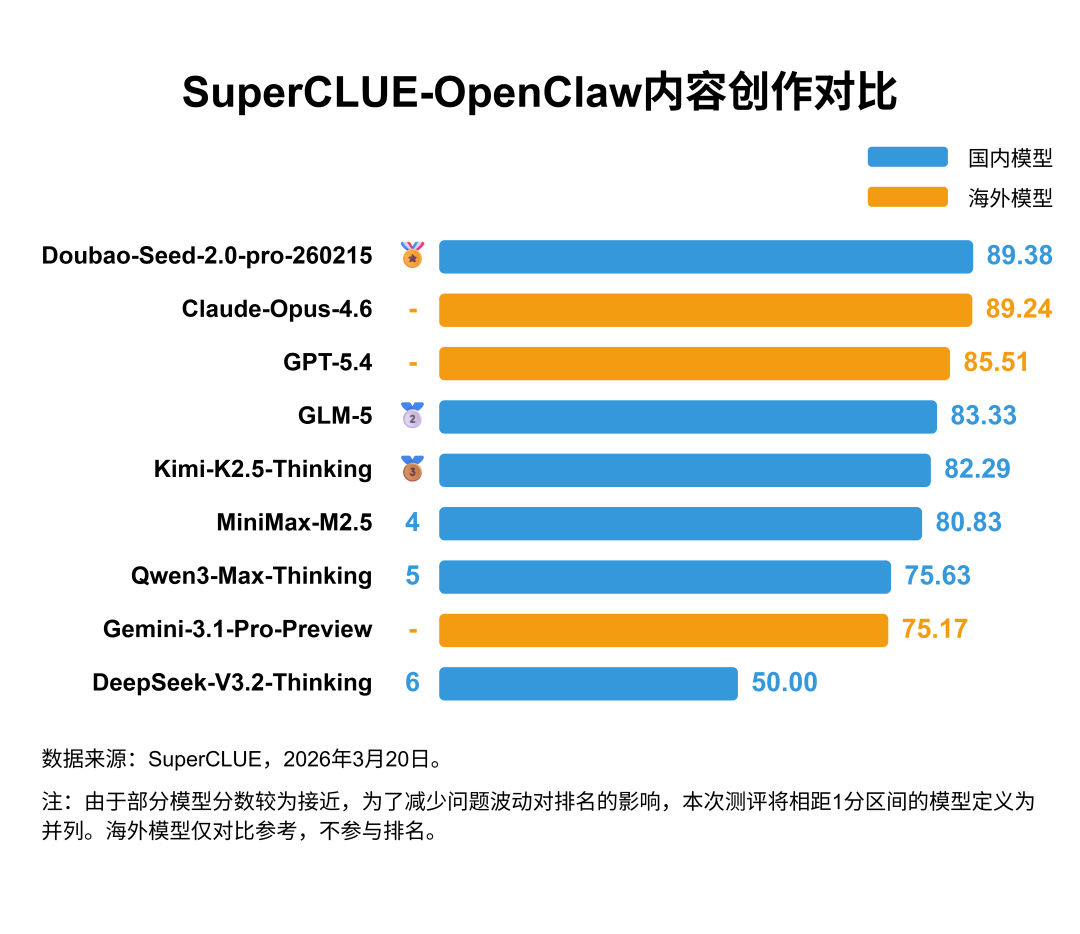

3. 内容创作

(1)国内模型登顶榜首。Doubao-Seed-2.0-pro以89.38分位居第一,小幅领先海外最强的Claude-Opus-4.6(89.24分)。前6名中国内模型占据4席,且GLM-5、Kimi-K2.5-Thinking均突破82分。

(2)海外模型表现分化。海外模型中Claude-Opus-4.6表现优异(与豆包几乎持平),但Gemini-3.1-Pro-Preview仅75.17分。

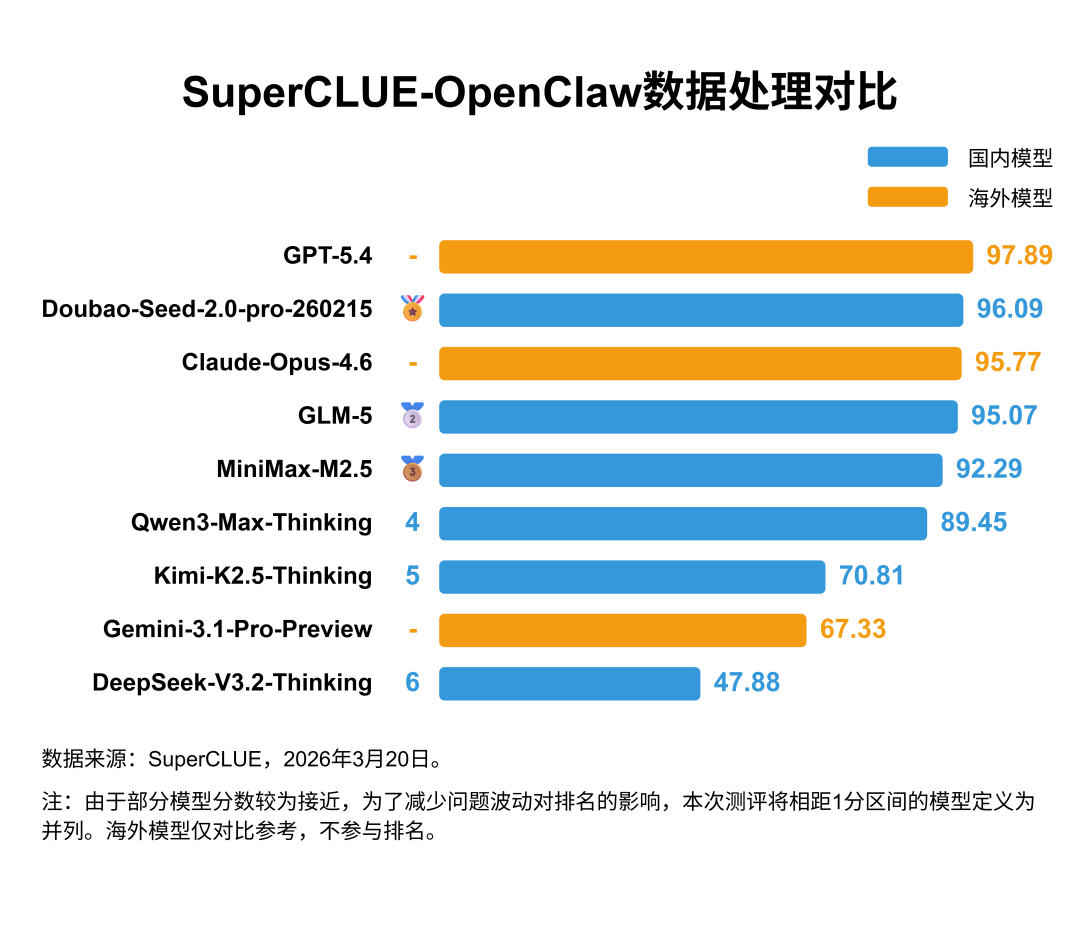

4. 数据处理

头部梯队竞争激烈,国产模型表现亮眼。国内模型 Doubao-Seed-2.0-pro (96.09分) 夺得国内榜首,仅次于海外模型 GPT-5.4 (97.89分),两者仅差1.8分。GLM-5 (95.07分) 与 Claude-Opus-4.6 (95.77分)得分几乎持平,显示出国内头部模型在数据处理任务上已具备对标海外顶尖模型的能力。

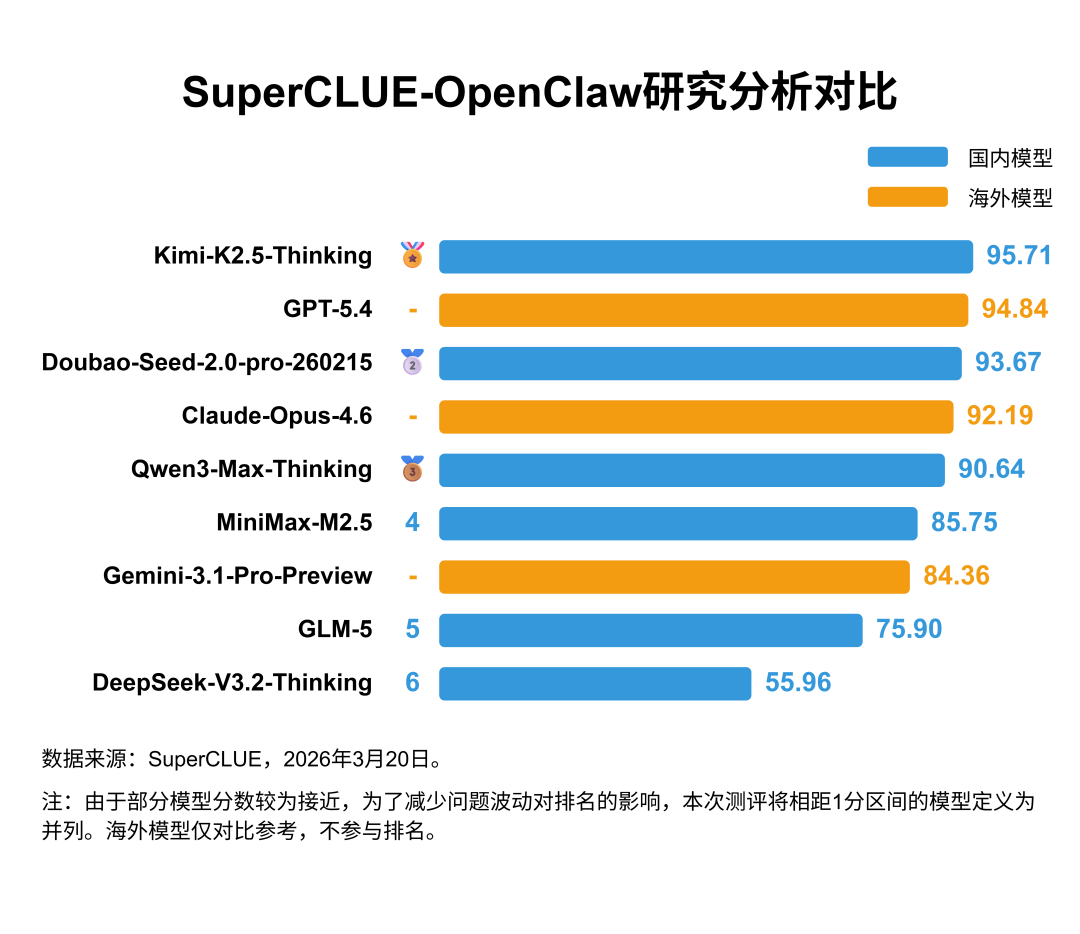

5. 研究分析

国产头部模型在「研究分析」场景实现反超。Kimi-K2.5-Thinking以95.71分超越GPT-5.4(94.84),在该维度拿下第一。国内前三甲(Kimi、Doubao、Qwen3-Max)平均分 93.34,略高于海外三强(GPT-5.4、Claude-Opus、Gemini-3.1)的 90.46。表明在需要深度信息整合、数据分析和报告生成的复杂研究任务中,国产头部模型已具备国际顶尖水平。

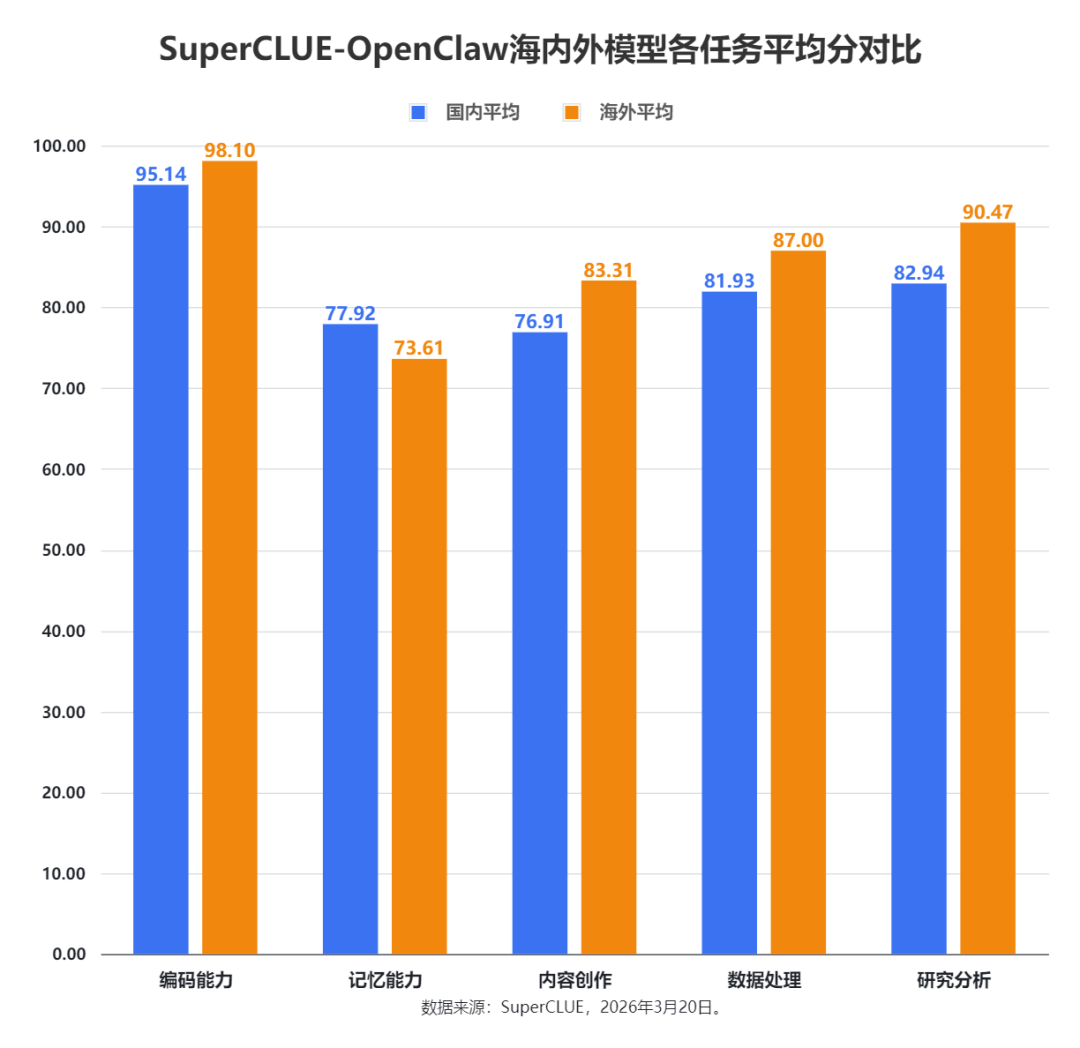

三、海内外模型各任务平均分对比

海外模型在综合任务能力上略占上风,在四大维度中均有领先,国内模型在编码领域已形成竞争力,记忆能力更是唯一反超的维度。

海外模型平均在研究分析(92.40 vs 82.94)和内容创作(85.96 vs 76.91)维度建立显著优势,差距分别达 9.5分 和 9.0分。国内模型在基础记忆任务具备局部优势,但在高阶认知任务(研究、创作)上与海外模型存在较大的能力差距。

1. 编码能力:差距最小的高分领域

海内外模型均表现优异(95.14 vs 98.10),差距仅2.96分,说明国内模型在代码生成/理解场景已接近国际顶尖水平。

2. 记忆能力:国内唯一优势项

国内平均77.92分,反超海外4.31分,反映出国内模型在中文语境下的长文本记忆优化更充分。

3. 研究分析:差距最大的短板

海外模型领先7.53分(90.47 vs 82.94),涉及深度推理、学术探究类任务仍是国内模型薄弱环节。

4. 内容创作与数据处理:中等差距

内容创作差距6.4分,数据处理差距5.07分,海外模型在开放性生成和结构化数据处理上更具优势。

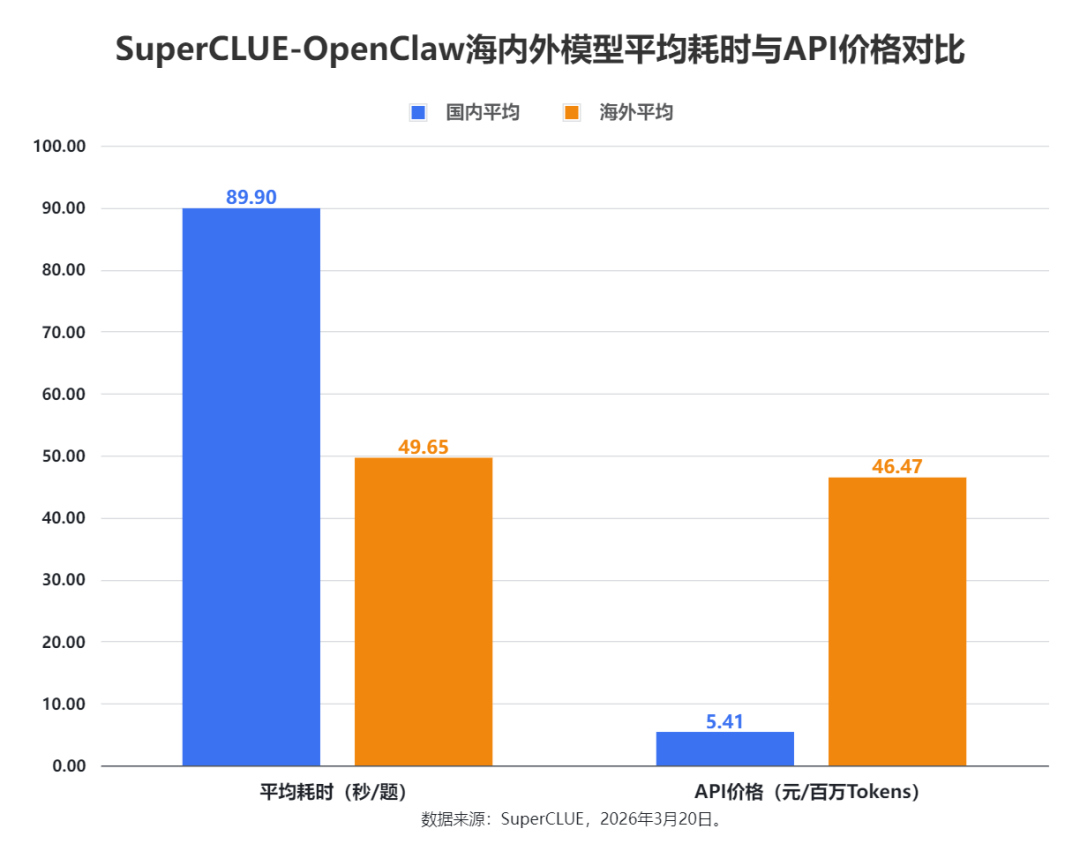

四、耗时与成本对比

1. 时效 vs 成本的权衡:国内模型以约1/9的价格换取了约1.8倍的响应时间,呈现明显的"低价慢速"特征;海外模型则是"高价快速"路线。

2. 若将"效率"定义为单位价格下的处理速度,海外模型的单位时间成本反而更高(国内:0.06元/秒,海外:0.94元/秒),国内模型在成本效率上占优。

# 对比示例

【任务类型】:记忆能力

【题目】

阅读当前目录下的 notes.md 文件,找出后端开发团队的负责人是谁。将答案(仅人名)写入 answer.txt 文件中。

凤凰项目 (Project Phoenix) - 开发笔记时间表Alpha 发布: 2024年3月15日Beta 发布: 2024年6月1日正式发布: 2024年9月30日团队开发负责人: 陈莎拉 (Sarah Chen)后端: 王磊 (Marcus Rodriguez), Aisha Patel前端: James Kim, Elena VolkovQA: David Thompson主要功能实时协作高级分析仪表板移动应用集成支持 GraphQL 的 API v2当前状态我们目前处于 Alpha 测试阶段,有50名内部用户。反馈非常积极,特别是关于新 UI 的部分。Beta 发布定于 2024年6月1日,我们要按时完成。技术栈前端: React 18, TypeScript后端: Node.js, Express, PostgreSQL基础设施: AWS (ECS, RDS, S3)CI/CD: GitHub Actions阻碍因素需要在 Beta 版之前完成 API 文档移动应用需要性能优化等待安全审计完成

def grade(transcript: list, workspace_path: str) -> dict: """ 基于正确答案提取对记忆检索任务进行评分。 参数: transcript: 解析后的 JSONL 记录,作为字典列表 workspace_path: 任务隔离工作区目录的路径 返回: 将评分标准名称映射到分数(0.0 到 1.0)的字典 """ from pathlib import Path import re scores = {} workspace = Path(workspace_path) # 检查 answer.txt 是否存在 answer_file = workspace / "answer.txt" if not answer_file.exists(): scores["file_created"] = 0.0 scores["correct_answer"] = 0.0 scores["clear_answer"] = 0.0 scores["read_notes"] = 0.0 scores["no_hallucination"] = 0.0 return scores scores["file_created"] = 1.0 # 读取答案内容 try: content = answer_file.read_text(encoding="utf-8").strip() except Exception: content = "" # 检查正确答案 ("王磊") if "王磊" in content: scores["correct_answer"] = 1.0 elif "Marcus" in content or "Rodriguez" in content: # 英文名给一半分 scores["correct_answer"] = 0.5 else: scores["correct_answer"] = 0.0 # 检查答案是否清晰(简洁,无多余行) # 理想情况:"王磊"(长度 2) # 可接受:"后端负责人是王磊"(长度 ~9) if len(content) < 20 and "\n" not in content: scores["clear_answer"] = 1.0 elif len(content) < 50: scores["clear_answer"] = 0.5 else: scores["clear_answer"] = 0.0 # 检查记录中是否读取了 notes.md read_notes = False for event in transcript: if event.get("type") != "message": continue msg = event.get("message", {}) if msg.get("role") == "assistant": for item in msg.get("content", []): if item.get("type") == "toolCall": tool_name = item.get("name", "") params = item.get("params", {}) # 检查 agent 是否读取了 notes.md # 支持多种工具变体:read_file (OpenClaw), readFile (legacy), Read (Gemini) if tool_name in ["read_file", "readFile", "Read"]: files = params.get("files", []) file_path = params.get("file_path", "") # 检查文件列表和单个文件路径 if any("notes.md" in str(f) for f in files) or "notes.md" in str(file_path): read_notes = True break if read_notes: break scores["read_notes"] = 1.0 if read_notes else 0.0 # 检查是否有幻觉(提到了错误的人) # Sarah Chen (负责人), Aisha Patel (后端), James Kim (前端), Elena Volkov (前端), David Thompson (QA) wrong_answers = [ "Sarah", "陈莎拉", "Aisha", "Patel", "James", "Kim", "Elena", "Volkov", "David", "Thompson" ] if any(name in content for name in wrong_answers): scores["no_hallucination"] = 0.0 else: scores["no_hallucination"] = 1.0 return scores

Agent response: [{'type': 'thinking', 'thinking': '用户要求我阅读 notes.md 文件,找出后端开发团队的负责人,然后将答案写入 answer.txt 文件。\n\n让我先读取 notes.md 文件。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_8a03da0b46a14b2eb6718e56', 'name': 'read', 'arguments': {'path': 'notes.md'}}]Agent response: [{'type': 'thinking', 'thinking': '从 notes.md 文件中,我可以看到团队部分:\n\n```\n## 团队\n\n- 开发负责人:陈莎拉 (Sarah Chen)\n- 后端:王磊 (Marcus Rodriguez), Aisha Patel\n- 前端:James Kim, Elena Volkov\n- QA: David Thompson\n```\n\n这里列出了后端团队成员:王磊 (Marcus Rodriguez) 和 Aisha Patel。但问题是问"后端开发团队的负责人是谁"。\n\n从文件来看,"开发负责人"是陈莎拉 (Sarah Chen),但这是整个开发的负责人,不是专门后端的。\n\n后端团队列出了两个人:王磊 (Marcus Rodriguez) 和 Aisha Patel。通常列表中第一个人可能是负责人,但文件没有明确说明谁是后端负责人。\n\n不过,按照常见的团队列表惯例,王磊 (Marcus Rodriguez) 排在第一位,很可能是后端团队的负责人。\n\n让我将答案写入 answer.txt 文件。答案应该是"王磊"或者"王磊 (Marcus Rodriguez)"。用户说"仅人名",我认为应该是中文名"王磊"。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_6d6696697bb540ef9dd9d606', 'name': 'write', 'arguments': {'path': 'answer.txt', 'content': '王磊\n'}}]Agent response: [{'type': 'thinking', 'thinking': '已完成任务。从 notes.md 中找到后端团队成员列表,王磊排在第一位,应该是后端团队负责人。已将答案"王磊"写入 answer.txt 文件。', 'thinkingSignature': 'reasoning_content'}, {'type': 'text', 'text': '已完成。从 `notes.md` 的团队部分可以看到:\n\n```\n- 后端:王磊 (Marcus Rodriguez), Aisha Patel\n```\n\n王磊是后端团队名单中的第一位,因此是后端开发团队的负责人。答案已写入 `answer.txt`。'}]

Agent response: [{'type': 'thinking', 'thinking': '我需要读取当前目录下的notes.md文件,找出后端开发团队的负责人是谁。然后将答案(仅人名)写入answer.txt文件中。\n\n首先,让我看看当前目录下有什么文件。使用exec列出文件。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_ZvgRdig6jrK78KUVljnUMalQ', 'name': 'exec', 'arguments': {'command': 'ls -la'}}]Agent response: [{'type': 'thinking', 'thinking': '好的,有notes.md文件。现在读取它。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_BTGEN8bmvproijc0f3IBri9z', 'name': 'read', 'arguments': {'path': 'notes.md'}}]Agent response: [{'type': 'thinking', 'thinking': '我需要找出后端开发团队的负责人是谁。从笔记中看,有一个“开发负责人: 陈莎拉 (Sarah Chen)”,但这是开发负责人,不一定是后端负责人。然后有一个“后端: 王磊 (Marcus Rodriguez), Aisha Patel”。这列出了后端团队成员,但没有明确指定负责人。\n\n不过,可能“开发负责人”负责整个开发团队,包括后端。但问题明确问的是“后端开发团队的负责人”。也许在上下文中,开发负责人就是后端团队的负责人?或者可能没有明确指定,需要从其他线索推断。\n\n让我搜索一下“负责人”或“lead”。也许在notes.md中没有,但可能有其他文件。不过,指令是“阅读当前目录下的 notes.md 文件,找出后端开发团队的负责人是谁。”所以答案应该来自notes.md。如果没有明确指定,可能需要推断。可能“开发负责人”就是后端开发团队的负责人,或者“王磊”是负责人,因为首先列出?但不确定。\n\n让我再仔细读一遍。在“团队”部分,有:\n\n- 开发负责人: 陈莎拉 (Sarah Chen)\n- 后端: 王磊 (Marcus Rodriguez), Aisha Patel\n\n这里“开发负责人”可能指的是整个开发团队的负责人,而不是专门的后端负责人。但也许在后端团队中,第一个人(王磊)是负责人?通常列表中第一个名字可能是负责人。但问题可能期望“陈莎拉”作为答案,因为她是开发负责人,可能也负责后端。\n\n但为了更确定,也许有其他上下文。让我检查是否有其他文件包含更多信息。不过,指令只提到notes.md。我应该只从这个文件中寻找答案。\n\n也许“开发负责人”就是后端开发团队的负责人。在很多组织中,开发负责人可能负责后端开发。但前端也有开发负责人?实际上,“开发负责人”可能负责前端和后端。然而,问题特别指出“后端开发团队”,这可能是一个独立的团队。\n\n如果notes.md中没有明确的后端负责人,我可能需要假设是“王磊”,因为他是后端团队中列出的第一个人。或者可能是“陈莎拉”。我需要做出决定。\n\n让我看看是否还有其他会议笔记或其他文件。使用grep搜索“后端负责人”或“后端 lead”。用exec搜索当前目录。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_0EnEWj6gDC1yKSTC9VlPihWZ', 'name': 'exec', 'arguments': {'command': 'grep -r "后端负责人" . 2>/dev/null || echo "没有找到"'}}]Agent response: [{'type': 'thinking', 'thinking': '搜索“负责人”:', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_r1hdbJBaAMHxR3a2PggxgBed', 'name': 'exec', 'arguments': {'command': 'grep -r "负责人" . 2>/dev/null | head -20'}}]Agent response: [{'type': 'thinking', 'thinking': '所以只有“开发负责人”。可能答案就是“陈莎拉”。但问题明确问的是“后端开发团队的负责人”。可能是一个陷阱:开发负责人就是后端开发团队的负责人,因为前端和QA是分开的?实际上,前端也有一个团队,所以开发负责人可能负责所有开发,包括后端和前端。但“后端开发团队”可能指的是后端子团队,其负责人可能是“王磊”或“Aisha Patel”。\n\n然而,在中文中,“后端开发团队的负责人”可能指的是“后端负责人”。但notes.md中没有“后端负责人”。也许在会议讨论中,开发负责人陈莎拉也是后端负责人?我需要检查其他文件吗?指令说“阅读当前目录下的 notes.md 文件”,所以只从这个文件获取信息。\n\n也许答案是“陈莎拉”。让我假设是这样。或者,我可以将“王磊”作为后端负责人,因为他是第一个列出的后端工程师。但通常第一个列出的不一定是负责人。\n\n让我再看一遍notes.md,看看是否有任何暗示。可能“开发负责人”是陈莎拉,她负责整个开发,包括后端。所以答案是“陈莎拉”。我将把“陈莎拉”写入answer.txt。但也许他们想要英文名“Sarah Chen”。问题说“仅人名”,可能是中文名“陈莎拉”或英文名“Sarah Chen”。在notes.md中,两种形式都给出了。通常在这种上下文中,可能使用中文名“陈莎拉”。我会选择“陈莎拉”。\n\n但为了更准确,让我检查是否在其他地方有“后端负责人”。搜索“后端”这个词。使用grep查看上下文。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_Xgy14katUhuZOfH8xignVl6x', 'name': 'exec', 'arguments': {'command': 'grep -B2 -A2 "后端" notes.md'}}]Agent response: [{'type': 'thinking', 'thinking': '所以“后端”这个词出现在团队列表和技术栈中。在团队列表中,它列出了两个名字。没有指定负责人。也许负责人在其他地方被提及,比如“开发负责人”负责后端。我会选择“陈莎拉”。\n\n但让我们想想:在团队结构中,通常有一个开发负责人,然后每个子团队(后端、前端、QA)可能有一个负责人。但这里没有列出。可能开发负责人就是后端负责人。我会将“陈莎拉”作为答案。\n\n现在,我需要将答案写入answer.txt。使用write工具。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_gQD4rD5bTcXW9qaQRv0Ph7pI', 'name': 'write', 'arguments': {'path': 'answer.txt', 'content': '陈莎拉'}}]Agent response: [{'type': 'thinking', 'thinking': '现在验证一下文件内容。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_jMdHU83C9SOx4uILILuRIYsR', 'name': 'read', 'arguments': {'path': 'answer.txt'}}]Agent response: [{'type': 'thinking', 'thinking': '好的。现在我需要确保这是正确的。也许我可以再检查一下是否有其他文件提到后端负责人。但指令明确要求只读取notes.md。不过,为了彻底一点,我可以快速检查一下其他文件,比如conferences.md或article.md,看看是否有关于团队结构的更多信息。但可能没有必要。\n\n我将用exec列出所有文件,并快速查看是否有任何文件包含“backend lead”或“后端负责”。使用grep。', 'thinkingSignature': 'reasoning_content'}, {'type': 'toolCall', 'id': 'call_00_9hJ1uDNOirMe92AfKsgItsJz', 'name': 'exec', 'arguments': {'command': 'grep -i "lead\\|负责" *.md *.txt 2>/dev/null | head -30'}}]Agent response: [{'type': 'thinking', 'thinking': '所以只有notes.md提到了“开发负责人”。没有“后端负责”。因此,我的答案很可能是正确的。\n\n现在,完成任务:阅读notes.md,找出后端开发团队的负责人,并将答案写入answer.txt。已经完成。我将给出一个简短的回复,说明我已经完成了。', 'thinkingSignature': 'reasoning_content'}, {'type': 'text', 'text': '我已经读取了 notes.md 文件,找到了后端开发团队的负责人,并将人名写入 answer.txt。\n\n结果:\n- 负责人:陈莎拉(Sarah Chen)\n- 已保存至:answer.txt'}]

【评价】:

DeepSeek-V3.2-Thinking成功创建了 answer.txt 文件并且答案清晰,但是函数名大小写错误(read——Read)、答案不正确、存在幻觉,仅有2个得分点得分,最终此任务得 0.4 分。

# 参测流程

1.邮件申请

2.意向沟通

3.参测确认与协议流程

4.提供API接口或大模型

5.获得测评报告

# 邮件申请

# 联系我们