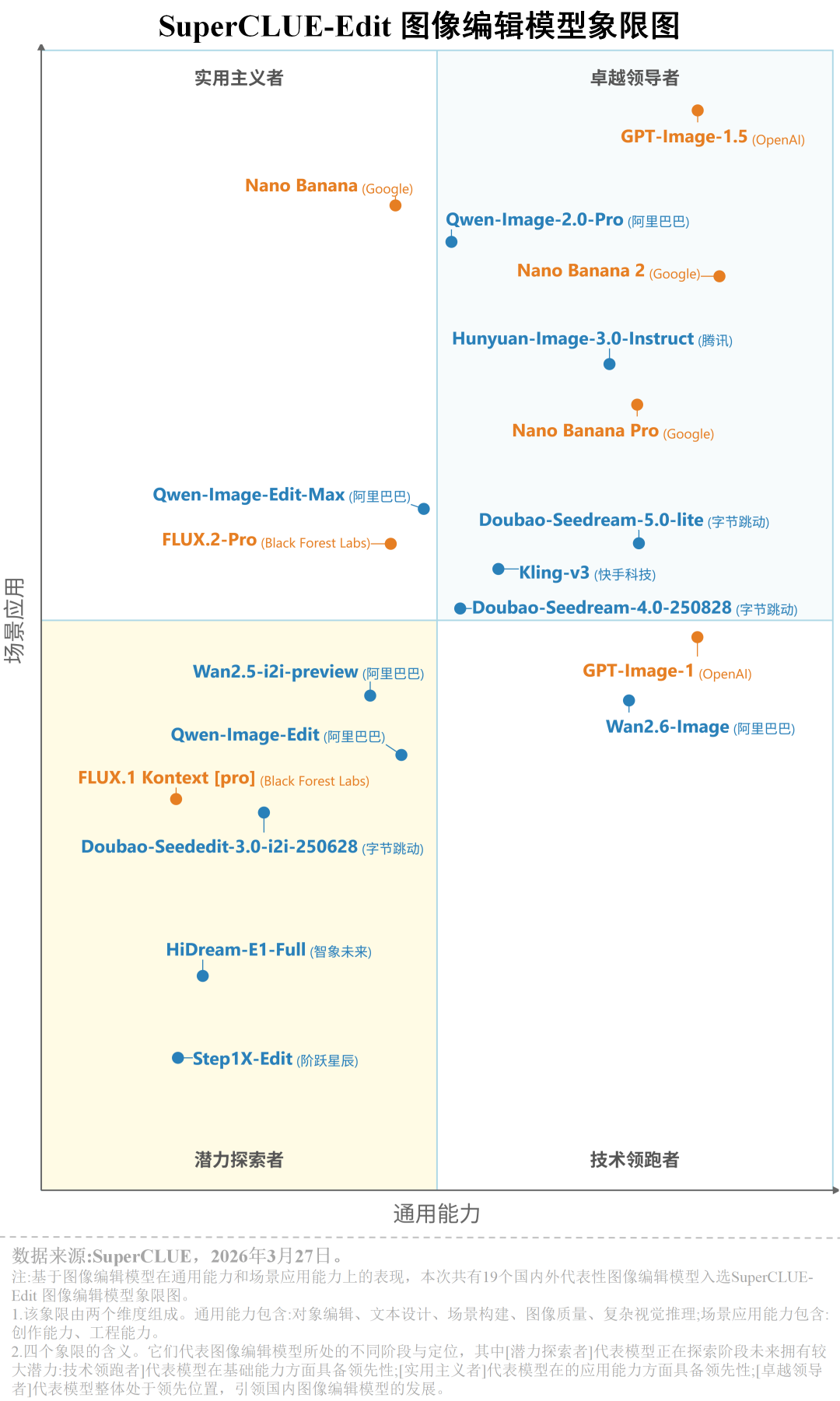

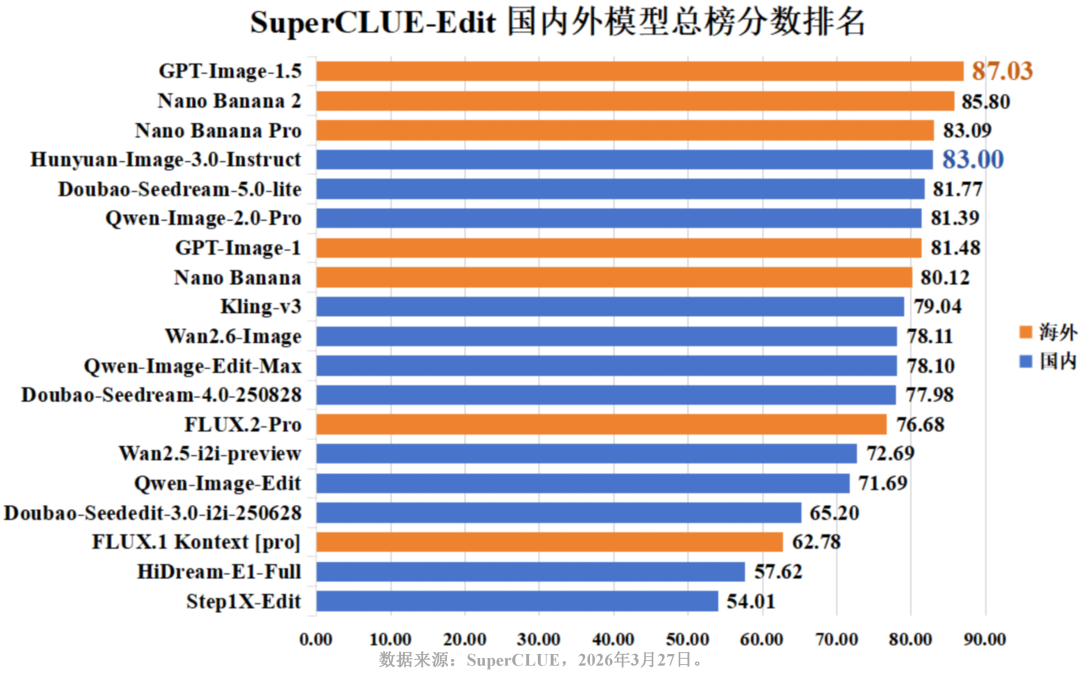

3月图像编辑榜单发布!GPT-Image-1.5领跑,腾讯混元国内第一!

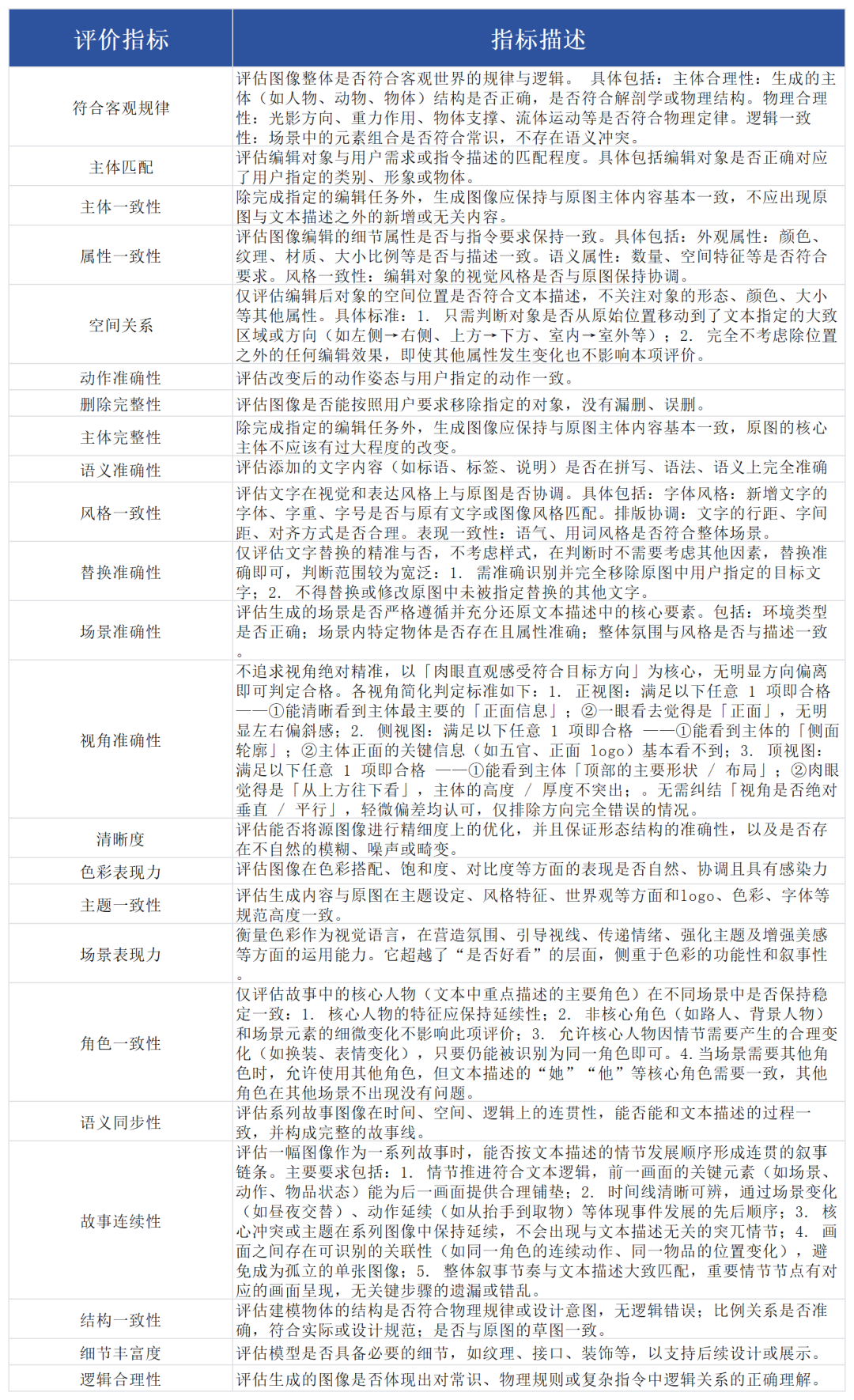

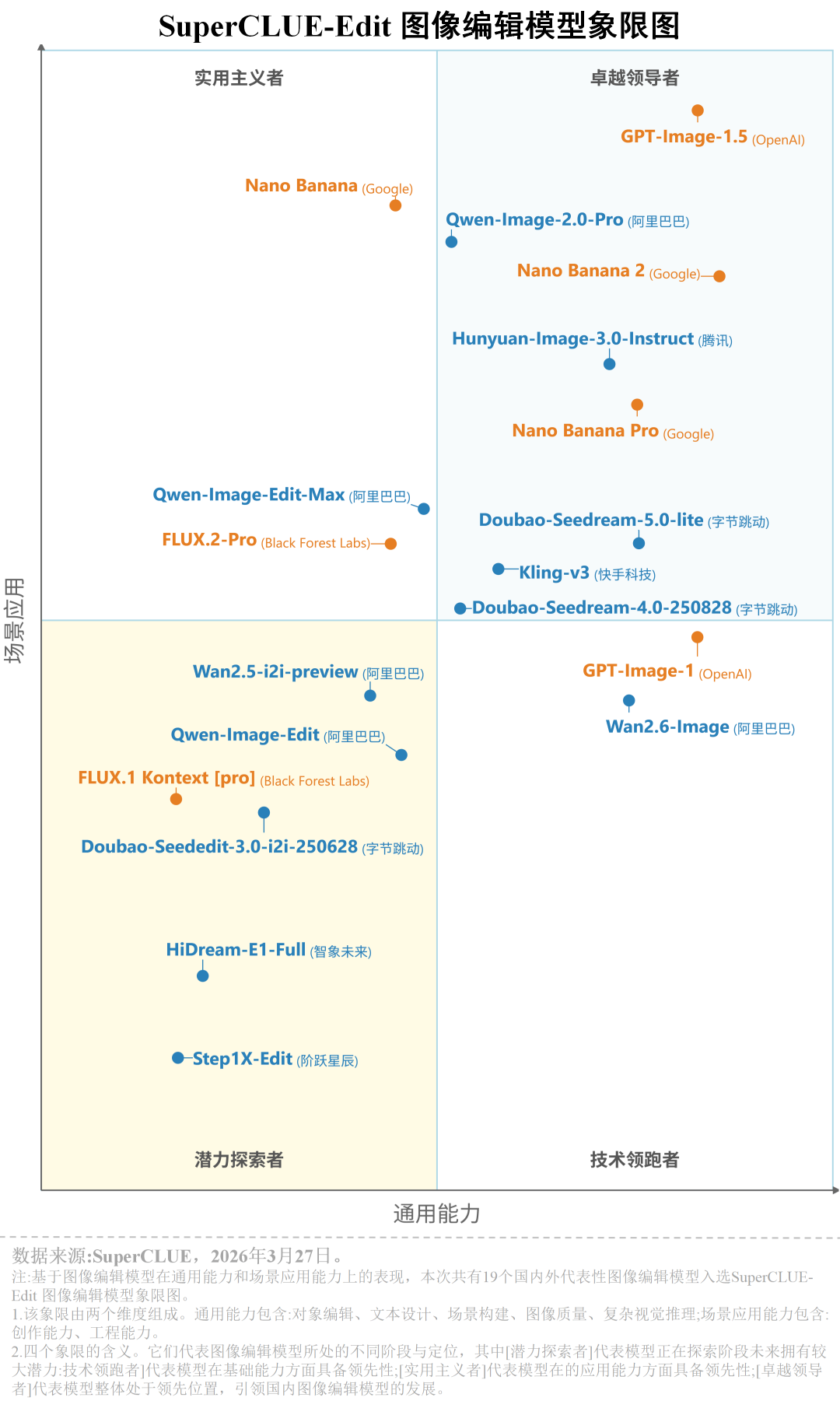

2026 年 3 月,SuperCLUE-Edit 中文原生图像编辑最新测评榜单发布。本次沿用 「图像编辑」测评基准中文方案发布,覆盖通用能力和应用场景两大核心维度,从多角度揭示图像编辑模型在语义理解、创意表达与视觉工程能力上的真实水平。

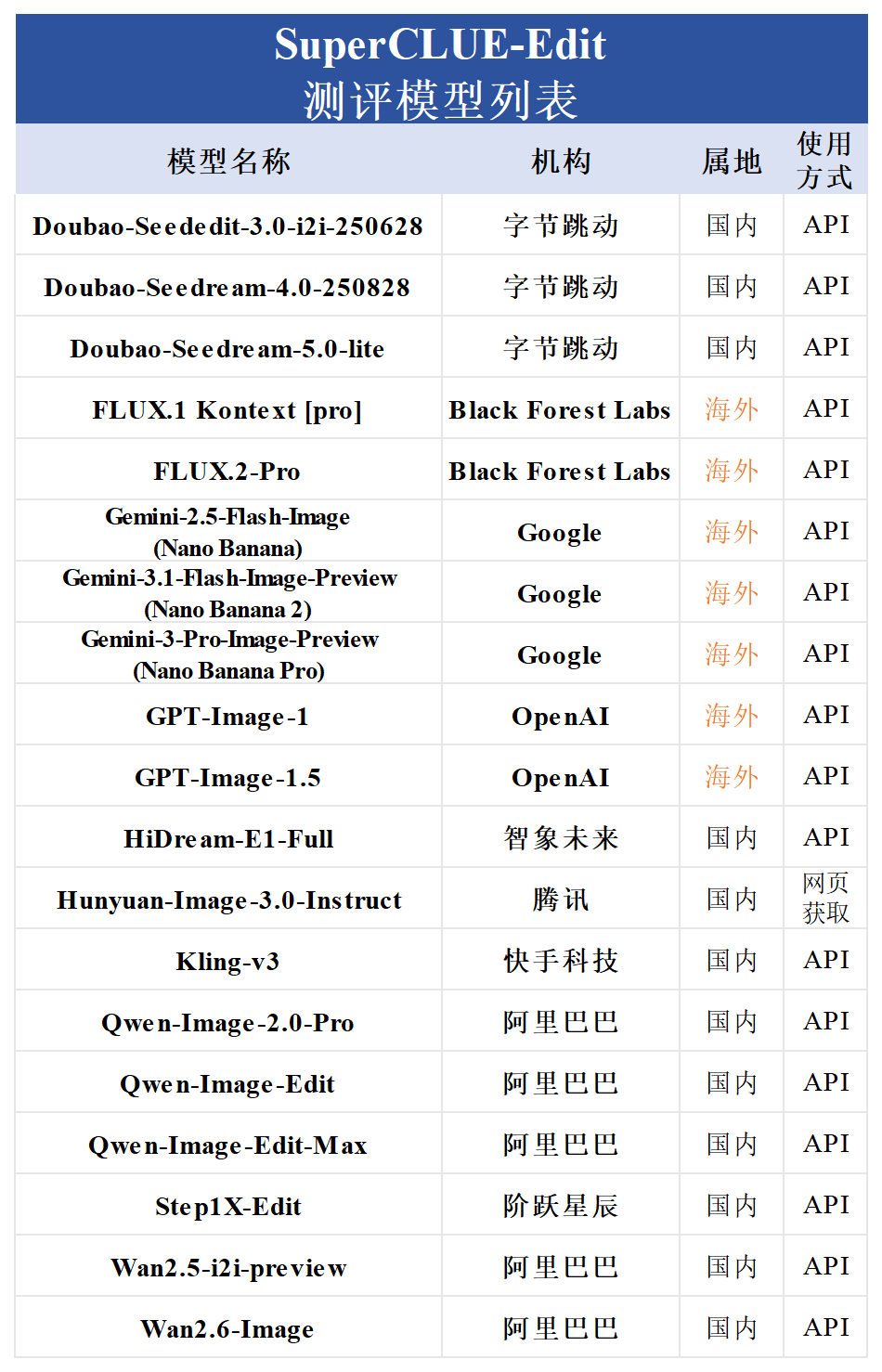

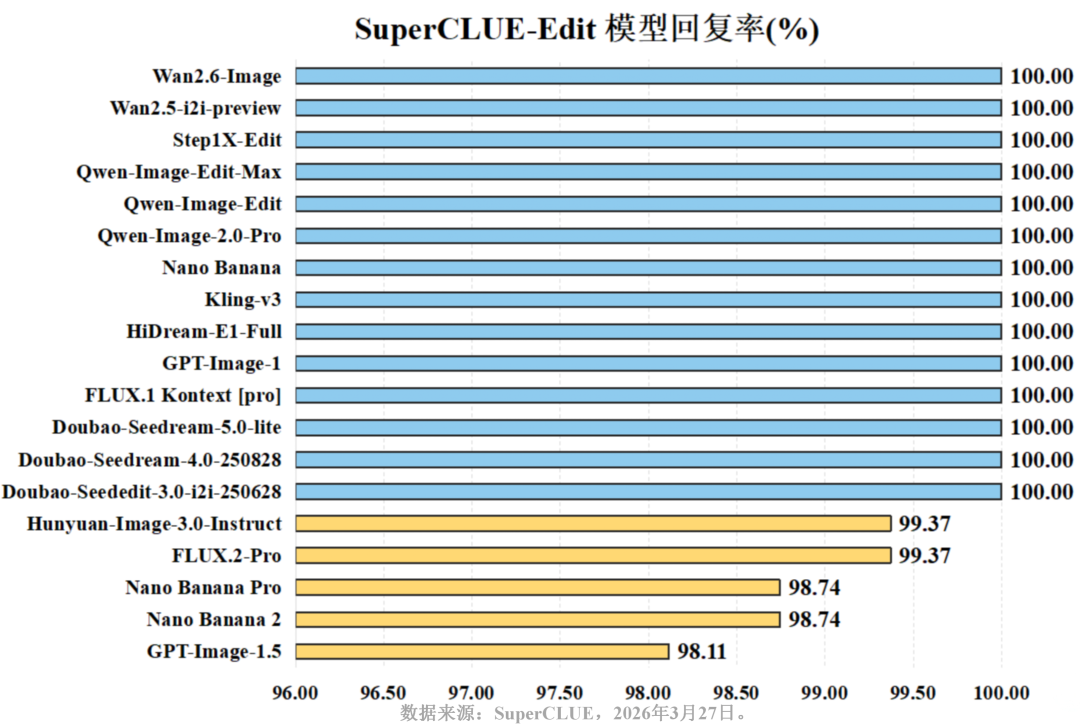

本次评测涵盖了国内外19个具有代表性的图像编辑模型,并对其综合能力进行了深入测评。以下为详细测评报告:

「过往文章介绍」

1.【2025年10月 图像编辑测评榜单参考文章】「图像编辑」测评基准榜单发布:Nano Banana中文能力欠佳,无缘第一,国产模型表现不俗!

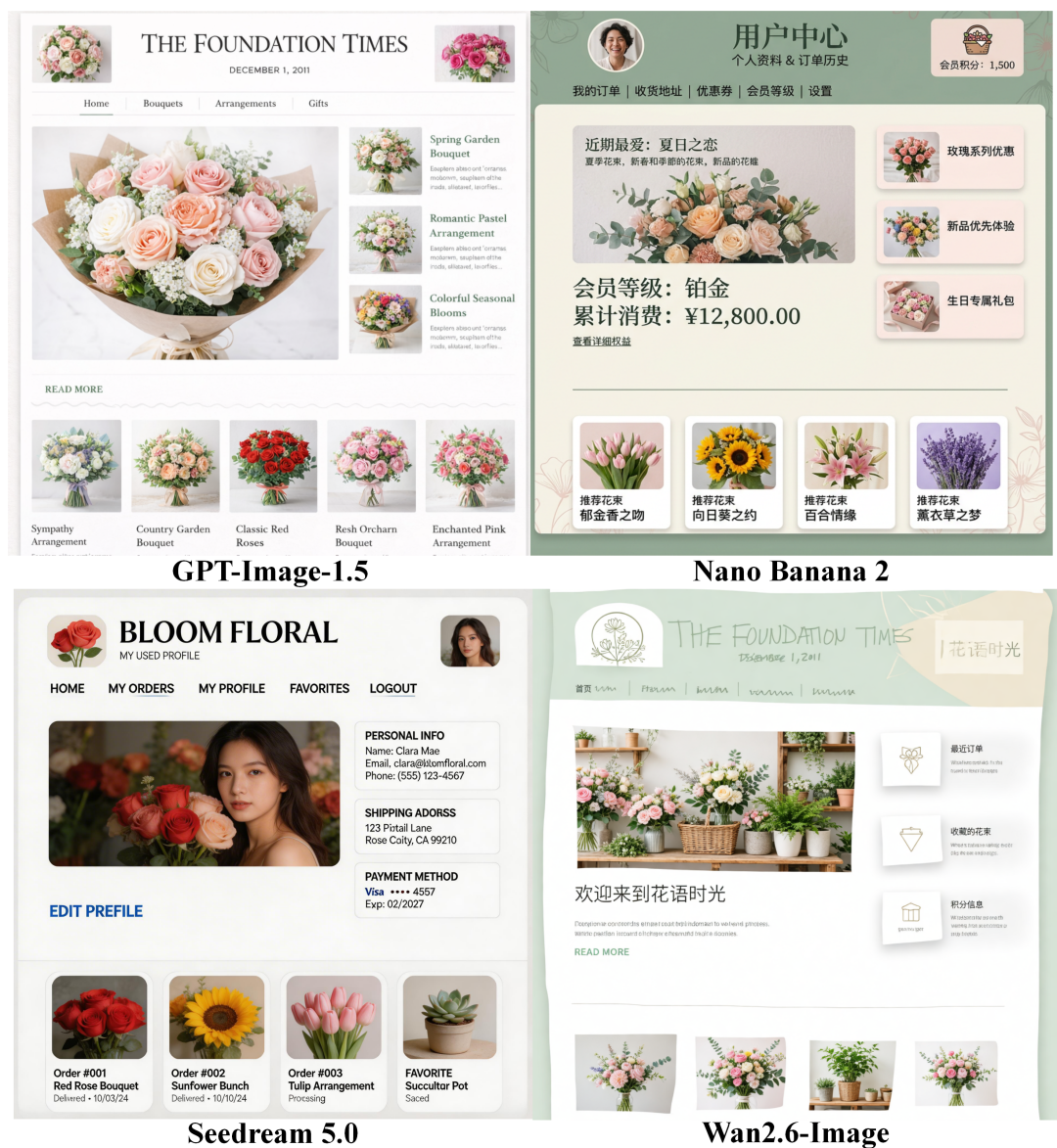

提示词:这是一个Web端用户详情的简图,请根据图中原型布局,将其渲染成一个花店的用户详情页面。

原始图片:

模型回答:

测评核心内容摘要

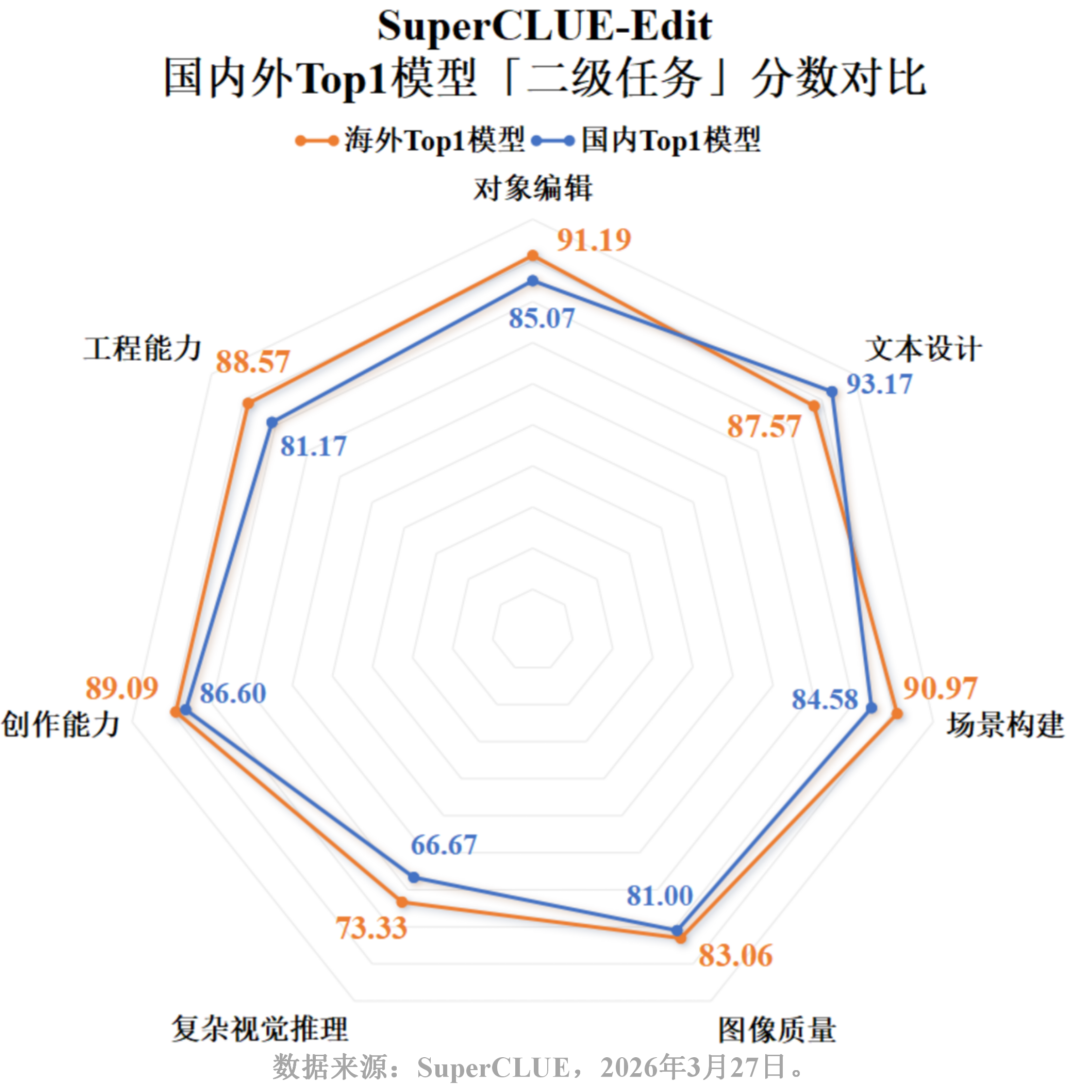

摘要1:海外保持领先,国内第一梯队紧追!

摘要2:通用能力优劣明显,复杂推理仍为国内弱项。

Google的 Nano Banana 2(85.99) 与 GPT-Image-1.5 (85.22) 领跑通用能力榜单。国内 Doubao-Seedream-5.0-lite (83.14) 、阿里的 Wan2.6-Image (82.79) ,并列国内第一。但在复杂视觉推理上,国内外模型差距超10分,依然国内弱项。

# SuperCLUE 图像编辑中文竞技场排行榜

本竞技场是一个大众投票的匿名评测平台,榜单汇聚最新投票数据,定期更新排名。诚邀您参与评测,在原生中文语境下用实际体验为模型能力提供真实反馈,共同完善图像编辑模型的评估标准。

访问地址:https://www.superclueai.com

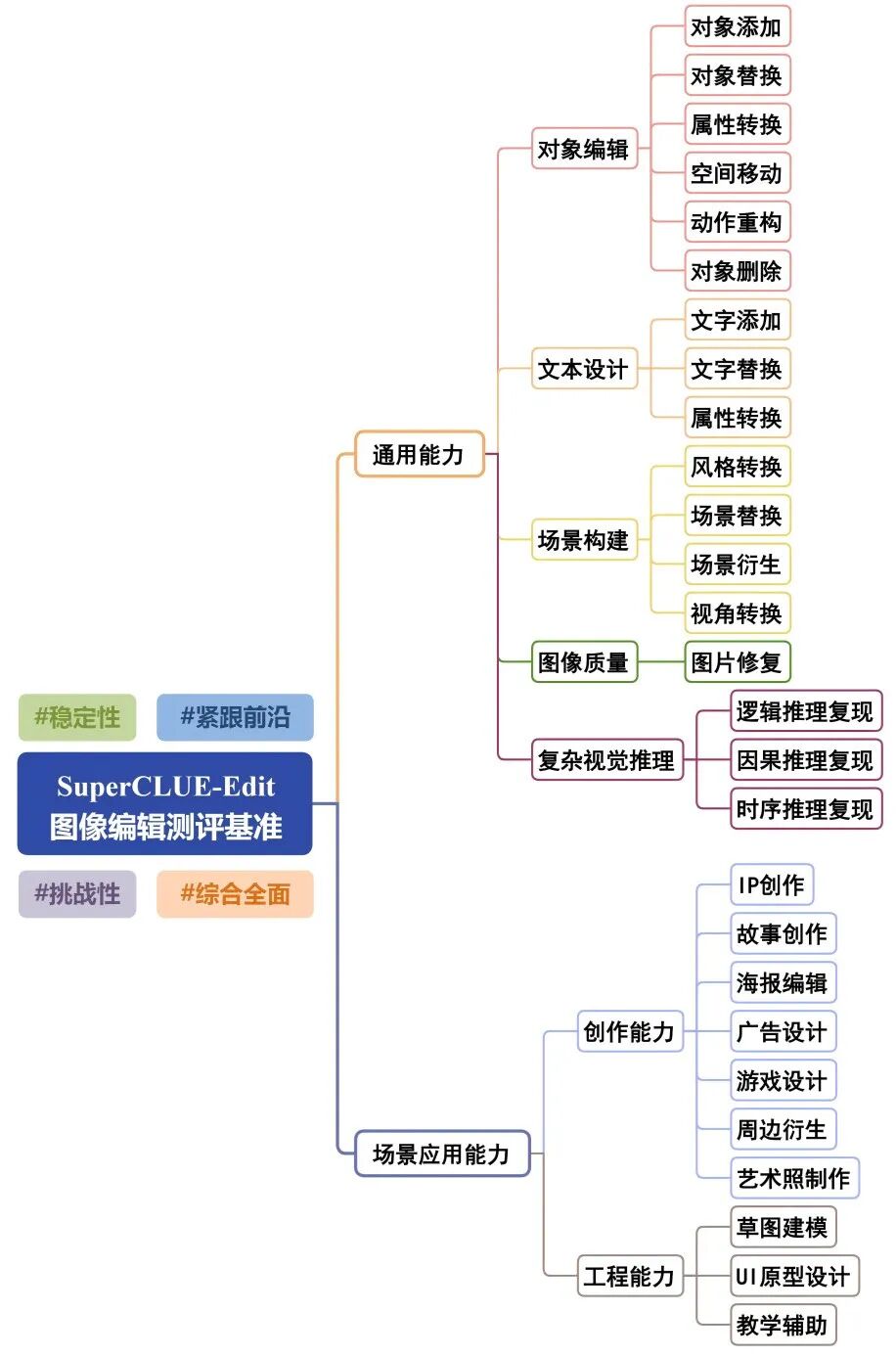

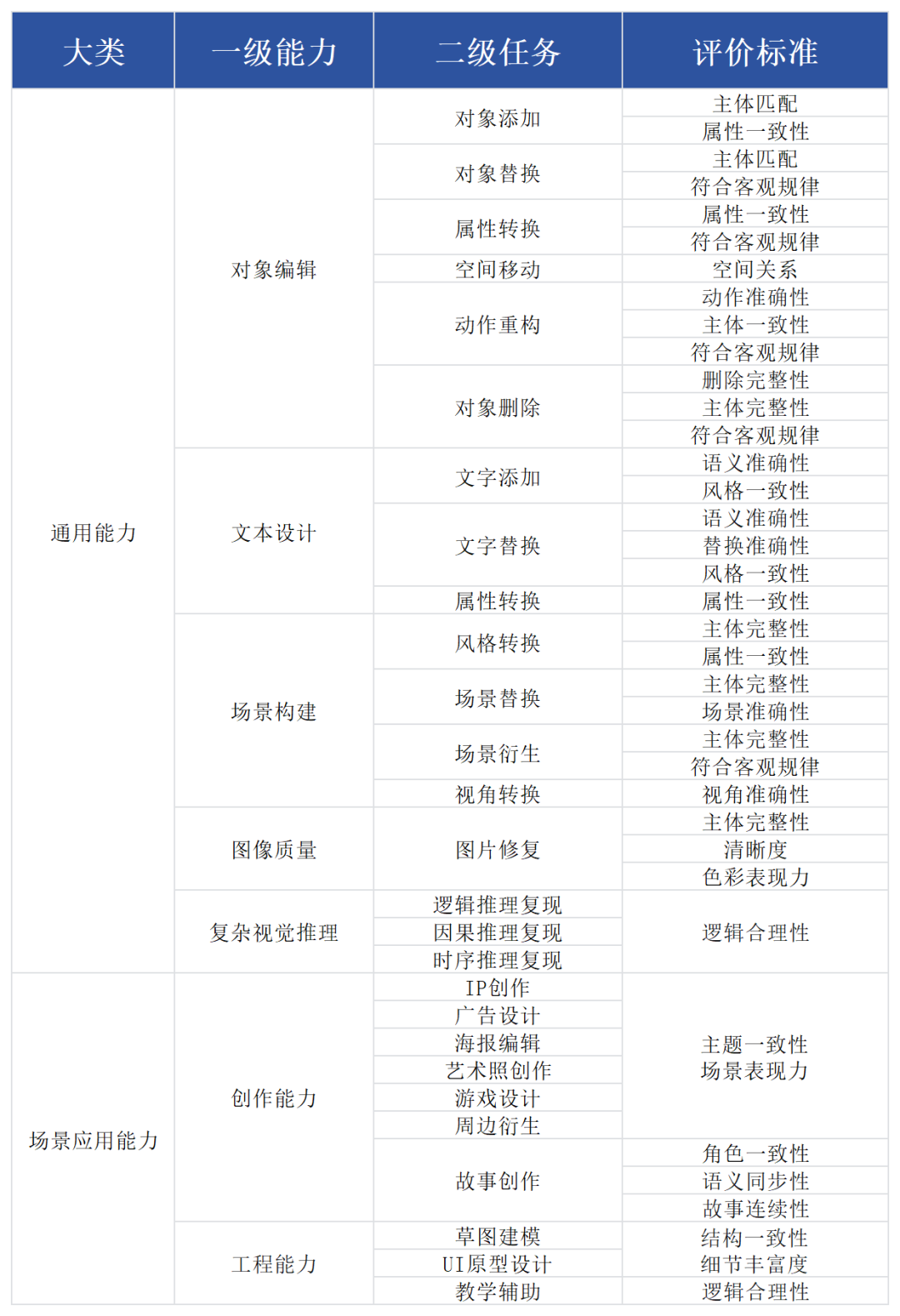

SuperCLUE-Edit 是一个聚焦图像编辑模型的基准,旨在为图像编辑领域的评估提供全面且多维的参考,覆盖通用能力和场景应用能力,涵盖28个子任务。

# 测评方法和评估示例

参考SuperCLUE细粒度评估方式,采用GPT-4o作为评价模型,每个维度进行细粒度的评估并可以提供详细的反馈信息。该评估流程分为以下几个步骤:

1. 测评集构建

我们结合具体场景与考察方向针对评估维度撰写图像编辑的提示词(prompt),为了更好地检验图像编辑模型的中文理解能力,本次的提示词语言主要使用汉语,针对个别国外模型采用英文提示词。

中文原生图像编辑测评基准中文题库的构建流程如下:

1.参考现有提示词(Prompt),撰写prompt--->

2.测试--->

3.基于测试结果优化完善prompt--->

4.系统化构建各维度专属评测集,形成完整测评题库。

2. 评分标准

GPT-4o根据预先定义的评测流程进行评估。评测流程涵盖了评价流程的说明、评价标准、打分细则、以及数据格式要求,确保评分的一致性、稳定性与公正性。

3. 自动化评分

GPT-4o将根据具体的任务类型结合相关的评价标准进行自动化评分。此外,SuperCLUE-Edit将采用多轮测评方案,即针对同一个模型生成的全部图片均将采取相同的评价流程进行前后三次测评,并将三次结果的平均值作为每个视频的最终分数参与后续计算与排名。

4. 综合评分与反馈

最终,我们将各一级维度的平均分计算出来,结合各模型在不同场景中的得分,最终分数将反映出该模型在每个场景的综合性能。结果将以统一的输出格式提供,包括每个单独任务的详细评分与总体评价。

评估示例

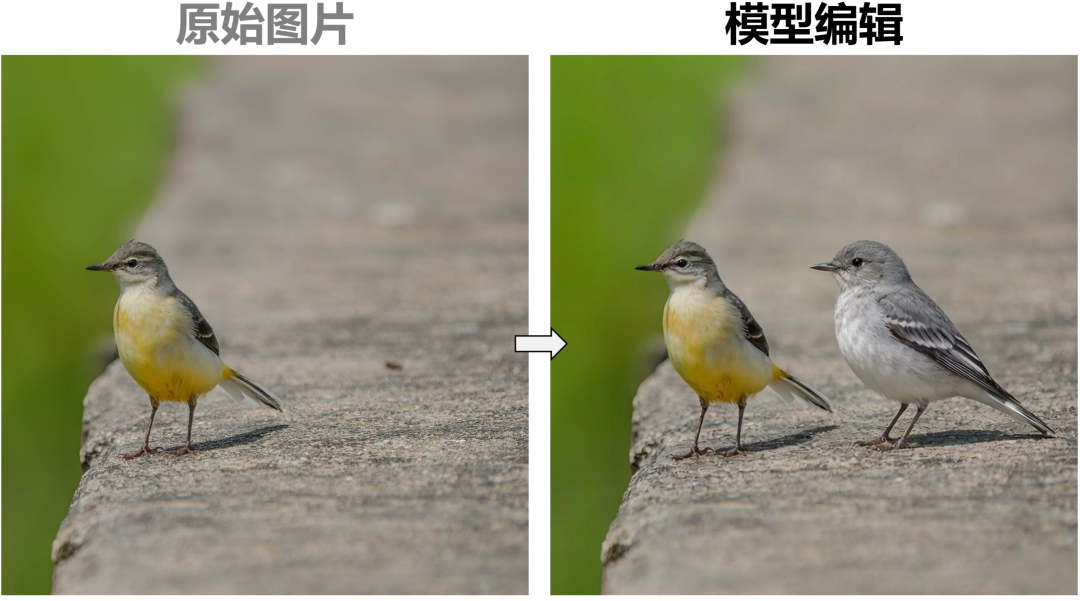

-----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀(0.8-1.0档) **基础要求检查:** 基础要求完全满足,无逻辑违背或明显不符现象。 1. **标准1 <主体匹配> 的评价:** - 灰白小鸟正确添加,与提示词中的物种描述一致。 - 添加的位置明显在黄胸小鸟的右侧,与描述吻合。 - 整体符合提示要求,无任何明显的错位或不符。 基于标准1的得分:【1】 2. **标准2 <属性一致性> 的评价:** - 小鸟外观上的灰白特征与指令一致,羽毛的整体颜色符合提示词要求。 - 添加的小鸟与原图主体小鸟的大小比例和放置位置符合逻辑,没有出现明显的不协调。 - 风格保持一致,光影处理自然,总体质量令人满意,但姿态设计稍显单调,羽毛纹理细节有提升空间。 基于标准2的得分:【0.9】 **综合得分计算:** 计算过程:(1 + 0.9) / 2 = 平均分 = 0.95 综合得分:【0.95】 -----评价结束----- 第二轮评价: -----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀 (0.8-1.0档) **基础要求检查:** 满足基础要求,无逻辑错误,符合提示需求。 1. **标准1 <主体匹配> 的评价:** <图像显然满足了主体匹配要求,增加的小鸟形象及灰白颜色与原始提示描述准确一致,同时位置也正确。无明显偏差。> 基于标准1的得分:【1】 2. **标准2 <属性一致性> 的评价:** <图像的属性一致性表现总体良好:灰白色的小鸟大小比例与场景协调一致;位置安排精确;风格与原场景融合较自然。但光影处理稍显不足,增加的小鸟的表现略显僵硬,与原鸟相比细节动态逼真度略逊。此缺点虽不明显,但影响艺术表现。> 基于标准2的得分:【0.8】 **综合得分计算:* 计算过程:(标准1得分 + 标准2得分) / 2 = 平均分 综合得分:【0.90】 -----评价结束----- 第三轮评价: -----评价开始----- **初步质量定性 (0.0-1.0分档):** 优秀(0.8-1.0档) **基础要求检查:** 满足基本要求,无明显违背提示词逻辑或常识。 1. **标准1 <主体匹配> 的评价:** 添加的对象为灰白色小鸟,符合提示描述的类别、种类及位置。即使存在轻微位置和比例偏差,仍与提示的指令要求大体一致。 基于标准1的得分:【1】 2. **标准2 <属性一致性> 的评价:** 添加小鸟的外观颜色、纹理、形态设计与指令要求相符,尺寸比例虽稍偏,但风格和呈现形式都较好地融入原图。背景未产生明显变动,整体协调性高。然而,由于比例以及位置细微调整可能进一步改善,此分数不完全提升至满分。 基于标准2的得分:【0.9】 **综合得分计算:** 计算过程:(标准1得分 + 标准2得分) / 2 = (1 + 0.9) / 2 = 0.95 综合得分:【0.95】 -----评价结束-----

# 人类一致性评估

# SuperCLUE 图像编辑中文竞技场排行榜

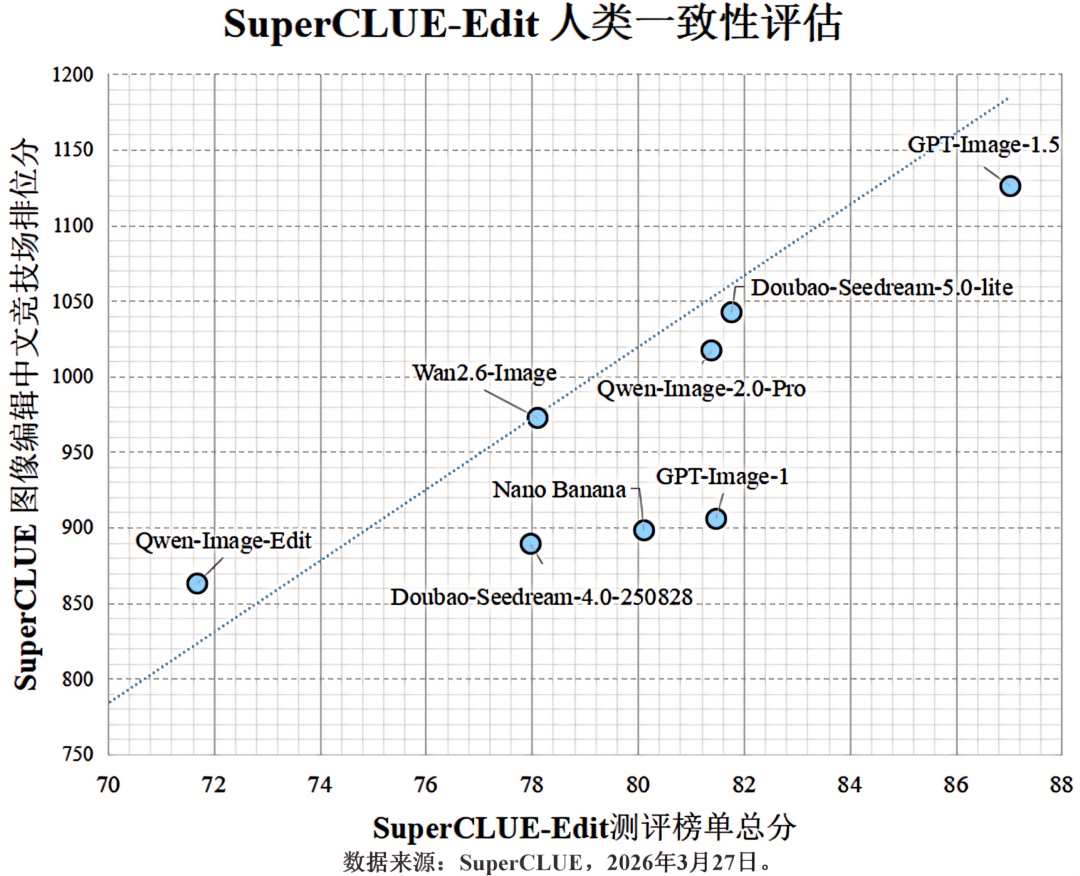

为验证测评体系的公信力,我们将SuperCLUE图像编辑中文竞技场排位分与本次SuperCLUE-Edit测评榜单总分进行交叉分析。结果显示,客观测评体系精准反映了真实用户的感官体验,具体统计指标如下:

皮尔逊(Pearson)相关系数: 0.8027,P值:2.9281e-03。表明测评分与排位分存在极强的正线性相关性,P值小于0.01说明相关性极其显著。

斯皮尔曼(Spearman)相关系数: 0.9273,P值:3.9442e-05。表明测评分与排位分的排名顺序几乎完全一致,榜单排位具有极高可信度。

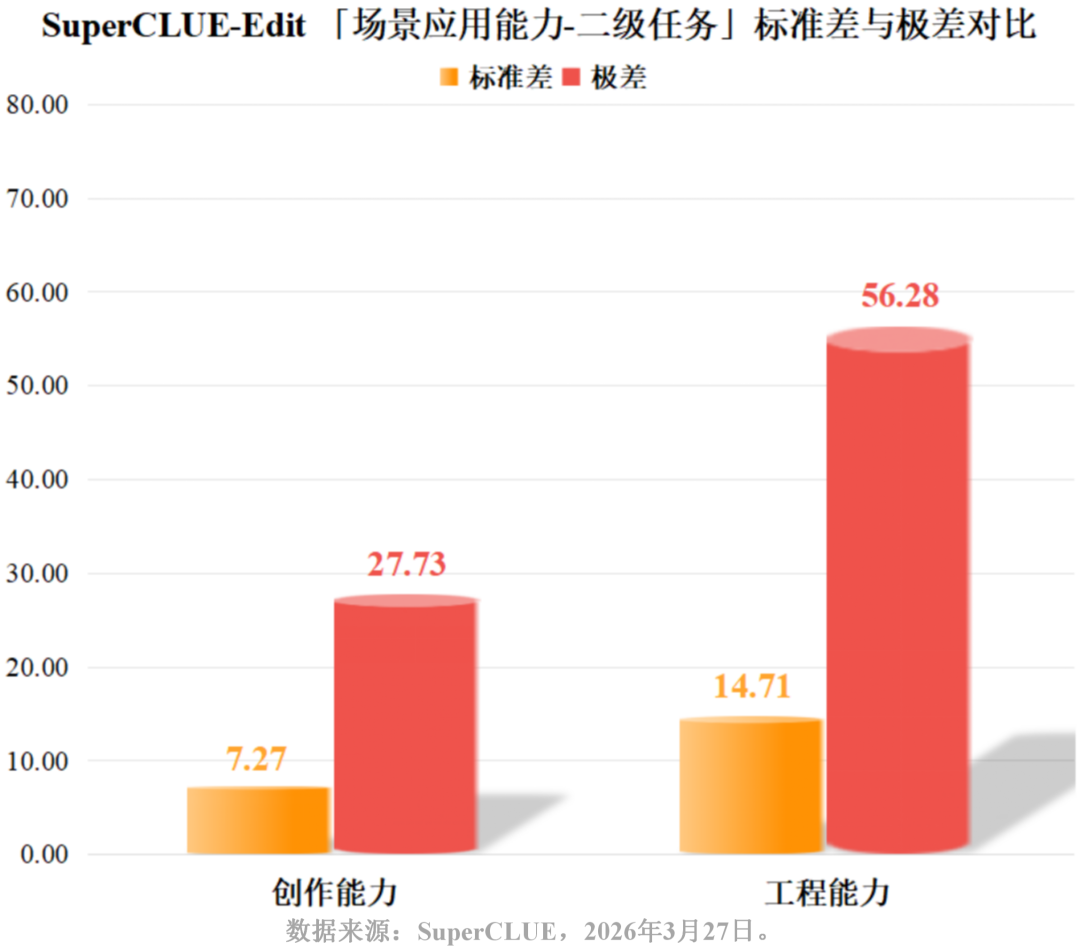

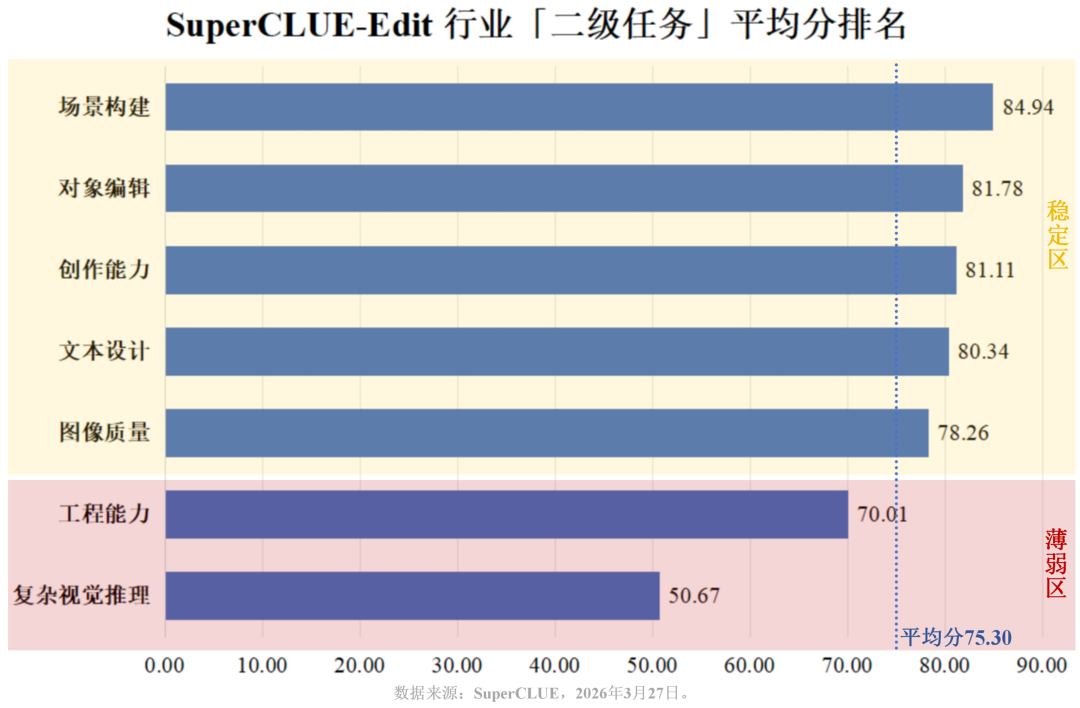

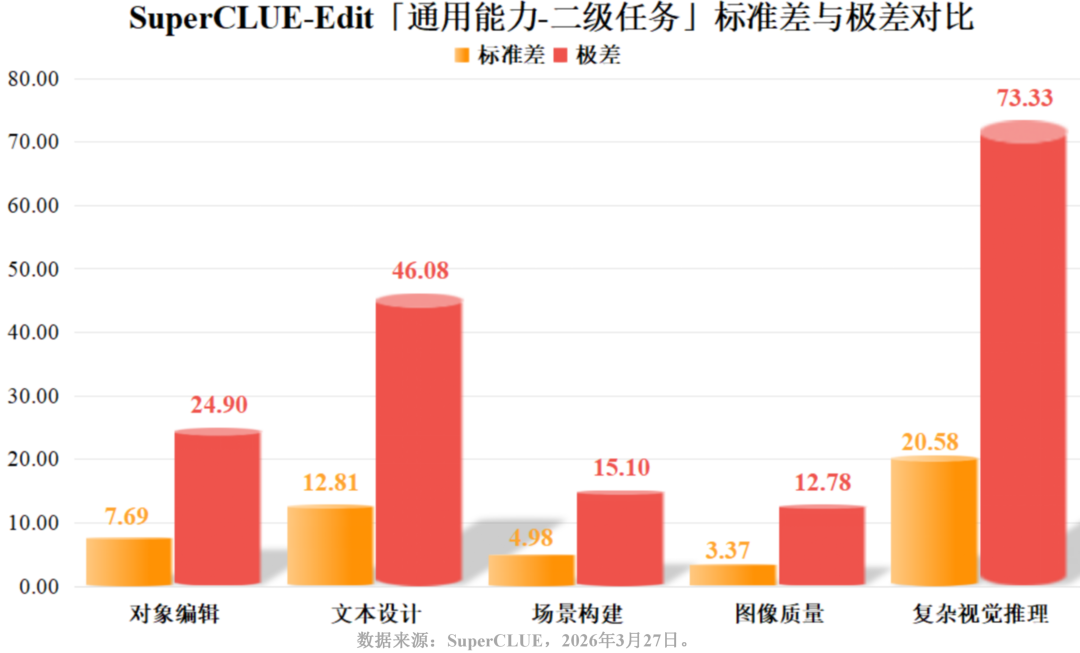

当前图像编辑模型的发展呈现出明显的“偏科”现象。从行业二级任务平均分排名来看,以视觉表现和基础操作为主的任务已经进入“稳定区”;但在深层的多模态语义对齐、严格约束以及逻辑推理上,不仅整体水平跌入“薄弱区”,且各模型之间的能力形成了极其明显的断层。

通用能力:场景与画质高度一致,复杂推理成最大鸿沟。

在基础的视觉呈现方面,行业表现高度成熟且一致。其中“图像质量”极差仅为 (12.78),标准差低至 (3.37);“场景构建”极差为 (15.10),标准差仅 (4.98),这说明绝大多数模型已经完全掌握了基础的图像重构与画质把控能力。

然而,在“文本设计”中,极差飙升至 (46.08),标准差达 (12.81),意味着部分尾部模型依然无法精准将文本融入图像编辑中;“复杂视觉推理”极差高达惊人的 (73.33),标准差达到 (20.58)。这暴露出当前行业现状:模型普遍擅长“把图做的好看”,但在面临需要多步逻辑计算、空间方位严格约束的复杂指令时,出现了严重的实力两极分化。

场景应用能力:创作审美趋同,工程落地能力差距悬殊。

在实际应用场景中,“创作能力”表现出较好的稳定性,极差为 (27.73),标准差为 (7.27)。表明在发散性思维和艺术风格化处理上,模型都具备了较高的审美。

“工程能力”极差拉大至 (56.28),标准差达到 (14.71)。现象表明,当应用场景从“主观创作”转向需要满足商业交付、严格尺寸/元素控制的时候,存在许多缺乏深度优化的模型缺陷。