阿尔法被投企业诺亦腾机器人、智象未来达成战略合作,共创具身智能数据新范式|AlphaFamily

阿尔法公社创始合伙人许四清:我们谋划并天使投资了梅涛和戴若犁两位科大杰出校友的创业项目,此次合作,两个团队巧妙地用科学方法解决高精度数据规模化的问题,在保持毫米级精度和高效率的前提下提供超大规模具身智能数据。师兄弟携手合作,是科学能力和效率的倍增器。

近日,阿尔法公社首轮投资的两家企业智象未来(HiDream.ai)与诺亦腾机器人(Noitom Robotics)正式达成战略合作。双方将围绕具身智能训练数据的核心瓶颈问题展开深度合作,通过“真实采集与生成模型协同”的方式,开启拓宽具身智能行业数据入口的全新模式探索。

智象未来与诺亦腾机器人正式达成战略合作

不同于大语言模型可以低成本获取海量文本数据,具身智能需要融合视觉、动作、触觉等多模态信息,数据结构复杂,获取成本高。随着具身智能产业爆发,训练数据正从小体量演示转向大体量、可规模化交付的需求,数据的获取、结构化与工程化能力,正决定系统上限。

在具身智能数据采集过程中有两组矛盾始终存在。一方面,真实数据的采集成本与模型所需的视觉泛化能力之间存在固有矛盾。标准化的环境能够显著提升采集效率,降低单位数据成本。但想要提升模型的视觉泛化能力,则需要多样化环境、多样化物体分布,覆盖复杂真实世界,以应对环境中的各种不确定性。

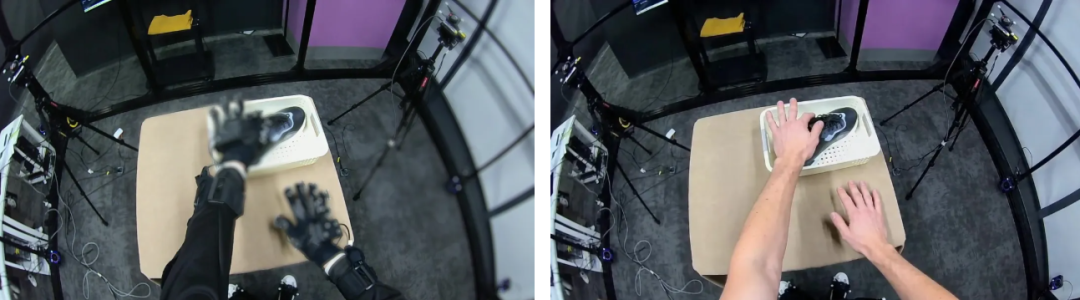

另一方面,在高精度、多模态数据采集的过程中,各类光学、惯性动作捕捉系统以及触觉采集装置的穿戴将会对人体形态、遮挡关系和整体视觉分布产生干扰,形成明显的“Vision Gap”。如果对采集到的图像进行后期修复,虽然可以对局部区域进行填补,但效果通常差强人意,难以满足具身智能模型训练的数据质量要求。

而通过引入AI视频生成以及视觉/世界模型,将有望解决以上这两组矛盾,为具身智能训练数据生产带来新的突破。

基于这一判断,智象未来(HiDream.ai)与诺亦腾机器人(Noitom Robotics)强强联合,将“多模态大模型的毫米级可控视频生成能力”与“以人为中心(Human-centric)的多模态数据生产基础能力”相结合,探索真实采集数据的模型增广、扩容与泛化。

双方将共同探索用算法与模型缩小Vision Gap,预测更多的执行路径,以及围绕真正具有空间精度意义的世界模型进行深入研究。经过双方大量的协同试验表明,智象未来(HiDream.ai)优秀的生成式模型在Vision Gap的生成式去除方面表现极为优秀,可以达到模型训练的精度与合理性需求。

左:诺亦腾机器人数据采集原始场景 右:智象未来生成式模型生成式处理效果

双方公司多项深度技术合作之一,利用视频生成技术去除数据中的vision gap及视觉干扰项。

此次战略合作将把双方在数据采集和模型训练方面的强项发挥到极致,预计双方年内合作生成的具身智能视频数据将达到数万小时以上,这将开辟出可规模化供应行业亟需的高质量具身训练数据的全新路径。

仪式现场,智象未来创始人兼首席执行官梅涛、诺亦腾机器人创始人兼首席执行官戴若犁等共同出席,见证了这一重要时刻。

智象未来:用毫米级高可控视频大模型,打开具身智能数据入口

作为全球领先的多模态生成式人工智能企业,智象未来专注底层架构的持续创新,在生成质量、语义理解与艺术表现力上不断突破边界,定义行业新标杆。在本次合作中,智象未来充分发挥其领先的高可控视频生成技术,将利用高精度动作捕捉设备采集的原始传感数据进行了百倍以上的精细化放大。这一过程并非简单的素材堆砌,而是通过可控视频生成技术将精准的动作指令与极其丰富的视觉场景深度融合,它不仅赋予了具身智能训练数据在场景、光影变化及人体形态肤色上的超高复杂度,更确保了生成的每一帧视频与底层操作数据之间的精准配对。

智象未来联合创始人兼CTO姚霆博士表示:“普通的通用视频生成模型通常是为了好看,容易产生幻觉或物理不一致。为了让生成的视频数据能够达到具身智能产业需求的物理一致性,我们基于智象自研的多模态大模型,对传感动捕设备采集的数据进行了高可控性的生成式优化,使之更加符合具身智能企业进行高精度训练的要求。这种‘数据炼金术’打破了传统动捕数据的局限,为具身智能的进化提供了取之不尽的高质量“燃料”。

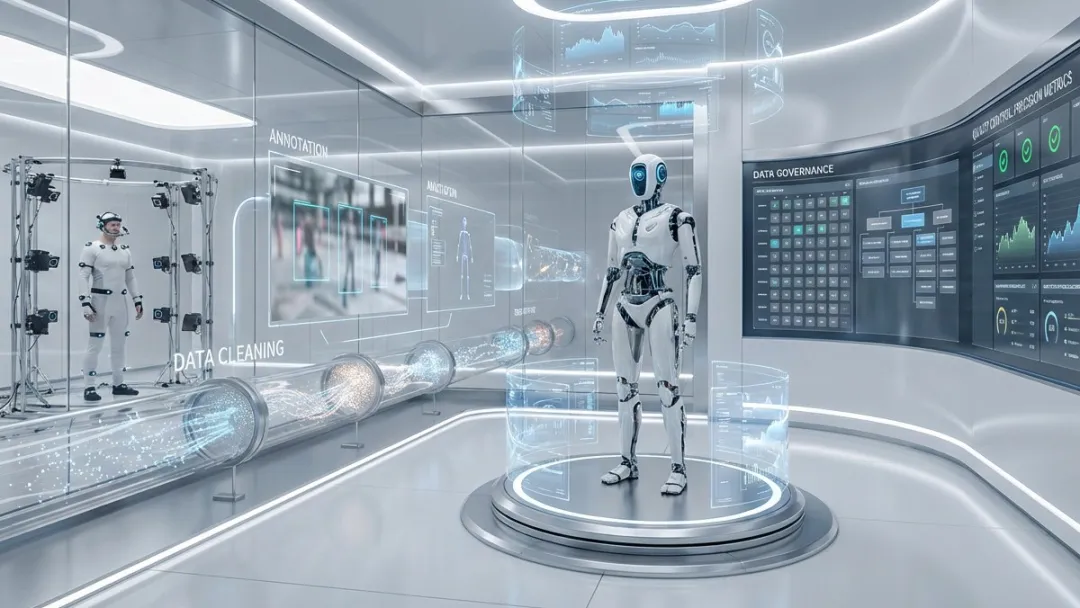

高质量、多模态的训练数据正在成为推动具身智能行业进步的关键基础要素

诺亦腾机器人:构筑具身智能数据底座

诺亦腾机器人面向具身智能与人形机器人产业,以“数据”为核心交付界面,基于高精度人体动作捕捉与多模态数据采集能力,为机器人企业、具身智能模型团队等提供高质量、可规模化的训练数据与相关基础设施能力。

随着具身智能产业加速发展,高质量、多模态的训练数据正在成为推动行业进步的关键基础要素。基于对具身智能发展路径与数据瓶颈的判断,公司从数据基础设施这一底层环节切入,专注于构建面向产业的技术与平台能力,推动具身智能从“数据获取”走向“数据工程化与体系化”。

诺亦腾机器人联合创始人、首席科学家韩磊博士表示:“具身智能的发展,本质上是一个以数据为核心驱动的系统工程。单一来源的数据难以支撑模型在复杂物理世界中的泛化能力。我们希望通过与智象未来的合作,将真实世界中高精度采集的Human-centric数据,与可规模化生成的多样化视频数据相结合,构建兼具真实性与多样性的训练数据体系。这将有助于突破当前数据规模与质量之间的瓶颈,加速具身智能模型从“可用”走向“好用”。

未来,双方将进一步围绕高质量数据构建、VLA模型规模化演进,以及视频建模与动作预测协同驱动的世界模型等方面展开深入合作。

智象未来将发挥多模态大模型的零样本生成优势,携手诺亦腾机器人对高精度多模态Human-centric数据进行规模化扩展与视觉精细度增强;诺亦腾机器人将利用其高精度动作捕捉与多模态数据基础设施,为模型提供真实精准的物理反馈数据。

双方将共同构建从生成到物理验证的数据闭环,加速推动具身智能走向真实世界应用。

✦

✦