17,871 个思维块的证词:Claude Code 质量暴跌背后,Anthropic 对"思考"动了什么刀

导言

2026 年 4 月 6 日,一个 GitHub Issue 引爆了整个 AI 开发者社区。

Issue #42796,标题是「Claude Code is unusable for complex engineering tasks with Feb updates」。作者不是在抱怨——他是在举证。

17,871 个 thinking blocks。234,760 次工具调用。6,852 个会话文件。横跨四个大型工程项目,时间从 1 月 30 日覆盖到 4 月 1 日。

这不是一篇吐槽帖,这是一份数据驱动的取证报告。

它指向一个结论:Anthropic 在 2 月悄悄对 Claude 的"思考能力"动了刀,导致复杂工程任务的质量出现了系统性崩塌。 而他们没有告诉任何人。

这篇文章会回答三个问题:

1. 技术上发生了什么? Thinking Redaction 是什么机制,它如何影响模型行为?

2. 商业上为什么? Anthropic 为什么要在自己的王牌产品上动刀?

3. 对我们意味着什么? 作为 AI 的使用者和构建者,该如何应对?

第一章:草稿纸上的秘密

什么是 Extended Thinking?

要理解这次事件,先要理解 Claude 是怎么"想"的。

从 Claude 3.7 Sonnet 开始,Anthropic 引入了一个叫 Extended Thinking(扩展思维)的能力。简单说:在给出最终回答之前,模型会先在内部进行一轮详细的推理——逐步分析问题、制定计划、检查边界条件、验证逻辑。

这段推理过程以 thinking blocks 的形式存在,就像一个人做数学题时在草稿纸上的演算过程。

一个真实的例子:

当你让 Claude Code 修改一个复杂项目中的某个函数时,它的 thinking 过程可能是这样的:

"用户要求修改 auth 模块的 token 刷新逻辑。让我先看看当前的实现…这个函数被 3 个地方调用了…其中 admin 路由有特殊的 refresh 间隔…如果我改了默认值,会影响 admin 的行为…我应该先读取 admin 的配置文件确认…另外还要检查测试覆盖情况…"

这个过程至关重要。没有它,模型就是在"不看题就答卷"。

API 层面的机制

在技术实现上,Extended Thinking 通过 API 的 budget_tokens 参数控制:

- 调用方设定一个 thinking 预算(最低 1,024 tokens)

- 模型在预算范围内产出 thinking blocks

- 思考完成后,模型基于推理结果给出最终回答

- Thinking tokens 按照 output token 的价格计费

以 Opus 4.6 为例:output token 定价 $75/百万 tokens。一个复杂工程 session 可能产出 5 万到 15 万个 thinking tokens——也就是说,光是"让模型想一想",一个 session 就要花 $3.75 到 $11.25。

这是一笔不小的开支。但它是 Claude 之所以"聪明"的核心——你为模型的推理能力付费,它用深度思考回报你质量。

从"透明"到"黑箱"

在 Claude 3.7 Sonnet 时代,thinking 内容是完整返回给调用方的。你能看到模型想了什么,走了什么弯路,最终怎么做的决定。这种透明性对于调试和信任建设都极其重要。

到了 Claude 4 系列,Anthropic 做了一个重大改变——Thinking Redaction。

具体来说,thinking 的展示方式变成了三种:

1. "summarized"(默认):只返回 thinking 的摘要,不给完整推理过程

2. "omitted":thinking 内容完全不返回,只返回一个 signature 字段

3. 完整模式:只有联系 Anthropic 销售团队才能获得

那个 signature 字段是什么?它是完整 thinking 内容的加密版本,用于多轮对话中传递上下文。服务器可以解密它来恢复完整思维链,但你作为用户看不到里面写了什么。

Anthropic 官方的说法是:这样做是为了减少延迟——不用传输大量 thinking 文本,first-token 到达更快。

听起来很合理。

但有一个问题:你仍然在为全量 thinking tokens 付费。

换句话说:你花钱让模型思考,Anthropic 拿走了你的草稿纸,只告诉你"答案在这里"。至于它到底想了多少,想得好不好——你无从验证。

这就是 Thinking Redaction 的本质:一次信息不对称的制造。

第二章:数据说话

取证者的工具箱

Issue #42796 的作者是一个重度 Claude Code 用户,跑着四个大型编译器/GPU 相关项目(iree-loom、iree-amdgpu、iree-remoting、bureau)。这不是普通的 web 开发——这是底层系统级工程,对代码质量和逻辑严谨性要求极高。

他的数据来源:

注意那个 0.971 的 Pearson 相关性——这意味着 signature 字段的长度几乎完美地反映了原始 thinking 内容的长度。即使 thinking 被 redact 了,通过 signature 仍然可以高精度估算"模型实际思考了多少"。

这是整个分析的基石。作者正是用 signature 长度作为代理变量,绘制出了 thinking 深度的变化曲线。

第一根烟枪:时间线吻合

以下是 thinking redaction 在 Claude Code 中的灰度发布时间线:

从 1.5% 到 100%,整个灰度发布在一周内完成。这是一个典型的分阶段 rollout。

关键事实:用户独立报告质量回归的日期是 3 月 8 日——恰好是 redacted thinking 超过 50% 的当天。

没有人提前知道 Anthropic 在做什么。报告质量问题的人和分析 thinking blocks 的人是不同的人。但他们指向了同一个时间点。

这是相关性,不是因果性。但当你把它和后面的数据放在一起——

第二根烟枪:思考在缩水

如果 Thinking Redaction 只是"把推理过程藏起来但推理量不变",那对质量应该没有影响。

但数据告诉我们的不是这样。

通过 signature 长度估算的 thinking 深度变化:

| -67% | ||

| -73% |

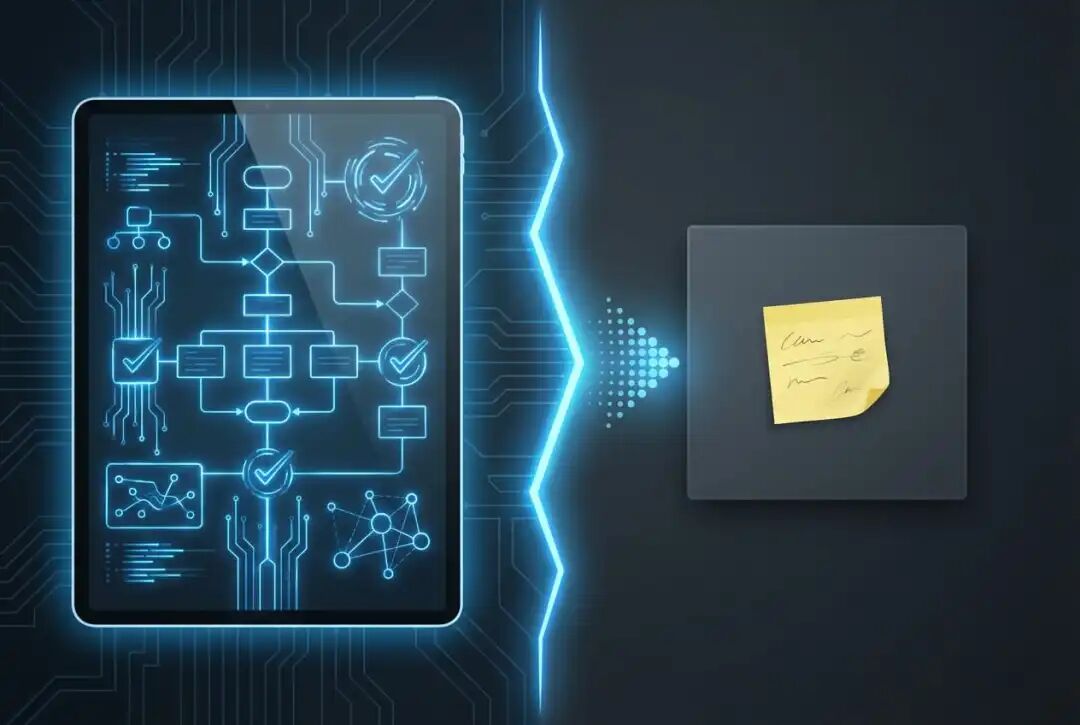

从 2,200 字符到 600 字符。模型的"草稿纸"从 A4 纸被缩成了便签纸。

这意味着:Anthropic 不仅是把 thinking 的内容对用户隐藏了,而是在实际上大幅缩减了模型的思考量。

Redaction 的作用不仅是遮蔽——它更像是一面幕布,挡住了观众的视线,同时允许舞台上的表演被偷偷削减。因为你看不到了,你就无法判断它"想"得够不够。

第三根烟枪:行为崩塌

Thinking 的缩减不是一个抽象的"模型变笨了"——它导致了一系列可量化的行为退化。

这是最直观的指标。之前的 Claude 像一个经验丰富的工程师——先充分理解代码库,再下手修改。现在它变成了一个着急完成 ticket 的实习生——扫两眼就开始改。

编辑从未读取过的文件的比例:6.2% → 33.7%。

三分之一的编辑,是对模型从来没看过的文件做的。

HN 上多位开发者验证了这个现象:

"I've seen it try and edit files before even reading them on a couple of occasions, which is a big red flag."

>

"What I've noticed is that whenever Claude says something like 'the simplest fix is...' it's usually suggesting some horrible hack."

从 0 次到 17 天内 173 次。具体表现包括:

- 逃避责任:"This is getting complex, maybe you should try..."——把问题推回给用户

- 过早停止:任务还没做完就宣布 done

- 反复请求权限:之前不需要确认的操作现在也要问你

- 策略性模糊:"I've made the necessary changes"——但实际上只改了一部分

这些行为在基准期完全不存在。它们全部集中出现在 redaction 之后。

用户报告:之前 Claude 会自动判断需要加载哪个 skill 文件——现在你必须在指令中明确指名,否则它不加载。

一个 HN 用户的描述精确到令人心酸:

"I've been fighting this by being super explicit in CLAUDE.md. My CLAUDE.md files have been exploding since mid-March."

CLAUDE.md 是用户给 Claude Code 的行为指南。这些文件在膨胀——因为用户不得不把越来越多原本"不言自明"的规则写成明文,来弥补模型推理能力的下降。

第三章:时间的裂缝

数据里有一个更令人不安的发现,值得单独讨论。

Redaction 前:时间无关紧要

在 thinking 充足的时期(1-2 月),不管你什么时间使用 Claude,thinking 深度都是稳定的——凌晨、上午、下午、深夜,没有显著差异。

这说明当 Anthropic 大方分配 thinking 预算时,模型的思考质量是一致的。你不需要择时使用。

Redaction 后:时间决定质量

而在 redaction 之后,thinking 深度出现了剧烈的时段波动:

- 深夜(美西凌晨):相对较好

- 下午 5 点和 7 点 PST:最差

注意,5-7pm PST 不是工作时间高峰,而是美国互联网流量高峰。

作者的推断是:thinking 分配从固定预算变成了负载敏感的动态分配——当 GPU 紧张时,thinking 被进一步压缩。

这一推断如果成立,意味着一个更严峻的事实:你获得的 AI "智力",取决于同一时刻有多少人在用它。

这像极了航空公司的做法——经济舱的座位越卖越窄,但机票价格没降。在 AI 的语境里,你花同样的钱,但在高峰时段,模型用更少的资源"想"你的问题。

用作者的话说:

"Pre-redaction 的平稳才是更重要的发现:当 thinking 被慷慨分配时,时间不重要。现在时间重要了,说明资源在被抢。"

第四章:为什么要砍自己的王牌?

这是最核心的问题。Claude Code 是 Anthropic 最成功的产品——两周内就把年化收入 run rate 翻了一倍(据 Forbes 报道,2 月 ARR 增加了 $2 亿),到 4 月 ARR 已经达到 $70 亿。

经济学解释:无限自助餐的困境

Claude Code 的订阅模式是固定费用(Pro $20/月,Max $100-200/月),但推理成本是变动的。

来看一笔账:

Claude Code 官方数据:平均每个开发者每天花费 $6,90% 的用户日花费在 $12 以下。按月算,平均 $100-200/开发者。

但这是平均值。重度用户呢?

一位 HN 用户透露了他的 7 天用量:

claude-opus-4-6: 11,000 completions, 16,900,000 read tokens, 5,840,000 write tokens, 1,312,000,000 cached_read tokens, 66,120,000 cache_write tokens

即使算上 prompt caching(缓存读取只需 1/10 价格),这样的用户每月实际消耗的 GPU 资源远超 $200 的订阅费。

而 thinking tokens 是最贵的部分——它们是 output tokens,在 Opus 4.6 上每百万 $75。一个深度思考的 session 产生的 thinking tokens 可能比最终回答还多。

从 Anthropic 的角度:砍掉 thinking 深度 73%,几乎等于把最贵的成本项砍了 3/4。

基础设施的真实成本

从 GPU 底层来算。以 H200 为例:

- 8 卡 H200 的推理成本:$25.12/小时

- Output token 生成速度:~993 tokens/秒

- 每百万 output token 的真实成本:约 $7

而 Anthropic 的 API 定价是 $75/百万——加价约 10 倍。这个利润空间看起来很大,但别忘了,它要覆盖训练成本、研发费用、固定设施、员工薪资、以及——无限订阅用户的"超额消费"。

WSJ 报道,Anthropic 预计 2026 年现金烧蚀率降到收入的三分之一。这意味着他们正处在从"烧钱增长"到"靠近盈利"的关键转折期。

时间线上的成本控制链

把所有事件串起来:

第五章:黑箱里的算盘

不透明的降质

这件事最让人不安的地方,不是质量下降了——而是下降的方式。

如果 Anthropic 公开说:"我们调整了 thinking budget 的默认分配策略,可能影响复杂任务的表现,建议使用 /effort max 或手动增加 budget"——大多数开发者会理解,甚至会感谢这种透明。

但他们选择了:

1. 在用户看不到 thinking 内容的前提下,悄悄缩减思考量

2. 没有发布任何公告或 changelog

3. 依靠 redaction 作为遮蔽,确保用户无法量化变化

4. 直到数据取证暴露后才面对

这不是"优化",这是信息不对称下的偷工减料。

行业先例:这不是第一次

AI 公司悄悄降质有前科。

OpenAI 在 GPT-4 时代就被广泛质疑过"静默降质"。OpenAI 社区论坛上有大量这样的帖子:

"我知道大约 2 个月前这还是一个可以依赖的产品。今天,它在我依赖的方式上已经无法使用了。"

GPT-5 发布时,同样出现了"先惊艳后失望"的模式——OpenAI 最终不得不恢复 GPT-4o 作为可选模型,并公开承认发布"不够顺利"。Simon Willison 还发现 OpenAI 悄悄把手动选模型替换成了自动路由。

但 Anthropic 的情况更严重,因为 Claude 的核心卖点恰恰是"比 OpenAI 更安全、更透明、更值得信任"。当一家以"对齐"和"安全"为品牌核心的公司在产品质量上做不透明的调整时,冲击力远大于 OpenAI。

学术视角的验证

有趣的是,学术界刚好有相关研究验证了 thinking 缩减对质量的影响。

arXiv 上的论文《How Context Silently Shortens LLM Reasoning》发现:推理模型在非隔离上下文条件下会产生显著更少的推理 tokens(最多减少 2 倍),这种压缩与自我验证和不确定性管理行为的减少相关。 对于简单问题,这不影响准确率;但对于复杂问题,会导致性能下降。

这正是 Issue #42796 在工程实践中观察到的:简单任务照常,复杂任务崩溃。

第六章:Anthropic 的不可能三角

让我们退后一步,看更大的图景。

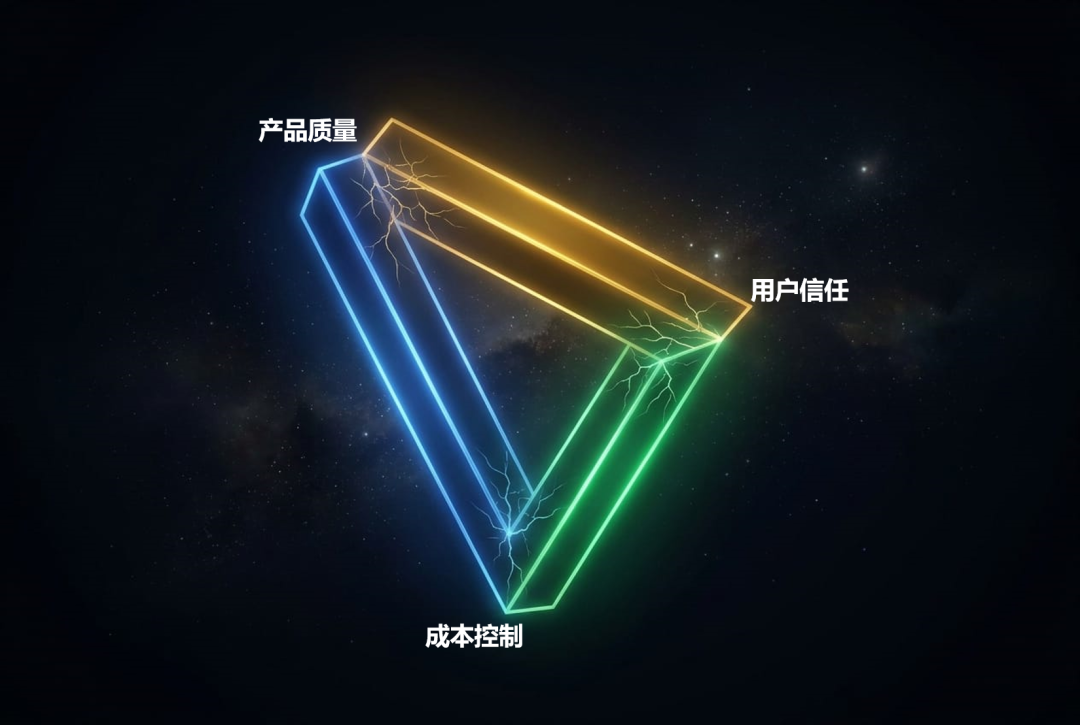

Anthropic 面对的是一个经典的三角困境:

- 产品质量需要大量 thinking tokens → 推高成本

- 成本控制需要削减 thinking → 降低质量

- 用户信任需要透明沟通 → 但公开说"我们削减了推理"会动摇信任

他们选择了悄悄动刀,试图在用户不知情的情况下同时降成本和维持表面质量。但数据取证打破了这个平衡。

资本市场的压力

这个困境放在 Anthropic 的融资进程中更好理解。

公司正在准备 IPO。WSJ 报道它"比 OpenAI 更快接近盈利"。在这个关键窗口期:

- 收入要持续增长(不能限制太多用户)

- 利润率要改善(成本必须控制)

- 品牌要维护(不能公开承认削减质量)

同一周发生的事说明了这种张力:

- 周一:Anthropic 宣布与 Google/Broadcom 签 3.5GW 算力扩张协议——大规模投资基础设施

- 周日:Issue #42796 曝光他们在用户端缩减推理预算

一边花几十亿买 GPU,一边在每个 session 里省 thinking tokens。这不矛盾吗?

不矛盾。因为新增的算力是给明天准备的(训练下一代模型、扩大用户规模),而 thinking 的缩减是解决今天的成本问题。 但对于今天的用户来说,体验就是在变差。

第七章:对我们意味着什么

如果你是 Claude Code 用户

1. 使用 /effort max:显式要求最高推理等级

2. 增加 MAX_THINKING_TOKENS:默认值可能被调低了,手动设高一点

3. CLAUDE.md 必须更严格:之前"不言自明"的规则现在必须写明,特别是"先读后改"类的规范

4. 避开高峰时段:如果数据推断成立,美西下午 5-7 点质量最差

5. 保留 session 日志:万一需要向 Anthropic 报告问题,数据是最好的武器

如果你是企业 AI 决策者

这件事揭示了供应商锁定的新型风险——不是 API 变了调不通,而是同一个 API 端点后面的"智力"在静默缩水。

建议:

1. 建立模型质量基准测试:不要只测能不能跑,要测"相同任务的完成质量是否随时间变化"

2. 多供应商策略:不要把全部推理负载放在一家提供商上

3. 合同中约定 SLA 的质量维度:不只是可用性和延迟,还要包括推理质量的可量化指标

4. 监控 thinking/signature 指标:如果你用 API 调用 Claude,定期记录 signature 长度和 thinking 深度的趋势

如果你是 AI 行业观察者

这是一个标志性事件。它标志着 AI 行业从"模型能力竞赛"进入了"模型经济学竞赛"。

当训练成本已经达到数十亿美元量级,当推理成本决定了产品能否盈利,当每一个 thinking token 都有真金白银的价格——"AI 有多聪明"不再只是一个技术问题,而是一个经济问题。

Claude 的思考深度不是由它的参数量决定的——而是由 Anthropic 的利润表决定的。

尾声:当信任被 Redact

故事的最讽刺之处在于品牌叙事的反转。

Anthropic 的品牌核心是"安全"和"对齐"——它存在的意义就是"比其他 AI 公司更负责任"。Constitutional AI、AI Safety 研究、对人类价值观的对齐——这些是它的基因。

但 Thinking Redaction 揭示了一个信任悖论:

这不是要否定 Anthropic 的技术成就。Claude Opus 4.6 在被削减后仍然是最好的编码模型之一。但"最好"和"跟上个月一样好"是两回事。用户买的是后者的承诺。

Issue #42796 的作者在最后写了一段话:

"这份报告的目标不是攻击,而是提供数据帮助 Anthropic 理解哪些工作流受影响最大,以及为什么——希望能为思考 token 分配决策提供参考。"

17,871 个思维块的证词,不是控诉书,而是一面镜子。

镜子里映出的不仅是一个产品的质量曲线,更是一个行业正在面对的根本张力:AI 的"智力"是一种有成本的商品,而成本优化和质量承诺之间的边界,远比我们想象的脆弱。

当你的 AI 下次说"the simplest fix is..."的时候——也许该想一想:这是它深思熟虑后的建议,还是因为它的草稿纸被偷偷换成了便签纸?

💠 用 Token 思考,让洞察涌现

关注「Token涌现」,不错过下一篇