图生视频4月中文测评榜单发布 | PixVerse V6引领发展,国产模型百花齐放!

2026年4月,中文原生图生视频模型测评基准(SuperCLUE-I2V)4月榜单正式发布。该基准立足于中文语境,延续过往基准设计2025年6月SuperCLUE-I2V测评基准,围绕运动流畅性、内容一致性、物理真实性、动漫风格、写实风格和奇幻风格六大任务构建评测体系。

本次测评完成体系升级,测评方式由人工评估转向自动化测评,有效提升评测效率、客观性与可复现性。评测涵盖国内外13个具有代表性的图生视频模型,对各模型综合生成能力开展全面深度评估,并同步进行人类一致性检查。以下为详细测评报告:

「过往文章介绍」

1.【2025年6月图生视频测评文章】图生视频6月中文测评榜单发布:6大任务,11款模型对决

国内头部模型生成(基础能力—运动流畅性)

图生视频测评摘要

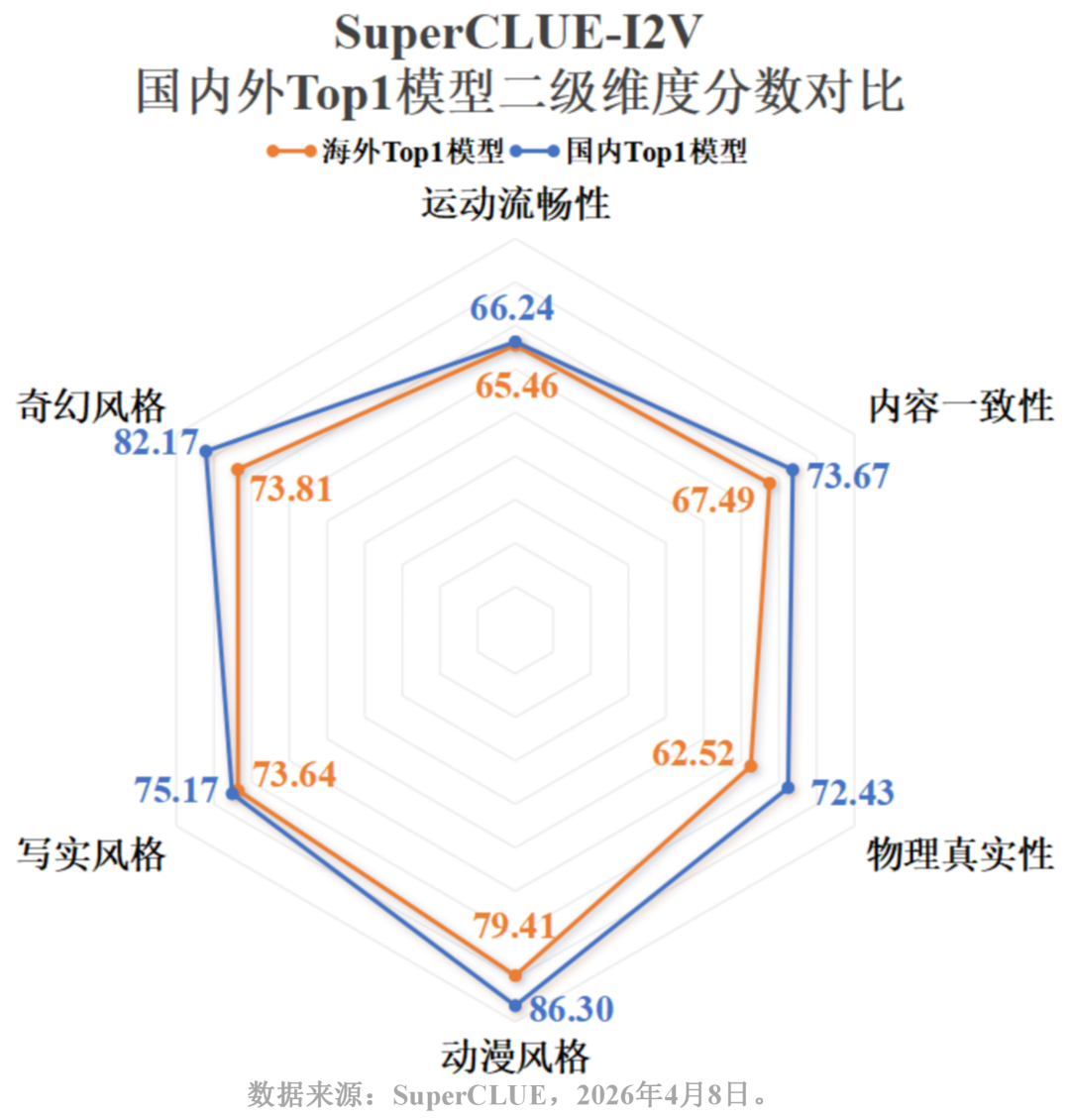

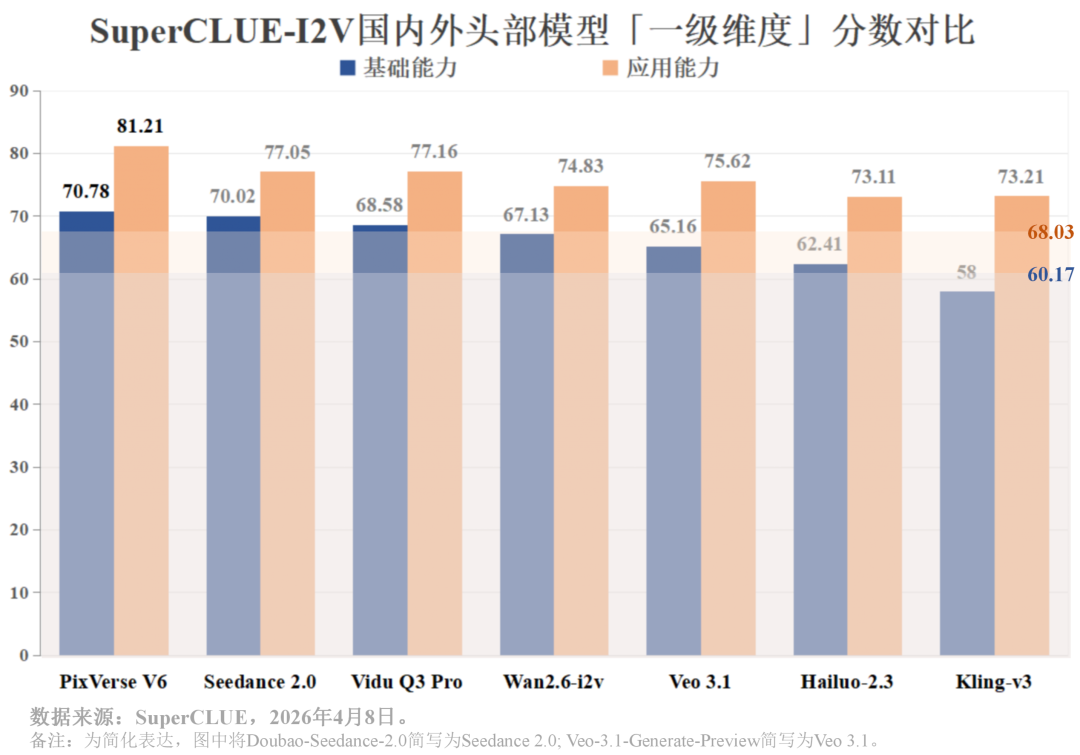

爱诗科技的PixVerse V6以76.00分强势登顶总榜;字节的Doubao-Seedance-2.0 (73.53分)与生数科技的Vidu Q3 Pro (72.87分)分数紧咬,国内模型包揽前三,展现出绝对的统治力。

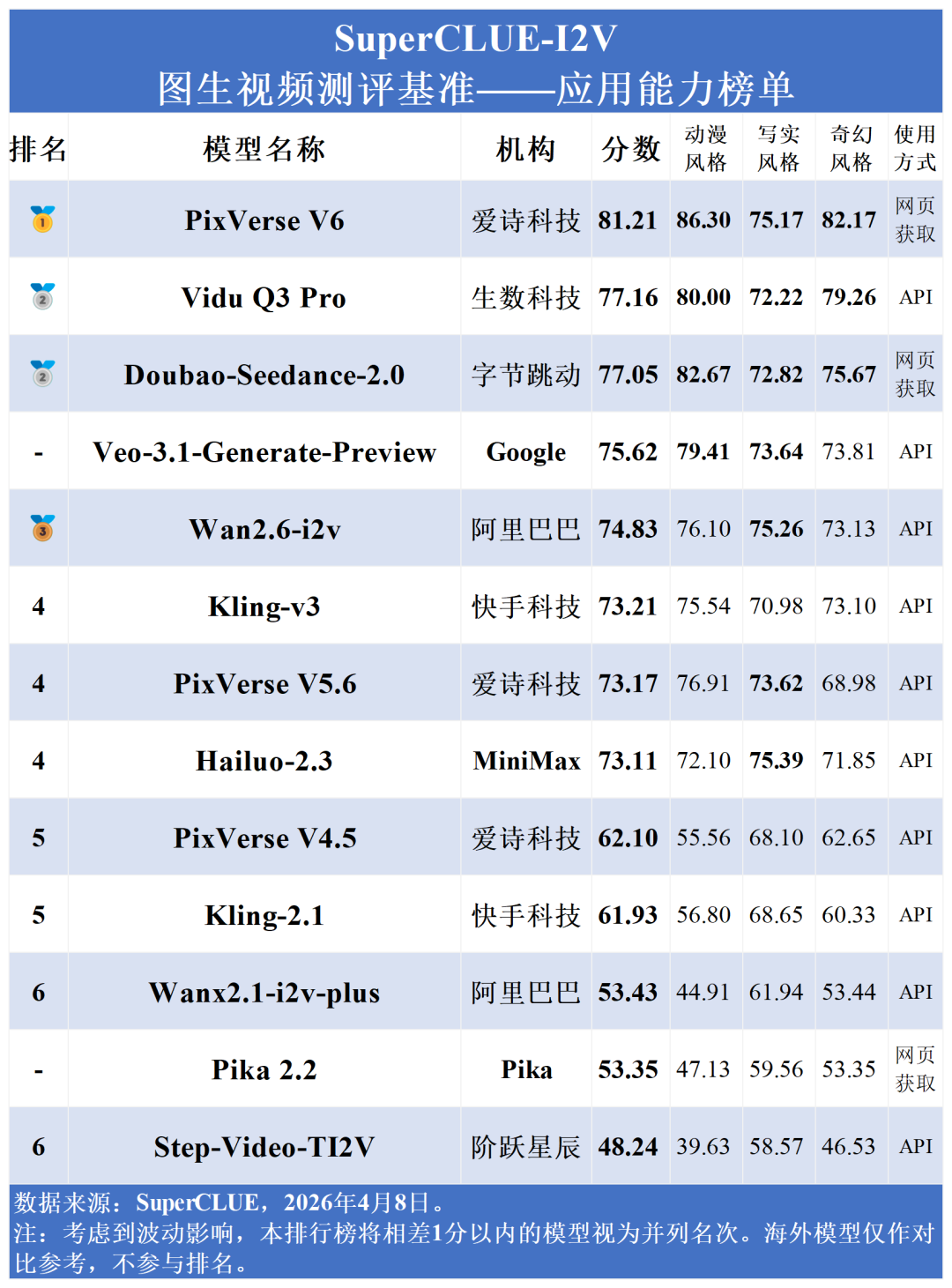

测评要点2:基础能力长板突出,应用风格各显优势。

在基础能力维度,Doubao-Seedance-2.0在内容一致性(80.78分)上表现出断层领先,PixVerse V6则在物理真实性(72.43分)上确立优势;在应用能力维度,PixVerse V6凭借在动漫风格(86.30分)和奇幻风格(82.17分)的极强统治力,占据应用榜首;而在写实风格中,Hailuo-2.3以(75.39分)逆势夺冠。

无论是在基础维度的内容一致性,还是在应用维度的各类风格渲染上,国内头部模型已经能够全面平视甚至超越海外头部模型,展现出引领行业标准的强劲态势。

# 榜单概览

# SuperCLUE 图生视频中文竞技场排行榜

本竞技场是一个大众投票的匿名评测平台,榜单汇聚最新投票数据,定期更新排名。诚邀您参与评测,在原生中文语境下用实际体验为模型能力提供真实反馈,共同完善视频生成模型的评估标准。

访问地址:https://www.superclueai.com

#SuperCLUE-I2V介绍

SuperCLUE-I2V 是一个专为图生视频产品设计的评测基准,旨在为图生视频领域提供全面且多维的能力评估参考。

秉持创新、紧跟前沿、客观和全面的原则,测评基准围绕六大任务展开评测。

1. 运动流畅性:评估视频中所有运动过程的平滑度与自然感。重点考察主体(如人物、动物)的动作衔接是否连贯,是否存在肢体僵硬、抽搐或不自然的形变;同时关注物体位移、背景流动以及镜头运镜(推拉摇移)的稳定性,整体动态效果需符合生理视觉的流畅预期。

2. 内容一致性:评估视频在时间维度上核心要素的稳定性。要求主体的特征、服装配饰及身体比例在不同帧之间保持统一;同时考察场景环境的一致性,确保视频在播放过程中建立起逻辑自洽、连续不中断的视觉叙事。

3. 物理真实性:评估视频中运动与交互是否遵循基本的物理学规律。重点观察重力表现(如坠落速度)、惯性(如急停或转弯)、物体间的碰撞反馈及流体动力学(如水流、烟雾)是否符合现实逻辑。

1. 动漫风格:评估视频对二次元艺术特征的还原程度。考察人物设计是否符合动漫审美,场景是否具有手绘感或风格化处理,以及特效是否契合动漫作品的视觉表现力与艺术张力。

2. 写实风格:评估视频对现实世界细节的模拟精度。考察材质纹理的细腻程度、摄像机光学特性的还原,画面色彩自然、影调真实,主体与环境融合度高。

3. 奇幻风格:评估视频在构建非现实、想象力场景时的视觉表现力。考察奇幻元素的设计创意与独特性,以及奇幻场景的视觉呈现。

对比上期人工测评,主观评分一致性有限、难以规模化复现。因此,本次 SuperCLUE-I2V 采用自动化测评,使用 Gemini-3-Flash-Preview 作为裁判模型。该评估流程分为以下几个步骤:

1)测评集构建

我们结合具体场景与考察方向针对评估维度撰写生成视频的提示词(prompt),为了更好地检验视频生成大模型的中文理解能力。

2)评分标准

裁判模型根据预先定义的评测流程进行评估。评测流程涵盖了评价流程的说明、评价标准、打分细则、以及数据格式要求,确保评分的一致性、稳定性与公正性。

3)自动化评价

裁判模型将根据具体的任务类型结合相关的评价标准进行自动化评分。此外,SuperCLUE-I2V将采用多轮测评方案,即针对同一个模型生成的全部视频均将采取相同的评价流程进行前后三次测评,并将三次结果的平均值作为每个视频的最终分数,参与后续计算与排名。

4)综合评分与反馈

最终,我们将各一级维度的平均分计算出来,结合各模型在不同场景中的得分,最终分数将反映出该模型在每个场景的综合性能。结果将以统一的输出格式提供,包括每个单独任务的详细评分与总体评价。

【测评维度】:应用能力—写实风格

【提示词】:男子目视前方,用双手整理着领口。

【裁判模型打分】:

第一轮评价

-----评价开始-----

**初步质量定性 (0.0-1.0分档):** 优秀/接近完美 (0.9-1.0档)

**基础要求检查:** 完全满足。视频主体与首帧图像高度一致,且精准完成了“目视前方”和“整理领口”的动作指令。

标准 1 <写实风格> 的评价:视频的写实感极强,皮肤质感、光影效果以及衬衫的褶皱动态都非常逼真。人物整理领口的动作逻辑通顺,双手没有出现常见的肢体崩坏或多余手指现象。唯一的扣分项在于背景细节在动态过程中的稳定性略欠,但作为核心评价的主体部分几乎完美。

基于标准 1 的得分:【0.94】

**综合得分计算:**

计算过程:(0.94) / 1 = 0.94

综合得分:【0.94】

-----评价结束-----

第二轮评价

-----评价开始-----

**初步质量定性 (0.0-1.0分档):** 优秀 (0.8-0.9分档)

**基础要求检查:** 完美满足“输入图像+文本指令”的基础要求。人物一致性高,动作完全符合描述。

标准 1 <写实风格> 的评价:视频在写实度上表现优秀。人物皮肤质感、卷发的蓬松程度以及衬衫的白色色调都得到了很好的还原,背景的虚化与光影也保持了自然。虽然在手部与衣物的动态交互上存在AI生成中常见的面料形变和纹理闪烁,但从宏观语义和动作连贯性来看,这仍然是一个高质量的生成结果。由于画面比例的改变和手部交互的轻微违和,未达到0.9以上的卓越水平。

基于标准 1 的得分:【0.82】

**综合得分计算:**

计算过程:(0.82) / 1 = 0.82

综合得分:【0.82】

-----评价结束-----

第三轮评价

-----评价开始-----

**初步质量定性 (0.0-1.0分档):** 优秀/卓越档 (0.9-1.0)

**基础要求检查:** 完全满足。视频首帧与输入图像特征高度一致,且完美执行了“双手整理领口”的动态指令,动作连贯且具有明确的逻辑性。

标准 1 <写实风格> 的评价:视频展现了极高的写实精度。人物的皮肤质感、卷发的蓬松度以及白色衬衫的棉质纹理均表现得非常自然。光影随着手臂的抬起和领口的折叠而发生实时变化,阴影过渡平滑。对比同类模型,其在处理“手部与细小物体交互”这一难点上表现极其出色,手指的关节点和运动轨迹符合物理规律。未达到1.0满分仅因为极细微的手指尖端闪烁。

基于标准 1 的得分:【0.96】

**综合得分计算:**

计算过程:0.96 / 1 = 0.96

综合得分:【0.96】

-----评价结束-----

【综合得分】:(0.94+0.82+0.96)/3≈0.91分

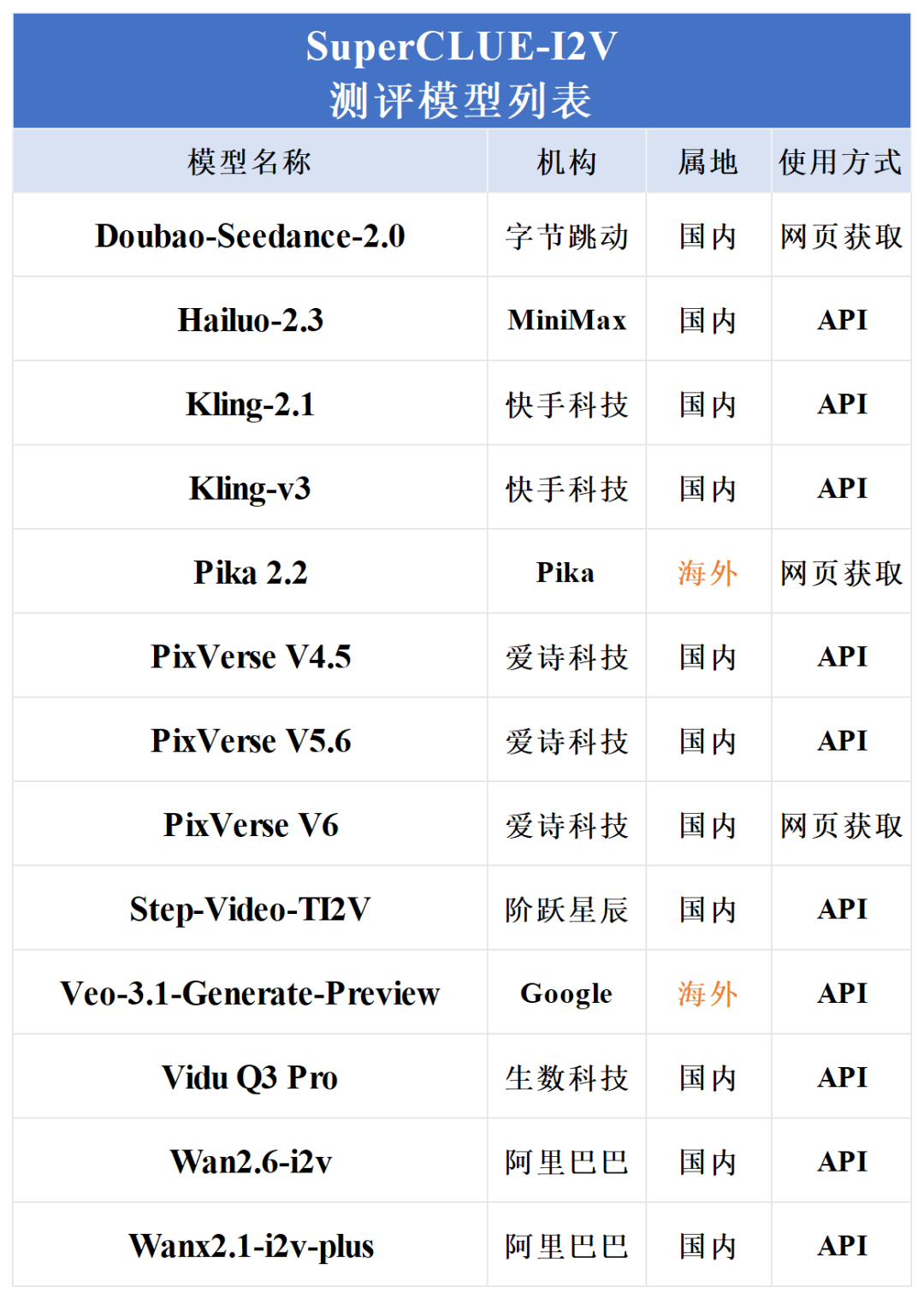

# 参评模型

为综合衡量国内外文生视频模型的发展水平,本次测评选取了代表性的2个海外模型和11个国内模型。

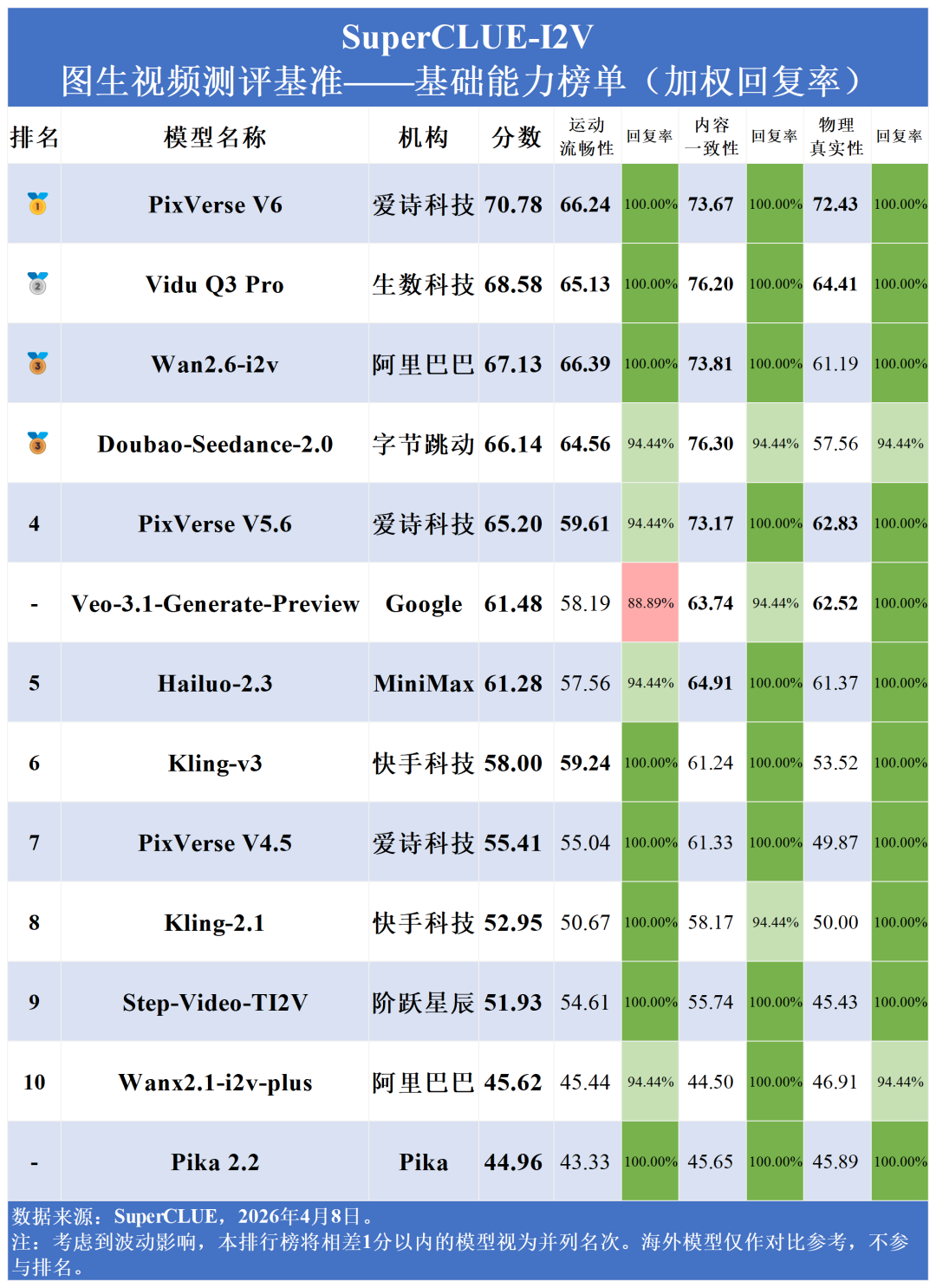

基础能力榜单

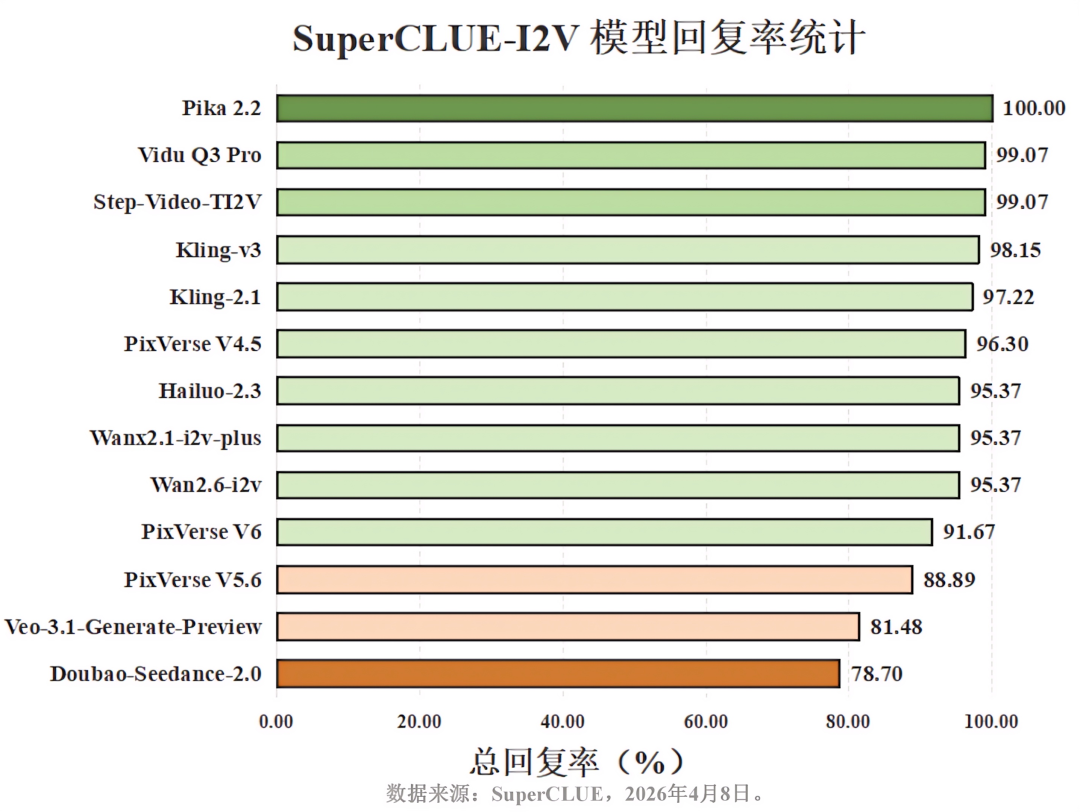

本次测评中,由于不同视频生成模型存在各自的规则约束与内容安全限制,模型有效回复率存在明显差异:

1. Doubao-Seedance-2.0 在动漫类、真人人像生成场景中,存在大部分内容不符合平台规范的情况;

2. Veo-3.1-Generate-Preview 也因内容风控与生成限制,在部分题材下出现生成失败或无法输出的问题;

3. 其余模型几乎均存在因平台内容限制问题,部分题目无法生成的情况。

因此,SuperCLUE-I2V 再次采用按回复率加权计分的方式,以同种测评方式获取模型加权回复率的榜单排名,提供相关参考。具体计分规则如下:

最终得分 = 原始得分 × 回答率,其中:

原始得分 模型在该维度下已答题目的平均分;

回答率 = N_answered / N_total;

N_total 表示该维度下的总题目数;

N_answered 表示模型成功生成视频的题目数。

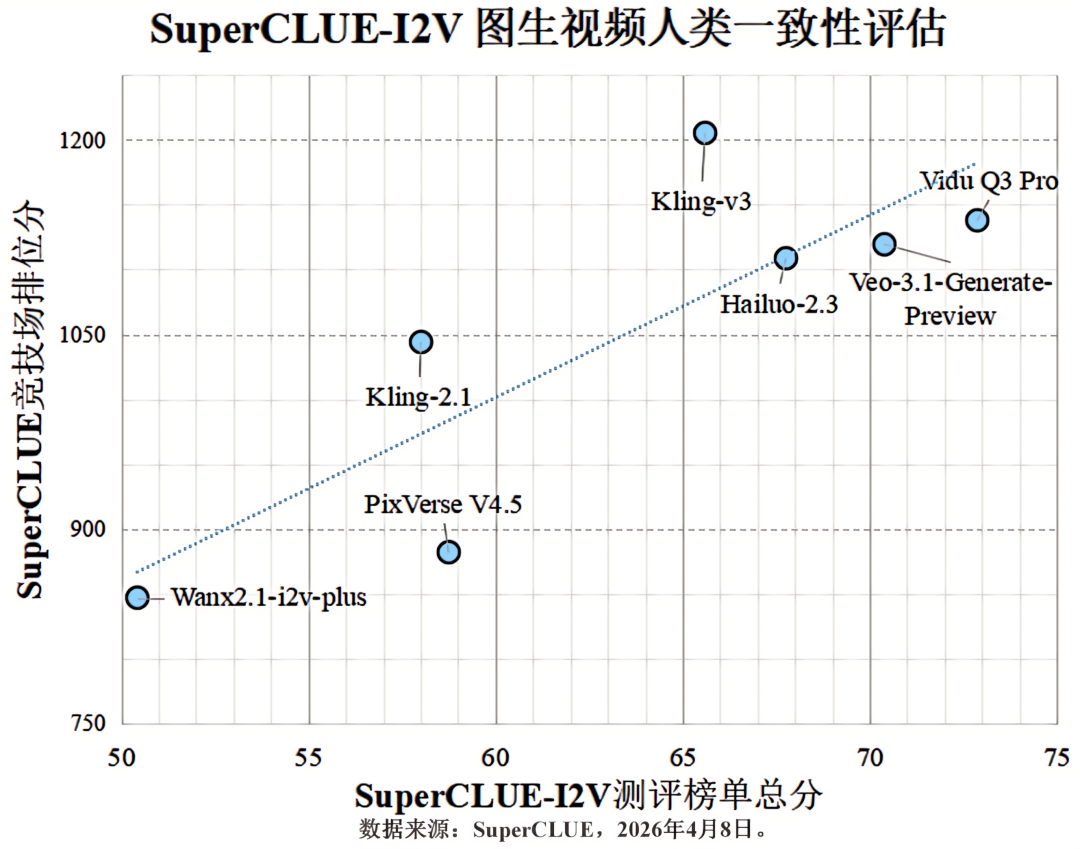

# 人类一致性评估

# SuperCLUE 图生视频中文竞技场排行榜

为验证测评体系的公信力,我们将SuperCLUE图生视频中文竞技场排位分与本次SuperCLUE-I2V测评榜单总分进行交叉分析。结果显示,客观测评体系精准反映了真实用户的感官体验,两者呈现高度趋同,具体统计指标如下:

皮尔逊(Pearson)相关系数: 0.839,P值:0.018。表明测评分与排位分存在强相关性,P值远小于0.05说明相关性显著。

斯皮尔曼(Spearman)相关系数: 0.750,P值:0.052。表明测评分与排位分的排名顺序具有较高重合度,榜单排位具备高可信度。

# 模型对比示例

# 示例1 基础能力—内容一致性

【提示词】:视频采用环绕旋转的拍摄手法,围绕着雕像缓缓转动镜头。树叶的光影在雕像上斑驳闪烁,能清晰看到雕像的纹理细节。随后镜头下移,聚焦到坐在椅子上的老人,老人微微仰头,目光似乎停留在雕像上,陷入沉思。接着镜头继续延展,展现出雕像周围色彩斑斓的花丛,远处喷泉的轮廓也逐渐映入眼帘,整个公园的静谧与美好完整呈现。

【Doubao-Seedance-2.0】:0.89分

【Kling-v3】:0.28分

# 示例2 基础能力—物理真实性

【提示词】:随着时间的推移山体慢慢由部分到全部都被日光笼罩。

【Hailuo-2.3】:0.89分

【Step-Video-TI2V】:0.37分

# 示例3 应用能力—动漫风格

【提示词】:两只狗狗欢快地起身,大狗狗在前,小狗狗在后,迈着轻快的步伐向前跑去。它们穿过一片五彩斑斓的花丛,花瓣随着它们的跑动纷纷飘落。接着,来到一条清澈的小溪边,大狗狗率先跳进水里,溅起一片水花,小狗狗也不甘示弱,跟着跳进去,在水中欢快地扑腾。玩累后,它们抖落身上的水珠,沿着溪边继续向前,奔向远方一片金黄色的田野,在夕阳的余晖中尽情嬉戏玩耍。

【PixVerse V6】:0.89分

【Veo-3.1-Generate-Preview】:0.41分

# 示例4 应用能力—奇幻风格

【提示词】:他静静坐着,背后的橙黑背包微微起伏,似乎在呼吸。夕阳将城市染成橙红色,高楼大厦在余晖中轮廓分明。他抬手摸摸耳边的植入设备,眼中闪过一丝落寞。突然,背包发出一阵嗡鸣,他打开侧面的显示屏,上面跳出一条加密信息。他眼神一凛,迅速起身,沿着天台边缘的管道攀爬而下。在城市的阴影中穿梭,朝着未知的任务地点奔去。

【Vidu Q3 Pro】:0.91分

【Wanx2.1-i2v-plus】:0.45分

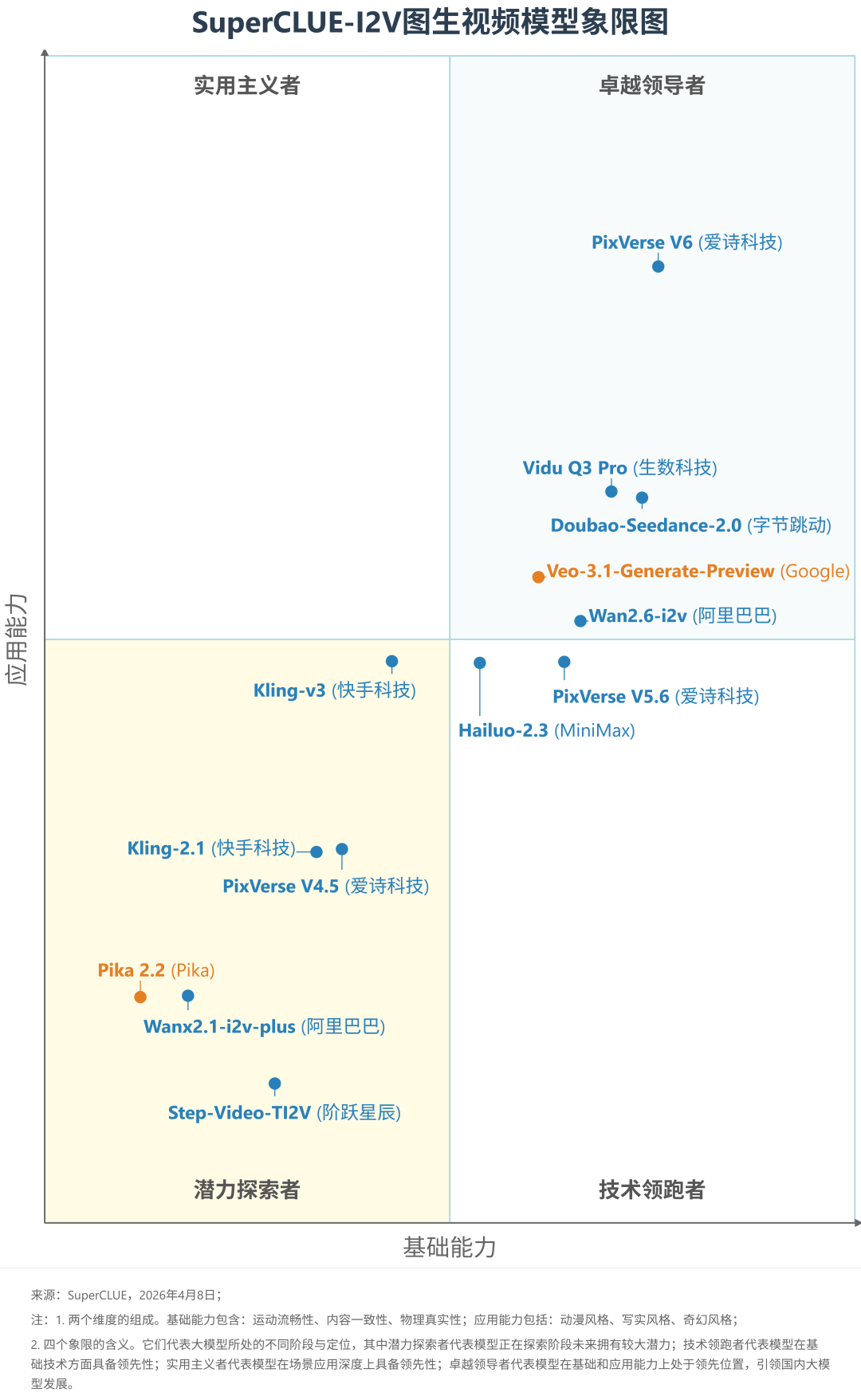

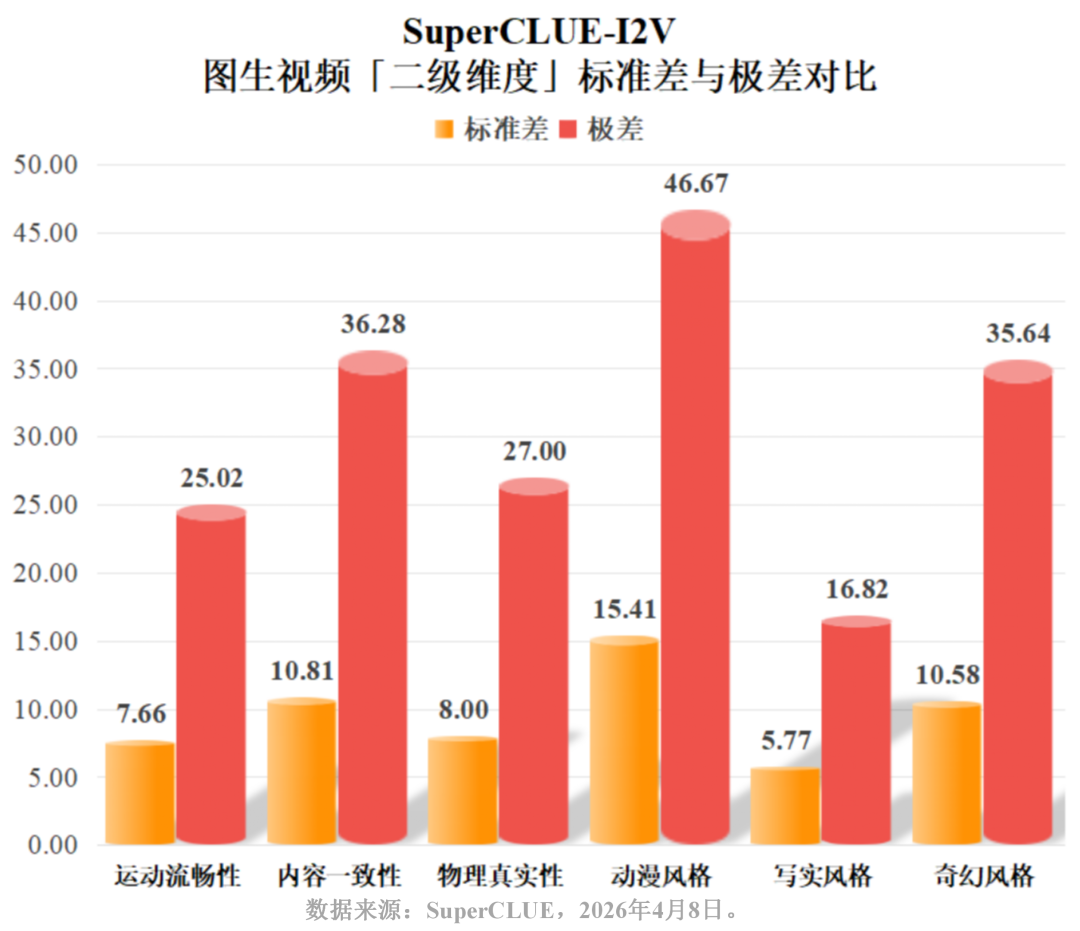

当前图生视频模型的发展呈现出明显的非均衡状态。大多数模型的“应用能力”得分显著高于“基础能力”。结合二级维度的极差与标准差分析,不同风格的生成能力形成了极其明显的断层;而底层的物理运动规律则成为全行业的共同瓶颈,模型间未能拉开实质性差距。

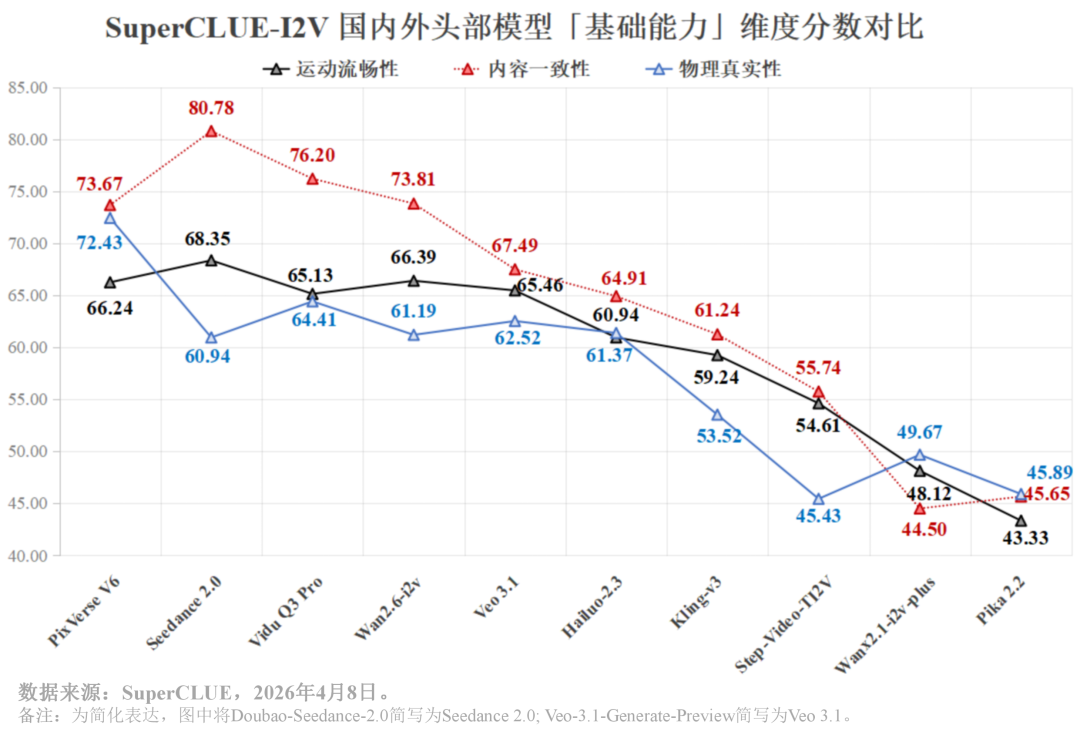

基础能力:一致性拉开梯队,物理运动规律成主要鸿沟。

“内容一致性”极差为 (36.28),标准差达 (10.81),模型间差距较大,顶尖模型已较好掌握了原图特征的保留与对齐;在“运动流畅性”(极差25.02,标准差7.66)和“物理真实性”(极差27.00,标准差8.00)上,大部分模型都被卡在同一瓶颈处。

同时,结合基础能力折线图来看,“内容一致性”中,Doubao-Seedance-2.0 (80.78分) 位列第一;而“运动流畅性”与“物理真实性”上,除 PixVerse V6 在“物理真实性”上实现了 (72.43分) 的单点突破外,多数头部模型的这两项指标均被压制在60-68分区间,印证了底层物理运动是难以轻易跨越的门槛。

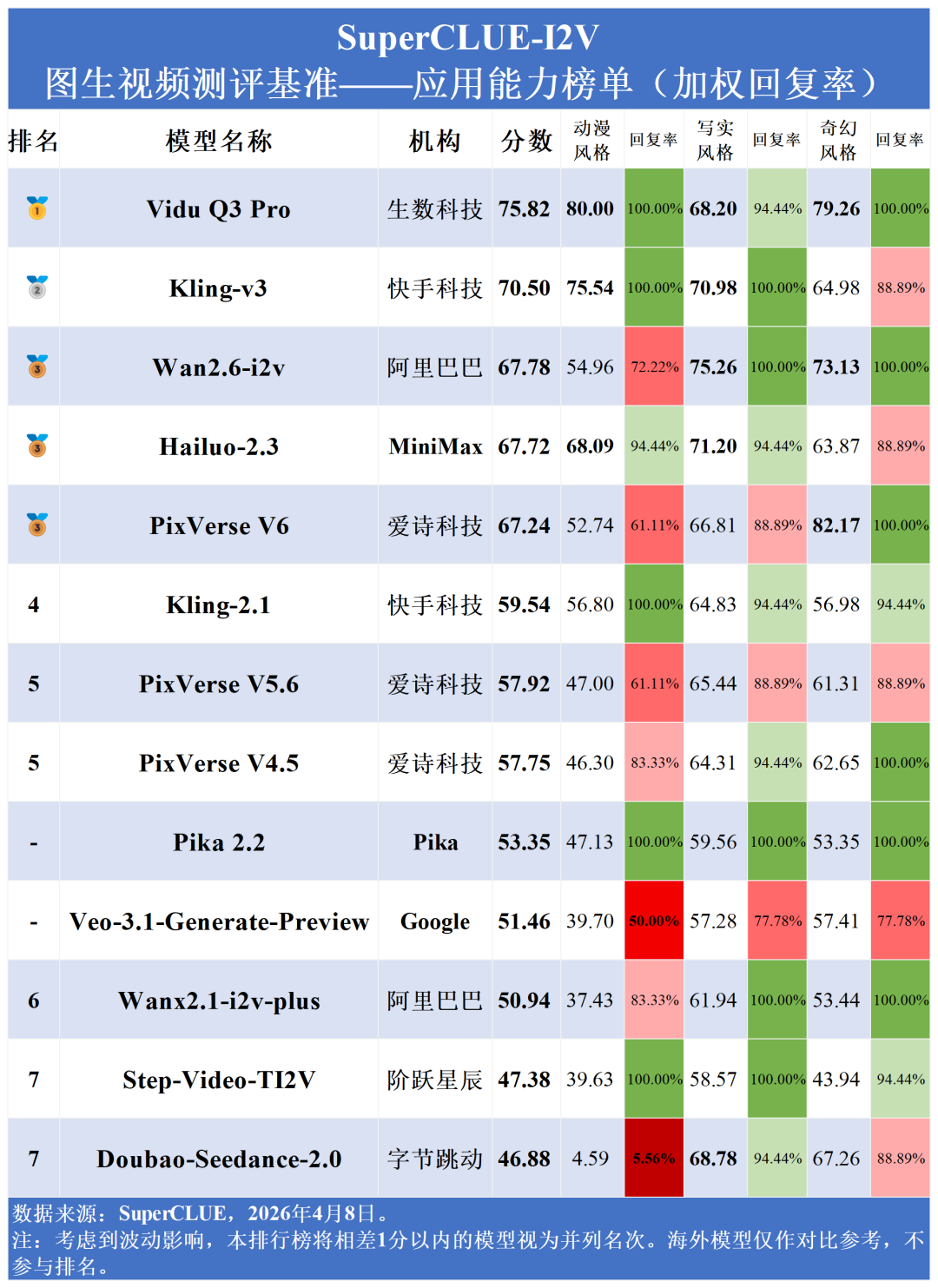

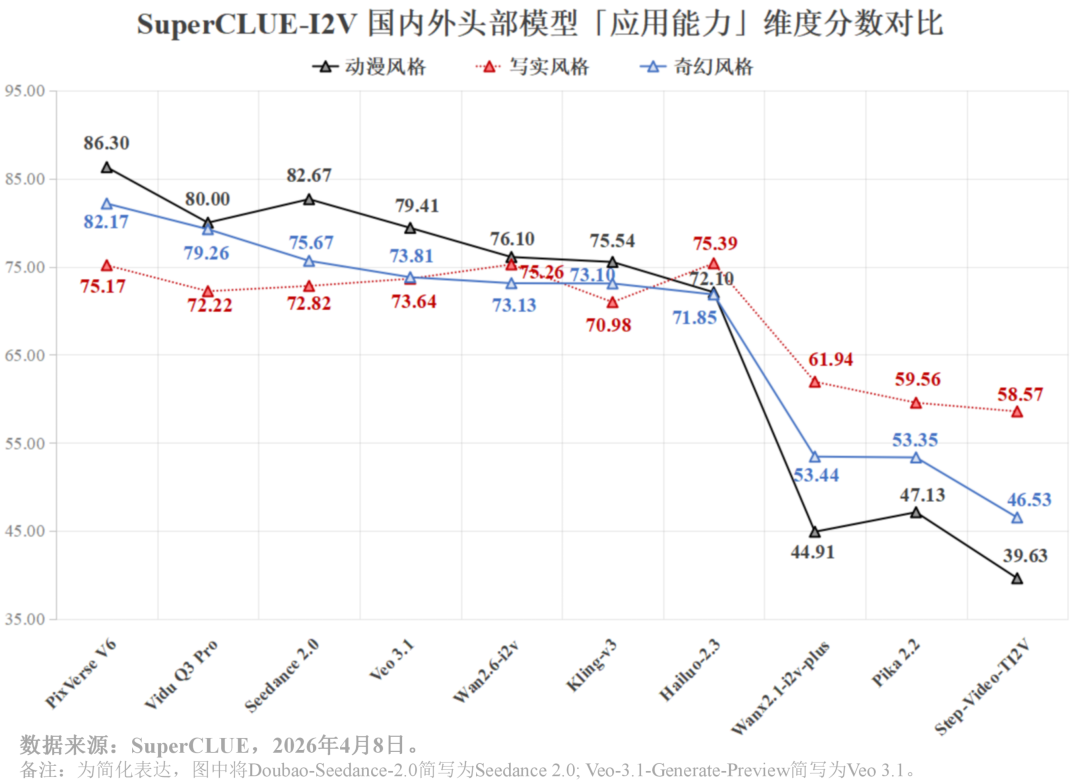

应用能力:写实风格表现统一,动漫风格成为最大分水岭。

“写实风格” (极差16.82,标准差5.77) 成绩表明在高度要求光影、肌理等真实感还原的场景下,多数模型能较好掌握;而“动漫风格” (极差46.67,标准差15.41) 则表明当应用场景转向偏向艺术化、二次元特征的创作时,模型生成限制与实力出现了极其悬殊的断层。

同时观察折线走势图,头尾模型差距明显。“动漫风格”上,PixVerse V6(86.30分) 拔得头筹;但随着梯队下移,该维度呈断崖式下跌。“写实风格”走势平缓,主流模型分数在70-75分区间内。直观反映出模型在写实维度上的高度趋同,而动漫和奇幻风格则是目前拉开总榜排名的核心。

扩展阅读

[1] CLUE官网:www.CLUEBenchmarks.com

[2] SuperCLUE排行榜网站:www.superclueai.com

[3] Github地址:https://github.com/CLUEbenchmark