对话地平线前高管牛建伟:万亿参数大模型如何重塑具身智能

作者丨齐铖湧

编辑丨林觉民

具身智能的赛道正在分裂。

一边是智元、自变量代表的"VLA派",视觉-语言-动作端到端,用海量数据训练机器人叠衣服、抓取物体,估值一路飙到数百亿;一边是至简动力、维他动力等"智驾降维派",华为ADS、小鹏、理想背景的团队涌入,把自动驾驶的BEV、端到端经验移植到人形机器人上,动辄融资数亿美金。

两条路线都指向同一个终点:让机器人真正"看懂"世界、自主行动。但两条路都还没跑通——VLA困于泛化与成本,智驾派困于场景迁移。行业共识远未形成,资本却在疯狂押注。

时间来到2026年,我们发现业界出现了另一支派系:“大模型派”。

近期,多家创业公司都选择了类似的技术路线,某种意义上,这是"大模型派"对"VLA派"的宣战。

最近,我们约到了一些相信能够能将具身大脑和多模态大模型结合的创业团队,来跟他们聊聊这个新的流派和思路。

牛建伟,进入了我们的视线,这位地平线前智能座舱产品线总经理,带着一支"成建制的大模型团队"进军具身智能赛道。他做过百度首个深度学习语音系统,做过国内首个车规级AI芯片+多模态人机交互方案量产,对多模态大模型和系统落地有极为精确量化的认知——2015年余凯邀请他进去,正是为了那个"瓦力"般的机器人梦想。直到十年后,这个梦想得以延续。

十年后杀回具身,他却说:VLA是弯路。真正的答案,是"物理世界的GPT"。

这是一个AI老兵对旧日经验的"出走"。在具身智能的战国时代,牛建伟选择了一条不一样的路,以认知驱动的大模型范式,来解决具身的问题。不是做最会叠衣服的机器人,而是做最懂物理世界的"大脑"。

以下是牛建伟与AI科技评论的对话,AI科技评论作了不改变原意的编辑:

01

2015年就想做的事,现在终于能做了

AI科技评论:先聊聊你的背景。2012年你在百度IDL实习,搭建了国内第一个基于深度学习的语音系统。当时是什么情况?

牛建伟:当时语音的主流方案还是以GMM的传统方案为主,局限性很大。而深度学习范式刚刚兴起,我作为主力去搭建了IDL首个使用GPU并行训练的深度学习框架,花了9个月,把基于深度神经网络的语音识别模型推上线,支撑了百度语音搜索和语音输入法等产品。

那时候叫"大模型",现在看只有不到0.1B参数,但当时已经是行业突破了。

AI科技评论:为什么2015年去地平线?语音和芯片似乎很远。

牛建伟:我跟余凯在IDL就已经共事。地平线创立之初就想做机器人,凯哥拉我入伙负责机器人的人机交互系统。

机器人的核心是什么?理解人的意图、执行人的指令、给人反馈。没有优秀的人机交互系统,机器人就是聋子哑巴。

当时地平线的构想很大,要做"机器人OS+芯片",办公室还摆了个“瓦力”模型——那个《机器人总动员》里的智能体,我们做机器人最早的种子就是这个。

AI科技评论:但是那时做机器人似乎有些早。

牛建伟:是的,当时的AI技术还不足以支撑做一个可用的机器人,本体也不成熟。机器人要听懂话、理解意图、执行任务,这些链条都是断的。

我们花了半年时间探索,发现做不下来,后面就调整了方向,去围绕智能汽车进行芯片加AI的产品研发和落地。行业的共识,汽车就是"四个轮子的机器人",最早就是我们提出的。

大概18年,我领导团队做面向智能座舱的AI解决方案,在行业内率先提出了"多模态交互"的理念,整体方案我们研发打磨了三年,走完了痛苦的0到1的完整过程,最终拿下长安汽车这个重要的客户,把地平线首款车规级芯片和行业首个多模态AI解决方案落地到了长安 UNI-T车型上,UNI-T也是当年的爆款车型。

我们创造了一款全新的AI芯片在汽车行业最快量产的速度记录。

AI科技评论:这十年你一直在琢磨机器人?

牛建伟:对我们这代最早的AI从业者而言,机器人的愿景其实一直没变过。2018年提"多模态交互"的时候,背后有个认知:AI的核心是对多维度信息的全面、深度的计算,信息越多、计算的越多就越有价值。

机器人的智能来自于对外部世界和本体的全模态感知与理解的能力。当时我们就想,如果能在座舱里对人的行为状态和所处的环境,进行全模态的感知理解,我们就能构建出汽车的智能大脑。

AI科技评论:什么时候决定创业?

牛建伟:地平线完整做完了“从0到1”和“从1到10”,内心总会有个声音去做更大的事情。

有个实际的契机,当时我带着团队探索,用大模型通过GUI Agent的能力直接操作手机上的美团APP完成下单,当时就觉得:像人一样感知世界、使用工具解决复杂问题的大脑雏形出现了。时机到了。

之前大模型更多的是作为Chatbot被使用,伴随着大模型的多模态感知和Agent能力的巨大提升,它能自如的操作手机、电脑完成复杂任务了。如果把它放到机器人上呢?

正如OpenClaw改变了AI‘只能说、不能做’的现状,我们也要改变机器人‘只能做,不能学’的现状。”以前没人相信我,现在全都懂了。

AI科技评论:你认为现在入场时机成熟么?具身目前是超级红海。

牛建伟: 两个前提条件很清晰了,才会决定入场。第一,如果我做的和别人一样,那肯定泯然众人了;第二,如果没有一个过硬的团队来实现真正的具身“智能大脑”,那肯定也活不到最后。简单来说,具身还没达到“GPT时刻”,还没有“范式基座”。而过去十年的积累和身边人的信任,把我推出来了。

AI科技评论:在超过200家具身公司的竞争中能冲出来?

牛建伟: 地平线当时的竞争环境不必这好,我们不也冲出来了(笑)?而且这件事我已经想了超过十年。

02

VLA在用大模型最不擅长的方式做事

AI科技评论:但现在行业主流是VLA。智元,银河通用、自变量都在做VLA。你为什么不做?

牛建伟:VLA正在用大模型最不擅长的范式解决运动控制问题。大语言模型的根本局限在于离散token化表示——它本质上是文本的概率生成器,而非数值计算器。

一个经典例证是9.9和9.10的比较:由于token化机制将'9.10'切分为['9', '.', '10'],模型会因字符串'10'大于'9'而产生数值幻觉。即便进行三位数的乘法计算,目前最好的大模型也做不到100%的准确率,主流做法都是大模型通过调用计算工具进行计算。

VLA的结构性矛盾正在于此:要求模型将视觉-语言理解直接映射为连续空间中的关节坐标、动作轨迹或路径点,这种'语言token→连续数值序列'的转换,存在明显的模态错配和信息损失。VLA架构在通过"扬短避长"的方式在利用大模型的能力,大模型真正擅长的对于任务规划推理、工具调用的能力被明显弱化了。

AI科技评论:但VLA能叠衣服、能抓取,视频看起来很流畅。

牛建伟:动作不是关键,智能才是。小学生叠十年衣服,不会变成大学生。

VLA能叠衣服,是因为它针对这个任务采了大量数据,但换个场景、换个本体,就要重新采。你找一个小学生让他搬十年箱子,他脑子也不会变聪明;但反过来,让他脑子变聪明,看别人叠一遍衣服就会了,而且不只会叠衣服,让他干什么都行。

简言之,我们要先做个能学习的大学生,也许笨拙,但有自主进化的能力。

AI科技评论:具体说,VLA的问题在哪?

牛建伟:三个问题。

第一,模型太小。VLA通常3B-7B参数,根据Scaling Law 随着数据规模的指数级增加,模型参数规模也需要同比例增加。100万小时视频按照一秒钟抽取2帧图片,那么就对应7.2B张图像帧,你用7B模型去学必然会出现Underfitting。能够充分学习1000万小时视频数据的模型,参数量要到100B级别,我预计十年内没有端侧芯片能跑下来。

第二,与本体绑定太深。特斯拉Optimus迭代了好几代,硬件差别很大,你绑着一代去弄,每代都要花大钱。

第三,没有有效的反馈和记忆机制。VLA直接输出动作序列,将认知和执行强耦合,无法通过外界的反馈来纠正和学习更好的完成任务。举个例子,OpenClaw是可以在用户的使用过程中通过记忆和SKILL的能力持续成长,核心在于解耦了认知和执行,就可以利用大模型擅长的in-context learning的能力实现在线学习。

AI科技评论:但VLA派会说,端到端才是未来,分层架构是老派的模块化方案。

牛建伟:端到端是单点方案。但具身智能是通用问题——机器人要会开车、做饭、打扫,是人的化身。VLA方案还在尝试解决自动驾驶的L3问题,目前还没有有效结局。想解决通用任务目前看很难。你看人怎么看自动驾驶:我会开车,只是我的一个技能而已。机器人也一样,开车只是它的技能之一,它还要做很多通用的事。

03

我们要做万亿参数的空间智能大模型

AI科技评论:你的方案是什么?

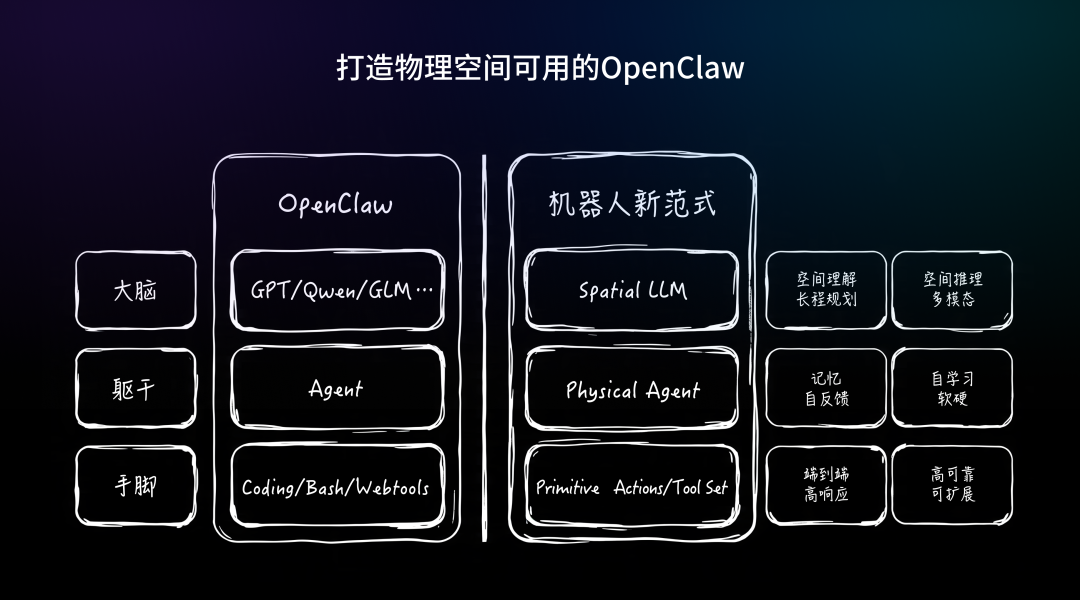

牛建伟:分层架构。

上面是万亿参数的"空间智能大模型",是大脑,做任务规划、推理、记忆;下面是VA(Vision-to-Action)小模型,0.1B-1B参数,是手和脚,专门执行基础操作。

大模型擅长什么?推理、任务编排、调用工具。我们的方案就是充分利用大模型在逻辑推理、任务规划和工具调用方面的能力。现有的GPT类大模型在空间理解与推理,物理世界任务规划方面有较大的欠缺,因为它们都是基于互联网数据训练的,天然缺少物理世界的数据、对具身的任务也没有针对性训练。我们会在数据和训练算法两方面进行大模型的优化,来实现一个更懂物理世界的空间智能大模型。

业内能打通空间智能大模型和行为小脑的团队很少,真正做过长周期、大参数、闭环落地的,才能做成这套方案。

AI科技评论:为什么是万亿参数?创业公司能训么?

牛建伟:物理世界的复杂度不比数字世界低,只会更高。

GPT处理数字世界需要万亿参数,机器人理解三维世界的空间关系和物理规律,也需要这个量级。我们站在巨人肩膀上,千问、Llama已经开源,技术路线摸清楚了。重新做一个千问要1000亿人民币,我们在开源基础上增加三维世界数据重新训练,可能几十亿就够了。

预训练阶段加入大量弱标注的三维数据,后训练用几千小时精标数据激发能力。不需要像VLA要采100万小时、1000万小时的操作数据。(编者注:几乎每个问题,牛建伟的表达都是精细到具体数字量级的)

AI科技评论:具体怎么训练?

牛建伟:大模型范式已经很清楚了。预训练用海量弱标注数据,学习物理世界的知识和规律;后训练用少量的通用任务的精标数据,激发能力,让智能涌现。

GPT就是这样干的,Coding能力不是预训练直接得到的,是后训练用相对少量人类专家数据激发的。我们也一样,预训练加三维真实世界数据,让大模型具备物理规律的理解;后训练用精标数据,激发它做任务规划、工具调用、反馈学习的能力。

AI科技评论:VA是什么?和VLA有什么区别?

牛建伟:VA是Vision-to-Action,弱化语言部分,视觉直接驱动动作。通过VA模型来实现机器人的基础操作能力。VLA是Vision-Language-Action,语言部分参数量太大,推理慢。VA做到0.XB参数规模,推理速度更快,延迟更低。

AI科技评论:这样会不会限制能力?VLA可以端到端学习任意动作。

牛建伟:VLA看似灵活,但是是由数据驱动的。它只能做训练数据里有的动作,换个方式拿杯子就不会了。

我们的方案,大模型负责任务规划,知道"为什么要拿杯子";VA负责执行,知道"怎么拿"。比如向前走这个动作,人形机器人用双足、轮臂机器人用轮子,只是调用不同的VA模型,大脑完全复用。

04

特斯拉有Grok,国内只学了Optimus的一半

AI科技评论:怎么看待行业内的大规模数据采集的计划?

牛建伟:总体上是为行业做贡献,很好的补充了之前匮乏的具身行业数据。但问题是,如果算法范式错了,采越多越浪费。我觉得目前的人的第一视角的数据逐渐成为了行业的一种共识,之前采集的很多遥操数据的价值可能就弱化了很多。

AI科技评论:展开说说?

牛建伟:自动驾驶就是例子。过去十年,自动驾驶行业经历了多次的技术迭代和硬件传感器的迭代,每次迭代都会让之前积累的数据价值弱化,甚至变得不可用。

具身的本体和技术方案都在发展的早期阶段,我们应该从第一性原理出发,从智能的终局出发来考虑如何采集和标注数据。我觉得大模型行业的经验值得借鉴,将预训练的数据和任务相关的数据分离开是一种思路。

AI科技评论:但投资人认这个。头部公司都融了很多钱。

牛建伟:现在投资圈特别认智驾背景,觉得做VLA是降维打击。但这是错的。

VLA可以非常快地实现一个很好的Demo效果,不管是抓取柔性物品还是执行特定场景的表演动作集,但最后消费者和B端客户买的不是“电器”,而是智能体。

自动驾驶是单点问题,具身智能是通用问题。或者说要实现L4级的自动驾驶问题可能也需要站在空间智能的角度,按照一种通用方式来解决。就像翻译作为语言大模型的一个子任务被较好的解决了一样。

AI科技评论:你认为具身智能的三派之争谁会赢?

牛建伟:三派。本体派,比如波士顿动力只会运控,没有环境感知,VLA出来就把他们打懵了;VLA派只会操作,没有大脑,国内只看到本体上的VLA,没看到大脑;大模型派(特斯拉、谷歌、我们)做大脑,做任务规划、推理、记忆。

AI科技评论:谷歌、特斯拉的具体方案是什么?

牛建伟:谷歌有Gemini,特斯拉有Grok,都是万亿参数大模型做大脑,做任务拆解和推理;本体上用VLA或类似模型做执行。这是完整的方案。

05

我们要做物理世界的OpenClaw

AI科技评论:你们现在产品到什么阶段了?

牛建伟:我们已经在机器人上跑通了物理agent架构,可以直接通过对话交互的方式修正机器人的任务执行,并积累到机器人的skill中去。你可以简单的理解,我们已经搭成了一个物理世界的OpenClaw,下阶段是skill的问题。

AI科技评论:具体能做什么?

牛建伟:告诉它"把杯子拿起来放到收纳盒里",它自己拆解任务:调用相机看杯子位置,调用深度感知测距离,调用VA模型执行拿取,然后移动到收纳盒上方,执行放置。每个步骤都是大模型规划,调用不同工具完成。

AI科技评论:这和VLA的端到端有什么区别?

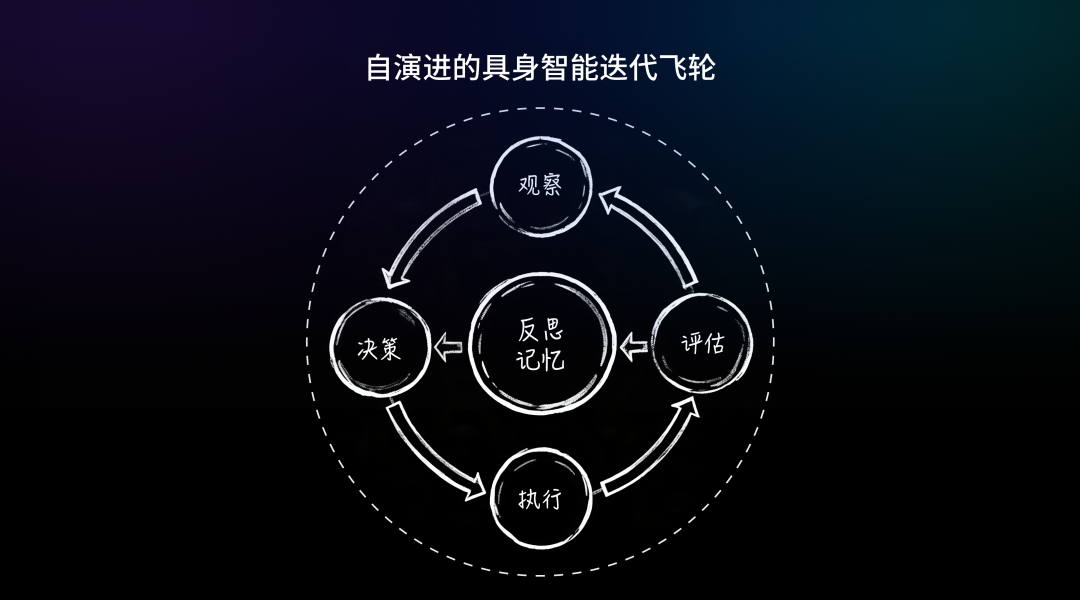

牛建伟:VLA对于长程任务的规划能力其实是不足的,另外一个重要区别是我们的方案引入了物理Agent的架构,在我们的方案下机器人不仅知道如何做一个任务,还能够实时监督和反馈任务完成的情况,并通过记忆和反思的能力,实现任务越做越好。

我们通过Agent的开发范式构建了感知、决策、执行、评估与反思记忆的完整闭环,使得机器人可以在和环境的交互和与人的互动中持续的学习与成长。

AI科技评论:反馈学习怎么做?

牛建伟:就像养“小龙虾”。你告诉它"邮箱应该这样发",它不用重新训练就能学会;执行任务报错,它能自己查资料修正。女主人说"杯子以后放厨房",Agent记住,形成记忆,不需要做任何模型层面的调整,在线就完成了体验优化。VLA干不了这个,它训练好了就是这样,能力的泛化有限。

"我们等了十年,不差这一两年"

AI科技评论:如果这次错了呢?如果三年后VLA成了主流?

牛建伟:如果VLA成为了通向通用具身智能的主流方案并且具备了很高的智能,这应该是是一件特别好的事情。云端万亿参数的大模型完全可以参照VLA来进行模型的尺寸小型化,这个会节省非常多的成本和能源消耗。但我很难相信,一个参数规模比人脑神经元数量(100B)还少的模型可以实现接近人的智能水平。

AI科技评论:万一还是做不成呢?

牛建伟:我们等了十年,不差这一两年。但逻辑是通的,大模型给我们最大的启示就是:用通用方案解决问题,持续提升智能,新的能力就会涌现。VLA是反着来的,针对每个场景堆数据,这是小模型的范式。

06

后记

某种意义上,"大模型派"的出现,是对"VLA派"的宣战,也是具身发展进入战国时代的一个标志,这一条更慢、更重、但也可能更通吃的路能实现么?

我们会持续关注,本文作者近期也将带来更多大模型派的创业公司的对谈,欢迎关注。

起底智元机器人,谁在推动一个庞然大物向前

达闼科技陨落一周年:具身独角兽的消亡史

未经「AI科技评论」授权,严禁以任何方式在网页、论坛、社区进行转载!

公众号转载请先在「AI科技评论」后台留言取得授权,转载时需标注来源并插入本公众号名片。

未经「AI科技评论」授权,严禁以任何方式在网页、论坛、社区进行转载!

公众号转载请先在「AI科技评论」后台留言取得授权,转载时需标注来源并插入本公众号名片。