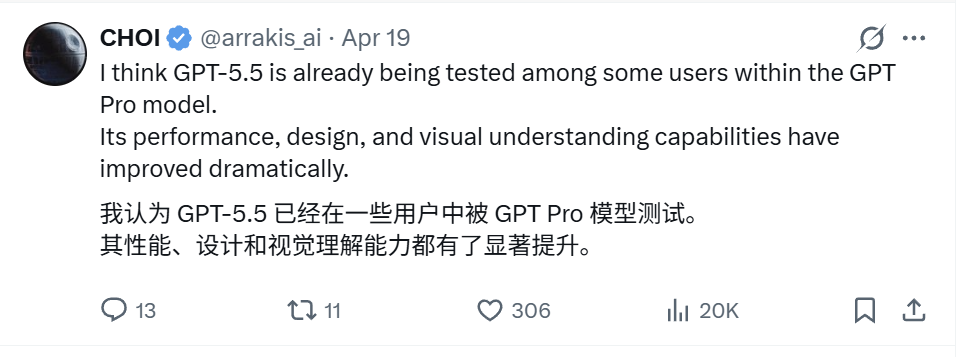

刚刚,GPT-5.5 的风声突然传开了

这两天,不少人忽然发觉,GPT-5.4 Pro 变快了。

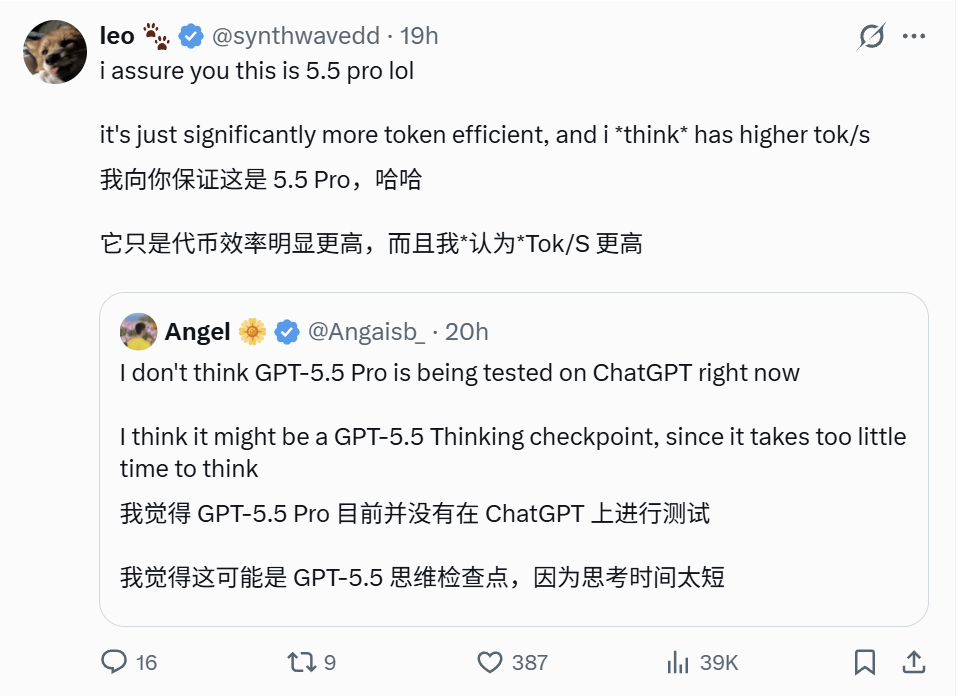

就是那个动辄思考很久、经常一开推理就拉满的模型,忽然没那么慢了。

昨天开始,开发者社区里开始流传关于 OpenAI 新模型的消息。linux.do 上有帖子汇总称,X 上从前一天开始出现大量关于 GPT-5.4 Pro 响应速度变快、输出风格变化的反馈。

社区总结出的变化大概集中在几个方向:

一是响应速度明显变快:

二是多数情况下感觉智商变高:

三是编码能力和审美提升,SVG 能力大提升:

但也有人觉得模型搜索的深度降低了,相比原来的 GPT-5.4 Pro 显得没那么愿意展开。

随后,OpenAI 研究员 Eric 发了一条面向 GPT-5.4 Pro 的意见征集推文,被社区迅速解读成一个信号:当前 ChatGPT 里的 GPT-5.4 Pro,背后可能已经不是原来的那个模型了。

抛开新模型,其实过去一个月,OpenAI 已经高频发布了很多新东西:

3 月 5 日正式发布的 GPT-5.4 仍在持续 rollout;4 月 14 日又上线面向防御场景的 GPT-5.4-Cyber,扩展 Trusted Access for Cyber;4 月 16 日发布 GPT-Rosalind,切入生命科学研究;同一天,Codex 也迎来大更新,官方说它的每周开发者用户已经超过 300 万。

短短几周,OpenAI 一口气把主线模型、网络安全、生物医药、Agent 产品全都往前推了一步。

问题是,OpenAI 最近也不是单纯在顺风局里狂飙。

外面,Anthropic 正在追得很凶。Anthropic 4 月初推出 Project Glasswing,让合作伙伴接入 Mythos,主打关键软件和网络安全防御场景;Anthropic 还表示,Mythos Preview 是它目前能力最强的前沿模型之一,重点就是漏洞发现和利用能力。

更现实的是商业化压力。

Reuters 在 4 月初的报道中提到,Anthropic 的年化营收(ARR)已冲到 300 亿美元量级;而 OpenAI 此前披露的月收入约 20 亿美元,换算年化约 240 亿美元。这是自 2022 年 ChatGPT 上线以来,OpenAI 第一次在营收量级上落到第二位。

Claude Code、Claude for Enterprise 两条线是主要引擎。据 Anthropic 内部披露,仅 Claude Code 一条线就贡献了约 25 亿美元的年化营收。这对 OpenAI 来说,不可能没有压力。

前两天,The Information 爆出一条消息:Claude Mythos 之所以迟迟难以全面发布,一个核心原因是算力开销太大。

在大规模上线之前,它必须先把运行效率大幅压下来,否则根本撑不住。

据投资人材料,Anthropic 的推理成本已经超出内部预期 23%,毛利率下探到 40% 左右。也就是说,它每赚 1 美元,可能有一大半,转头就烧进了 GPU 集群。

基础设施侧同样吃紧。The Register 的报道显示,仅 3 月一个月,Claude 就出现了 5 次大规模宕机;Anthropic 在 3 月底被迫对 7% 付费最狠的用户限流,开发者在社区反馈,月费 200 美元的 Max 档用户,30 天里能正常用上 Claude 的只有 12 天左右。

反超者的烦恼,不在模型,在供给侧。

回头看这几个月,无论是 OpenAI、Anthropic,还是 Google DeepMind,其实都在遇到同一类问题:模型越来越强,但也越来越难养。

一边是更复杂的推理、更长的上下文、更高的性能指标;另一边,是频繁的宕机、限流、响应收缩,以及不断上涨的算力成本。

于是你会看到一组很微妙的变化:模型开始变快,产品在扩张,但实际使用却在被限流——算力开始成为真正的瓶颈。

所以,GPT-5.4 Pro 的“变快”、Mythos 的限流、Sora 的关停,背后可能不只是优化体验,而是一次更现实的调整——在算力吃紧的前提下,让旗舰模型尽可能跑得动、撑得住、用得起。