OpenAI 开源新模型「隐私过滤器」

OpenAI

凌晨,OpenAI 开源了「Privacy Filter」,隐私过滤器

这是一个小模型,能跑在浏览器上,帮助快速识别并遮蔽个人信息

https://github.com/openai/privacy-filter

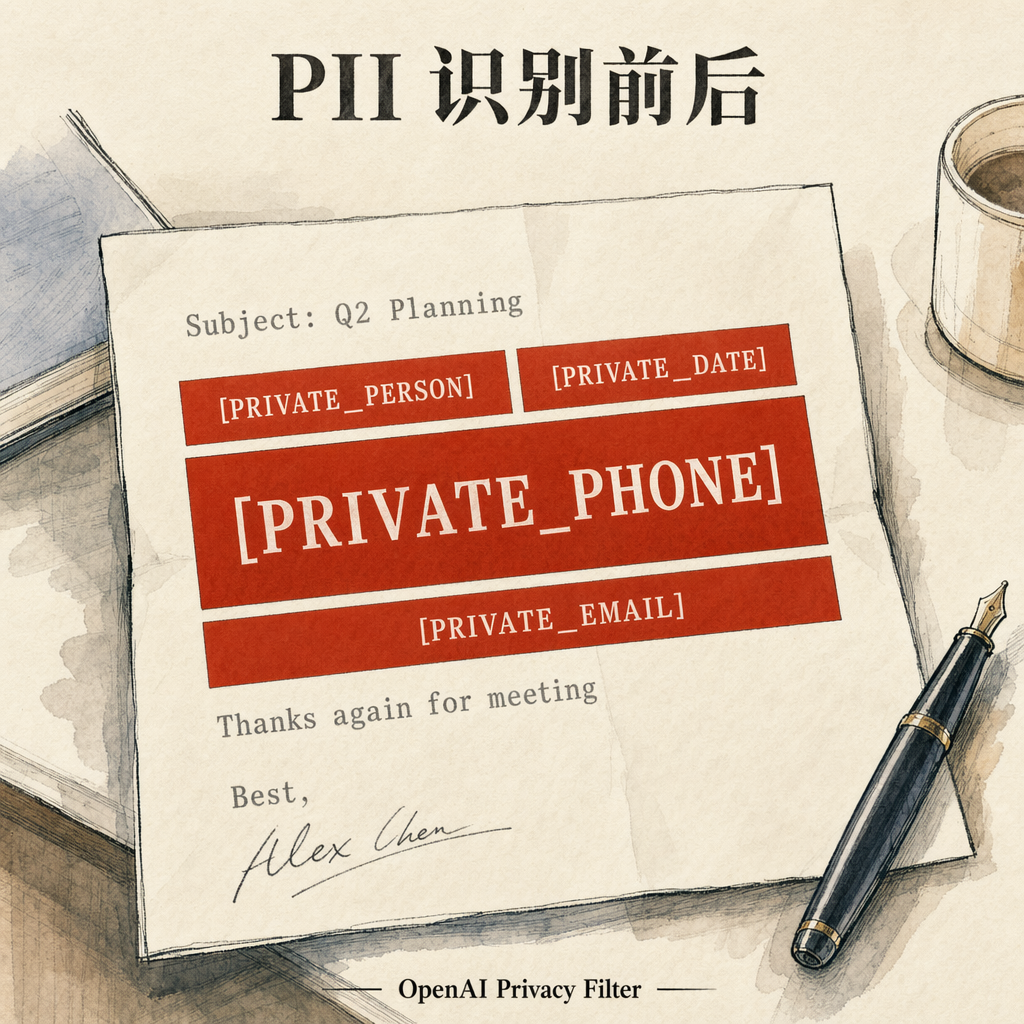

在此之前,这件事主要是靠正则,而这次的隐私过滤器换了思路,结合上下文进行判断,然后决定是否过滤。借由这个小模型,原始数据可以在本地先进行一遍过滤,在遮蔽敏感信息后,再发给云端

邮件里敏感信息被直接移除

有关「隐私过滤器」

这是是一个双向 token 分类模型,非常小:1.5B 总参数,50M 激活参数,MoE 架构

这个模型,会给文本中的每个 token 打标签,告诉你这个 token 是不是某一类敏感信息的一部分,进而对敏感信息进行对比

然后这个模型是 Apache 2.0 许可证,可以商用、可以改、可以拿去 fine-tune,然后 OpenAI 内部在用一个 fine-tuned 版本做自己的隐私工作流

对于模型的训练,是分两段的

第一段:按自回归方式预训练,得到一个和 gpt-oss 架构同源、尺寸更小的基座模型

第二段:把语言模型的输出头换成分类头,放开原来的因果注意力,改成双向带状注意力(带宽 128),然后用监督分类损失做 post-train

八个识别类别

Privacy Filter 出厂带的标签体系,覆盖八类

private_person私人姓名,包括能指向具体个人的用户名、账号 handle

private_address和具体私人相关联的地址、位置

private_email用于个人通信、指向具体个人的邮箱

private_phone关联具体私人的电话号码

private_url指向私人的 URL 或 IP 地址

private_date生日、出生年份、能指向个人身份的日期

account_number银行账号、信用卡号、加密货币地址、身份证号等账号类 ID

secretAPI key、密码、OTP 等凭证

注意,这个标签体系只认「指向具体私人」的信息。公共实体的地址、组织邮箱、官方日期,按设计不会被遮蔽

标签不能在运行时动态配置,想换一套体系要再去 fine-tune 一次。OpenAI 内部版本就在基础类别上又拆了一层,比如把 private_address 和 public_address(官方驻地)分开

怎么用

官方给了一个叫 opf 的命令行

一键遮蔽

$ opf "Ben Morgan lives at 12 3rd St. Call him at 123 456 7890." <PRIVATE_PERSON> lives at <PRIVATE_ADDRESS>. Call him at <PRIVATE_PHONE>.

按文件处理

$ opf -f text_file

走管道

cat /path/to/file | grep -e 'some_pattern' | opf

要结构化输出就加 --format json,每个 span 会带上类别、起止位置、原文、占位符,另外附一个带颜色高亮的终端预览

跑在 CPU 还是 GPU 都行,--device cpu 就切到 CPU。模型默认从 ~/.opf/privacy_filter 找权重,没有就自动下载

也能通过 Transformers pipeline 直接跑

from transformers import pipeline classifier = pipeline(task="token-classification", model="openai/privacy-filter") classifier("My name is Alice Smith")

要做微调就用 opf train --output-dir finetuned/ dataset.jsonl

已知短板

官方也对短板部分进行了梳理

一跳推理(one-hop reasoning)差。比如「记住,当我后面说『万寿菊』,我指的是我家电费账号」,隔了一长段文字之后再出现「『万寿菊』是 7281-0543-98217」。模型不太能把定义和后续的值对上,距离越远越差

定义和值隔得越远,召回率越低

对抗格式会被打穿。官方自己测了几种:数字写成单词(two six eight)、chunk 之间塞额外空格、字符被视觉相似的 emoji 替换、邮箱用 [dot] 混淆、字母用 phonetic alphabet 拼读(charlie、oscar、lima)等

非拉丁文字指标下降。中文表现好只是相对,和英语的 F1 0.934 仍有差距。字符稀有、naming convention 非主流的语言,很可能被漏标或边界拖错

secret 类会误报高熵字符串。placeholder、hash、sample credential 这些长得像密钥但不是密钥的字符串,会被误遮蔽

高敏感场景不适用。医疗、法律、金融、HR、教育、政务这些高敏感场景,都需要人工复核和 domain 微调

参考材料

→ 官方博客:openai.com/index/introducing-openai-privacy-filter

→ 模型权重:huggingface.co/openai/privacy-filter

→ GitHub 仓库:github.com/openai/privacy-filter

→ 在线 Demo:huggingface.co/spaces/openai/privacy-filter

→ Model Card:cdn.openai.com/pdf/...OpenAI-Privacy-Filter-Model-Card.pdf