一文读懂DeepSeek V4:1.6万亿参数、百万上下文、华为芯片

DeepSeek创始人梁文锋。图片经过AI处理

DeepSeek创始人梁文锋。图片经过AI处理

文丨晓静、李海伦

编辑丨苏扬

4月24日消息,DeepSeek V4预览版官宣上线。

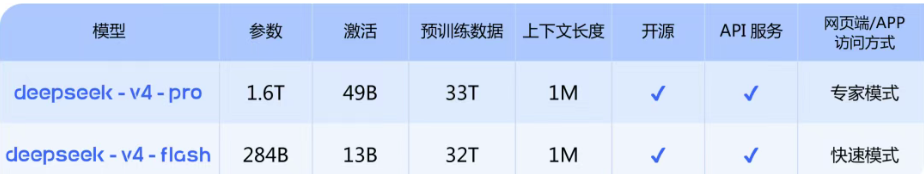

根据DeepSeek的官方介绍,V4系列包含两个MoE模型:DeepSeek-V4-Pro总参数1.6T、激活参数49B,DeepSeek-V4-Flash总参数 284B、激活参数13B,两者均原生支持100万token上下文。

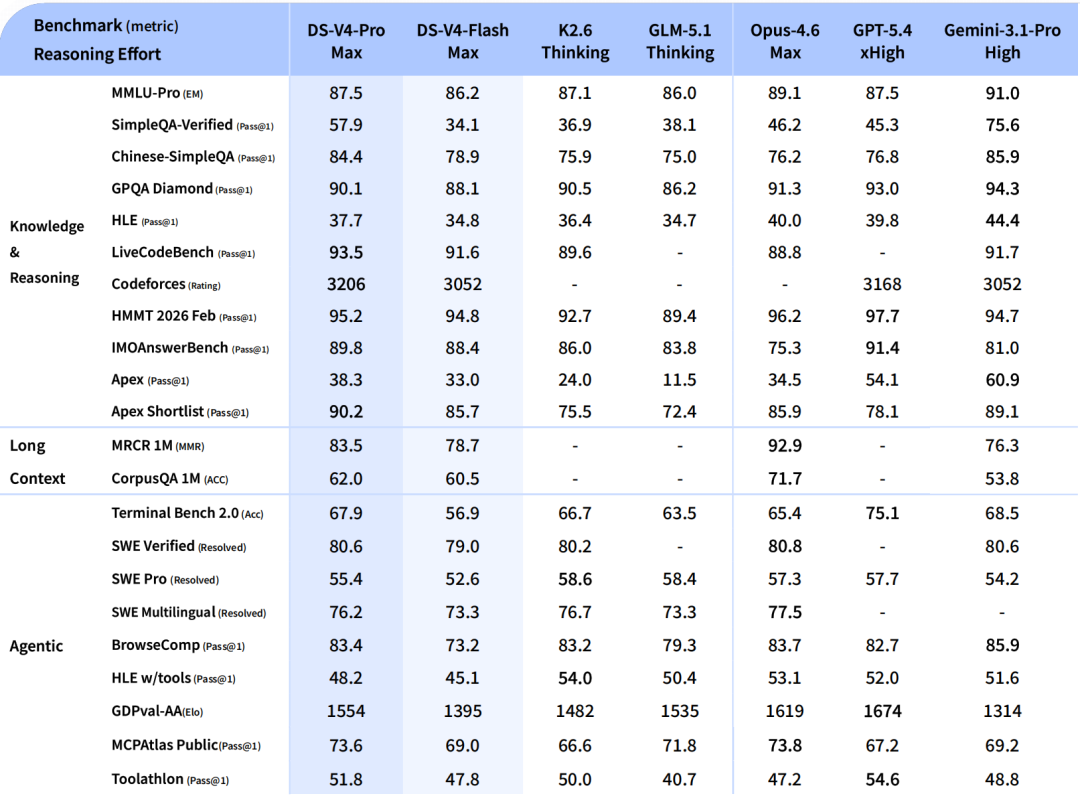

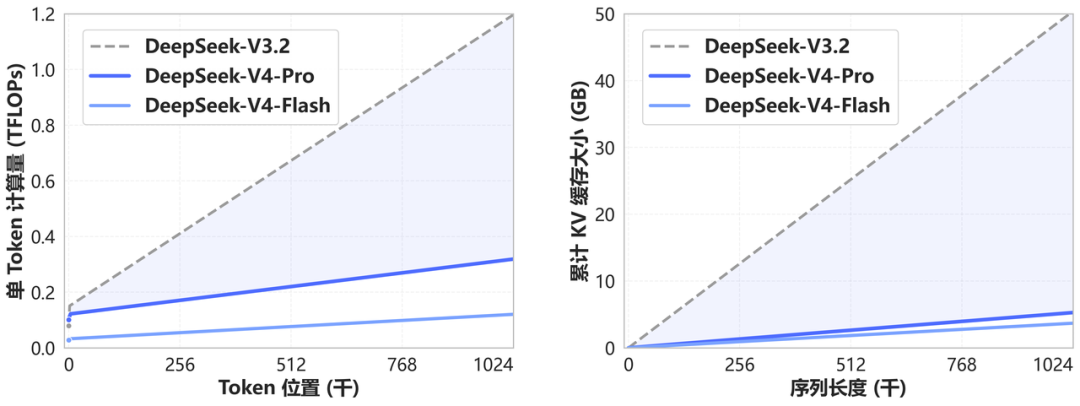

在1M上下文设置下,V4-Pro的单token推理FLOPs只有V3.2的27%,KV Cache只有10%;V4-Flash更极端,分别压到10%和7%。DeepSeek自己给这代模型的定位是“preview version”,官方在报告中明确表示,V4的能力水平仍落后GPT-5.4和Gemini-3.1-Pro,“发展轨迹大约滞后前沿闭源模型3至6个月”。

换句话说,V4预览版是把长上下文成本重构,为下一阶段test-time scaling和长程任务铺路的基础设施发布,没有强调能力上的跨越升级。

01

两款模型、三档推理:V4预览版到底是什么?

根据DeepSeek的官方介绍,V4系列包含两个MoE模型:DeepSeek-V4-Pro总参数1.6T、激活参数49B,DeepSeek-V4-Flash总参数284B、激活参数13B,两者均原生支持100万token 上下文。

真正值得关注的是成本曲线。

在1M token的上下文设置下,V4-Pro的单token推理FLOPs 只有V3.2的27%,KV Cache只有 10%;V4-Flash更极端,分别压到10%和7%。换句话说,上下文从V3.2的128K扩到V4的1M,理论上放大了近8倍,但单token算力需求反而下降了。

API价格沿袭了DeepSeek一贯的“打穿底”思路。V4-Pro每百万token输入1元(缓存命中)或 12元(缓存未命中),输出24元;V4-Flash分别为0.2元、1元、2元。

每款模型都提供三档推理强度:Non-think(直出)、Think High(常规深度思考)、Think Max(在 system prompt 里注入强指令、把上下文和输出长度拉满)。

Max模式是为了榨出模型的能力上限——V4-Pro-Max在HLE测试中从Think High的34.5分升到 37.7分,Apex Shortlist 测试中从85.5升到90.2,代价是输出token翻倍。

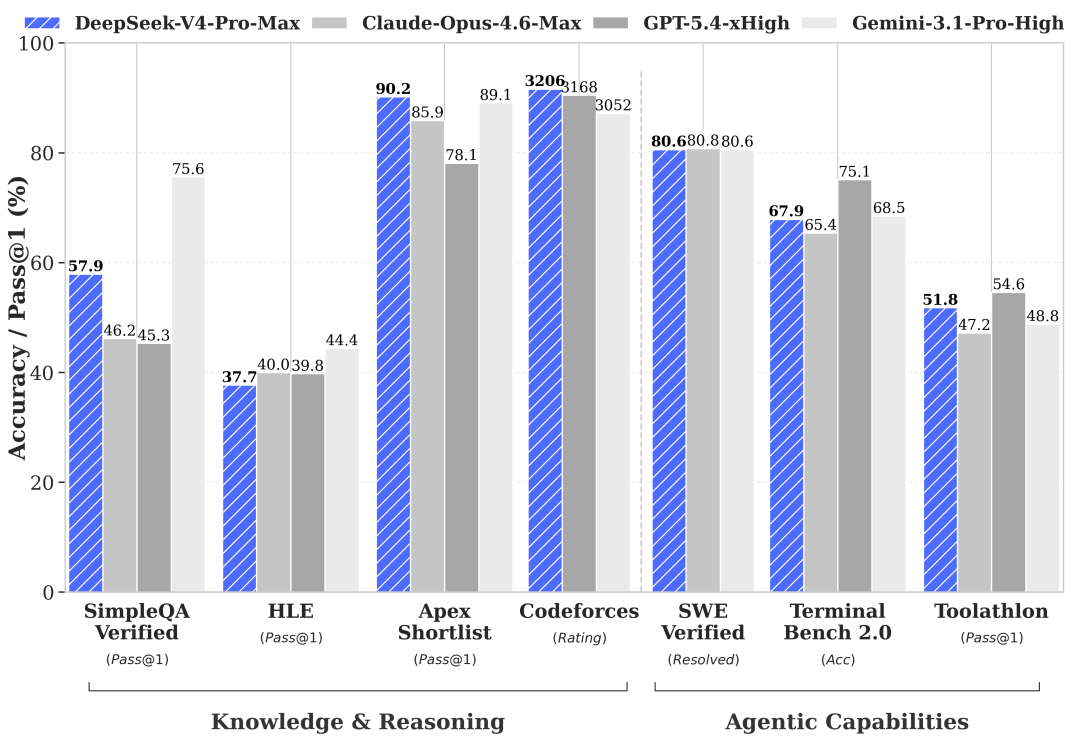

根据DeepSeek披露的详细基准测试数据,在知识与推理类测试中,DeepSeek-V4-Pro-Max 在Apex Shortlist(90.2%)和 Codeforces(Rating 3206)两项硬核推理 / 编程任务中拔得头筹,展现了极强的逻辑与算法能力;而 Gemini-3.1-Pro-High在 SimpleQA Verified(75.6%)中领先,Claude 和GPT则在各项目中互有胜负,整体差距不大。

在智能体能力相关的测试中,四款模型在SWE Verified任务上打成平手(均达到80.6%),但 DeepSeek在Terminal Bench 2.0(67.9%)和Toolathlon(51.8%)两项任务上同样表现突出,体现了在复杂指令执行与工具调用场景下的优势。

DeepSeek表示,相比前代模型,DeepSeek-V4-Pro的Agent能力显著增强。

“使用体验优于Sonnet 4.5,交付质量接近Opus 4.6非思考模式,但仍与Opus 4.6思考模式存在一定差距。”

DeepSeek官方强调,基于丰富的世界知识:V4-Pro在世界知识测评中,大幅领先其他开源模型,仅稍逊于顶尖闭源模型Gemini-Pro-3.1——Gemini-3.1-Pro-High在MMLU-Pro(91.0)、SimpleQA-Verified(75.6%)、GPQA Diamond(94.3%)等通用知识问答中领先。

另外,在数学、STEM、竞赛型代码的测评中,DeepSeek-V4-Pro超越当前所有已公开评测的开源模型,取得了比肩世界顶级闭源模型的优异成绩,DeepSeek将其称之为“世界级的推理性能”。

定位为经济性模型的V4 Flash在世界知识储备方面比DeepSeek-V4-Pro稍逊一筹,但也展现出了接近的推理能力。而由于模型参数和激活更小,相较之下V4-Flash能够提供更加快捷、经济的API服务。

在Agent测评中,DeepSeek-V4-Flash在简单任务上与DeepSeek-V4-Pro旗鼓相当,但在高难度任务上仍有差距。

02

重写注意力机制:“先压缩再挑着看”

V4最核心的技术改动在注意力层。

传统Transformer的注意力机制,每个token要和前面所有token都算一遍相似度。上下文从10万拉到100万,计算量增长的不是10倍,是100倍,这是长上下文一直跑不起来的根本原因。

V4的做法是把注意力拆成两种,交替叠用。

一种叫CSA(压缩稀疏注意力),它先把每4个token的KV缓存合并成一条摘要,再让每个query只在这些摘要里挑出最相关的top-k条去算注意力。相当于既压缩了“要看的内容”,又只挑“值得看的”去算。

另一种叫HCA(重压缩注意力),它的压缩率更激进,把每128个token合并成一条,但对剩下的摘要做稠密注意力,不做稀疏挑选。

两种交替叠起来,再加一个滑动窗口分支处理“离得近的token之间的细节依赖”。这是一套“粗粒度+细粒度、稀疏+稠密”的组合拳。

把这套方案和DeepSeek过去两年的技术脉络连起来看,变化就清晰了:V2、V3走的是参数稀疏化——总参数很大,但每token只激活一小部分专家;V4在此之外又开了一条上下文稀疏化的路——KV压缩、top-k选择、分层压缩率。

这是DeepSeek第一次把“稀疏化”的刀动到Transformer的核心结构里。

除了注意力层,V4还有两处此前版本没动过的改造。一是把传统残差连接升级为mHC(流形约束超连接),通过数学约束让深层网络的前向和反向传播更稳定;二是用Muon优化器替代大部分模块原本用的AdamW,收敛更快、训练更稳。这是DeepSeek第一次同时动Transformer的注意力、残差、优化器这三处核心结构。

DeepSeek-V4 和 DeepSeek-V3.2 的计算量和显存容量随上下文长度的变化

DeepSeek-V4 和 DeepSeek-V3.2 的计算量和显存容量随上下文长度的变化

03

后训练换范式:把一堆专家“蒸馏”成一个模型?

比架构改动更值得注意的是后训练方法的切换。

V3.2用的是“混合RL”,一次性用强化学习优化多个目标。V4换成了“分化再统一”的两步走:

第一步,针对数学、代码、Agent、指令跟随等不同领域,每个领域单独训练一个专家模型。这些专家先用该领域的高质量数据做监督微调,再用GRPO算法做强化学习,每个专家都在自己的细分赛道上跑到最优。

第二步,用一种叫On-Policy Distillation(OPD,在策略蒸馏)的方法,把十多个领域专家“合成”回一个统一的学生模型。学生自己生成回答,然后对每个回答,去匹配“最懂这个问题”的专家的输出分布,通过logit级对齐,把能力吸收进来。

你可以讲这种做法理解为,把一堆尖子生蒸馏了。

这套流程的工程难度在于:同时加载十多个万亿参数级的教师模型做在线推理不现实。DeepSeek的做法是把所有教师权重统一卸载到分布式存储,只缓存每个教师最后一层的hidden state,训练时按教师索引排序样本,保证任意时刻GPU显存里只驻留一个teacherhead。

换个说法,V4的能力不再靠一个模型从头学,而是先让不同专家在自己的赛道跑到顶,再把它们收编进同一套权重里。这种思路绕开了传统“混合 RL”容易导致的能力互相干扰问题。

04

Agent能力优化

DeepSeek-V4针对Claude Code、OpenClaw、OpenCode、CodeBuddy等主流的Agent产品进行了适配和优化,在代码任务、文档生成任务等方面表现均有提升。

DeepSeek自述V4-Pro的Agent能力“优于Sonnet 4.5,交付质量接近Opus 4.5非思考模式,但仍与Opus 4.6思考模式存在一定差距”。

值得注意的是,V4在Agent方向做了几处专项优化:后训练阶段把Agent作为与数学、代码并列的独立专家方向单独训练;工具调用格式从JSON换成带特殊token的XML结构,用来降低转义错误;跨轮次推理痕迹在工具调用场景下完整保留,不再像V3.2那样每轮清空;此外DeepSeek自建了一套名为DSec的沙箱平台,单集群可并发管理数十万个沙箱实例,用来支撑Agent强化学习训练和评测。

下图为V4-Pro在Agent框架下生成的PPT内页示例:

05

昇腾在等V4,V4也在等昇腾

比起技术本身,V4这次发布更受关注的还有与华为昇腾的协同。

V4技术报告第3.1节专门写了一句:“我们在英伟达GPU和华为昇腾NPU两个平台上均验证了细粒度EP(专家并行)方案。”这是DeepSeek官方第一次在正式文档中把华为昇腾和英伟达并列写进硬件验证清单。

报告同时披露,V4的MoE专家权重和稀疏注意力索引器都采用FP4精度,FP4(mxFP4)恰好是华为3月发布的昇腾950PR芯片的原生支持精度。

华为官网后续在全联接大会 2025 的主题演讲中确认,昇腾950系列新增支持 MXFP4 等低精度格式,其中950PR面向Prefill和推荐场景,并采用华为自研 HiBL 1.0,容量128GB,带宽1.6TB/s。

另外,面向训练场景的950DT计划今年四季度推出。

DeepSeek在官宣文章中还表示:“预计下半年昇腾950超节点批量上市并部署之后,Pro版本的价格也会大幅度下调。

推荐阅读

给DeepSeek的最后一封催更信

人民想念DeepSeek

一文读懂GPT-5.5:从今天起,OpenAI“不卖”Token了