跨本体、长任务、可预测……Motubrain双榜登顶只是一个开始

作者丨高景辉

编辑丨马晓宁

“机器人都能做后空翻、跑马拉松了,怎么还是干不了活?”

在有关具身机器人的视频评论区,我们总能看到这样的疑问。

的确,纵观行业当前的大部分具身机器人,在尝试“干活”的时候总会遇到尴尬场面:要么一次只能干一件事,一点都不“通用”;要么经常卡顿,需要人为干预;要么换了个机型,就动不了了。

这不禁令人疑惑:具身智能离真正帮我们干活,到底还有多远?

01

Motubrain 双榜登顶,

机器人干活能力有了 “合格线”

很多人把具身机器人干不了活,归咎为模型能力不足,无法胜任各种场景的干活需求。但事实果真如此吗?

人们想交给具身智能来干的活千千万万,既包含复杂的操作,也有相对简单的动作,能切入的方向理论上很多,按照目前行业顶尖模型的能力,未必不能驾驭。

所以,不能将具身智能干活难的问题,全算在“能力”头上。在能力之外,一个被忽视的问题是,大家对于“干活”的定义没有统一,究竟做到什么程度才算“能干活”?评价一个机器人干活的综合能力,又要看哪些方面的表现?

换句话说,如果不能用一张“试卷”考核机器人的干活能力,那么评判机器人的“干活”水平就将失去意义。

这种背景下,国际权威 Benchmark 榜单的参考价值被进一步放大。尤其是覆盖不同核心能力维度的多个榜单,综合来看能更全面地验证模型的商用潜力。

以最近的例子来说,不久前通用世界行动模型 Motubrain,就同时登顶 WorldArena 与 RoboTwin2.0 两大国际具身智能权威榜单。Motubrain 背后的生数科技,也渐渐浮出水面。

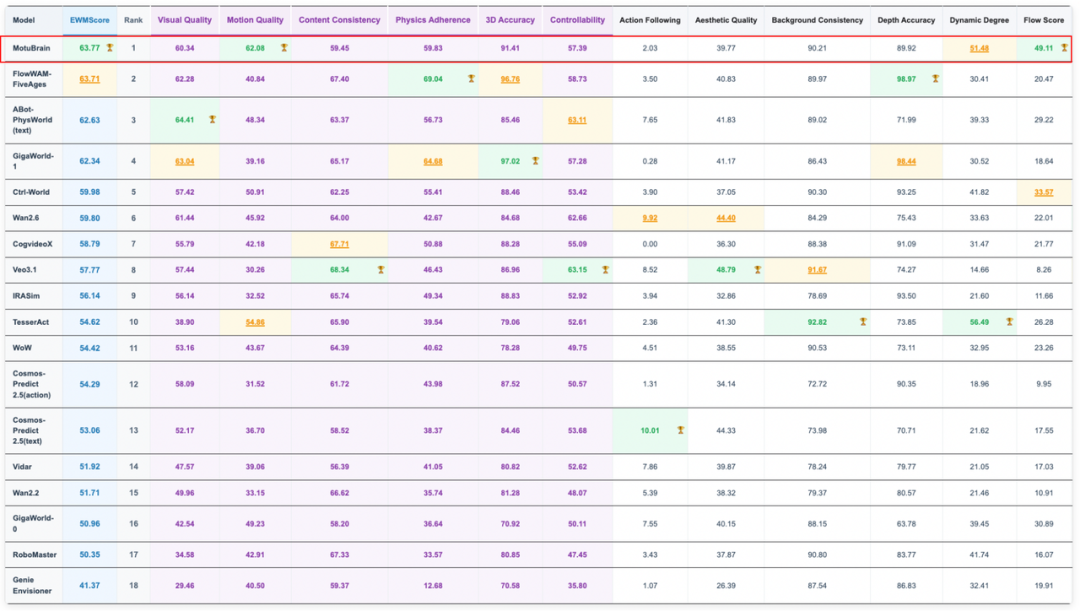

具体来看,WorldArena 榜单聚焦模型对真实世界的理解与预测能力,核心衡量模型对物理规律、运动变化、环境状态的认知水平。在该榜单中,Motubrain 总体 EWM Score 达到 63.77,位列总榜第一,同时在 Motion Quality、Flow Score、Motion Smoothness 等多个核心运动维度均拿下榜首。

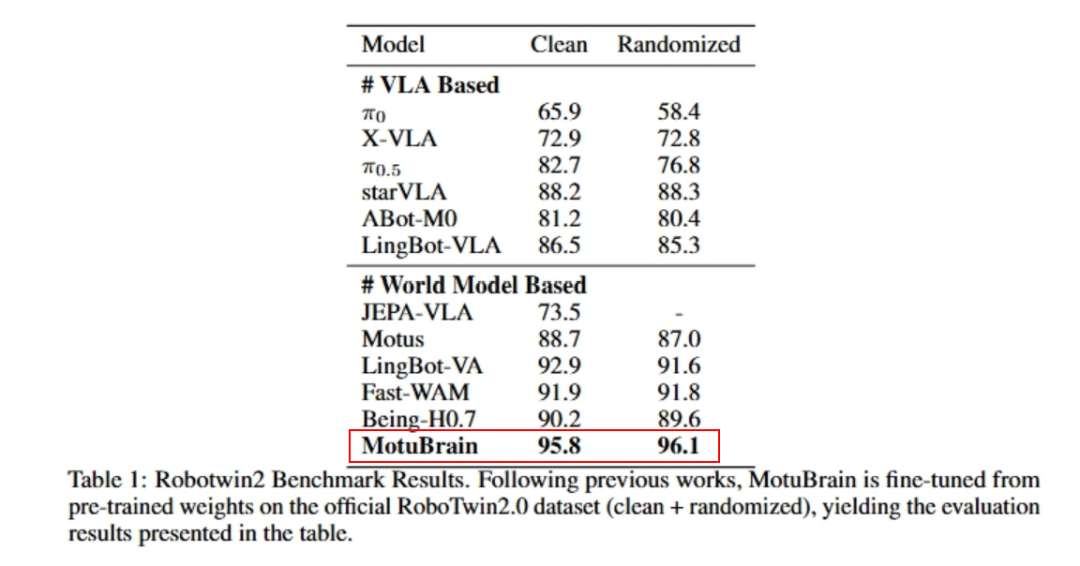

RoboTwin2.0 榜单则聚焦机器人的任务执行与泛化能力,衡量模型在多任务、多环境、随机扰动下的稳定执行表现。在该榜单中,Motubrain 在 Clean 与 Randomized 两个场景下分别取得 95.8 与 96.1 的成绩,位列总榜第一,也是榜单上唯一一个在随机环境下平均分超过 95 的模型。

过去,行业内的技术探索大多存在能力偏科。部分模型在世界建模维度表现突出,但无法转化为稳定的执行能力;部分模型能完成固定动作,却无法适配环境的随机变化。极少有模型能同时在世界理解与动作执行两个核心维度,做到行业顶尖水平。

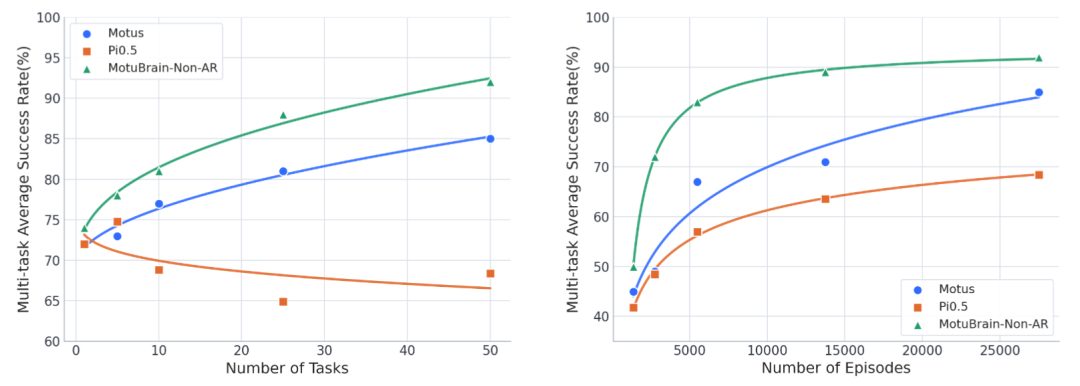

更多地,Motubrain展现出远高于VLA的多任务泛化性曲线和数据scaling曲线。从左图可以看出,随着任务数量增加,Pi-0.5成功率持续下降,而MotuBrain成功率持续上升——这说明它学到了跨任务的通用世界知识,这是 VLA 不具有的能力。

从右图可以看出,Motubrain 的在数据量上的 Scaling Law 曲线相比其他模型更陡峭,说明其数据效率非常高,仅用少量数据就可以取得很好的结果。

此外,任务数量的 scaling law 曲线比数据量更为陡峭,说明对于 Motubrain 这种数据效率极高的模型来说,相比于增加数据量,增加任务的多样性对成功率的提升效果更为显著。

所以,Motubrain 双榜同时登顶的核心价值,在于它确立了通用机器人大脑干活能力的参照系。两大榜单的核心维度,共同构成了通用机器人大脑“能干活”的合格线,也为未来具身智能在场景落地,注入了更强的确定性。

02

机器人“干活”,到底需要哪些模型能力?

既然有了参照系,就不可避免地要回答一个问题:机器人落地“干活”,到底需要哪些模型能力?

这个问题其实不难回答,看看我们「人」在干活的时候需要哪些能力就知道了。

比如餐馆的工作人员,一个人可能要身兼数职,包括点餐、送餐、收台、巡场甚至后厨协助,他们所需要的,是一种“通用”能力,放在具身模型上,就是一个“大脑”接管所有岗位,这就要求机器人的大脑能实现“一脑多能”。

这对于当下的顶尖大模型来说并非难事。比如 Motubrain 在多任务场景中能够保持稳定表现,而且随着任务数量持续增加,模型共享到的世界知识越多,平均任务成功率反而同步提升,且任务之间不再争夺模型容量,反而相互促进。

从生数科技发布的真机演示 Demo 可以看到,Motubrain 在“调酒”任务中,能抓取不同大小、材质的容器,并将酒一滴不撒地倒入酒杯中,也能抓取薄荷叶这类柔性物品。至少要具备这种程度的通用性,机器人才真正上得了岗。

还有,人在做家务活时需要足够“连贯”,一次性完成所有琐碎的动作。但很反直觉的是,家务活中对人来说简单不过的部分,对机器人很可能是相当复杂的。

比如“倒杯水”这个简单指令背后其实是一长串任务,包括抓取杯子、从厨房取一杯水、避开地上杂物、识别卧室门口、放在床头柜上并且不打翻药瓶……这中间涉及移动、抓取、避障、放置等多个动作,还夹杂环境变化。传统做法依赖上层任务拆解、状态机或快慢系统拼接,每一步都可能引入额外延迟和失败风险。

但如果像 Motubrain 一样有了“一脑贯通”能力,就能够直接学习完整任务链路,无需上层规划拼接,而且人类无需在中间反复干预,用户体验直线上升。毕竟,Motubrain 可以完成超过 10 个原子动作的复杂长程任务,而不是仅停留在两三个动作的演示阶段。

在生数科技发布的 Demo 中,Motubrain 演示了“插花”这一长程任务,包含多次捡花、插花的动作,以及多次拿起水壶喷水的动作,整个过程十分丝滑,像一个整体而非“分解动作”,似乎预示着“干家务”已难不倒具身模型了。

小红书上有不少人说,希望能有一个机器人“球搭子”,在约不到人的时候陪自己打打球,这种语境下打球也可以视为一种“干活”,但对机器人模型的“预测”能力有很高要求。因为像网球这类运动,其球速往往在每小时100km以上,已超过了当前机器人的硬件能力的上限,等感知到球再挥拍已来不及,必须在人击球时做出预测,这就依赖于世界模型的能力。

Motubrain 也确实是为数不多能实现“一脑预见”,将理解世界、预测世界和执行动作统一建模的模型。它不只是执行一步指令,而是能推演环境变化,并据此生成更合理的动作路径,而且预测球路和驱动身体挥拍会成为同一模型下的两种推理模式,延迟更低,决策更连贯。

当然,也有些问题是人不会遇到的,比如令无数模型厂商头疼的“泛化”问题。人都是同一个物种,身体结构都是一样的,基本不会出现多一个关节、少一个器官的情况。但机器人形态各异,构造无法保持一致,这就需要一种“一脑多型”的能力,让模型能够吸收生态内越来越丰富的异构数据。

Motubrain 的解决思路,是从一开始就面向多机器人本体。它不是为某一台机器量身定制,而是用统一的 action 表征打通不同本体,从而适配轮式、臂式、复合式等多种形态。随着机器人种类和场景不断增长,模型通用性持续提升,又会进一步反哺每一类机器人的实际表现。

那么,为什么 Motubrain 可以同时具备这四种能力?

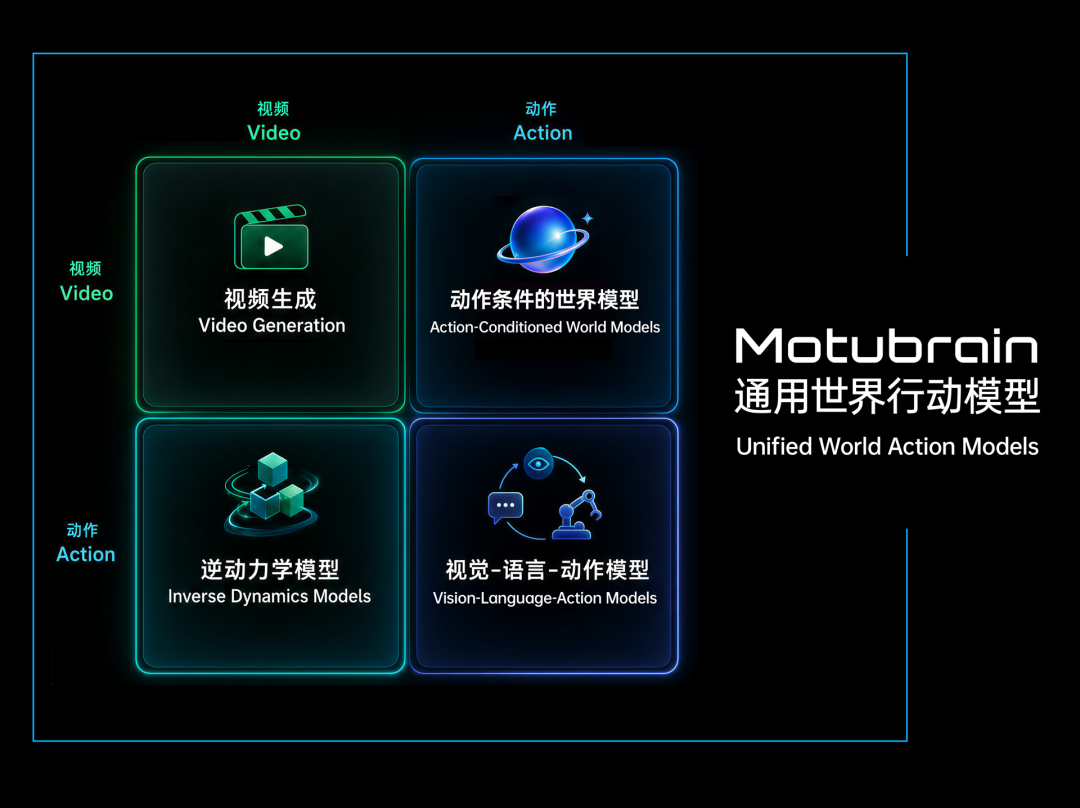

最根本的原因在于,Motubrain 是一个通用世界行动模型(WAM),其核心差异在于模型的训练范式——通过 UniDiffuser 统一建模和调度 video 与 action 两个连续模态。一次训练,即可推理出五类分布:视觉-语言-动作(VLA)、世界模型、视频生成、逆动力学、视频-动作联合预测。

这种大一统建模带来的直接结果是数据吸收能力的质变。传统 VLA 只能从特定机器人本体的完整任务轨迹数据中学习。Motubrain 可以同时利用缺少 action 模态的纯视频数据、缺少语言任务标签的任务无关数据,以及包含 video、action、language 的完整轨迹数据。模型学到的,是任务、环境变化和动作后果之间的共享世界知识。

这也是多任务正向 scaling 的根基:任务越多,共享的世界知识越丰富,模型平均成功率随之提升。

不过,Motubrain 并非“横空出世”的大模型,在此之前已有深厚的铺垫。

其实但凡对模型领域有了解的人,都能从名字猜出 Motubrain 和 Motus 之间的联系。早在2025年12月,生数科技就开源了 Motus,比行业早两个月提出并验证了 World Action Models 的核心思想。

在Motus的基础上,Motubrain完成了一次跃迁:用任意视角数量的统一建模打通不同相机配置,让模型不再依赖固定的视觉输入形态;用统一的 action 表征打通不同机器人本体;通过自回归+diffusion 和语言-动作-视频三流 MoT,让模型可以直接完成超过 10 个原子动作的长序列任务;并且让超大规模具身模型能够在机器人上实现云边端协同的实时闭环控制。

这五步跳跃,让 Motubrain 从一个学术验证型框架,直接切入了“干活”相关的高要求场景。

Motubrain详细内容请见:https://www.shengshu.com/zh/motubrain

03

从技术验证到产品落地,才是真正的挑战

做出一个能干活的模型,只是具身智能落地的第一步。下一步是把这种干活能力升级为一种产品力,它的难度往往不亚于技术研发本身。

以生数科技在多模态领域的另一款产品 Vidu 为例,其全自动一键成片、高质量批量生产视频的能力,广受创作型青睐,尤其是“AI解说剧”细分赛道,Vidu 已成为不少团队的首选。

这说明,技术上的领先优势固然重要,但能够把技术转化为客户愿意付费的产品,考验的是公司对真实场景需求的理解、对用户体验的打磨,以及对商业化路径的持续探索。而生数科技在多模态模型产品化的实操经验,对于具身智能方向的落地具有直接的迁移价值。

从 Motubrain 的模型发布到产品落地,生数科技已经开始了前置布局。今年3月,生数科技在2026中关村论坛年会上正式发布通用世界模型战略。公司以基座世界模型为核心底层,向上延伸出两条清晰的业务轨道:一条基于世界生成模型,在数字空间构建视频大模型产品 Vidu,推动数字内容的智能化生产;另一条基于世界行动模型,在物理空间构建世界模型产品 Motus,也就是 Motubrain 背后的统一平台。两条轨道共享同一个底层技术架构,形成数字世界与物理世界的双向贯通。

在物理空间的产业化推进上,生数科技也已经与无界动力、星尘智能、深朴智能等具身智能企业达成战略合作。这两次合作让 Motubrain 走出了“技术验证”的范畴,形成了“模型能力—本体适配—场景落地”的完整闭环。

总之,技术突破决定有没有,产业合作决定能不能用起来。两者结合,才能支撑具身智能从实验室走向真实场景的完整叙事。

最后回到本文的主题,具身智能离真正“能干活”还有多远?

答案或许比许多人想象的要近,但也比一些人期待的更远。

说“近”,是因为像 Motubrain 这样能够在世界建模和执行能力上同时站上行业最顶端的模型正在出现。双榜第一的意义不仅仅是技术指标的领先,而是它第一次为通用机器人大脑在落地之前竖起了一把标尺——我们知道了什么样的模型能力,至少具备了在真实场景中干活的潜力。

说“远”,是因为从模型突破到大规模部署之间,还有大量的工程化问题和产品化工作要做。机器人不只是模型,还要适配不同本体的硬件,要适应千差万别的物理环境,要在用户端形成真正好用的产品体验。这些都不是一蹴而就的事。

但至少有一点是确定的:过去几年困扰行业的最大瓶颈——机器人大脑缺乏统一、通用的智能能力——正在被一步步突破。当行业的上限在不断被刷新,距离机器人在物理世界帮我们干活,就不会太远了。

2026年的具身智能行业,正在从“技术验证”走向“规模落地”的关键节点上,等待那个“ChatGPT时刻”的到来。而Motubrain 的出现,可能是其中最值得关注的一个信号。

独家丨清华大学丁宁成立通用物理智能公司「自然意志」,估值40亿

独家丨被亚马逊收购后,Covariant 核心人物加入枢途科技

未经「AI科技评论」授权,严禁以任何方式在网页、论坛、社区进行转载!

公众号转载请先在「AI科技评论」后台留言取得授权,转载时需标注来源并插入本公众号名片。F

未经「AI科技评论」授权,严禁以任何方式在网页、论坛、社区进行转载!

公众号转载请先在「AI科技评论」后台留言取得授权,转载时需标注来源并插入本公众号名片。F