【报告】DeepSeek专题一:DeepSeek-V4技术报告(附PDF下载)

DeepSeek-V4 深度解析:百万上下文与混合专家架构如何重新定义大模型效率边界

引言:打破长序列效率瓶颈的新一代模型

大语言模型的推理能力与测试时扩展越来越依赖超长上下文处理能力。然而,传统注意力机制的二次计算复杂度成为了限制长序列推理的根本瓶颈。DeepSeek-V4系列正是为突破这一效率壁垒而生,它通过混合注意力架构、流形约束超连接(mHC)和Muon优化器等一系列创新,首次在开放模型中实现了对百万 token 上下文的高效原生支持。

本文将全面解读DeepSeek-V4技术报告中的核心内容,包括模型架构设计、训练与推理基础设施优化、预训练与后训练流程,以及在各类基准测试和真实场景中的表现。

一、模型总览:两大版本,各有所长

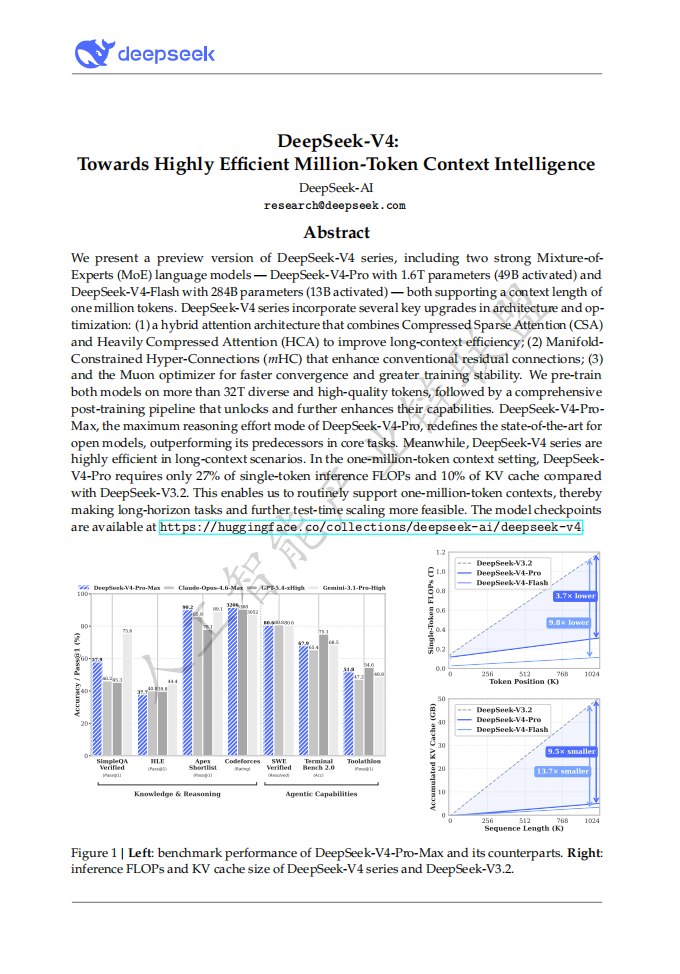

DeepSeek-V4系列目前推出两个预览版本:

• DeepSeek-V4-Pro:总参数量1.6万亿,激活参数量490亿(每次前向传播激活约490亿参数),支持百万 token 上下文。 • DeepSeek-V4-Flash:总参数量2840亿,激活参数量130亿,同样支持百万 token 上下文。

两个模型均采用混合专家(MoE)架构,在推理效率上相较前代DeepSeek-V3.2有显著提升。在百万 token 上下文中,DeepSeek-V4-Pro 的单 token 推理 FLOPs 仅为 DeepSeek-V3.2 的 27%,KV 缓存大小仅为后者的 10%。而更轻量的 DeepSeek-V4-Flash 则将这两个数字进一步压缩到了 10% 和 7%。

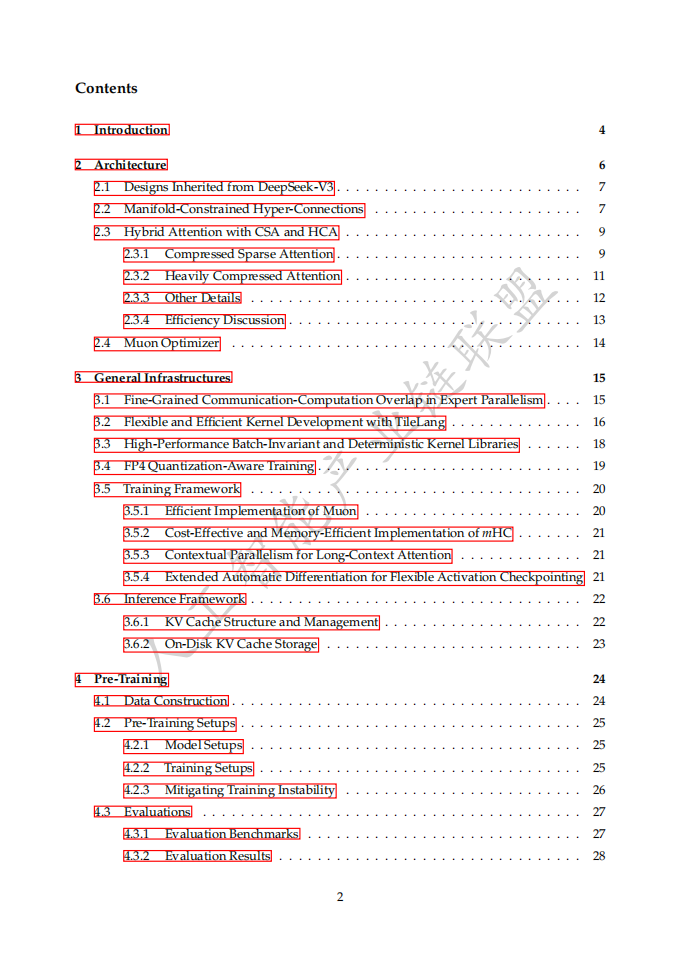

二、架构创新:从注意力到连接再到优化器

DeepSeek-V4系列保留了DeepSeek-V3中的DeepSeekMoE框架和多 token 预测(MTP)策略,同时引入了三项关键升级。

2.1 混合注意力:CSA + HCA

针对超长上下文,传统自注意力的计算和存储开销难以承受。DeepSeek-V4设计了两种互补的高效注意力机制:

• 压缩稀疏注意力(CSA)

CSA首先将每 m 个 token 的 KV 缓存压缩成一个条目,然后采用 DeepSeek 稀疏注意力(DSA)策略,每个 query token 仅关注 top‑k 个压缩后的 KV 条目。压缩率 m 设为 4,top‑k 为 512(Flash)或 1024(Pro)。CSA 还引入了一个轻量级索引器(lightning indexer),以低秩方式生成索引分数,从而高效筛选出最相关的压缩 KV 块。此外,为了避免因果掩码导致的信息丢失,CSA 额外增加了一条滑动窗口注意力分支,用于捕捉局部依赖关系。• 重度压缩注意力(HCA)

HCA 使用更大的压缩率 m′(设为128),将每 128 个 token 的 KV 压缩为一个条目,但不再进行稀疏选择,而是采用稠密注意力。这种方式适用于对全局信息要求更高的层次。

两种注意力在模型的不同层间交错使用,实现了效率与表达能力的平衡。此外,混合注意力还采用了多项实用技巧:查询和 KV 条目的 RMSNorm、部分旋转位置编码(RoPE)、额外的滑动窗口分支,以及注意力汇聚(attention sink)技术,允许每个注意力头调整总注意力分数近似为 0,从而更灵活地处理长文本。

2.2 流形约束超连接(mHC)

传统的残差连接在极深网络中容易出现信号传播不稳定的问题。DeepSeek-V4 引入了流形约束超连接(mHC),将传统残差连接升级为具有显式约束的超连接。

• 标准超连接(HC):将残差流的维度从 d 扩展到 n_hc × d,通过输入映射 A、残差变换 B 和输出映射 C 来更新状态。虽然 HC 可以提升模型容量,但多层的数值不稳定性限制了其扩展能力。 • mHC 的核心创新:将残差变换矩阵 B 约束为双随机矩阵(Birkhoff 多面体)——即行和与列和均为 1 且所有元素非负。如此一来,B 的谱范数被限制为 ≤1,使残差变换具有非扩张性,显著增强了前向和反向传播的数值稳定性。双随机矩阵集合对乘法封闭,因此在堆叠多层 mHC 时依然稳定。 • 动态参数化与约束施加:三个映射的参数由输入依赖的动态分量和输入独立的静态分量共同生成。对于输入映射 A 和输出映射 C,通过 Sigmoid 函数保证非负和有界;对于残差映射,则通过 Sinkhorn‑Knopp 算法(20 次迭代)将其投影到双随机流形上。

2.3 Muon 优化器

DeepSeek-V4 在大部分模块上采用了 Muon 优化器,以获得更快的收敛速度和更好的训练稳定性。只有 embedding 层、预测头、mHC 中的静态偏量和门控因子、RMSNorm 权重仍保持 AdamW 更新。

Muon 的核心是基于动量累积和牛顿‑舒尔茨(Newton‑Schulz)迭代的正交化步骤。DeepSeek-V4 采用了混合牛顿‑舒尔茨策略:前 8 次迭代使用一组系数实现快速收敛,后 2 次迭代改用另一组系数使奇异值精确稳定在 1。由于混合注意力中已经对查询和 KV 进行了 RMSNorm,因此无需使用 QK‑Clip 技术即可避免注意力 logits 爆炸。

三、基础设施:从训练到推理的全栈优化

为了支撑万亿参数 MoE 模型的高效训练与推理,DeepSeek-V4 团队在系统层面做了大量创新。

3.1 专家并行中的细粒度通信计算重叠

MoE 的专家并行(EP)需要跨节点通信。团队设计了一种细粒度的 EP 方案,将专家划分为多个波(wave),每个波内的通信完成后即刻开始计算,实现计算与通信的流水线重叠。在 DeepSeek-V4-Pro 的配置下,每个 token‑expert 对需要 6×h×d FLOPs,而通信量仅为 3h 字节。只要互联带宽满足 C/B ≤ 2d = 6144 FLOPs/Byte,通信就能被完全掩盖。这为未来硬件设计提供了明确的平衡点指导。

该方案在 NVIDIA GPU 和华为昇腾 NPU 上均获得 1.5~1.73 倍加速,在 RL rollout 等延迟敏感场景中最高达 1.96 倍。团队已将 CUDA 版 MegaMoE 内核开源。

3.2 TileLang:兼顾开发效率与运行性能的 DSL

DeepSeek-V4 使用 TileLang 领域特定语言开发了数百个融合内核,显著减少了 Python 调用开销。TileLang 的 Host Codegen 技术将原本数十甚至数百微秒的 CPU 侧验证开销降至 1 微秒以下。同时,集成 Z3 SMT 求解器进行形式化整数分析,自动验证张量索引边界、内存冲突等,解锁更激进的优化(如向量化)。在数值精度方面,默认禁用快速数学近似,并提供 IEEE 标准内建函数,确保位级可重现性,便于与手写 CUDA 基线比对。

3.3 批量不变性与确定性内核

为了保证预训练、后训练和推理之间的位级一致性,DeepSeek-V4 实现了批量不变(batch‑invariant)和确定性(deterministic)内核。

• 注意力:采用双内核策略,一个内核在单个 SM 内完整计算一个序列(高吞吐),另一个内核使用多 SM 处理部分填充波(低延迟),并精心设计累加顺序以确保位级相同。 • 矩阵乘法:完全替换为自研的 DeepGEMM,避免 cuBLAS 的非确定性;在极小 batch 下放弃 split‑k,通过其他优化达到甚至超越 split‑k 性能。 • MoE 反向:通过 token 顺序预重排和跨 rank 缓冲区分隔,保证确定性。 • mHC 小矩阵乘法:使用 split‑k 后单独输出各 split 部分,再通过确定性归约内核合并,兼顾性能与确定性。

3.4 FP4 量化感知训练

在后训练阶段引入 FP4(MXFP4)量化感知训练(QAT),应用于两个关键组件:

• MoE 专家权重:主优化器维护 FP32 主权重,前向时先量化到 FP4,再无损反量化为 FP8 计算(FP8 的动态范围大于 FP4,只要每个 FP8 量化块内的 FP4 子块尺度因子比值不超过一定阈值,即可完全吸收尺度信息)。反向时梯度按 FP8 权重计算并直接回传至 FP32 主权重(STE)。 • CSA 索引器的 QK 路径:QK 激活完全以 FP4 缓存、加载和相乘,加速长上下文下的注意力分数计算。同时将索引分数从 FP32 量化为 BF16,使 top‑k 选择器提速 2 倍,KV 条目召回率保持 99.7%。

在推理和 RL rollout 阶段,直接使用真实 FP4 权重,不再模拟量化,从而实际降低内存加载和提升速度。

3.5 训练框架的关键增强

• Muon + ZeRO 的混合策略:对于稠密参数,限制 ZeRO 并行度并用背包算法分配参数矩阵,每个 rank 管理不超过 5 个矩阵,填充开销 <10%;MoE 参数则展平后均匀分布,不设并行度上限。将 MoE 梯度随机舍入到 BF16 同步,通信量减半,并通过 all‑to‑all + 本地 FP32 求和保证数值稳定性。 • mHC 的内存与通信优化:设计融合内核,采用选择性重计算策略(重计算大部分隐藏状态和归一化层输入,避免重计算高开销操作),并调整 DualPipe 1F1B 流水线策略,使 mHC 的墙钟开销仅占流水线阶段的 6.7%。 • 长上下文并行(Contextual Parallelism):针对 CSA/HCA 的变长压缩特性设计两阶段通信方法,先交换跨 rank 的尾部未压缩 KV 以产生定长压缩块,再全收集后进行选择与填充,最终得到全局压缩 KV 序列。 • 张量级激活检查点:扩展自动微分,支持对单个张量标注检查点。框架自动反向遍历计算图,识别最小重计算子图,并复用存储指针,实现零拷贝重计算,且自动去重共享存储的张量。

3.6 推理框架的 KV 缓存管理

混合注意力产生了多种类型的 KV 条目,KV 缓存大小在不同层和不同分支(压缩与滑动窗口)间差异巨大。DeepSeek-V4 设计了异构 KV 缓存布局,并为滑动窗口注意力提供了三种磁盘缓存策略:

• 全量 SWA 缓存:存储所有 token 的 SWA KV,计算零冗余,但磁盘 I/O 不平衡。 • 周期检查点:每 p 个 token 检查一次最后 n_win 个 token 的 SWA KV,命中前缀时加载最近检查点并重计算尾部。 • 零 SWA 缓存:完全不存,仅重计算最后 n_win × L 个 token(L 为层数)即可恢复所有 SWA KV。

根据部署场景灵活选择,实现存储与计算的平衡。

四、预训练:数据与训练方案

DeepSeek-V4-Flash 在 32T token 上预训练,DeepSeek-V4-Pro 在 33T token 上预训练。数据构成在 DeepSeek-V3 基础上进一步优化:

• 过滤网络数据中的批量生成和模板内容,防止模型崩溃。 • 强化数学与编程语料,并在中训练阶段加入 agentic 数据提升代码能力。 • 扩大多语言语料,增强跨文化长尾知识的覆盖。 • 特别重视长文档(科学论文、技术报告等)的收集,体现学术价值。

训练策略:

• 序列长度从 4K 逐步增长到 16K、64K、1M。 • 前 1T token 使用稠密注意力预热,之后在 64K 长度时引入稀疏注意力,并先短时预热索引器。 • 批量大小调度(最大 Flash 75.5M token,Pro 94.4M token)。 • 学习率 warmup 2000 步,峰值 2.7e‑4(Flash)或 2.0e‑4(Pro),最后余弦衰减到 1/10。 • MTP 损失权重早期 0.3,学习率衰减后降为 0.1。 • 负载均衡:辅助损失自由策略 + 序列级平衡损失(权重 0.0001)。

4.2 训练稳定性缓解措施

万亿参数 MoE 训练极易出现 loss 尖峰。DeepSeek-V4 发现尖峰与 MoE 层中的异常值以及路由机制本身密切相关,为此提出了两个实用技巧:

• 预期路由(Anticipatory Routing):在第 t 步,特征计算使用当前参数 θ_t,但路由索引使用历史参数 θ_{t-Δt}。通过提前预计算路由索引并缓存,额外墙钟开销仅约 20%。系统还可以动态检测 loss 尖峰,临时启用预期路由一段时间后再切回标准模式。 • SwiGLU 截断:将 SwiGLU 的线性部分限制在 [-10,10],门控部分上限截断到 10。该操作有效消除异常值且不影响性能。

五、基础模型评估:效率与性能的双重胜利

在统一的内部评估框架下,DeepSeek-V4-Flash-Base 和 DeepSeek-V4-Pro-Base 与 DeepSeek-V3.2-Base 进行了全面对比:

• DeepSeek-V4-Flash-Base:以更少的激活参数(13B vs 37B)和总参数(284B vs 671B),在大多数世界知识、语言理解、长上下文基准上超越了 DeepSeek-V3.2-Base,展现了架构和数据优化的巨大红利。 • DeepSeek-V4-Pro-Base:进一步确立了全面优势,在推理、代码、长上下文和世界知识等几乎所有维度上均刷新了 DeepSeek 基础模型的记录。

具体来说,在 MMLU、MMLU-Pro、C-Eval、SimpleQA Verified、SuperGPQA、FACTS Parametric 等知识类基准上,Pro-Base 显著领先;在 BigCodeBench、HumanEval、GSM8K、MATH 等代码与数学任务上也有明显提升;在 LongBench-V2 长上下文任务中,Pro-Base 更是领先 V3.2-Base 超过 4 个百分点。

六、后训练:领域专家 + 同策略蒸馏

DeepSeek-V4 的后训练采用了全新的两阶段范式:先独立培养多个领域专家,再通过同策略蒸馏(OPD)合并为单一统一模型。

6.1 领域专家训练

针对数学、代码、智能体、指令跟随等领域,分别训练专家模型。每个专家经历:

• 领域特定数据上的监督微调(SFT) • 基于 GRPO 的强化学习,使用领域定制的奖励模型

对于推理任务,DeepSeek-V4 支持三种推理力度模式:

• Non‑think:快速直觉响应,用于日常任务。 • Think High:有意识的逻辑分析,用于复杂问题求解。 • Think Max:最大化推理深度,通过特殊系统提示强制模型穷举所有潜在路径、边缘情况和对抗场景。

三种模式通过不同的长度惩罚和上下文窗口微调得到,并用 <think> 标签区分。

在难以验证的任务上,DeepSeek-V4 放弃了传统的标量奖励模型,转而采用 生成式奖励模型(GRM),且对 GRM 本身进行 RL 优化。由于 GRM 与演员网络共享参数,模型的评判能力与生成能力相互融合,仅需极少的人类标注即可获得高度鲁棒的评分。

6.2 同策略蒸馏(OPD)

为了将多个领域专家的能力融合到一个模型中,DeepSeek-V4 采用了多教师 OPD。损失函数为:

L_OPD(θ) = Σ w_i · D_KL(π_θ || π_Ei)

即学生从自己的轨迹中学习,最小化与教师分布的反向 KL 散度。与以往用 token 级 KL 估计简化计算不同,DeepSeek-V4 实现了全词汇表 logit 蒸馏,获得更稳定的梯度估计和更忠实的知识迁移。

OPD 基础设施工程亮点:

• 教师调度:所有教师权重卸载到分布式存储,按需加载并采用 ZeRO 式分片。不直接存储 logits(词汇量 >10 万),而是仅缓存最后一层教师隐藏状态,训练时实时经过预测头重构 logits。按教师索引排序小批量,确保每个教师预测头一次只加载一个。 • FP4 加速:推理前向时直接使用 FP4 权重,训练时模拟 FP4→FP8 无损反量化,无缝复用 FP8 训练框架。 • 可抢占与容错 Rollout 服务:实现 token 粒度预写日志(WAL)。任务被抢占时保存 KV 缓存和 WAL;恢复时继续解码。致命硬件故障可通过 WAL 重放预填充阶段重建 KV 缓存,且避免了从头重新生成导致的长度偏置问题。 • 百万 token RL 优化:将 Rollout 数据拆分为轻量级元数据与重 per‑token 字段,通过共享内存加载器消除节点内数据冗余,动态决定 on‑device mini‑batch 数量以平衡计算与 I/O。 • 智能体沙箱 DSec:构建了基于 Rust 的生产级沙箱平台,支持函数调用、容器、microVM、fullVM 四种执行后端,通过分层存储和写时复制实现快速镜像加载,并在每集群管理数十万并发实例。轨迹日志支持预占恢复、精细溯源和确定性重放。

七、标准基准评估结果

7.1 知识与推理

• 知识:DeepSeek-V4-Pro-Max 在 SimpleQA Verified 上以 57.9% 的准确率大幅领先所有开源模型(领先约 20 个百分点),但在 MMLU-Pro、GPQA、HLE 等教育知识上仍略微落后于 Gemini‑3.1‑Pro。DeepSeek-V4-Flash-Max 则在知识任务上因参数量较小而明显弱于 Pro。 • 推理:DeepSeek-V4-Pro-Max 在 HMMT 2026 Feb 达到 95.2%,IMOAnswerBench 89.8%,Apex Shortlist 90.2%,超越了 GPT‑5.2 和 Gemini‑3.0‑Pro,但仍略逊于 GPT‑5.4 和 Gemini‑3.1‑Pro,大致落后前沿模型 3~6 个月。Flash‑Max 在同等推理预算下可与 GPT‑5.2 和 Gemini‑3.0‑Pro 相当。 • 代码:在 LiveCodeBench‑v6 上,Pro‑Max 达到 93.5% Pass@1,Codeforces 评分约 3206,与 GPT‑5.4 持平,成为首个在该任务上匹配闭源模型的开放模型。Pro‑Max 在 Codeforces 人类选手中排名第 23 位。 • 形式化数学:在 Putnam‑200(轻量级 agentic 环境)上取得 SOTA,在 Putnam‑2025(混合非形式‑形式推理)上达到完美 120/120,超越 Aristotle 等系统。

7.2 智能体

• 在 Terminal Bench 2.0、SWE Verified、SWE Pro、SWE Multilingual 上,Pro‑Max 与 K2.6 和 GLM‑5.1 相当,但仍落后于闭源模型。Pro‑Max 在内部评估中超越 Claude Sonnet 4.5,接近 Opus 4.5 水平。 • 在 MCPAtlas 和 Toolathlon 上表现良好,表明对多种工具和 MCP 服务具有出色的泛化能力。

7.3 百万上下文

• 在 MRCR(多针检索)上,Pro‑Max 得分 83.5%,优于 Gemini‑3.1‑Pro(76.3%),但低于 Claude Opus 4.6(92.9%)。在更真实的 CorpusQA 上,Pro‑Max 得分 62.0%,同样优于 Gemini‑3.1‑Pro(53.8%)。 • 检索性能在 128K 内高度稳定,1M 时虽有下降但仍显著优于同类竞品。

7.4 推理力度对比

从 Non‑think 到 High 再到 Max,越高的推理力度带来了越强的性能,尤其是在 HLE、Terminal Bench、SWE 等困难任务上。例如,HLE 从 Non‑think 的 7.7% 提升到 Max 的 37.7%。同时,Pro‑Max 的 token 效率也高于 DeepSeek‑V3.2‑Speciale,即在输出相同数量的推理 token 时获得更高的准确率。

八、真实世界任务表现

8.1 中文写作

• 应用文:DS‑V4‑Pro 对 Gemini‑3.1‑Pro 的整体胜率为 62.7% vs 34.1%。Gemini 有时会将自身风格偏好强加于中文写作场景。 • 创意写作:指令遵循胜率 60.0%,写作质量胜率 77.5%。但在最高难度的提示(如高复杂度约束或多轮交互)下,Claude Opus 4.5 仍以 52.0% 对 45.9% 略占优势。 • 办公文本、媒体文本、日常文本等细分品类中,DS‑V4‑Pro 普遍领先。

8.2 搜索

• 检索增强搜索(RAG):DS‑V4‑Pro 相比 DS‑V3.2 在客观问答和主观问答上均有大幅提升,尤其是在单值信息查找和规划策略类任务中增益最明显。 • 智能体搜索:允许模型迭代调用搜索和获取工具,在所有难度类别上均优于 RAG,而成本仅略高(工具调用平均 16.2 次,prefill token 约 1.36 万,output token 约 0.15 万)。

8.3 白领任务

构建了 30 个高级中文专业任务(涵盖金融、教育、法律、科技等 13 个行业)。盲测对比 DS‑V4‑Pro‑Max 与 Opus‑4.6‑Max:

• DS‑V4‑Pro‑Max 总体非损失率 63%,在分析、生成、编辑三类任务上均胜出。 • 优势维度:任务完成度和内容质量,模型能主动提供补充见解和自我验证步骤,长篇生成更深入连贯。 • 不足:偶尔忽略特定格式约束,简洁摘要能力偏弱,幻灯片整体视觉设计仍待提升。

8.4 代码智能体

从内部 50+ 工程师的日常工作中筛选出 30 个挑战性任务(涉及 PyTorch、CUDA、Rust、C++)。DS‑V4‑Pro‑Max 通过率 76%,远超 Claude Sonnet 4.5(47%),接近 Opus 4.5(73%)和 Opus 4.6 Thinking(80%)。内部调查(N=85)有 52% 的开发者愿意将 DS‑V4‑Pro 作为默认编码模型,39% 倾向愿意,仅 9% 拒绝。

九、结论、局限与未来方向

DeepSeek-V4 系列通过混合注意力(CSA+HCA)、mHC、Muon 以及全方位的基础设施优化,首次在开放模型中实现了百万 token 上下文的高效支持,并为测试时扩展、长时程任务和在线学习等新范式奠定了基础。

局限与未来工作:

• 为追求极端长上下文效率,架构变得相对复杂,未来将精简到最本质设计。 • 预期路由和 SwiGLU 截断虽有效,但理论基础尚不清晰,需要更系统的稳定性研究。 • 继续探索新的稀疏维度(如稀疏 embedding),降低低延迟部署的延迟,加强长时程多轮智能体任务,融合多模态能力,以及持续改进数据筛选与合成策略。

结语

DeepSeek-V4 系列不仅在大模型效率上实现了一次飞跃,更将百万长度上下文、强大的推理能力和灵活的智能体交互带入了开放模型社区。无论是轻量高效的 Flash 版本,还是追求极致性能的 Pro 版本,都代表了当前开源大模型的最前沿。期待 DeepSeek-V4 系列正式版带来更多惊喜,并为大模型在长上下文、推理和智能体应用领域开辟新的可能性。

(完整技术报告及模型权重已开源:https://huggingface.co/collections/deepseek-ai/deepseek-v4)

☟☟☟

☞人工智能产业链联盟筹备组征集公告☜

☝

精选报告推荐:

Openclaw龙虾专题:

【报告】Openclaw龙虾专题一:清华大学-龙虾OpenClaw发展研究报告1.0版(附PDF下载)

【报告】Openclaw龙虾专题二:清华大学-龙虾OpenClaw自我研究报告1.0版(附PDF下载)

【报告】Openclaw龙虾专题三:2026年部OpenClaw代理解决方案(附PDF下载)

【报告】Openclaw龙虾专题四:OpenClaw发展研究报告2.0版--深度研究报告(附PDF下载)

【报告】Openclaw龙虾专题五:OpenClaw蓝皮书:人人都能拥有的AI常驻助手(附PDF下载)

【报告】Openclaw龙虾专题六:OpenClaw未来可能方向研究报告(附PDF下载)

【报告】Openclaw龙虾专题七:OpenClawAI从聊天到行动下一代智能助手白皮书(附PDF下载)

【报告】Openclaw专题八:2026年OpenClaw安全部与实践指南(360护航版)(附PDF下载)

【报告】Openclaw专题九:2026年OpenClaw入门指南-当AI长出了手脚:一份给聪明人的理性上手手册(附PDF下载)

【报告】Openclaw专题十:OpenClaw新手入门宝典(附PDF下载)

【报告】Openclaw专题十一:腾讯2026最全企业级安全养虾教程(附PDF下载)

【报告】Openclaw专题十二:OpenClaw养虾全景报告(附PDF下载)

【报告】OpenClaw专题十三:吹响AIAgent时代号角(附PDF下载)

【报告】OpenClaw专题十四:OpenClaw从入门到精通指南一-技能提升必看2026(附PDF下载)

【报告】OpenClaw专题十五:OpenClaw深度调研报告-从对话到执行的AI智能体革命(附PDF下载)

【报告】OpenClaw专题十六:厦门大学-智能体OpenClaw(小龙虾)应用实践(附PDF下载)

【报告】OpenClaw专题十七:龙虾全自动科研报告一-OpenClaw替我干科研(附PDF下载)

【报告】OpenClaw专题十八:投研人如何养“虾”?(附PDF下载)

【报告】OpenClaw专题十九:清华大学:OpenClaw与数字员工研究报告(附PDF下载)

【报告】OpenClaw专题二十:2026年OpenClaw生态威胁分析报告(附PDF下载)

【报告】OpenClaw专题二十一:清华&北航:OpenClaw科研手册实操精简版(附PDF下载)

【报告】OpenClaw专题二十二:政企版龙虾OpenClaw安全使用指南(2026)(附PDF下载)

【报告】OpenClaw专题二十三:九章智算云:2026年OpenClaw安全操作指南报告(附PDF下载)

【报告】OpenClaw专题二十四:北京大学:OpenClaw001龙虾使用入门(2026年)(附PDF下载)

【报告】OpenClaw专题二十五:OpenClaw:驯化还是进化?(附PDF下载)

【报告】OpenClaw专题二十六:北京大学:龙虾第三次AI平民化自主Agent时代到来(附PDF下载)

【报告】OpenClaw专题二十七:腾讯云智能体开发平台企业级ADPClaw最佳实践与教程(附PDF下载)

【报告】OpenClaw专题二十八:AI原生组织:OpenClaw推动组织形态重塑(附PDF下载)

【报告】OpenClaw专题二十九:龙虾(OpenClaw)管理学-面向Al Agent 时代的组织设计、流程治理与经营控制(附PDF下载)

【报告】OpenClaw专题三十:2026阿里云DataClaw帮你“智”动驾驶数据库(附PDF下载)

【报告】OpenClaw专题三十一:2026年DataClaw:如何让+Agent安全访问数据报告(附PDF下载)

【报告】OpenClaw专题三十二:清华大学:2026驾驭工程(HarnessEngineering)研究报告(附PDF下载)

【报告】OpenClaw专题三十三:OpenClaw深度测评与应用指南-2026年(附PDF下载)

【报告】OpenClaw专题三十四:AIAgent智能体行业深度:OpenClaw、市场空间、新变化、产业链及相关公司深度梳理(附PDF下载)

11份清华大学的DeepSeek教程,全都给你打包好了,直接领取:

【清华第四版】DeepSeek+DeepResearch让科研像聊天一样简单?

【清华第七版】文科生零基础AI编程:快速提升想象力和实操能力

【清华第十一版】2025AI赋能教育:高考志愿填报工具使用指南

10份北京大学的DeepSeek教程

【北京大学第五版】Deepseek应用场景中需要关注的十个安全问题和防范措施

【北京大学第九版】AI+Agent与Agentic+AI的原理和应用洞察与未来展望

【北京大学第十版】DeepSeek在教育和学术领域的应用场景与案例(上中下合集)

8份浙江大学的DeepSeek专题系列教程

浙江大学DeepSeek专题系列一--吴飞:DeepSeek-回望AI三大主义与加强通识教育

浙江大学DeepSeek专题系列二--陈文智:Chatting or Acting-DeepSeek的突破边界与浙大先生的未来图景

浙江大学DeepSeek专题系列三--孙凌云:DeepSeek:智能时代的全面到来和人机协作的新常态

浙江大学DeepSeek专题系列四--王则可:DeepSeek模型优势:算力、成本角度解读

浙江大学DeepSeek专题系列五--陈静远:语言解码双生花:人类经验与AI算法的镜像之旅

浙江大学DeepSeek专题系列六--吴超:走向数字社会:从Deepseek到群体智慧

浙江大学DeepSeek专题系列七--朱朝阳:DeepSeek之火,可以燎原

浙江大学DeepSeek专题系列八--陈建海:DeepSeek的本地化部署与AI通识教育之未来

4份51CTO的《DeepSeek入门宝典》

51CTO:《DeepSeek入门宝典》:第1册-技术解析篇

51CTO:《DeepSeek入门宝典》:第2册-开发实战篇

51CTO:《DeepSeek入门宝典》:第3册-行业应用篇

51CTO:《DeepSeek入门宝典》:第4册-个人使用篇

5份厦门大学的DeepSeek教程

【厦门大学第一版】DeepSeek大模型概念、技术与应用实践

【厦门大学第五版】DeepSeek等大模型工具使用手册-实战篇

10份浙江大学的DeepSeek公开课第二季专题系列教程

【精选报告】浙江大学公开课第二季:《DeepSeek技术溯源及前沿探索》(附PDF下载)

【精选报告】浙江大学公开课第二季:2025从大模型、智能体到复杂AI应用系统的构建——以产业大脑为例(附PDF下载)

【精选报告】浙江大学公开课第二季:智能金融——AI驱动的金融变革(附PDF下载)

【精选报告】浙江大学公开课第二季:人工智能重塑科学与工程研究(附PDF下载)

【精选报告】浙江大学公开课第二季:生成式人工智能赋能智慧司法及相关思考(附PDF下载)

【精选报告】浙江大学公开课第二季:AI大模型如何破局传统医疗(附PDF下载)

【精选报告】浙江大学公开课第二季:2025年大模型:从单词接龙到行业落地报告(附PDF下载)

【精选报告】浙江大学公开课第二季:2025大小模型端云协同赋能人机交互报告(附PDF下载)

【精选报告】浙江大学公开课第二季:DeepSeek时代:让AI更懂中国文化的美与善(附PDF下载)

【精选报告】浙江大学公开课第二季:智能音乐生成:理解·反馈·融合(附PDF下载)

6份浙江大学的DeepSeek公开课第三季专题系列教程

【精选报告】浙江大学公开课第三季:走进海洋人工智能的未来(附PDF下载)

【精选报告】浙江大学公开课第三季:当艺术遇见AI:科艺融合的新探索(附PDF下载)

【精选报告】浙江大学公开课第三季:AI+BME,迈向智慧医疗健康——浙大的探索与实践(附PDF下载)

【精选报告】浙江大学公开课第三季:心理学与人工智能(附PDF下载)

【精选报告】浙江大学公开课第三季:人工智能赋能交通运输系统——关键技术与应用(附PDF下载)

【精选报告】浙江大学公开课第三季:人工智能与道德进步(附PDF下载)

篇幅有限,部分展示 加入会员,任意下载 资料下载方式

Download method of report materials

关注公众号后回复:DS260429 即可领取完整版资料

荐: 【中国风动漫】《姜子牙》刷屏背后,藏着中国动画100年内幕! 【中国风动漫】除了《哪吒》,这些良心国产动画也应该被更多人知道!

【中国风动漫】《雾山五行》大火,却很少人知道它的前身《岁城璃心》一个拿着十米大刀的男主夭折!

如需获取更多报告

报告部分截图

编辑:Zero

文末福利

1.赠送800G人工智能资源。

获取方式:关注本公众号,回复“人工智能”。

2.「超级公开课NVIDIA专场」免费下载

获取方式:关注本公众号,回复“公开课”。

3.免费微信交流群:

人工智能行业研究报告分享群、

人工智能知识分享群、

智能机器人交流论坛、

人工智能厂家交流群、

AI产业链服务交流群、

STEAM创客教育交流群、

人工智能技术论坛、

人工智能未来发展论坛、

AI企业家交流俱乐部

雄安企业家交流俱乐部

细分领域交流群:

【智能家居系统论坛】【智慧城市系统论坛】【智能医疗养老论坛】【自动驾驶产业论坛】【智慧金融交流论坛】【智慧农业交流论坛】【无人飞行器产业论坛】【人工智能大数据论坛】【人工智能※区块链论坛】【人工智能&物联网论坛】【青少年教育机器人论坛】【人工智能智能制造论坛】【AI/AR/VR/MR畅享畅聊】【机械自动化交流论坛】【工业互联网交流论坛】

入群方式:关注本公众号,回复“入群”

戳“阅读原文”下载报告。