深度|对话a16z:当Bot比真人还多,互联网必须重建「人籍」认证系统

图片来源:a16z

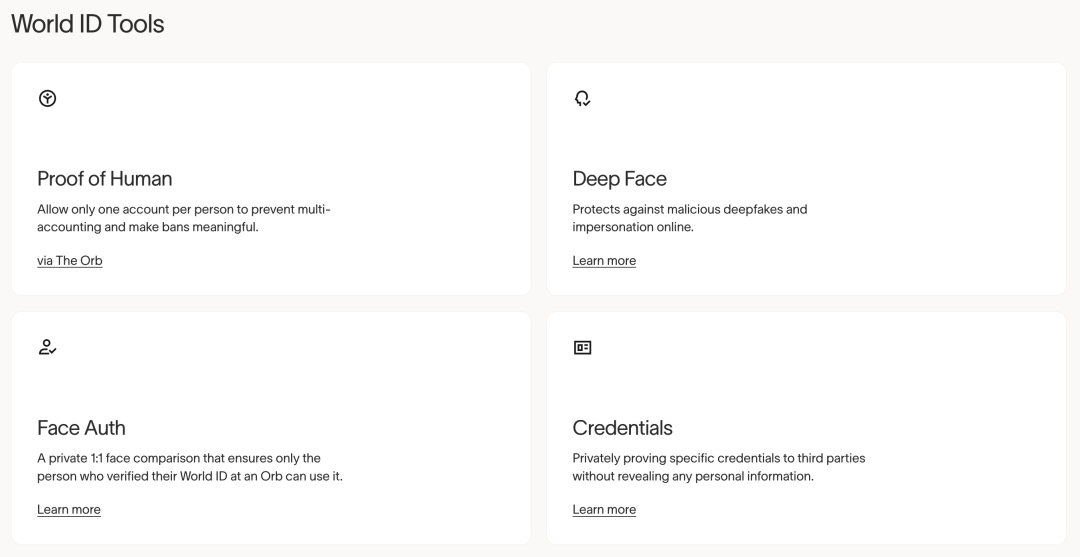

今天我们要聊一个听起来有点科幻、但正在迅速变成现实的问题:在 AI Agent、deepfake 和机器人账号泛滥之后,互联网还怎么证明「你是人」?

本期嘉宾是 Alex Blania,World 及其核心技术公司 Tools for Humanity 的联合创始人兼 CEO。他在 2019 年与 Sam Altman 共同创办 World,试图为 AI 时代建立一套新的「真人身份证明」基础设施:通过 Orb 设备完成线下初始核验,再用 World ID 在互联网上匿名证明「我是一个独一无二的人类」。

这次对话由 a16z 的 Ben Horowitz 与 Erik Torenberg 发起,核心讨论的是 Proof of Human:当 AI 能发帖、开 GitHub、约会、打视频会议、甚至替另一个 AI 作证时,互联网的信任底座会被怎样重写。

本文的主要观点包括:

Proof of Human 为什么突然变成现实问题

Alex Blania:你如何证明某个人是真人?这其实是一个出乎意料地困难的问题。我认为,人们将开始被指控是 bots。我们现在看到的,只会是大概一两年后情况的不到 1%。AGI 将会带来某种非常根本性的转变——这种想法……似乎是显而易见的。比如,AI在给人类编程这件事上真的非常擅长,比 人类给 AI编程要强得多。一个 AI 将能够拥有一个 GitHub 账户,也将能够发帖,甚至还能够为另外五个 AIs 作证明,说这些实际上都是真人,尽管它们并不是。说实话,如果你现在还不认真对待这件事——

Ben Horowitz:Alex,欢迎来到这档播客。很高兴你能来。

Alex Blania:感谢邀请。

Ben Horowitz:所以,Proof of Human (真人身份证明)现在正处在一个受到高度关注的时刻。你不如先给不熟悉的人介绍一下背景?现在正在发生的这个“时刻”是什么,我们又是怎么走到这里的?对。还有,什么是Proof of Human?

Alex Blania:Proof of Human,正如这个名字所展示的,就是,你是否知道你是在和一个真人互动,还是在和互联网上别的什么东西互动?而且我其实认为,我们现在正在提出的问题是:你是在和一个 human 互动,还是在和一个代表真人行事的 Agent 互动,还是仅仅在和一个 Agent 互动?我觉得这大致就是我们想要区分开的三个——三个区域。

Ben Horowitz:好,那再稍微描述一下,“只是一个 Agent”和“一个代表真人行事的 Agent”之间的区别。你是怎么理解这个区分的?

Alex Blania:对。所以,先快速解释一下 Proof of Human 这个术语本身,以及我认为它难在哪里,然后我会解释这和“代表真人行事的 Agent”之间是如何关联起来的。所以,Proof of Human 真正的意思是每一个在一个平台上互动的个体,都只有一个——理想情况下只有一个——账户,或者说数量有限的账户,并且始终是那个账户的拥有者。就像,这有点就是你要寻找的那个属性。你要寻找的是一种初始核验,它理想情况下应该是匿名的,或者是极度保护个人隐私的;然后还要有持续进行的后续认证,以确保始终是同一个人在控制这个账户。

Alex Blania:嗯,然后还有一些我认为最好也具备的次级属性。但这其实已经告诉你,真正困难的地方在于 uniqueness。像现在在 Twitter 这样的平台上发生的事情是,有所有这些账户,你知道,所有这些出现在回复区里的 bots,嗯,很可能某个地方坐着一个 人,然后放出了数以万计、甚至数十万个 AIs。于是就有这样一场追赶游戏:Twitter 和 X 只能试图找到它们,并且一天可能要封掉数百万个这样的东西,而这大概只是 bots 的百分之一?然后我认为,“代表 人类行事的 Agent”将来可能会是这样一种样子:呃,我作为一个……我觉得我们所有人都会有 Agents。具体会是什么样子还不清楚。是会只有一个,还是会有多个,也许承担不同的任务,甚至——甚至具有不同类型的角色设定?嗯,我觉得最后会变成:我批准我的 Agent 采取某个行动,我赋予他某些权利。比如说,“代表我行事”,“好,替我在我的 X账号上发帖,替我发到我的 Instagram 上”,举例来说。但那个 Instagram 是我的,而且我是拥有它的一个独特的人类。没错。你知道,然后 X 或 Instagram 就可以决定,作为一个平台,它们到底是否想要这样的东西,对吧?但这就是一种可行的做法。

Ben Horowitz:这说得通。嗯,所以你要怎么证明某个人是 human 呢?

Alex Blania:这其实是一个出乎意料地困难的问题。那些 Agent 非常聪明。我们几年前创办这家公司时,ChatGPT 还没有出现,但我们当时就有一个基本判断:最终,AI 一方面会通过图灵测试,能够声称自己是真人,而你在互联网上将无法再分辨;另一方面,它们也会具备很强的自主行动能力,能够四处活动、自己完成各种事情。

这也正是问题困难所在。我们创办公司时,外界主要有三种思路。

第一种是web of trust。核心做法是根据一个人在互联网上的行为,或其过往行为来判断身份。比如,你拥有若干个已经使用多年的账户,会定期发帖,或者长期在 GitHub 上评论。再比如,假设我们三个人都具备这些特征,而我还能为你作证,证明我在现实世界中认识你。这样就能逐步构建出一张关系图谱。这在当时是非常热门的想法。

但我们几乎立刻就放弃了这种思路,因为我们的判断是:凡是纯数字化的东西,AI 最终都能够做到。现在其实已经差不多到了这个阶段。AI 可以拥有一个 GitHub account,可以发帖、持有 account,也可以为另外五个 AI 作证,说它们是真人,尽管它们并不是。所以,这是第一类思路的问题。

第二类思路是,对所有事情都使用政府身份证件。我们也几乎立刻排除了这个方案,原因有几个。

其一,从言论自由以及基础设施权力分散的角度看,不由政府控制这样的基础设施会更好。其二,一旦采用这种方式,你几乎立刻就会失去匿名性。理论上,也许可以设计出某种仍能保留匿名性的系统,但这会非常困难。

此外,政府身份系统本来也不是为这个问题设计的。而这个问题最难的一点在于,它是一个全球性问题。所以,即便某个政府拥有非常完善的基础设施,也仍然无法真正解决问题。比如,新加坡就是政府基础设施非常完善的例子,但这几乎并没有那么重要。因为像 Meta 这样的产品是全球性的,拥有 30 亿用户,覆盖大量其他国家。

Ben Horowitz:对,新加坡大概只有……200 万人?

Alex Blania:500 万人,没错。难道你要把其他所有人都排除在外吗?除此之外,还有一长串别的原因,让我们几乎立刻否定了这个方向。

最后一种思路是生物识别。可一提到这个,人的第一反应通常就是抗拒。而且问题更复杂。正如我一开始说的,这个问题真正困难的地方在于唯一性。

用最简单的话说,Face ID 是怎么工作的?它检查的是:现在使用我手机的人,是不是同一个我。

所以,它是一种 one-to-one authentication。手机里存着一个 embedding。系统拍一张我的脸,生成一个新的表示,再与之前那个做比较;如果足够接近,我就可以使用手机。

但这本质上仍然是 one-to-one,也就是一个 embedding 对一个新的 embedding。可如果你要解决 Proof of Human 问题,你需要做的是:把一个新的个体与所有既有个体区分开来。你需要确保,Ben 现在正在尝试注册,而且他以前没有注册过。

这样一来,问题就从 one-to-one 变成了 one-to-N,而这个 N,本质上就是你要向其证明这一点的整个网络规模。然后你就可以从数学熵、也就是信息论的角度,算出完成这种证明究竟需要多少信息。

结果会发现,这个数字非常高,因为这是一个指数级问题。所以你一算就会知道,像人脸或指纹这类生物特征,并不足以解决这个问题。大概到几千万用户规模时,你就会撞上天花板。于是最后你会发现,眼部的这部分组织——才真正具备足够的熵,能够做到唯一。

真正难点不是识别,而是唯一性

Ben Horowitz:那你们又是怎么解决另一个问题的?因为生物识别历来一直容易受到重放攻击的影响。也就是说,好,就算我没有你的眼部生物信息,但我可能已经掌握了足够多的信息,可以对你发起重放攻击。

Alex Blania:所以,我觉得还是要把问题拆开来看:一部分是初始核验——用传统的话说,就像你去领取护照;另一部分是后续认证,也就是你在某些场景下持续出示护照。

在初始核验这一侧,如果你了解 World,就会知道我们做了一个叫 Orb 的设备。它做了很多事情来防止这类攻击。比如,它在电磁谱上配置了多个传感器,用来确保你不能拿一块显示屏对着它,而它却误以为那是真实对象。我觉得在这一侧,我们已经把这个问题处理好了。

但在消费者侧,也就是后续重新验证这件事上,问题就要难得多。因为在某种意义上,你需要信任手机。本质上,当你通过 Orb 完成初始核验时,我们不仅会以完全匿名且保护隐私的方式检查你的唯一性——这部分我们等会儿也可以展开讲——还会向你的手机发送一张经过签名的人脸图像,之后你可以用它来做重后续认证。

如果是新款 iPhone,这套机制是可以建立起相当程度信任的;但如果是比较旧的 Android设备,基本上就不行。因为你完全可以展示一个 深度伪造,不管是通过显示器播放出来,还是直接注入摄像头画面。

所以,这确实是个问题。最终可能会变成一种混合方案:如果你用的是足够新的 iPhone,或者更一般地说,足够新的手机,那么你就可以直接基于初始核验时采集的那张图片完成再次认证。否则,你可能就得比较频繁地回到 Orb 去重新认证。比如说,如果你用的是较旧设备,可能一年要去几次。

Ben Horowitz:有意思。另外,早期外界对这套方案有一种不太准确的批评,说“天哪,他们拿到了我的 眼部生物信息”。意思是,他们因此就能接触到我的隐私,对我做各种事情;那成了我的通行证,接着 Worldcoin 就可以 冒充 我,诸如此类。但事实并不是这样。而且,这背后其实也是一个并不简单的工程问题。

Alex Blania:确实,这在工程上非常不简单。关于iris,有一点大家往往没有充分意识到,而这也是我们当时的一个判断:iris 最终会成为一种非常日常的识别模态。原因是,我认为未来我们都会佩戴 AR 和 VR 系统,而这些设备都会用到它。Apple 已经这么做了,Vision Pro 里已经有 Optic ID。更一般地说,iris 很可能会在很多不同设备上被广泛使用,并逐渐变得常态化。

但在隐私这件事上,我们确实花了很多时间。因为大约 6 年前,当我们基于这些前提得出结论:要解决这个问题,需要一台专门用于生物识别的定制硬件设备时,这其实是一个相当令人畏惧的结论。因为这意味着极高的成本,而且这种设备还需要被部署到全球各地,这实际上意味着你必须设法筹集数十亿美元,并推动一场全球范围的大规模部署。

除此之外,还有隐私层面的挑战:你要如何构建这样一个系统,使它同时满足我们关心的所有要求?从高层看,解决这个问题主要有两种思路:multi-party computation 和zero-knowledge proofs。

还是回到 Face ID。Face ID 之所以能很好地保护隐私,是因为它的 embedding 存在手机里,不需要离开设备。本质上,它只是“现在的你”和“过去的你”之间做比较。但如果你要检查唯一性,就必须把新来的人和所有已经存在的人进行比对,所以必然会有某种信息离开设备。

这也正是更难的地方。我们的做法是使用multi-party computation。在我们的系统里,当你通过 Orb 完成初始核验时,设备会拍摄图像,并直接在本地完成计算。然后,这些结果会被拆分成多个部分。比如,我们会拍摄 iris 图像,计算出一个 iris code,再把它切分成多个片段,分别发送给多台计算机。这样一来,就不存在中心化数据库,也没有任何单一一方真正掌握你的完整信息。接着,再通过一些巧妙的方法,让这些不同参与方在各自只持有局部片段的前提下,共同完成计算。

Ben Horowitz:对,这样就没有任何人拿到完整的数据。

Alex Blania:对,没有任何人持有完整数据,而且在计算过程中,也没有任何人会拿到完整数据。但这些参与方会通过一些精巧的交互,最终得出结论。这有点像 zero-knowledge proof 的技术思路。它当然和 zero-knowledge proof 很不一样,但如果从它实现的性质来看,两者有些相似:没有人真正知道关于你的完整信息,但大家却可以共同得出一个关于你的判断。

所以,你把这些信息送入 multi-party computation,返回的结果会是:“这个个体是唯一的。” 接着我们做的第二件事,是再通过 zero-knowledge proof 把这一切和你的真实身份分离开。也就是说,那个保密凭证保存在你的手机上,只有你自己持有,其他任何人都没有。服务器没有,我们也没有。

之后,你可以再回到这套 multi-party computation 体系,对外证明:“我持有一个属于那次计算的保密凭证,而且我确实是唯一的。” 你可以把这一点证明给某个平台。比如,你可以去一个社交网络,向它证明你是一个唯一用户,而在这个过程中,我们并不知道你是谁,社交网络也不知道你是谁。

所以,这是一种非常反直觉的性质:虽然系统使用了生物识别技术,但你依然可以保持匿名,并且维持极高的隐私。我觉得这非常酷。

从 Tinder 到 YouTube:真人证明会先在哪些场景爆发

Eric Madsen:你知道,社交媒体只是其中一种典型场景。过去这些问题只是“烦人”,现在则正在变得“难以承受”,尤其是 bots、PSYOPs、propaganda 之类的东西。除了社交媒体之外,还有哪些 bots 的使用场景,会在未来如果没有 Proof of Human 的情况下,变得几乎无法忍受?

Alex Blania:对。其实我对这件事的一个简单理解是:凡是互联网上那些本质上以真人彼此互动为核心的时刻——或者哪怕只是间接互动——都会受到影响。最简单的例子之一就是约会。这个场景里,对面到底是不是一个真实的人,这件事非常重要。

至于 Tinder 的 use case 是什么——我们最早是在日本启动的,把它当作一个测试市场。它的机制本质上就是我们刚才讨论的内容:如果你通过 Orb 完成验证,你就会得到一个小徽章,向其他人表明你确实是一个 human,也就是说你经过了较高强度的 初始核验。

另外,接下来的一步——我不确定现在是否已经上线——是进一步验证你是否真的是你声称的那个人。也就是说,你的 world ID 会与你使用的 头像 关联起来,再做一次快速检查,确认这些信息是一致的。这样一来,你不仅知道自己不是在和 bot 互动,也知道你面对的是一个完全真实的人。

还有一个很有意思、但又有点反直觉的场景,我觉得会是视频会议。因为现在其实已经有 deepfakes 了。

比如,“我今天不想参加这个视频会议了,直接把我的 deepfake 挂上去吧。” 实际上,最早是你先跟我提到这个问题,所以我们才开始为此做产品。因为它很可能会先从高价值用户群体中出现。比如像你这样管理 fund 的人,有时候一通电话本身就可能价值极高,可能涉及借款之类的事情,或者——

Eric Madsen:对。就是说,有人可以冒充我,然后说:“Eric,你能不能把 4 亿美元汇给这位尼日利亚王子?” 对吧?

Alex Blania:对。现在这还算是略带一点假设性,因为这些技术还没有做到完全实时,你多少还能看出一些端倪——但我们已经非常接近了。真的非常接近。所以我认为,一年之后,这种能力就会变成一种完全商品化的东西:极其逼真、完全实时,到那时你在这些媒介上将几乎无法再判断任何事情。

所以我觉得这是另一个重要场景。再往下一个我觉得挺有意思的,会是游戏。

因为玩家非常在意——他们不想自己在和 AI 对战。这会让人非常挫败,尤其是当你们还在赌钱的时候。

你每天训练好几个小时,好不容易把自己练得很强,结果突然被一个在各个维度上都超越人类的 AI 彻底碾压。心智模型:我觉得连 视频平台的整个商业模式可能都快要被打破了。这个问题有好几个维度,但其中一个是:如果内容创作正在变得可以被无限扩展……比如我听说有个人在 YouTube 上一天可以生产大约一百个视频,而且每个月赚几万美元,这些视频全部都是 AI 生成的。

而且人们真的就买账了。所以问题就变成:YouTube 真的希望以这种方式去 实现变现 这类内容吗?这到底是不是——

Ben Horowitz:对,这就很有意思了。人们的确接受了它,但也许他们其实就是喜欢这种内容。

Alex Blania:对,也有这种可能。但如果能够明确知道“这是真人制作的视频”还是“这是 AI 制作的视频”,肯定会更好。

其实我对这件事的一个判断大概是这样的:有一些内容类别本来就明显是虚构的。比如电影就是这样。你并不在意它和现实之间有没有什么连接,它本来就是一个完全虚构的故事。

它本来就是一个完全虚构的故事。但如果你再想想 TikTok 这类平台,或者其他类似的内容平台,大家之所以在意它们,很大程度上是因为这些内容和现实之间多少存在某种连接。

Ben Horowitz:对。不只是和现实有关,还和人有关,比如,你完全可以拿一篇科学论文交给 Gemini,然后对它说:“把这个做成一档播客。” 它最后可能真的会变成一档相当有趣的播客,而且它也确实和现实有关,因为它来源于某个真实存在的东西。但你会想知道这一点。你会希望知道它是怎么来的。

Alex Blania:对,我会想知道。而且问题还会继续延伸:如果你是广告人,你也会想知道——观看它的是 人,还是 AI?

Ben Horowitz:另一种情况就是:我做了一百个 AI 视频,又让一百万个 AIs 去看它们。然后我就从 YouTube 那里赚了很多钱。

Alex Blania:没错。我今天其实就看到一个 YouTube farm 的视频。里面摆着成千上万部手机,整天都在刷视频,就是为了这个目的。

Ben Horowitz:而这对 YouTube 的广告商来说几乎是零价值。所以这对他们而言其实是一个非常现实的问题,对吧?

Eric Madsen:而且,过去十年的整个创作者经济平台——像 Substack、Spotify,以及那些支持艺术家的平台,比如 Patreon——它们成立的一个基础,就是创作者,或者说 YouTubers,和这些人之间存在一种个人关系。人们支持他们,不只是因为喜欢他们的作品。所以如果有一天大家突然发现,原来他们关注的其实是 bots,那他们可能就不会再以同样的方式支持他们了。

我觉得确实有一部分人,他们想支持的就是现实中的真人,并且希望自己是在和一个真实的人建立关系。

Alex Blania:对。而且我觉得大家其实没有真正意识到这件事的后果。按理说这应该是显而易见的,但很多人并没有真正理解它的影响。我觉得主要有两点。

第一,我们现在正在经历的,其实只是接下来将要发生事情里非常非常小的一部分。它只是一个苗头,只是一个前兆。因为智能的成本正在以近乎指数级的速度下降,而 Agent的能力则在以某种超线性的方式提升。所以,我们现在所看到的,可能还不到未来一两年后真实情况的 1%。

第二,这些东西在很多方面都会变得比人类更强。它们会非常擅长理解你,也非常擅长用最合适的方式和你说话。比如,有一篇论文——后来我记得好像被删掉了——研究的是 “Change My Mind” 这个 子版块。

苏黎世大学当时做了一个实验,让 AIs 去和 “Change My Mind” 上的用户互动。结果它们在改变别人观点这件事上,表现得几乎是超越了人类。因为它们会回头分析发帖者的 profile,理解他们的政治动机、说话方式,然后以一种几乎完美的方式和他们互动,精准击中所有触发点。AIs 在“面向人类编程”这件事上真的非常厉害,远比人类面向AI 编程厉害得多。

所以我觉得这也会变得相当可怕。但至少,如果你正在成为某种 PSYOP 的受害者,或者你遇到的是一个由 AI 执行的高度复杂的信息操控行动,那么能够识别这一点就会非常有价值。

图片来源:World

Ben Horowitz:来再多讲一点现在产品和业务的状态吧。现在外面大概已经有多少 IDs 了?你可以做一个更新,也顺便讲讲它的发展过程。

Alex Blania:

首先,这其实是一个需要同时解决三个方面问题的系统工程。

第一,你需要平台采用这项技术,比如 Reddit、X 等类似平台。

第二,你需要把这些设备铺出去。我觉得理解这件事最合适的方式是:一个人平均需要多少分钟才能到达这样一台设备。按当前全球平均来看,这个数字会很糟,很多人甚至需要坐飞机。但问题是,怎样才能把这个时间在全美范围内压到 15 分钟以内?要做到这一点,大概需要部署 50,000 台设备。这个数字不算夸张,但也绝不是一件容易的事。

第三,前面这些因素最后要如何组合成一个很多人真正愿意使用的产品?这既取决于各个平台本身提供的价值,也取决于叠加在其上的激励机制。比如,它也许可以绑定你的 Reddit 账户,也许还能附带某种 TBD 订阅权益。所以最终一定是多种因素共同作用的结果。

难点在于,你必须在某个时间点把这三件事同时做成,而这本身就非常难。

我们现在已经有 1800 万完成验证的用户,app 内总用户数达到 4000 万。不过,最大的变化在于:由于上一届政府时期的环境,再加上我们使用了 crypto,过去很长一段时间里我们其实并没有真正投入美国市场。而现在,这正是我们正在经历的最大转变。因为在整件事里,最关键的市场就是美国。也希望 Clarity Act 能尽快通过,让相关问题获得更明确的监管界定。

所以,我们现在最重要的重心,就是全面押注美国市场。接下来一年里,公司 90% 的努力都会围绕美国展开。比如,怎样把设备铺开?怎样最终让它出现在每一家 Starbucks 里?这样它就会变得非常日常化,人们会像使用普通服务一样每天使用它。这就是当前的重点。

至于平台这一侧,我自己其实经历了一个很有意思的过程。因为几年前,几乎所有人都在嘲笑我们,这几乎就是当时最普遍的反应。当然,a16z 和少数真正相信这件事的人除外。至于媒体,他们对这件事的嘲弄,某种程度上也只说明了很多人的短视。

其实,你们第一次听我们 pitch 的时候是怎么想的?因为连你应该都会觉得这件事很疯狂吧。

Ben Horowitz:主要是因为你们有那个 Orb。Orb 实在太狂野了。就是,“好,我们要扫描人们的视网膜,然后以此来判断他们是不是人类。” 诸如此类。而且那还是——你们是 6 年前来 pitch 我们的。

那还是在 COVID 之前,因为当时你已经带着 Orb 来了。那时候 AI 还没有真正爆发。你当时大致能看见一点趋势——当时也已经有 bots,但和现在比起来,它们还非常粗糙。不过,这件事看上去是不可避免的。至少在当时,我们会担心的是:这件事发生的时间到底是什么时候,前后节奏怎么配合,等等。

但你本人足够让人印象深刻,这件事迟早会发生,而且这个想法本身也足够令人兴奋,所以这些因素加在一起,让我们最终觉得:“好,我们投。” 不过,这并不是那种一眼就能看出“它会在这个时间窗口里跑通”的项目。很长一段时间里,它看起来都非常不显然。

那你们当初的 pitch,和后来真正做出来的东西相比,有多大不同?

Alex Blania:其实几乎完全一样。我觉得本质上还是同一个故事。变化的是设备。你知道,我们后来把它做得更经济,也更方便了,但是...

Ben Horowitz:对,没错。不过最初的那个判断——是对的。核心就是:未来在 网络空间里,每个人都必须证明自己是真人;否则,这个世界会变得非常糟糕。机器人大军会把我们淹没,我们就完了,对吧?

然后第二层判断是:这件事本身会变成一个非常重大的需求;而一旦它变成重大需求,我们就有机会在此基础上构建出最有价值的网络之一。因为在一个 AI 时代,拥有一个 人际网络 将会变得极其重要。

所以其实有两点。第一,你会需要证明自己是真人;第二,这件事会带来非常强的 network effects。即便是那些平台本身——虽然 bots 一直是它们最大的问题之一。你还记得 Elon 当时和 Twitter 的事吧,他一度退出收购,就是因为那些统计数据里充满了 bots。可即便平台自己明知道这一点,它们仍然很难在思维上真正走到未来那一步,然后得出结论:“对,我们需要 Proof of Human。”

因为很多人会说:“这到底是什么意思?” “Proof of Human 到底是什么意思?”

你们当时已经有链接检测工具了吗?还有,你们是什么时候开始用“Proof of Human” 这个说法的?

Alex Blania:其实我们很长一段时间里一直用的是Proof of Personhood。但后来有一天我们突然意识到:“糟了。” 因为终有一天,AI也会拥有人格。所以那这个说法就不成立了。

我其实记得,大概一年前,我和几个 OpenAI 的人在一个小群里。当时他们就说:“Alex,这件事以后会变得很黑暗。人们会讨厌你,因为你不给 AI 人格。” 我当时心想:“天哪……好吧,那我们就叫它 Proof of Human 吧。”

Alex Blania:所以,是的,我觉得去年在 ChatGPT 出现之后是一个很大的转折点。AI 突然变得让人们有了真实感。那时候大家开始来找我们,但当时更多还是觉得:“好,这也许是个未来问题,可能还要再过几年。” 但第二个更大的转折,其实我真的认为是最近的 Claude、Agents,以及 model-on-model。这基本意味着,局面已经彻底失控了。说实话,如果你现在还不认真对待这件事,那我觉得你应该换一份工作了。

因为这件事现在已经更像是一个执行层面的问题了。比如,怎么把 50,000 台设备铺出去?怎么把它们做得足够便宜?怎么让这种行为变得日常化,以至于人们在 Starbucks 里看到它时不会觉得奇怪?我觉得,相比之下,人们会更加无法接受另一种选择。大家会开始互相指责对方是 bots。我认为,如果没有一个清晰的区分机制,局面会变得一团糟。

我觉得接下来几个月里,我们会看到一些平台尝试在手机上使用人脸识别,而我知道这一定会失效。因为你就是……对。我们只是必须足够快地把规模做起来。而且,目前其实没有真正的竞争对手,因为这件事本身太离谱了。无论是把它做出来的工程难度,还是它所带来的巨大网络效应,门槛都非常高。

不过,就业务而言,我们现在最主要在做的事就是进入美国市场。其实我也想听听你对这个问题的看法:在你看来,要让这套东西在 AI 世界里真正运转起来,我们需要实施哪些经济政策?

Ben Horowitz:对。我觉得政府必须想清楚,怎样把钱发到公民手里。你回头看 COVID 时期的刺激计划,据说有 4000 亿美元被从刺激资金里骗走了。那时候你肯定会希望,自己发出去的钱是发给了独一无二的 真人。

所以,美国现有的身份体系、社会保障体系,大家都知道,是一团糟,完全是一场灾难。我们必须建立起某种在密码学上足够强的方式,来识别谁是哪个国家的公民。否则,连民主都无法维持。你怎么知道投票的人真的是活着的真实的人?

在一个 AI 可以大规模 冒充的世界里,你将不再拥有“人民的意志”。到那时,主导一切的会是拥有最多 GPU 算力的那个人的意志。

同样地,我觉得我们也必须以比现在这些荒唐的社会项目更高效的方式,把钱发到人手里。比如你想想,像 Medicare 这样的系统已经糟糕到一种程度:当有人枪杀了 United Health的 CEO 时,人们居然会感到高兴。AI 会让这个问题变得更严重,因为伪造理赔的能力,以及在黑市上购买社会保险号的能力,都会被极大放大。事实上,每个人的社会保险号都已经在被出售了。AI 只是让这种 欺诈变得大规模、并且极易扩展。

所以我认为,Proof of Human 是拼图中非常重要的一块。如果我们不升级整套基础设施,我们就无法继续作为一个 民主国家运作下去。

Eric Madsen:你刚才说,明年的市场推广会聚焦美国。这里的激励是因为用户可以使用一整套服务,还是还有别的经济激励?

Alex Blania:我觉得,基本上从一个月前开始,我们进入了一个完全不同的阶段。因为我们现在正在接入的很多平台,会把大量用户带到我们的平台上来。假设你面对的是一个拥有 10 亿用户的平台,它开始把用户导向你这里来完成验证,那么问题就几乎只剩下一个:你要怎么承接这部分需求。接下来不久,你会看到很多非常大的平台完成接入。

第二,怎样把 Orb的分发做起来?我觉得这是我们公司现在面临的最大挑战。因为这是 hardware。而且不只是 hardware——它还是一种必须在无人监督情况下大规模运行的硬件。为了把质量提升 1%,你都要面对一大堆极其混乱、相互牵连的依赖问题。

然后你还需要部署这些设备的地点——Walmart、Starbucks,或者一些很潮的咖啡店。我们很快会推出一个东西——团队可能会讨厌我现在提前说出来——叫做 Orb on Demand。在湾区或者纽约,其实更便宜也更容易的做法,是直接把一个 Orb 放在 motorbike 上送到你面前。你将可以说:“我现在就想验证。” 然后 15 分钟之后,一台 Orb 就会来到你这里。

Ben Horowitz:你有没有想过设置不同等级?比如,“我们知道你是一个独一无二的人类”,或者“这个人可能是一个独一无二的人类,因为他是在自己的 iPhone 上完成的验证。”

Alex Blania:对,我们有这个。我们有一个叫Face Check 的功能,就是做这件事的。它使用摄像头采集的人脸信息。它仍然使用MPC,所以你依然是匿名的,但它能达到的准确性要低得多。至少,一个人没法创建 100 个 account——也许还是能创建 10 个或者 20 个。它更像是一种 速率限制的手段。我认为,随着 deepfakes 的发展,这个方案从根本上会失效,所以它只是一个帮助我们扩展规模的临时方案。我们也会使用带有 NFC 芯片的政府身份证件。总之,凡是能派上用场的手段,我们都会用上。

Ben Horowitz:那你怎么看World ID 本身?它未来会像一个密钥吗?或者说,对于这个身份层本身,你们的设想是什么?

Alex Blania:我觉得,它本质上就是互联网的认证层。它是一种让你在不牺牲 privacy 的前提下证明“你是谁”的方式。而且它是开放的,是一个 协议。任何人都可以在它之上构建东西。这一点最重要。它不归我们所有。

你会看到,它会逐渐变成你登录各种东西的方式。既然你可以直接使用你的人类身份,那为什么还要继续用用户名和密码呢?

所以,我们正在为开发者构建整套接入工具。而且我们已经看到了很多比如,在 World 上开发的开发者数量正在非常迅速地增长。

Ben Horowitz:太棒了。那美国推广的时间线大概是什么样的?

Alex Blania:我们现在已经开始了。我们已经在主要城市部署设备了。接下来一年的目标,是实现全面覆盖。这会是一项非常庞大的工程,但我们已经准备好了。

Ben Horowitz:这真的是一项非常重要的使命。这个世界确实需要它。

Alex Blania:对。如果不是我们来做,那还会有谁来做?目前没有其他项目在采取这种路径。而且我认为,这也是唯一能够在全球规模上真正解决这个问题的方法。

原视频:How Bots, Deepfakes and AI Agents Are Forcing a New Internet Identity Layer

https://www.youtube.com/watch?v=0_NGsljlo3o

编译:Tiffany Zhao

稿件经采用可获邀进入Z Finance内部社群,优秀者将成为签约作者,00后更有机会成为Z Finance的早期共创成员。