压缩即是全部 —— 菲尔兹奖得主 Michael Freedman 给数学和 AI 的一封信

您想知道的人工智能干货,第一时间送达

2026 年 3 月,菲尔兹奖得主 Michael Freedman 发了一篇只有 30 多页的论文,标题叫《Compression is all you need》。他用一个优雅的代数模型回答了三个古老问题:人类怎么构建数学?人类数学和形式数学的本质区别是什么?未来人类数学家如何和 AI 协作?答案只有两个字——压缩。

2017 年 6 月,Google Brain 的八个人把一篇论文扔上了 arXiv。

标题狂得不像论文:《Attention Is All You Need》。

九年过去了,这个标题成了 AI 史上最著名的七个单词。基于它的 Transformer,撑起了 ChatGPT、Gemini、Claude、DeepSeek、万亿市值、一代人的焦虑。

2026 年 3 月 27 日,又一篇论文悄悄上了 arXiv。标题只有七个单词,格式一模一样:

Compression is all you need: Modeling Mathematics

看到这个标题,任何做 AI 的人都会下意识笑一下——"又一个蹭热度的"。点开作者一栏,笑容消失。

Michael Freedman。

这不是什么 ML 工程师。这是 1986 年菲尔兹奖得主,四维庞加莱猜想的证明者,过去二十年微软 Station Q 的灵魂人物,当今在世的数学家里戏份最重的那一批。

他在写 AI?不是。他在告诉所有搞 AI 的人:你们一直在用的那个词"压缩",其实比你们想象的要深得多。

这篇文章不是《Attention Is All You Need》那种工程突破。它是一封信——一位数学家,用他毕生训练出来的直觉,回答了三个困扰人类上千年的问题:

人类究竟是怎么构建数学知识的? 人类做的数学,和形式化的"纯逻辑数学",本质区别是什么? 未来的人类数学家,到底该怎么和 AI 协同工作?

他给出的答案,只有一个词:压缩。

今天这篇文章,就把这封信翻译给你。

第一章:Freedman 是谁

先说清楚为什么这个人开口说话,AI 圈必须听。

1981 年,三十岁的 Freedman 在加州大学圣地亚哥分校解决了四维庞加莱猜想——这个问题悬了 77 年。三维版本让 Perelman 在 2006 年拿到菲尔兹奖(他拒绝了);五维以上早在 60 年代就被解决。唯独四维——卡在最要命的那个维度——是 Freedman 攻下来的。

1986 年,柏克莱,国际数学家大会。Freedman 领走了菲尔兹奖。

1997 年,Freedman 做了一件数学家很少做的事——从学术界出走。微软给他开了一个几乎是为他量身定做的部门 Station Q,目标只有一个:用数学家的思路造拓扑量子计算机。他当了主任,一干就是二十五年。

2023 年,他回到哈佛 CMSA(数学与应用中心),换了一个身份:思考 AI 和数学的关系。

所以当 Freedman 这个人在 2026 年 3 月扔出一篇叫《Compression is all you need》的论文——这不是某个追热点的研究员,这是一个一辈子在数学内部看世界的人,突然转身跟所有人说:

"我看清楚了一件事。你们要听吗?"

第二章:一个让所有人尴尬的事实

Freedman 论文的切入点,是一个数学界人尽皆知、但几乎没人能解释的尴尬事实。

先建立两个概念:

- 形式数学(Formal Mathematics, FM)

:所有合乎逻辑规则的推演。 - 人类数学(Human Mathematics, HM)

:人类真正写下、收录、引用的那部分数学。

FM 的空间有多大?假设你有 n 个基础符号,组合出来的"合法推演"是指数级——n 上百以后就超过了整个宇宙里的原子数。

HM 呢?从欧几里得到今天所有数学家加起来写过的定理,约百万量级。Lean 4 的 MathLib 收录其中约 14 万条。

两个数字并排写

FM:> 1080

HM:~ 105

中间隔了 75 个零。

人类数学,是形式数学这个宇宙里一粒尘埃都不到的小角落。

而且——为什么是这一粒?

FM 里有无穷无尽的"合法但无聊"的定理。比如:"对任意整数 n,n + 0 = n","对任意整数 n,n + 0 + 0 = n","对任意整数 n,n + 0 + 0 + 0 = n"……每一条都合法,每一条都无意义。人类数学家从来不写这些。

一百年来这个问题有过无数个哲学回答:"美""简洁""有用""深刻"——都是词语的游戏。没有一个是数学答案。

直到 Freedman 2026 年给出了第一个能算的回答:

因为 HM 是 FM 里那个"可压缩"的子集。

第三章:压缩——先站在日常地面上

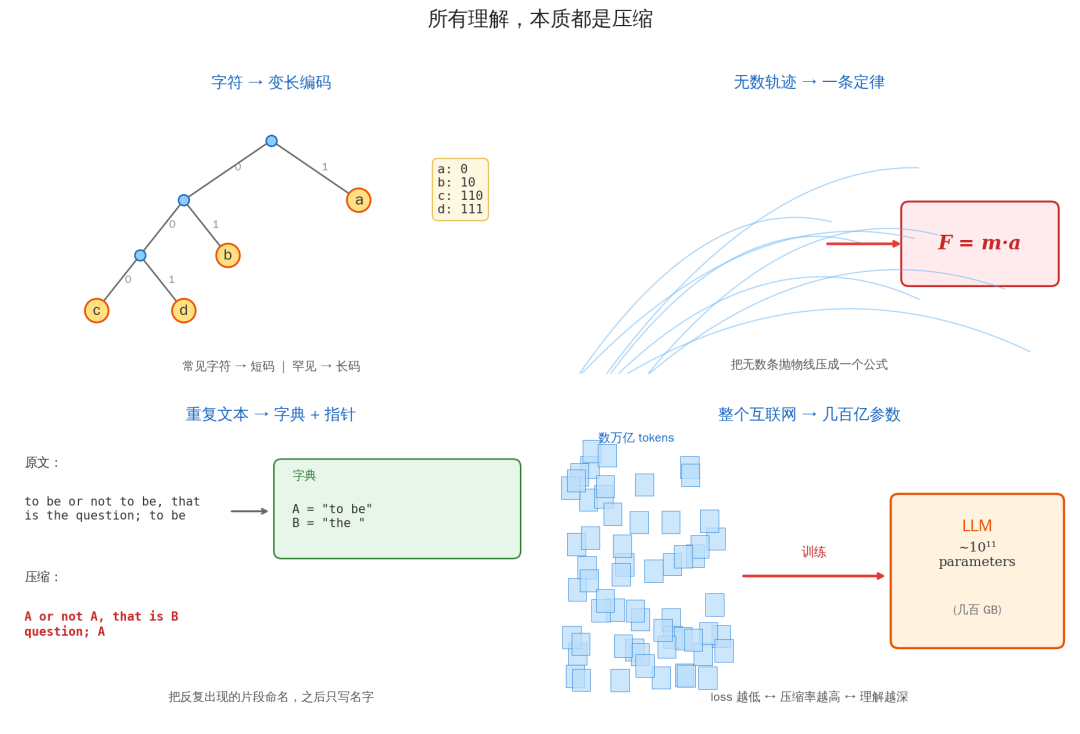

Freedman 说的"压缩"是什么意思?先别想数学,先想几个你已经懂的例子。

例子一:Huffman 编码

你家猫叫小花。照片里出现最多的动作是"睡觉"(4000 次),其次"吃饭"(3000)、"抓沙发"(2000)、"发呆"(1000)。

固定 8 位编码:80000 位。Huffman 编码:"睡觉→0;吃饭→10;抓沙发→110;发呆→111"——19000 位。压缩率 4 倍,没有丢失任何信息。

只要事物分布是不均匀的,就存在压缩。

例子二:牛顿三定律

宇宙里每一秒都在发生无数次的运动:苹果落地、月亮绕地、弹簧振动、子弹出膛、潮汐起落……你想记录所有这些运动,需要多少信息?

不需要。

你只需要记住 F = m·a,外加两条(惯性、反作用),就能重新生成上面所有运动。

牛顿三定律是一个几十字符的程序,它编码了经典力学的全部。

例子三:zip 文件

"to be or not to be, that is the question; to be"——把反复出现的"to be"和"the"命名成 A、B,之后只写名字。这是 LZ77 算法(zip / gzip / PNG 的底层),1977。

例子四:大型语言模型

喂整个互联网给 LLM——几万亿字、几百万小时文本。训练完得到几百亿参数的模型(几百 GB)。它能生成类似训练集里的任何内容。

这件事,用信息论的语言说叫:LLM 就是互联网的一次有损压缩。

DeepMind 2023 年做了一件让人血压升高的事:他们把 Chinchilla 70B 当成一个通用压缩器,用它去压缩原始字节流——不仅是文本,还有从没训练过的图像和音频。结果:

文本压缩率:比 gzip 好很多 图像压缩率:比 PNG 好 音频压缩率:比 FLAC 好

一个只训练了语言的模型,居然能压缩它从没见过的图像——因为它学到了"通用的世界结构"。

从 Huffman 的字符编码到 LLM 的几百亿参数——压缩的颗粒度越来越粗,本质是同一个。

任何"理解"的行为,本质都是找到更短的描述。这不是比喻。这是 Freedman 论文的出发点。

第四章:Freedman 的建模——字符串和"宏"

Freedman 说的第一件事:把数学推演当成字符串。你在黑板上写证明,本质就是一串字符。所有"合法的证明字符串"排起来——就是 FM。

但数学家从来不这样写。他会说:"设 f 在 [a, b] 上连续,则 f 一致连续。"

"连续"是一段定义,展开约三行字符。"一致连续"是另一段,展开约五行。表面 20 个字,完全展开超过 100 个字符。继续挖下去——一条"短句子"背后,是一棵很深的定义树。

Freedman 给这种"名字 → 一段长字符串"的约定起了个名字:宏(macro)。

"连续" = 一个宏 "一致连续" = 一个宏 "积分" = 一个宏(调用"极限""分割""黎曼和"的宏) "勒贝格积分" = 一个宏(调用"测度""可测函数"的宏) "黎曼-勒贝格引理" = 一个宏(调用以上所有)

一条现代定理"完全展开"往往是亿级字符。但数学家永远只看最外层。

数学家的工作,就是不断造宏。一位数学家的一生,可能就干了一件事——看到了一个之前没人压缩过的模式,给它起了一个名字。

高斯给"正态分布"起了名字。黎曼给"流形"起了名字。伽罗瓦给"群"起了名字。康托尔给"集合"起了名字。图灵给"可计算性"起了名字。香农给"熵"起了名字。

你今天学的所有数学,都是在站在前人造好的宏上。如果不能层层压缩,人类根本学不动数学。

第五章:$A_n$ vs $F_n$——两种宇宙

到这里一切都是直觉。Freedman 接下来要做的,是把这个直觉变成数学。

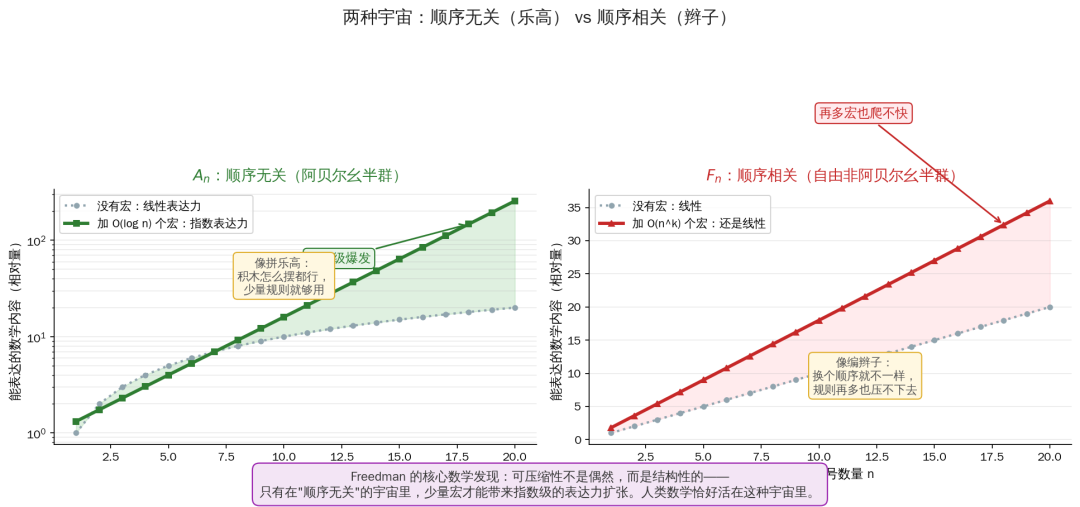

他引入两个代数对象(别紧张,用直觉讲):

A_n 像拼乐高

你有一堆乐高积木——红、蓝、绿。红拼蓝上加绿,还是先绿再蓝再红——最后模型一样。顺序无关紧要,只在乎哪些积木。

F_n 像编辫子

先压左绳再压右绳,和先压右再压左——得到的辫子完全不一样。顺序决定一切。

Freedman 的定理说了一件"漂亮得像魔法"的事:

Freedman 的核心代数发现

在 An 里,只要用 O(log n) 个宏(对数级稀疏),就能让表达力指数级扩张。

在 Fn 里,就算用 O(nk) 个宏(多项式级稠密),表达力也只能线性扩张。

同样的"造宏"策略,在两种宇宙里结果天差地别——可压缩性是结构性的。

用大白话翻译:

在"乐高宇宙"里,造几个宏顶一万个宏——积木自由组合,宏之间也自由组合 在"辫子宇宙"里,造再多宏也救不了你——顺序是死的,每个组合都得单独记

这个对比为什么重要?因为它告诉我们:"可压缩性"不是普世的,它只在特定结构里才存在。

数学里的加法、乘法、集合并、函数复合——都是可交换或近似可交换的。所以数学是可压缩的。

那人类的语言呢?主语动词宾语顺序很要命——"狗咬人"和"人咬狗"不是一回事。所以语言压缩程度远低于数学。

那生物学呢?DNA 顺序至关重要——所以生物学长期是描述性的,没有"F = m·a"级别的简洁定律。

那LLM 的参数空间呢?第八章再说。

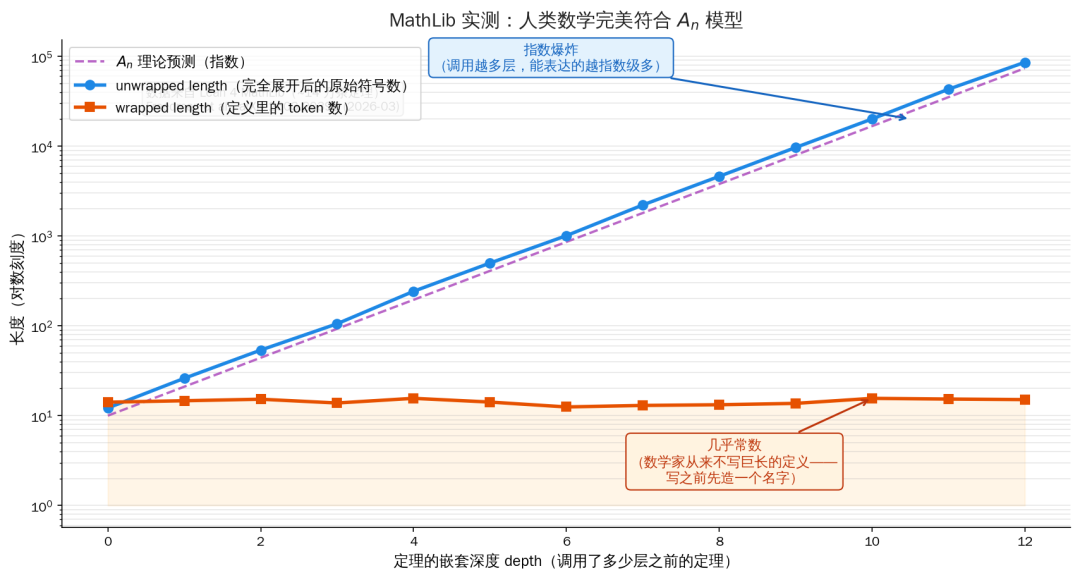

第六章:MathLib 实证——数据来说话

光有理论不够。Freedman 做了一件让这篇论文从"哲学随笔"升级成"硬科学"的事:把模型拿到真实的人类数学上验证。

测试对象:MathLib——Lean 4 的数学形式化库,14 万条定理,覆盖代数、分析、拓扑、数论、范畴论……

对每条定理,测三个量:

- depth

:嵌套深度 - wrapped length

:定义里的 token 数 - unwrapped length

:完全展开后的原始符号数

结果 1:unwrapped length 随 depth 指数爆炸。

越深,完全展开后字符数按指数增长。到深度 10+,展开一条定理就要数千万字符。

结果 2:wrapped length 几乎是常数。

但数学家写出来的定义,无论 depth 是 2 还是 12,长度几乎不变——永远就是几十个 token。

数学家从来不写很长的定义。每当一个东西变复杂,数学家的第一反应是:先给它起个名字,然后用名字继续。

unwrapped 指数爆炸,wrapped 岿然不动——数学家每到一层就造一个宏,把复杂性压回来。

结果 3:数据完美符合 A_n,严重违反 F_n。

Freedman 把两种模型的理论曲线画在同一张图上。An 的指数扩张曲线严丝合缝地盖在实测数据上。Fn 的线性曲线差了好几个数量级。

人类数学,生活在 An 模型预测的那个可压缩子空间里。这不是隐喻,是可测量的事实。

第七章:三个古老问题的答案

现在可以回到开头的三个问题了。Freedman 给的答案,每一个都短到令人震撼。

问题一:人类究竟是怎么构建数学知识的?

层层压缩。每一代数学家看到前一代的成果,找出其中"可以起名字"的部分,造新的宏,然后在新宏之上继续推演。整个数学史就是一部宏的积累史。

欧几里得给"点、线、面"起名字 → 笛卡尔给"坐标"起名字 → 牛顿给"导数"起名字 → 柯西给"极限"起名字 → 康托尔给"集合"起名字 → 希尔伯特给"空间"起名字 → 格罗滕迪克给"概形"起名字……每一层,都比上一层压缩了更多。

问题二:人类数学和形式数学的本质区别是什么?

可压缩 vs 不可压缩。FM 里大部分定理是"合法但无聊的"——没有结构、不能被起名字、没法进一步用。HM 是 FM 里那个碰巧活在 An-like 子空间的小角落。

人类数学之所以是"人类"的,恰恰是因为人类的认知带宽极其有限——我们只能在那个可压缩的子空间里活动。而那个子空间的存在,是宇宙给我们的礼物——如果它不存在,人类压根不会有数学。

问题三:未来人类数学家怎么和 AI 协同?

AI 的长处是在 FM 的巨大空间里并行搜索——因为它有我们没有的带宽。

人类的长处是判断哪些地方"值得起名字"——因为我们有五万年的语言和抽象训练。

这不是 AI 取代数学家,也不是数学家训练 AI。是两种不同认知带宽的分工协作。

Freedman 还具体建议:在 MathLib 的依赖图上跑 PageRank + 压缩度分析。一条定理如果被很多下游定理引用(PageRank 高),又能大幅压缩下游内容(压缩度高),那它就是核心定理——值得人类数学家投入,值得 AI 优先搜索。

这把"什么是重要的数学"从一个主观判断,变成了一个可以算的量。

第八章:这对 AI 意味着什么

第一个含义:AI 做数学的路线图,清晰了。

2024 年以来:DeepMind 的 AlphaProof 在 IMO 上拿银牌;陶哲轩公开宣布 Lean 4 是工作流的一部分;DeepMind 的 FunSearch 在组合数学里发现了新定理;专门的数学 LLM 涌现。

所有这些,Freedman 的框架都给了同一个解释——它们在 FM 的巨大空间里搜索,但它们能成功的地方,恰恰是 HM 已经压缩过的地方。

AI 的数学能力,是站在人类两千年"造宏"的结果之上的。脱离了 MathLib 里那 14 万条定理,AI 在纯 FM 里就像撒哈拉沙漠里找一粒米。

下一步的突破,不会来自于让 AI 在 FM 里搜索得更快——而是让 AI 学会"自己造宏"。

第二个含义:LLM 是什么?答案变清楚了。

DeepMind 那篇《Language Modeling Is Compression》(2023)给出了第一层答案:下一个 token 预测 = 算术编码下的压缩率最大化。训练时的 cross-entropy loss,严格来讲就是"对训练集的压缩率"的负对数。loss 越低,压缩率越高,理解越深——不是比喻,是数学恒等。

但 Freedman 给出了第二层答案:LLM 会用宏,但不会造宏。

LLM 训练时吃了整个互联网——里面充满了人类两千年造出来的宏("微积分""进化论""民主""熵""注意力"……)。LLM 学会了在这些宏之间自如穿梭——所以它在"单步推理"上惊艳。

但在"长证明"上——它崩溃。一条需要造新宏的证明,LLM 很难稳定完成。因为它没有在训练中见过这个宏,它不会从零定义一个新概念然后在新概念上继续推演。

这正好是 Freedman 说的"层层压缩"里的"层"——每一层都是一次新的命名。LLM 在一层内表现惊艳,跨层就断。

第三个含义:为什么 LLM 的 scaling 可能有上限。

如果智能本质是"层层压缩"——造宏、在宏上造宏——那么单纯把模型变大,增加的是单层的带宽,不是层数。

一个更大的 LLM,能用更精细的宏、更大的词表、更长的上下文。但它造新宏的能力,没有因为变大而获得质变。

LLM 是一个宏使用器。真正的智能是一个宏生成器。

—— 这呼应了《世界模型之争》里 LeCun / 李飞飞 vs Ilya 那场口水战。Ilya 说的是"用宏"的上限还没到,LeCun 说的是"造宏"的能力根本还没开始。

第八章半:数学之外——诗、画、乐也是压缩

Freedman 的论文从头到尾只谈数学。但如果"压缩即理解"真的是宇宙级的事实,它就不该只在数学里成立。

我写到这里的时候,脑子里跳出来的是王维。

大漠孤烟直,长河落日圆。

十个字。没有修饰、没有形容词、没有一个"情"字。但你读完这十个字,眼前立刻浮起一张画——辽阔、空旷、孤直的一缕烟、浑圆的落日压在地平线上。紧接着,是一股你说不出但确实感到的苍凉和孤寂。

这十个字背后,藏着多少信息?视觉上是一幅完整的西北边塞画面;几何上是"直"与"圆"的极简构图对比,一竖一圆撑起整个空间;时间是日落的那个瞬间,一天将尽;心境是使者独自远行的孤独、远离故土的怅然;背景是盛唐边塞诗的整套意象系统。用散文来复述,上千字都说不完。王维用十个字,把它压缩成了一个可以在你脑中重新展开的种子。

这和 Freedman 论文里讲的"宏"是同一件事。"大漠""孤烟""长河""落日",每一个都是一个宏——它调用了中文文学两千年积累的意象、画面、情绪。王维的天才不是"写得漂亮",而是挑出了那四个展开之后信息量最大的宏,把它们摆在一起。

音乐是另一个面孔。贝多芬第五交响曲的开头只有四个音:ta-ta-ta-tum。但这四个音在整首交响曲里被变形、重组、上行、下行、反转了几百次。一首四十分钟的交响曲,本质上是从一个四音动机里压出来的——这就是作曲家说的"主题与变奏",用 Freedman 的话讲就是:造一个宏,然后在宏的空间里自由展开。

绘画也是。齐白石画虾,不画水、不画水草,只画虾——你看到的是虾,感受到的却是整个池塘。留白不是"没画",是让观者自己在心里展开那一大片信息。八大山人一只翻白眼的鸟,你读出了整个明末遗民的心境。

为什么所有艺术都指向同一件事?我的猜想是这样的:

人类的大脑,能同时握住的"维度"是有限的。几千个脑细胞组成的注意力,在某一刻只能在一个相对低维的空间里做关联。

所以我们分科——有人专心在数学的维度里找可压缩的结构(几何、群、流形),有人专心在语言的维度里找(意象、节奏、双关),有人专心在声音的维度里找(和声、调性、动机),有人专心在视觉的维度里找(构图、比例、留白)。不是因为这些领域彼此无关,而是因为一个人扛不动所有维度。我们用自己天生敏感的那一条通道去压缩世界,彼此隔行如隔山——其实隔的不是山,是我们自己的认知带宽。

而 LLM 第一次给了"把维度连起来"这件事一个物理基础。

几千亿参数的模型,其内部表示空间的维度,远远超过任何一个人类个体能同时调用的维度。于是很多在我们看来"不相关"的东西——一首宋词、一段巴赫的赋格、一个偏微分方程、一张水墨画——在那个高维空间里,开始出现彼此对齐的方向。

LLM 的涌现,不是神秘的玄学,而是:当压缩维度大到一定程度,原本散落在不同学科的宏,开始互相调用。"熵"这个宏,在物理、信息论、经济学、心理学里,突然变成同一个东西;"对称"这个宏,在群论、晶体、音乐、诗歌里,突然变成同一个东西。这大概就是跨域泛化,就是所谓"世界模型"的雏形。

所以,数学、诗、画、乐,不是四件不同的事。它们是同一件事在四种媒介上的投影。

王维不是"诗人而已",他是一个在语言维度上找可压缩结构的人。欧拉不是"数学家而已",他是一个在符号维度上找可压缩结构的人。贝多芬不是"作曲家而已",他是一个在时间维度上找可压缩结构的人。齐白石不是"画家而已",他是一个在视觉维度上找可压缩结构的人。

殊途同归。万物为一。

我们每个普通人,只是在自己最敏感的那条通道里,做着同一件事——把复杂的世界压成一个自己能握住的短描述,然后靠这个短描述活下去。

Freedman 用代数模型证明了:数学之所以存在,是因为它活在一个 A_n-like 的可压缩子空间里。我想补一句他没说的:人类文明之所以存在,是因为它活在无数个可压缩子空间的并集里。数学只是其中最干净的那一个,但不是唯一的一个。

第九章:四种概率观的收束

写到这里,忍不住回头看一眼这一年来博客走过的路。

一条主线贯穿了四篇文章——每一篇都在用不同的视角看同一个数学对象 P(x):

| 贝叶斯 | |||

| 熵 | |||

| 量子 QBism | |||

| 压缩(本文) |

这四个视角指向同一个公式:

L(x) = − log P(x)

- 贝叶斯派

:L(x) 是"意外",驱动信念更新 - 统计力学派

:L(x) 是微观状态对熵的贡献 - QBism 派

:L(x) 是测量结果在下次下注时的权重 - 压缩派

:L(x) 是这个事件在最优编码里占的字符数

它们是同一个数学对象,从四个不同的哲学位置看。

Freedman 这篇论文的意义是——他把这个公式从"一个信息论工具"升级成了"数学本身的基础"。数学之所以能存在,是因为宇宙可压缩;人类之所以能做数学,是因为我们活在 An 那样一个低描述长度的结构里。

第十章:压缩留下的三个直觉

一、所有"理解"都是压缩。

你理解了一个现象,意味着你能用比原始数据短得多的描述重新生成它。做到这一点,你就理解了;做不到,你就只是在记忆。

二、数学独特之处,是它能做"嵌套的压缩"。

不止一次压缩,而是"在压缩之上再压缩"。每一代数学家把上一代结果打包成一个名字,然后在那个名字上继续工作。这个递归过程,是其他学科没有(或者没有这么强的)。

三、数学、诗、画、乐,是同一件事在四种媒介上的投影。

每个领域的大师,都是在自己那条通道里做可压缩子空间的挖掘者。王维的"大漠孤烟直,长河落日圆"和欧拉的 e^(iπ)+1=0,本质同构——都是把庞大的信息压成一颗能在别人脑中重新展开的种子。我们分科,不是因为世界是割裂的,是因为一个人的认知带宽不够。LLM 第一次让这些分科的宏在同一个高维空间里开始互相调用——这就是所谓的涌现和泛化。

四、AI 要做真正的数学(和深度智能任务),必须学会"造宏"而不只是"用宏"。

"用宏"是工程问题——扩大上下文、提高精度、叠更多层。"造宏"是认知问题——从混乱现象中看出一个可以命名的模式。

目前所有 LLM 的 scaling 都在"用宏"的层面上。真正的突破——不管它叫 AGI、叫 JEPA、叫世界模型、还是叫别的——一定出现在 AI 开始自己造宏的那一天。

尾声:你在读这篇文章,就是在压缩

Freedman 写完这篇论文大概花了一年。我写这篇文章带上查资料画图,大概八小时。你读它,大概二十分钟。

一年 → 八小时 → 二十分钟。

每一次压缩,都有损失。 但每一次压缩,也都有获得——你能在二十分钟里带走一个新的看世界的方式。

你读完过几天,记得的大概只有几个关键词:压缩、宏、乐高和辫子、MathLib、造宏而不是用宏。

这就是又一次压缩。

如果这几个关键词以后在你遇到别的问题时——学一个新领域、读一篇论文、训练自己的模型、带一个学生、甚至只是想一件事——还能被你调用,那说明它们在你脑子里成了新的宏。

你也在做 Freedman 说的那件事。

数学家、程序员、作家、老师、学生——所有"用头脑工作"的人,每天都在干同一件事:把世界的复杂,压进一个可以用的短名字。

下一次有人问你"什么是智能"的时候——你可以换一种回答了。

不是"处理信息"。不是"模式识别"。不是"深度学习"。是:

找到更短的描述。—— 压缩,即是全部。

下一篇,回到《看见物理》系列的最后一站——对称性。诺特定理、杨振宁、宇宙的骨架。对称性和压缩是一对孪生姐妹——有对称就有守恒,有守恒就有可压缩的描述。

—— 所以,实际上我们还在同一个故事里。

本文首发于「AI 学习笔记」博客:https://Jason-Azure.github.io/ai-blog/posts/compression-is-all-you-need/

微信公众号:AI-lab学习笔记

参考:Freedman, Compression is all you need: Modeling Mathematics, arXiv 2603.20396 (2026-03)

文章精选:

1.编程时代已终结!ClaudeCode创始人断言:编程就像发短信一样自然,首曝个人最新工作流:自创Sloop循环,单日PR达150!传统SaaS护城河崩掉