【AI加油站】第一百四十九部:从零到一:Python概率、统计与机器学习完全指南(附下载)

一本书读懂数据科学的核心技术与实战方法

在当今人工智能和大数据时代,掌握数据科学技能已经成为各行各业的必备能力。而Python,作为最受欢迎的编程语言之一,凭借其简洁的语法和强大的生态系统,成为了数据科学领域的首选工具。

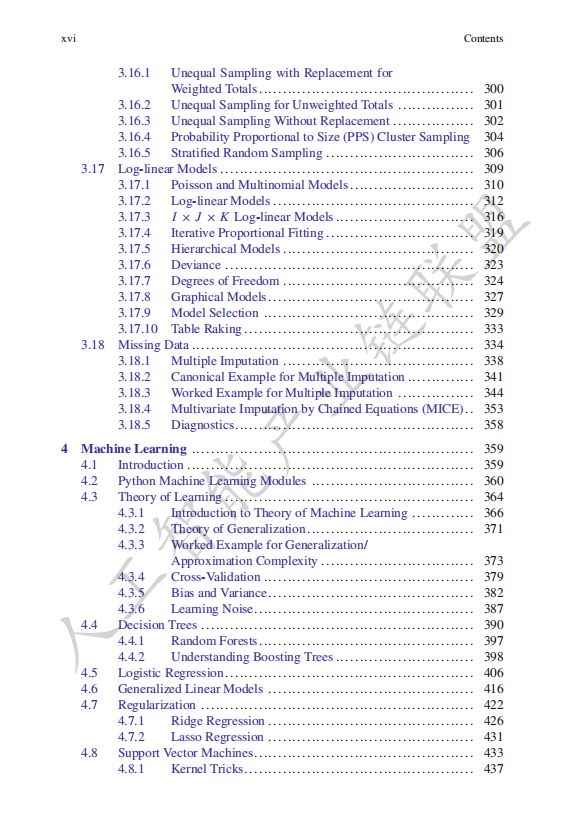

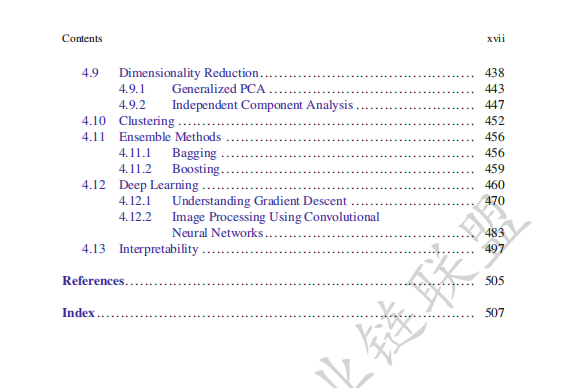

今天,我将为大家详细解读《Python for Probability, Statistics, and Machine Learning》这本经典著作的核心内容,帮助您建立从概率统计到机器学习的完整知识体系。

为什么要学习这本书?

这本书的独特之处在于,它将抽象的数学理论与可执行的Python代码完美结合。作者José Unpingco拥有丰富的工业界背景,第三版更新至Python 3.8+,内容比第二版增加了约三分之一,新增了大量难以找到的重要材料。

书中包含超过650个可运行的代码块和200多个图形可视化,使用的Python模块涵盖Numpy、Scikit-learn、Sympy、Scipy、Pandas、Tensorflow、Statsmodels、Xarray等。

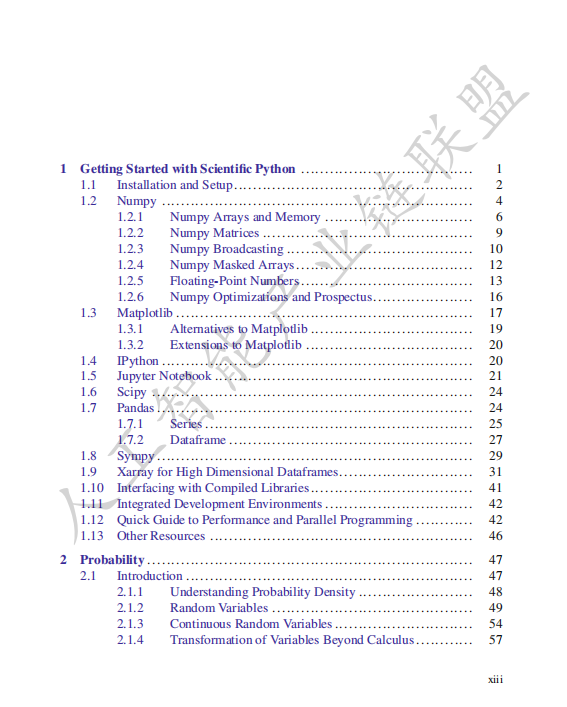

第一章:科学Python入门

为什么Python是数据科学的首选?

Python是一种解释型、动态类型的语言,它的核心优势在于:

1. 与编译库的无缝集成:Python可以轻松绑定到Fortran和C库,将密集计算任务发送给编译库执行,既享受了Python的编程便利性,又保证了计算性能。

2. 跨平台兼容性:同一份脚本可以在Windows笔记本和Linux超级计算机上运行。

3. 生产力提升:Python减少了开发时间,让科学家能够专注于解决问题而非编程细节。

环境配置建议

作者强烈推荐使用Anaconda发行版,它提供了强大的conda包管理器,能够处理复杂的依赖关系。对于Windows用户,如果遇到编译问题,可以考虑使用Windows Subsystem for Linux或虚拟机解决方案。

Numpy核心要点

Numpy是Python科学计算的基石,它提供了:

数组和内存管理:Numpy使用引用传递语义,切片操作创建视图而非副本,这对于处理大型数组特别重要。使用as_strided可以创建重叠的内存块而不消耗额外内存。

广播机制:这是Numpy最强大的特性之一,可以隐式创建多维网格。例如,x + y[:, None]可以自动扩展维度进行计算。

浮点数精度问题:书中详细解释了0.1 + 0.2不等于0.3的原因,以及如何使用Kahan求和算法和math.fsum()来处理舍入误差。

数据可视化与交互式分析

Matplotlib是Python的主要可视化工具,可以生成出版质量的图形。Seaborn作为扩展,提供了更美观的统计图形。IPython和Jupyter Notebook则提供了交互式开发环境,支持代码补全、内联帮助和丰富的数学排版。

核心数据处理库

Pandas:提供Series和DataFrame两种数据结构,特别适合时间序列和电子表格风格的数据分析。通过groupby和eval方法,可以轻松实现数据聚合和特征工程。

Xarray:专为高维数据设计,支持多维数据框,在地球科学和天文学领域广泛应用。它比Pandas更适合处理高维数据立方体。

Sympy:Python的主要计算机代数系统,可以进行符号数学计算,并通过lambdify方法将符号表达式转换为Numpy函数。

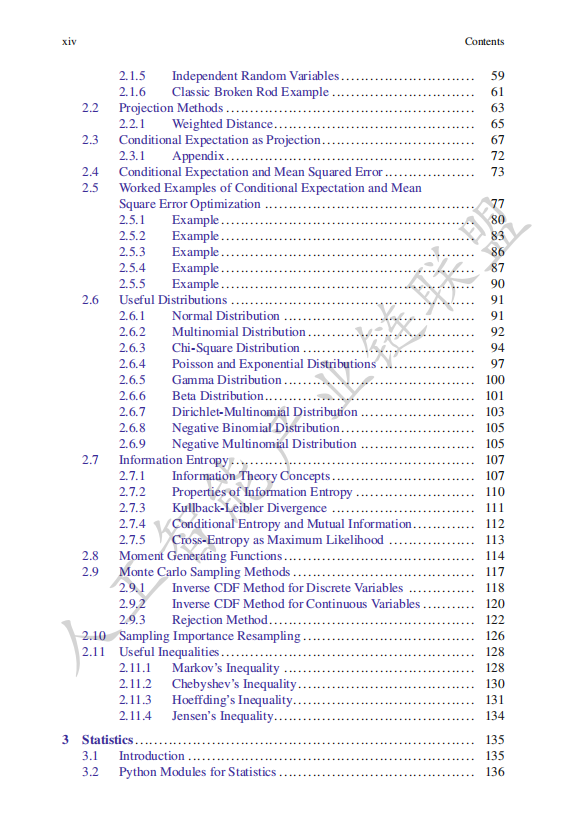

第二章:概率论深度解析

概率的几何视角

作者从几何角度解读概率论,将概率密度函数比作围绕数值的“蜂群”,密度表示不确定性。这种视角将概率与线性代数、几何和优化联系起来。

随机变量与测度

随机变量本质上是可测函数,将样本空间映射到实数。通过构建可测函数,可以从一个概率空间(如掷骰子)构建另一个(如掷硬币)。

条件期望作为投影

这是全书最重要的概念之一:条件期望是随机变量空间上的投影算子。这意味着:

• 条件期望是MMSE(最小均方误差)解 • 满足正交条件:E[(X - E[X|Y])Y] = 0 • 具有幂等性:E[E[X|Y]|Y] = E[X|Y]

常用概率分布

书中详细介绍了多种重要分布:

正态分布:完全由前两阶矩决定,在线性变换下保持不变。

多项分布:二项分布的推广,描述n个球分配到r个箱子的概率。

卡方分布:在假设检验中广泛应用,Pearson卡方检验统计量服从卡方分布。

泊松与指数分布:泊松分布描述时间间隔内事件发生次数,指数分布描述事件等待时间。

贝塔分布:均匀分布的推广,是二项分布的共轭先验。

狄利克雷-多项分布:在文本处理中常用,可以为文档中未出现的词分配非零概率。

信息熵

熵定义为H(X) = ΣP(x)log₂(1/P(x)),单位是比特。KL散度衡量两个概率分布的差异,互信息I(X;Y) = H(X) - H(X|Y)衡量变量间的相关性。

蒙特卡洛采样方法

• 逆CDF方法:适用于可逆CDF的分布 • 拒绝采样:需要找到合适的提案分布M • 重要性重采样:无需拒绝步骤,效率更高

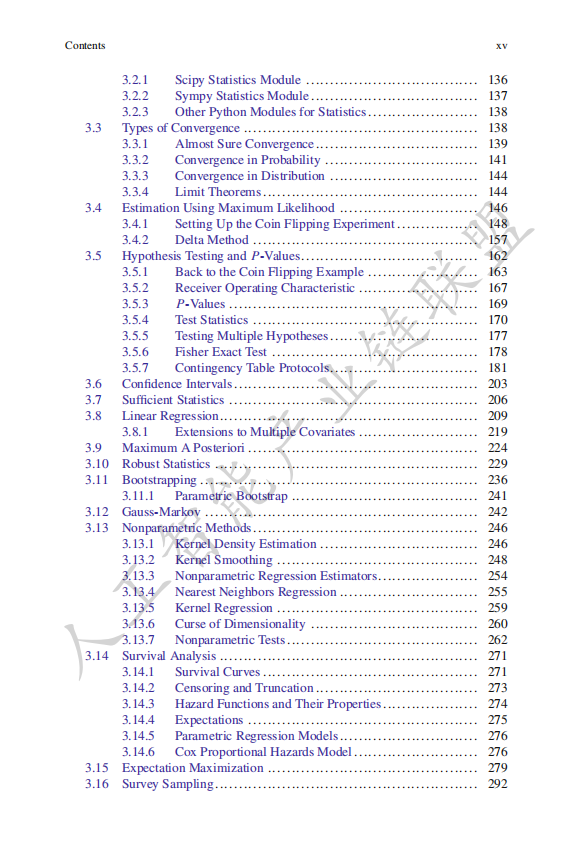

第三章:统计学核心方法

收敛类型

几乎必然收敛:序列以概率1收敛,是最强的收敛形式。

依概率收敛:收敛概率趋近于1,弱于几乎必然收敛。

依分布收敛:只关心CDF的收敛,是最弱的收敛形式。

大数定律和中心极限定理是统计推断的基石。

最大似然估计

以抛硬币为例,MLE估计量是样本均值,具有无偏性,方差为p(1-p)/n。Delta方法用于估计函数变换后的分布,可用于方差稳定化变换。

假设检验

• P值:在H₀下观察到的统计量至少与样本统计量一样极端的概率 • Neyman-Pearson检验:固定虚警概率,最大化检测概率 • 广义似然比检验:Wilks定理表明-2logΛ近似服从卡方分布

列联表分析

• Fisher精确检验:基于超几何分布,适用于小样本 • Pearson卡方检验:适用于大样本 • Simpson悖论:分组时有效的处理在合并后可能失效

线性回归

从投影角度理解:ˆa = ⟨y, x₁⟩/⟨x, x₁⟩,其中x₁是x在1⊥上的投影。R²衡量拟合优度,F统计量比较包含和排除斜率项的效果。

自助法

通过从原始数据有放回地重采样,估计统计量的分布。对于复杂统计量,自助法比Delta方法更准确。

非参数方法

核密度估计的收敛速度为n^{-2/(2+d)},存在维数灾难。局部线性回归可以缓解边界问题。

生存分析

• 生存函数 S(t) = P(T > t) • 风险函数 h(t) = f(t)/S(t) • Cox比例风险模型:h(t|x) = h₀(t)exp(xᵀβ)

EM算法

用于处理隐变量问题,通过E步(计算后验期望)和M步(最大化似然)迭代进行。

第四章:机器学习实战

学习理论

• VC维:衡量假设集的复杂度,决定了泛化误差界 • 偏差-方差权衡:Eout = bias² + var • 交叉验证:估计泛化误差的有效方法

决策树与随机森林

决策树通过递归分割构建,使用Gini系数衡量节点纯度。随机森林通过装袋和随机特征选择降低方差。

逻辑回归

使用sigmoid函数将线性回归映射到[0,1]区间,通过最小化交叉熵训练。正则化(L1/L2)控制模型复杂度,L1可产生稀疏解。

支持向量机

通过最大化分类间隔寻找最优分离超平面,只依赖于支持向量。核技巧将特征映射到高维空间,实现非线性分类。

降维

• PCA:寻找最大方差方向,通过SVD实现 • ICA:最大化非高斯性,用于盲源分离

聚类

K-means最小化簇内平方和,肘部法则和轮廓系数用于选择簇数。

深度学习

• 感知机:二分类的线性分类器 • 多层感知机:通过反向传播训练 • 卷积神经网络:使用卷积、池化和ReLU激活函数处理图像

模型可解释性

• 部分依赖图:显示单个特征的边际效应 • 个体条件期望图:显示每个样本的个体响应 • Shapley值:基于合作博弈理论的特征归因

写在最后

这本书的独特价值在于,它不仅教授Python工具的使用,更重要的是建立从概率统计到机器学习的完整思维框架。通过将抽象的数学理论与可执行的代码相结合,读者能够真正理解算法的本质。

无论您是数据科学的新手,还是希望深入了解算法原理的实践者,这本书都值得反复研读。记住,最重要的不是记忆代码,而是理解背后的原理,这样在面对新问题时才能灵活运用。

希望这篇导读能够帮助您更好地掌握概率、统计和机器学习的核心知识,在数据科学的道路上走得更远!

本文内容整理自《Python for Probability, Statistics, and Machine Learning》第三版,作者José Unpingco

本书免费下载地址

关注微信公众号“人工智能产业链union”回复关键字“AI加油站149”获取下载地址。

【AI加油站】第八部:《模式识别(第四版)-模式识别与机器学习》(附下载)