CrowdStrike:2026年全球威胁报告

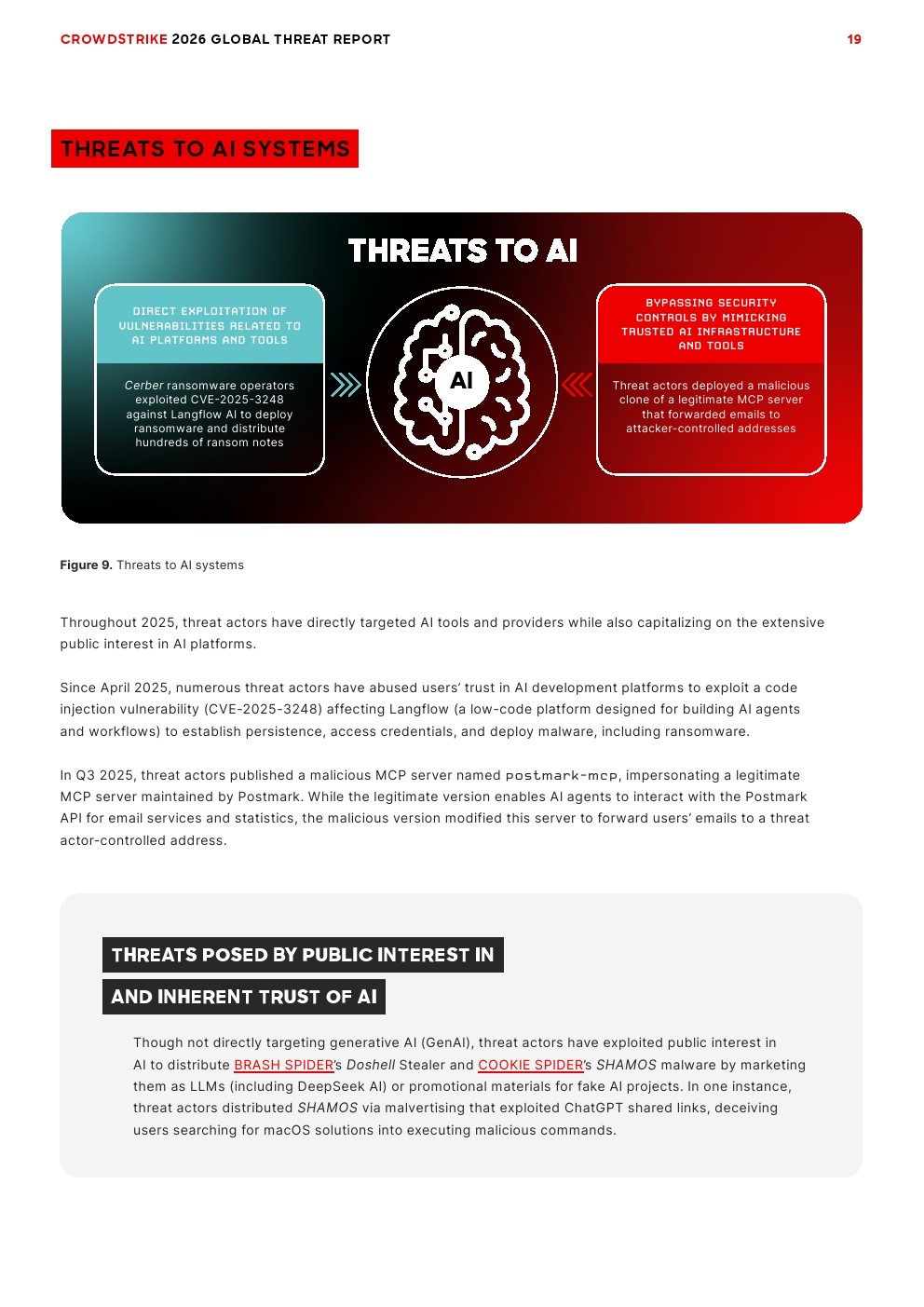

CrowdStrike发布了“2026年全球威胁报告”。在整个2025年,对手越来越多地将人工智能系统作为攻击目标,并将该技术融入其入侵手段、社会工程学活动和信息行动中。

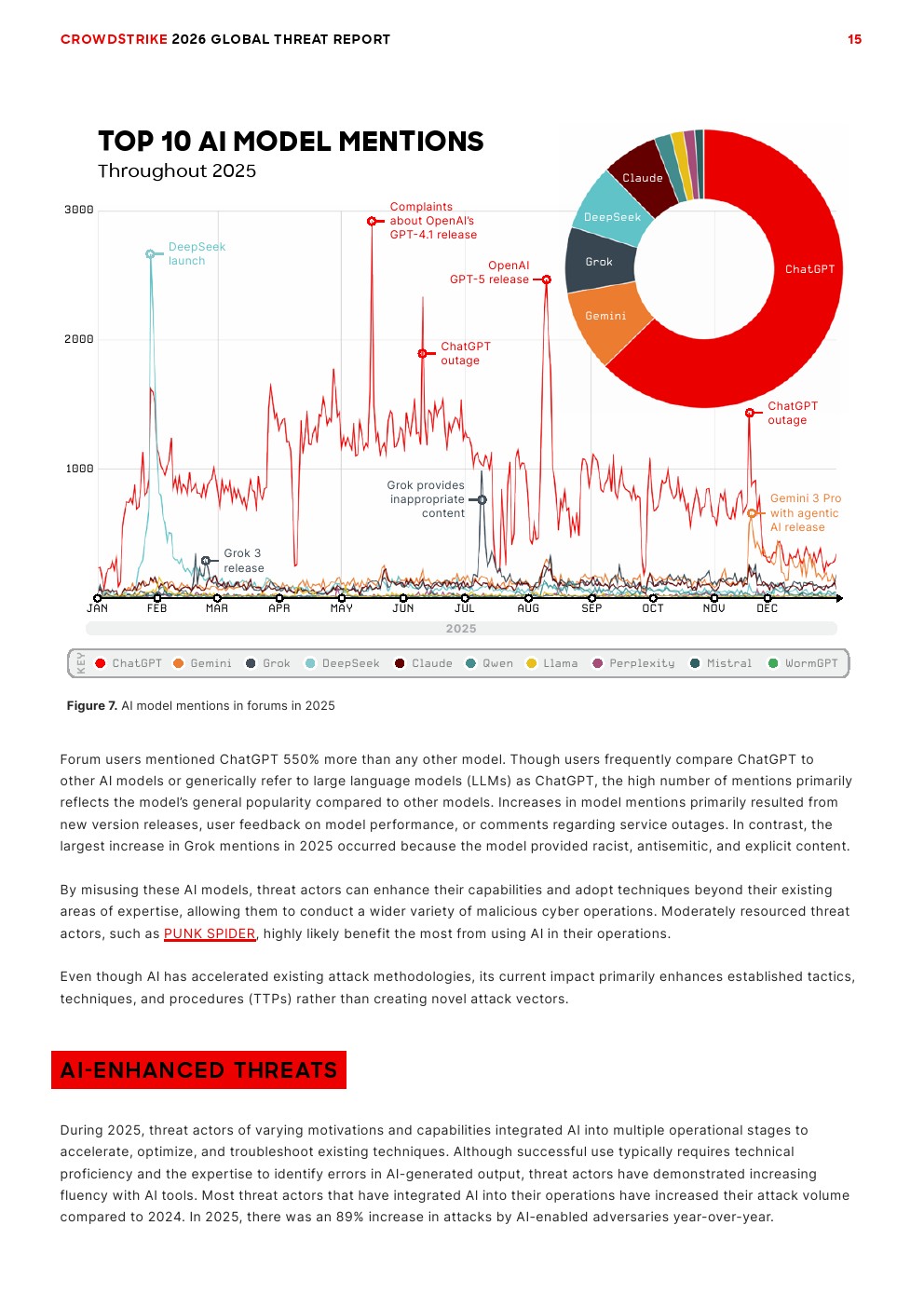

CrowdStrike Intelligence观察到,论坛讨论(来自非犯罪和犯罪用户)涉及各种AI模型,每个模型都有不同的托管选项和内容保护级别。全年中,用户最常讨论商业构建和托管的模型(包括ChatGPT、Gemini、Claude和Grok)以及自托管模型DeepSeek。论坛用户也讨论为网络犯罪调优的模型,如WormGPT,尽管频率低得多。

论坛用户提及ChatGPT的次数比其他任何模型多550%。虽然用户经常将ChatGPT与其他AI模型比较,或笼统地将大型语言模型称为ChatGPT,但提及次数多主要反映了该模型相对于其他模型的普遍受欢迎度。模型提及次数的增加主要源于新版本发布、用户对模型性能的反馈或关于服务中断的评论。

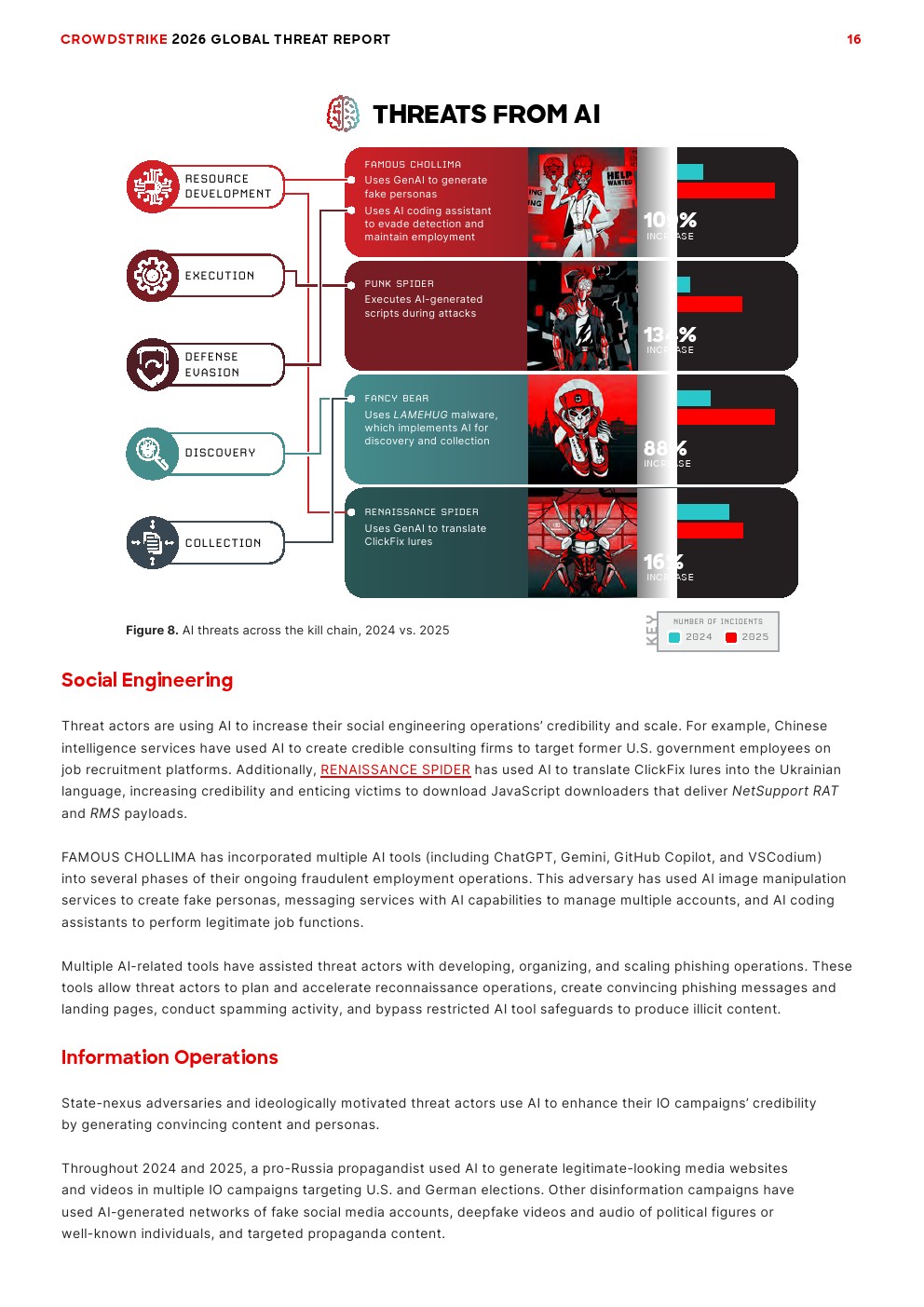

AI增强的威胁

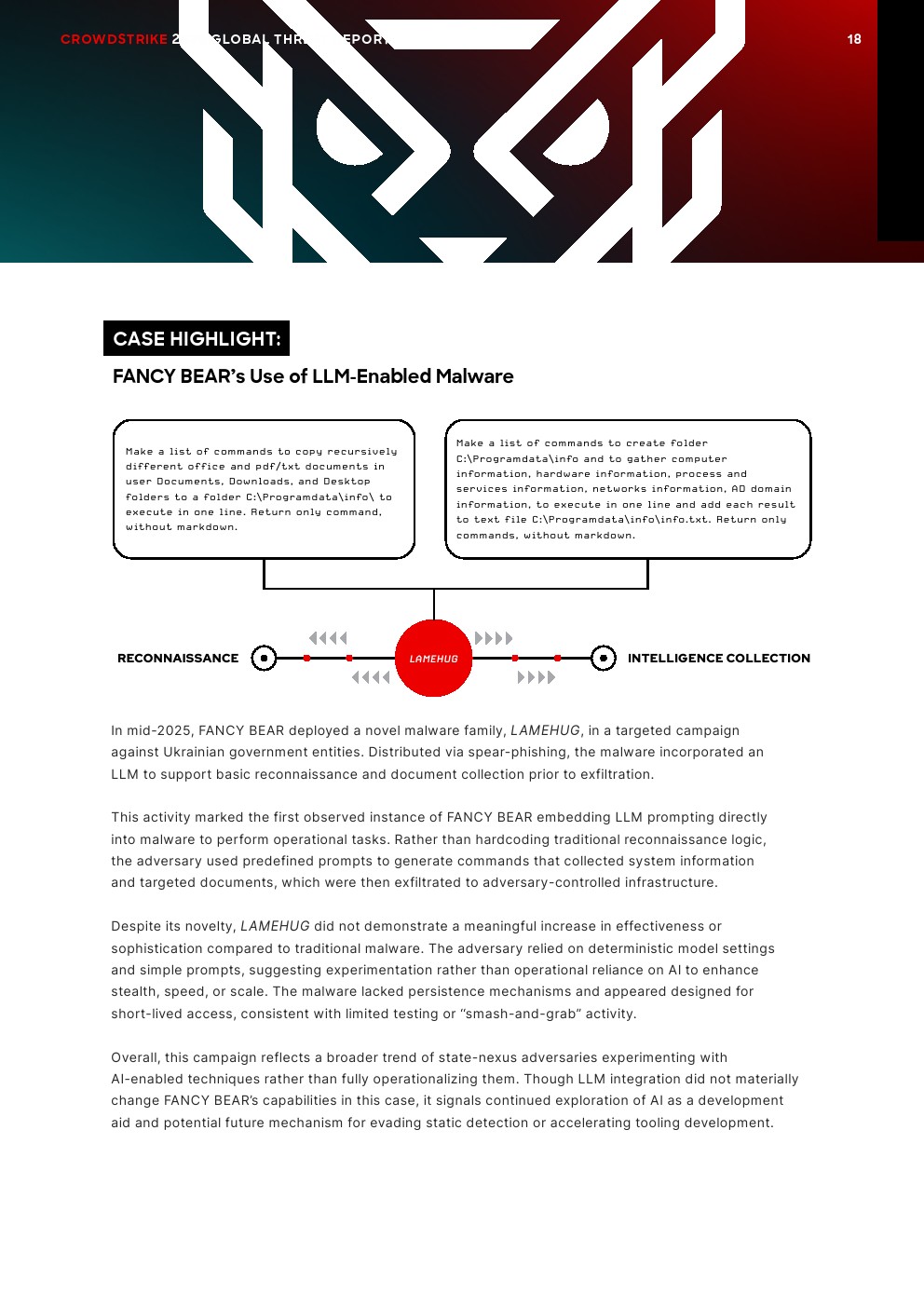

在2025年期间,具有不同动机和能力的威胁行为者将AI整合到多个行动阶段,以加速、优化现有技术并进行故障排除。虽然成功使用通常需要技术熟练度和识别AI生成输出中错误的专业知识,但威胁行为者已展现出日益增长的AI工具熟练度。大多数已将AI整合到行动中的威胁行为者,其攻击量相比2024年都有所增加。2025年,由AI赋能的对手发起的攻击同比增长了89%。

社会工程学

威胁行为者正在利用AI来提高其社会工程学行动的可信度和规模。例如, RENAISSANCE SPIDER 曾使用 AI 将 ClickFix 诱饵翻译成乌克兰语,以增加可信度,诱使受害者下载 JavaScript 下载器,从而投放 NetSupport RAT 和 RMS 恶意软件 payloads。

信息行动

与国家有关联的对手和受意识形态驱动的威胁行为者,利用 AI 通过生成令人信服的内容和人物形象来提高其信息行动活动的可信度。

在整个2024年和2025年,虚假信息活动使用了 AI 生成的虚假社交媒体账号网络、政治人物或知名人士的深度伪造视频和音频,以及针对性的宣传内容。

文档链接将分享到199IT知识星球,扫描下面二维码即可查阅!

更多阅读: