从北美颠覆性创新看AI网络互联技术的演进

本周GTC 2026正在上演,

英伟达

CEO

黄仁勋

再次强调了

AI

工厂的概念,表明核心为构建覆盖云、边缘乃至太空的全栈AI基础设施,并提出到2027年相关营收将达1万亿美元的预测。从云端来看,本次GTC聚焦Vera Rubin AI工厂平台。它是一个由Vera

CPU

、Rubin

GPU

、NVLink 6及CPO共封装

光学

交换机

等七种芯片构成的完整系统,旨在将整个数据

中心

整合为一台巨型计算机。为应对推理成本的挑战,英伟达还引入了与Groq合作的LPU推理架构,通过让GPU负责“预填充”、LPU专攻“解码”的协同模式,将推理的每瓦特Token生成效率提升了35倍。

从Scale-out和Scale-up互联角度来看,英伟达过去2年并没有在架构上做过多的革新,而是着重强调Scale-up的大规模HBD扩展,通过革新NVLink 与 NVSwitch整体性能构建Scale-up网络,并通过 Spectrum

以太网

交换机与 ConnectX 网卡的持续升级构建 Scale-out 网络。英伟达代表的是一个整体的AI交付解决方案,也是一种以英伟达计算芯片及其互联体系所衍生的封闭生态。

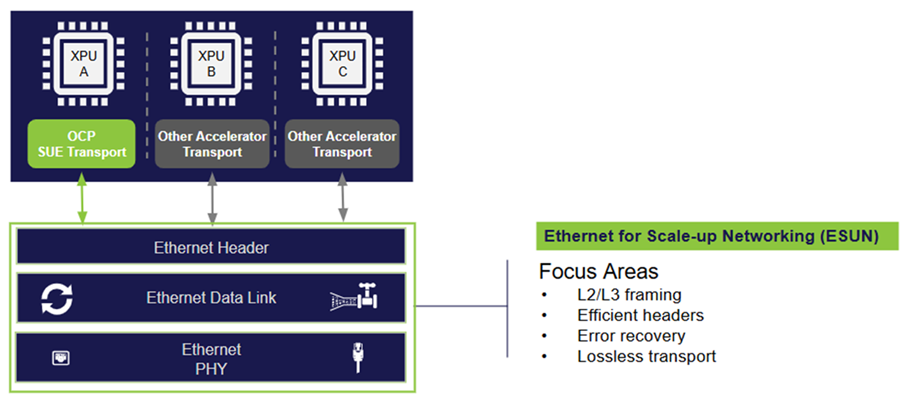

大家还沉浸在英伟达AI全栈的狂欢中,整个北美的AI网络正在以不同的形态演进。近期,OCP正式发布ESUN(

Ethernet

for Scale-up Networking,面向纵向扩展网络的以太网)1.0规范,旨在解决传统以太网在大规模AI集群场景下的多维度瓶颈——包括小数据包传输开销过高、多供应商设备互操作性缺失、无损传输能力不足等长期痛点,最终目标是将标准以太网打造为支撑EB级AI工作负载。

(图:ESUN 协议栈)

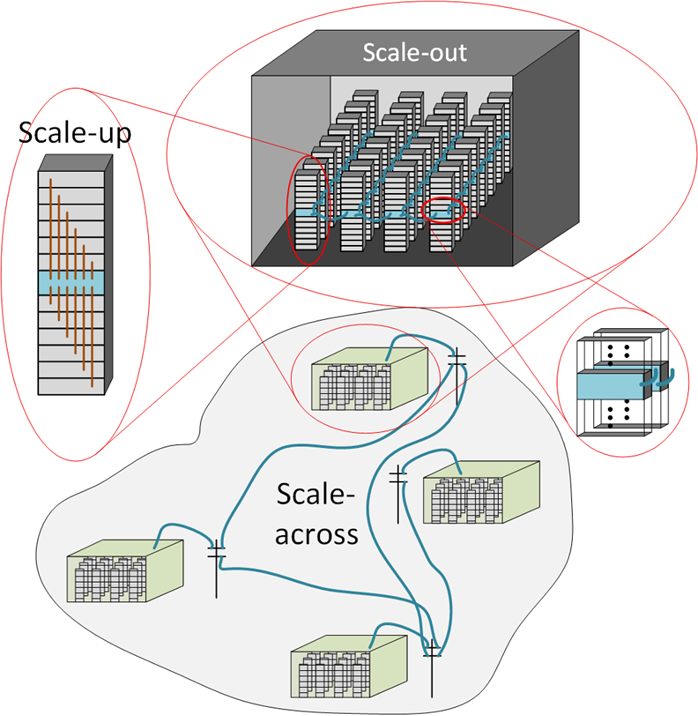

而在北美云厂商巨头一侧,打破Scale-out与Scale-up互联生态区隔的新形态正在逐步上演。Scale-up、Scale-

ac

ros

s 和 Scale-out 之间的界限在硬件最强势的北美正在逐步模糊化。

(图源:semiengineering.com)

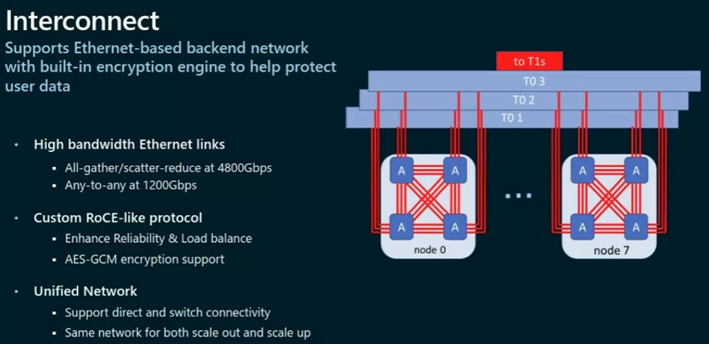

北美互联架构创新案例:Maia 200

On Die NIC 网卡(NIC)集成进主芯片

Maia 200 是微软第一颗为 AI 推理场景深度定制的系统级芯片,于 2026 年 1 月正式发布。它基于 TSMC N3(3nm)工艺制造,集成超过 1400 亿

晶体管

,TDP 功耗包络为 750W,在算力密度、内存容量与互联带宽三个维度上均实现了跨代跃升。

Maia 200 最具革命性的架构决策,是将高性能以太网 NIC 直接集成到主芯片 Die 上(On-Die NIC),通过这种方式实现了Scale-out和Scale-up网络的融合,这一设计具体实现如下:

(参考第一代Maia 100其构建的Scale-up组网形态)

1片间带宽

提供单向带宽 1.4 TB/s ,双向带宽2.8 TB/s 。

2

互联形态

在机架内部,四颗Maia 200通过直接链路全连接,形成计算域;跨机架基于自研ATL(AI传输层)协议,基于标准以太网物理层进行大规模扩展,从而实现低延迟、无损的集合

通信

。比上一代Maia 100有所升级的是,ATL 网络用于硬件级的包喷洒,多路径路由、拥塞感知流量控制等高性能R

DMA

技术,可覆盖更大的集群域。

3互联规模

多个节点内计算单元(4颗一组)通过工业标准高密度以太网交换机

ASIC

互联,形成可扩展至 6,144 台加速器的统一Scale-up 域,覆盖 MoE 模型的全局 All-to-All 专家路由流量。

总结,Maia 200 架构虽然相对激进,但用同一物理层的以太网,同时承载 Scale-up 和 Scale-out 流量,通过 ATL 协议层差异化处理两类通信语义从而实现了统一的 Scale-up 与 Scale-out 网络栈,大幅降低了部署和运维复杂度。

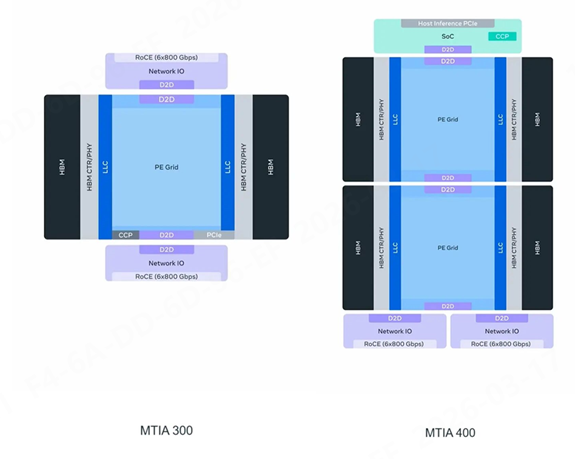

北美互联架构创新案例:Meta M

TI

A系列

Meta 的高速迭代策略并非试图“预测”模型走向,而是通过缩短反馈闭环来“紧跟”模型演变。AI 模型的迭代速度,快于传统芯片的研发周期。芯片设计基于对未来工作负载的预测,但等硬件量产上线时(通常需要两年时间),这些工作负载可能已发生巨大变化。Meta没有孤注一掷、长期等待,而是刻意采用迭代式研发思路:每一代 MTIA 都基于上一代优化,采用模块化小芯片(芯粒,将大芯片拆分为多个独立小模块拼接,降低研发难度、提升复用性)设计,融入最新的 AI 工作负载洞察与硬件技术,并以更短的周期完成部署。这种更紧凑的迭代闭环,让Meta的硬件能更好地适配不断演变的模型,同时加速新技术的落地应用。这一技术创新和奇异摩尔的Kiwi Fabric 计算与芯粒解耦技术路线不谋而合。

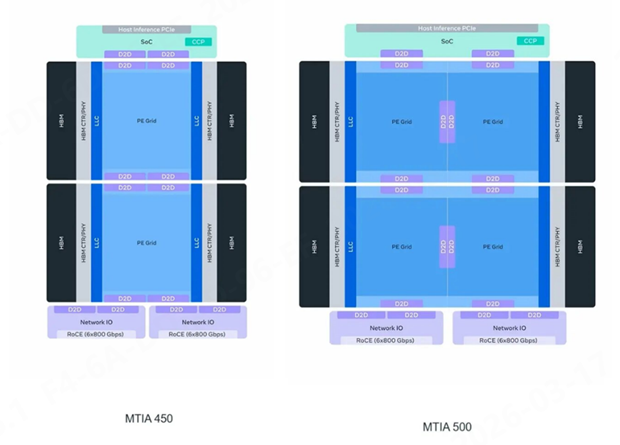

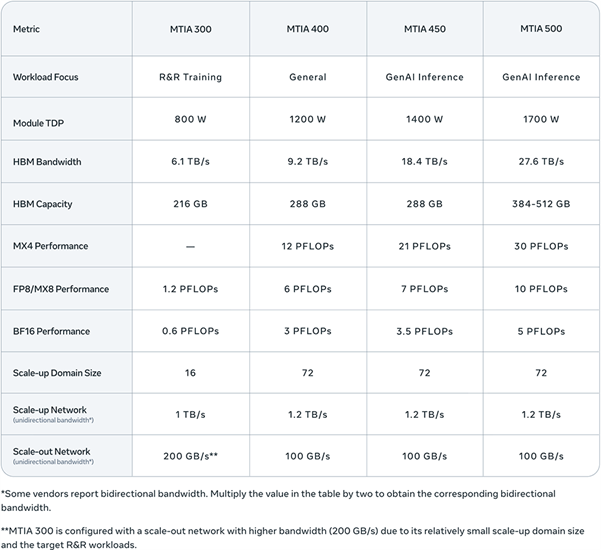

Meta 芯片MTIA的快速迭代

Meta发布的这四款AI芯片分别为MTIA 300、MTIA 400、MTIA 450和MTIA 500,由Meta与

博通

公司合作开发,基于开源的

RISC-V

架构并由TSMC生产。目前,MTIA 300已经开始生产,预计其他3款芯片将在2027年初至年底之间出货。

(图源:微软)

摩尔定律的放缓并未束缚定制硅片的步伐。从MTIA 300到MTIA 500,Meta在不到两年的时间里,完成了内存带宽4.5倍、计算性能25倍的跨越式增长。同时,Scale-Up互联能力从初代奠基走向成熟,已实现对72卡的全连接支持,并以1.2 TB/s的聚合带宽,将多颗芯片无缝整合为统一的算力节点——这正是系统级协同设计的威力所在。

网络

接口

芯粒创新

从MTIA 300开始,其显著特点包括内置网卡芯片、用于卸载通信任务的专用消息引擎、用于归约任务的近内存计算。这些低延迟、高带宽的通信组件为后续MTIA芯片中高效的GenAI推理和训练奠定了基础。在之后的迭代中,每代 MTIA 均内置 2个网络芯粒,相当于将 NIC 集成进封装内部。这个技术路径与上述微软Maia 200 的设计趋同。

1专用消息引擎

负责卸载AllReduce、AllGather等集合通信操作,使计算芯粒得以从繁重的同步任务中彻底解放,专注执行矩阵运算。

2

近内存计算

在数据不离开芯片存储层次的前提下完成Reduce类集合操作,大幅降低跨芯粒通信的延迟与能耗。

3

内置网络芯粒

将NIC功能从独立板卡“溶解”进

芯片封装

,实现通信路径的物理级缩短,为构建低开销、高密度的Scale-up互连提供硬件基础。

现有需求与未来演进的灵活组合

从 DeepSeek V3 问世至今不足 15 个月,AI 的进化速度已彻底超越人类的认知象限。纵观海外, 北美市场 AI 用户习惯已深度成型,中国出海军团正在奋起直追。MiniMax 2025 年全年营收达 7903.8 万美元(同比增长 158.9%),其中海外收入 5766 万美元,占比 73%,覆盖全球超 200 个国家和地区、累计服务 2.36 亿用户。Kimi 旗下 K2.5 大模型发布不足 20 天,累计收入便超越 2025 年全年总额,海外收入首次超越国内。

聚焦国内:AI 正以前所未有的速度贴近每一位普通用户。字节Se

eda

nce 2.0 作为首款落地春晚级超高清直播场景的 AI 视频大模型,在央视春晚直播中实现实时渲染,引发全球瞩目。与此同时,开源 AI 智能体 OpenClaw("养龙虾")在发布两周内席卷全网热搜,引发广大普通消费者关注。

而互联,作为支撑AI Worklo

ad

的重要硬件一环,其技术演进不可忽视。就现有广泛部署的基础设施而言,面向 Scale-out 的网络仍占重要席位,成熟的 RDMA over Ethernet 生态已在数据中心大规模落地。以 CX-7 系列为代表的高性能 RDMA 网卡,将端到端延迟压缩至 800 ns 以内,相比传统标准网卡实现 延迟降低 79%、消息率提升 345%,也是当前国内主流应用网卡。下一代支持高性能RDMA技术的AI NIC 在国产化替代政策的明确支持下成为重点突破方向并迎来从验证到规模部署应用的关键窗口期。

AI Workload 的快速进阶——从 Dense Transformer 到 MoE、从短上下文到超长推理链、从训练主导到推理主导——正在为 Scale-up 与 Scale-out 的全局架构带来巨大的不确定性。如今的超节点网络演进对于未来的硬件所需的性能及架构提出了挑战。正如北美市场2大云巨头的布局,网络功能正在从"GPU 附属品"演变为独立的、可单独迭代的核心计算基础设施单元。本质上都是在回答同一个问题:如何在AI快速演进迭代下让互联能力与计算能力以不同的速度独立进化,同时最大化整个超节点的系统效率。

奇异摩尔的答案:以芯粒为形态, 构建覆盖现在与未来的双轨互联产品线

SoC 单一路径的本质矛盾:它是为稳定时代设计的产品形态,却要服务于一个激进迭代的时代。以芯粒为形态构成的AI NIC、基于以太网并支持内存语义的G2G IOD互联芯粒可分别对应现有和未来AI 网络演进的产品解决方案,更符合应对未来AI Model的快速迭代。

一方面,未来无论是Scale-out还是Scale-up网络,对于网络传输都需要具备不同层级的重传和流控机制,例如Link Level Retry链路层重传、Credit based flow control基于信用的流量控制机制等技术。另一方面,Scale-up相对Scale-out的传输速率要求更高、要求时延更低,但规模较小。Scale-up 网络面向千卡万卡,需要更简洁高效的传输协议,和基于包的无损多径网络的控制算法。

奇异摩尔基于自己独创的HPDE引擎,在统一的微架构下,根据网络的不同需求,最大程度复用公共基础IP,将不同层次的网络传输功能分别集成在AI SNIC和GPU互联芯粒G2G IOD产品中,实现研发平台的可复用性和具灵活性, 从容面对未来Scale-out和Scale-up网络的融合。

开放共创AI Infra未来,奇异摩尔

受邀出席2026 Open AI Infra Summit

4月9-10日,奇异摩尔受邀出席2026 Open AI Infra Summit大会。会上奇异摩尔网络架构 VP 叶栋将在其《AI 原生时代:基于 Scale Out 及 Scale Up 网络的智算互联解决方案》的演讲中,分享奇异摩尔对 AI 智算场景的深度理解,逐一

拆解

当前 Scale-out 与 Scale-up 网络面临的需求与挑战,并分享奇异摩尔在 AI 原生超级网卡与超节点互联芯粒技术上的最新解决方案,探讨如何通过开放、高效的互联技术,为 AI 高性能计算提供更坚实、更强劲的支撑。

综上而言,技术终将更迭,架构总会重塑,但商业的底层逻辑从未改变——趋势洞察决定方向,风险规避决定存活,而交付能力,决定了一家企业能否在AI的牌桌上坐到最后。 当大潮退去,裸泳者消失,留下来的人将证明:看清本质是智慧,灵活转身是勇气,而持续交付,才是一家企业最深沉的护城河。

网络

网络

+关注

关注

14

文章

8290

浏览量

95183

AI

AI

+关注

关注

91

文章

40148

浏览量

301768

英伟达

英伟达

+关注

关注

23

文章

4099

浏览量

99327

原文标题:现在还是未来?从北美颠覆性创新看AI网络互联技术的演进

文章出处:【微信号:奇异摩尔,微信公众号:奇异摩尔】欢迎添加关注!文章转载请注明出处。