华为昇腾系列AI芯片:演进路径、架构、生态和详细参数对比

发布时间:2026-04-08来源:芯东西

![]()

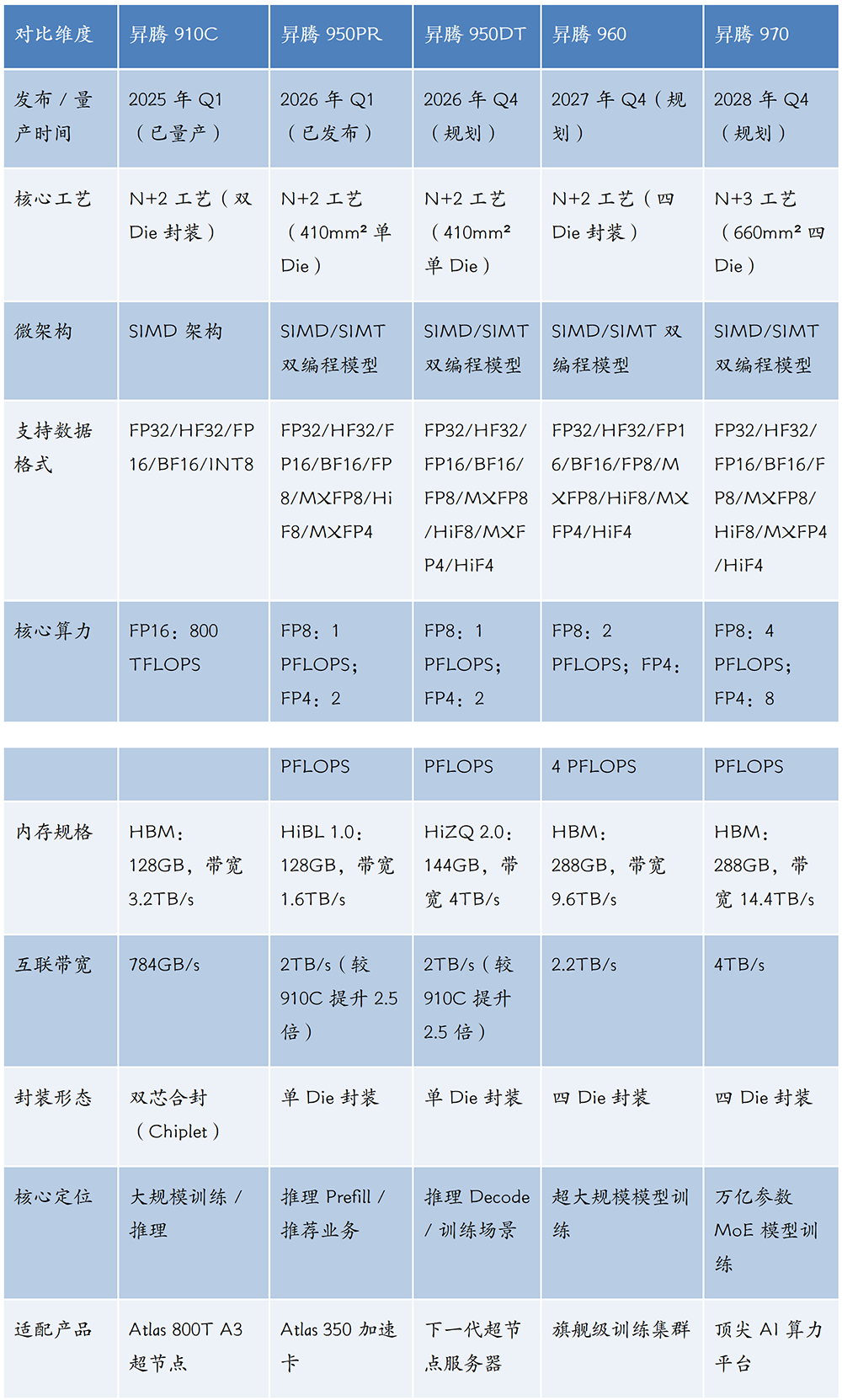

华为昇腾910C至970的迭代遵循“三年四代”战略规划(2025-2028),形成清晰的技术跃迁路径,核心围绕“算力密度、场景适配、国产化自主”推进。

1. 昇腾910C(2025)—— 国产化算力基石作为第三代昇腾的开篇之作,910C并非全新设计,而是通过双昇腾910B芯片合封(Chiplet技术)实现算力倍增,快速填补国内千亿参数模型训练的算力空白。面对DeepSeek等开源大模型带来的算力冲击,华为以成熟架构快速迭代,2025年Q1量产落地后,通过Atlas 800T A3超节点实现300+套规模部署,服务20+行业客户,完成 “从可用到好用” 的市场验证。局限性明显:SIMD单一架构、缺乏低精度优化、依赖外部HBM,难以满足大模型推理细分场景与成本控制需求,为950系列的场景化分化埋下伏笔。2. 昇腾 950PR/DT(2026)—— 场景化细分突破首次采用“同核心+差异化配置” 策略,950PR与950DT共享950 Die核心架构,仅通过自研HBM内存(HiBL 1.0/HiZQ 2.0)和软件优化实现场景分化,这是华为芯片迭代从 “大一统” 到 “精准适配” 的关键转变。引入FP8/FP4低精度格式,FP8算力达1PFLOPS,自研HiF8格式解决“低精度+高保真”矛盾,精度接近FP16;950PR采用低成本HiBL 1.0内存,定价较竞品低30%,降低推理场景门槛;950PR适配Atlas 350标卡,950DT瞄准超节点服务器,覆盖“边缘推理、云端训练”全链路。3. 昇腾960/970(2027-2028)—— 超大规模算力跃升遵循“规格翻倍” 原则,960相比950系列实现算力、内存容量、带宽的全面翻倍,970再翻一番,形成 “每代性能倍增” 的迭代节奏。960支持自研HiF4格式(业界最优4bit精度),适配千亿参数模型;970以8 PFLOPS(FP4)算力和4TB/s互联带宽,瞄准万亿参数MoE架构,呼应AGI时代的算力需求。970首次采用N+3工艺,660mm²四Die封装设计,能效比较910C提升 30%,破解 “算力提升伴随功耗激增” 的行业难题。

昇腾系列的架构创新贯穿迭代全程,核心围绕“计算效率、编程兼容性、场景适配性” 三大目标,形成清晰的技术传承与突破脉络:1. 架构核心突破:SIMD→SIMD/SIMT双编程模型910C的SIMD架构:专注向量计算效率,适合大规模连续数据处理(如模型训练的矩阵运算),但对碎片化数据(如推理Decode阶段的token生成)支持不足,内存访问颗粒度512字节,离散访问效率较低。- SIMD保留高效向量处理能力,适配“大块数据流水线运算”;

- 新增SIMT模型,支持灵活调度碎片化数据,内存访问颗粒度缩减至128字节,离散访问效率提升4倍;

- 双模型无缝切换,实现“训练 + 推理” 全场景高效适配,解决传统AI芯片“训练强推理弱”或“推理强训练弱”的痛点。

2. 生态兼容架构:ASIC+GPGPU双生子设计950系列起引入“双生子”架构策略:ASIC版本(昇腾Core)深度适配华为CANN生态,最大化硬件效率;GPGPU版本兼容CUDA生态,降低客户迁移成本(尤其针对原英伟达用户)。这一架构设计并非技术妥协,而是华为“生态开放”战略的体现 —— 配合CANN编译器开源、MindSpore框架开源,形成“硬件兼容 + 软件开放”的双重保障,加速产业落地。910C的外部HBM依赖:128GB容量、3.2TB/s带宽,虽能满足千亿参数模型需求,但成本高、供应链受限;950系列的自研HBM突破:HiBL 1.0(成本优化)与 HiZQ 2.0(性能优化)双方案,首次实现HBM国产化自主,950DT的HiZQ 2.0带宽达4TB/s,超越同期业界水平;960/970的存储跃升:288GB HBM容量+最高14.4TB/s带宽,配合2.2TB/s-4TB/s互联带宽,支持多芯片集群线性扩展,950系列超节点性能可超越英伟达2027年NVL576系统。

五款芯片并非孤立存在,而是形成“基础层、场景层、高端层”的三级协同体系,支撑华为“超节点+集群”的算力战略:950-970均延续“达芬奇架构”核心,在计算单元、指令集层面保持兼容性,确保基于910C开发的应用可平滑迁移至新一代芯片,降低生态迁移成本;950的低精度格式(FP8/HiF8)、双编程模型等核心技术,在960/970中进一步优化,仅通过工艺升级、封装扩展实现性能跃升,避免 “推倒重来” 的研发浪费;从910C的CloudMatrix 384超节点,到950的Atlas 950 SuperCluster(50万卡级),再到960的Atlas 960 SuperCluster(百万卡级),芯片迭代与超节点集群演进同步,形成 “芯片、集群、应用” 的端到端优化。2. 同代互补关系:950PR与950DT的场景协同作为同代双芯片,950PR与950DT形成 “推理分工 + 训练互补” 的协同模式。950PR聚焦推理Prefill阶段(长上下文输入处理)和推荐业务(计算密集型),950DT侧重推理Decode阶段(token生成)和训练场景(访存密集型),二者组合可覆盖大模型全流程推理需求;入门级:910C作为成熟产品,持续服务政务、金融等通用 AI 场景,提供高性价比的 “训练 + 推理” 一体化解决方案;中端:950系列聚焦推理细分场景,通过成本优化与性能升级,成为产业规模化落地的核心引擎;高端:960/970瞄准超大规模模型与AGI研发,打造国产顶尖算力平台,突破海外技术垄断。

华为昇腾系列的迭代逻辑,本质是在半导体制造工艺受限的背景下,通过架构创新、场景分化、生态协同实现算力突围:SIMD/SIMT双模型、自研HBM、Chiplet封装等架构创新,弥补了N+2/N+3工艺与国际先进工艺的差距,使970的FP4算力(8PFLOPS)接近英伟达Blackwell B300(15PFLOPS);放弃“一款芯片通吃所有场景” 的传统思路,通过950系列的场景分化,在推理细分市场形成差异化优势,避免与海外巨头正面竞争;从芯片到框架、编译器、应用套件的全栈开源开放,形成“硬件-软件-应用” 的生态闭环,构建难以复制的产业壁垒。

(数据来源:全联接大会 2025 + 行业研报,仅供参考,具体以发布产品参数为准)

1. 算力演进:从 “规模提升” 到 “精度优化”昇腾910C:作为第三代昇腾开篇之作,以800TFLOPS(FP16)算力奠定基础,采用双昇腾910B芯片合封设计,适配CloudMatrix 384超节点集群,可支撑千亿参数模型训练。950系列突破:首次引入FP8/FP4低精度格式,算力跃升至1PFLOPS(FP8),华为自研HiF8格式实现“低精度+高保真”平衡,精度接近FP16,解决大模型训练中的算力与精度矛盾。960/970迭代逻辑:遵循“每代算力翻倍” 原则,970最终实现8PFLOPS(FP4)算力,配合N+3工艺优化,能效比较910C提升30%以上,适配动态稀疏计算与MoE架构。2. 架构创新:SIMD/SIMT 双模型适配多元场景910C沿用SIMD架构,专注高效向量计算;950及后续型号新增SIMT编程模型,支持“大块向量流水线处理 + 碎片化数据灵活调度”,内存访问颗粒度从512字节缩减至128字节,离散内存访问效率提升4倍。同时提供ASIC(昇腾Core)和GPGPU双生子型号,分别适配CANN生态和CUDA兼容生态,降低客户迁移成本。950系列首次采用华为自研HBM方案,950PR的HiBL 1.0侧重成本控制,950DT的HiZQ 2.0强化带宽(4TB/s),适配训练场景的高访存需求;960/970通过容量翻倍(288GB)和带宽飙升(最高14.4TB/s),彻底解决万亿参数模型的内存限制。从910C的784GB/s到970的4TB/s,互联带宽提升5倍,支持多芯片集群线性扩展,950系列超节点可超越英伟达2027年NVL576系统性能。昇腾910C:通用性强,覆盖“训练 + 推理” 全场景,当前已广泛应用于政务、金融等行业的AI基础设施建设。950PR/DT分工:PR聚焦推理Prefill阶段(如视频推荐、实时交互),DT侧重推理Decode阶段(如对话生成)和训练任务,通过差异化内存配置(128GB vs 144GB)适配不同访存需求。960/970:瞄准超大规模场景,960支持288GB超大内存,适配千亿参数模型;970以4TB/s互联带宽和8PFLOPS算力,成为MoE等下一代AI架构的核心支撑。

全栈优化:从芯片(昇腾)、框架(MindSpore)、算子库(CANN)、应用(ModelArts),形成端到端优化,950系列向量算力占比提升30%,任务调度延迟降低50%。国产化突破:N+2/N+3工艺自主可控,HBM内存摆脱对外依赖,HiBL/HiZQ系列自研存储技术填补国内空白,互联架构打破英伟达 NVLink 垄断。成本优势:950PR定价约10万元/卡(重点客户8万元),较同性能竞品低30%;960/970通过多Die封装提升良率,进一步降低大规模部署成本。综上,昇腾910C-970的迭代并非简单的性能堆砌,而是华为在算力战略下的系统性布局:以910C奠定基础,以950系列实现场景突破,以960/970冲刺顶尖算力,最终形成覆盖全场景、全算力等级的国产AI芯片生态,为中国人工智能产业的可持续发展提供核心支撑。OpenClaw 凭什么刷屏?爆火逻辑、核心争议与未来挑战OpenClaw、MaxClaw、KimiClaw深度分析:入门该选哪个?OpenClaw卸载完全指南:从 “全民养虾” 到 “理性卸载”最全 OpenClaw 中文教程下载(840+页)谷歌TPU典配:3D Torus+DCN多层组网+OCS 支撑超大规模低时延GPU典配:第六代NVLink&满配 CPX,拆解Rubin NVL 144AWS Trainium3典配:组网“高密度互联 + 灵活扩展”组网解析宕机背后的技术博弈:DeepSeek V4隐身测试与难产之谜全球AI收费模式变天:Tokens失宠,集体转向PTU模式!

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。