谷歌发布两款AI芯片

发布时间:2026-04-23来源:半导体行业圈

半导体行业圈 振兴国产半导体产业!

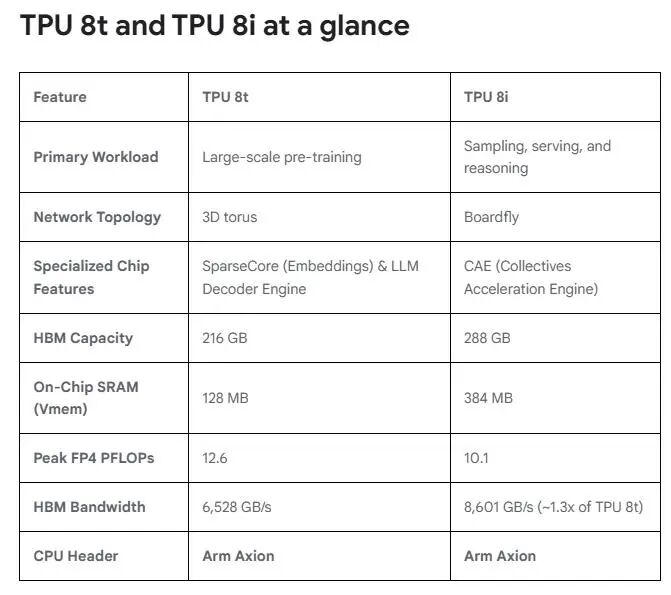

日前,谷歌在 Google Cloud Next 2026大会上正式推出第八代张量处理单元(TPU),该产品是谷歌云和DeepMind联合设计的,分为面向大规模训练的TPU 8t与面向低延迟推理的TPU 8i两款芯片。谷歌表示,第八代TPU的目标是为AI智能体场景提供算力支撑,并大规模适配不断演进的模型架构。这是谷歌首次将训练与推理任务拆分至独立芯片,标志着其AI硬件路线的重大转向。TPU 8t定位训练加速,旨在将前沿模型的开发周期从数月缩短至数周。TPU 8t的每个节点性能较上一代提升近3倍。单个TPU 8t节点现在更是扩展至9600个芯片并配备2PB共享HBM内存,芯片间带宽翻倍。谷歌表示,一个节点可提供高达121 ExaFlops的算力。同时,TPU 8t还通过一套全面的RAS功能去实现超过97%的有效吞吐量,以减少硬件故障导致训练停止的情况发生。TPU 8i 则聚焦推理场景,针对多智能体协同、低延迟需求优化。TPU 8i的每个节点扩展至1152个芯片,配备384MB的片上SRAM和288GB的HBM内存,这可以让模型的活动工作集完全保留在片上。同时,谷歌将每台服务器的物理 CPU主机数量翻倍,并转而采用定制的Axion CPU。全新的Boardfly拓扑架构将最大网络直径降低了50%以上,大幅降低了延迟。两款芯片均计划于2026年晚些时候正式对外供应。与去年11月发布的第七代Ironwood TPU相比,TPU 8t在同等价格下性能提升2.8倍,TPU 8i性能提升80%;两款芯片每瓦性能均较上一代提升逾一倍,TPU 8t达124%,TPU 8i达117%。谷歌强调,这两款芯片首次均运行于谷歌自研的基于Axion ARM架构的CPU主机上,这让他们能够针对性能和能效对整个系统进行优化。软件支持方面,两款芯片均支持开发者日常使用的原生 JAX、MaxText、PyTorch、SGLang 和 vLLM 等框架,还提供裸金属访问权限,让客户可直接访问硬件。在功耗优化上,第八代TPU也有升级。谷歌对整个技术栈的能效进行了优化,集成的电源管理功能可根据实时需求动态调节功耗。第八代TPU的每瓦性能较上一代 Ironwood提升高达两倍。同时,两款产品均搭载了第四代液冷技术,可实现风冷无法企及的性能密度。

*免责声明:以上内容整理自网络,不代表半导体行业圈的观点和立场,仅供交流学习之用。如有任何疑问或异议,请留言与我们联系。

爆料|投稿|合作|社群

文章内容整理自网络,如有侵权请联系沟通

投稿或商务合作请联系xd211ic

有偿新闻爆料请添加微信

xd211ic

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。