安森美Hyperlux ID解锁机器视觉应用新可能

深度感知是现实机器视觉应用中不可或缺的关键功能。

安森美

(onsemi)的Hyperlux ID 间接飞行时间 (iToF) 深度

传感器

,凭借更少、更小、更简单的器件,即可实现

高精度

深度感知。本系列文章将深度

拆解

安森美Hyperlux ID 技术及应用。

第一篇推文介绍了

机器视觉

基础知识

第二篇文章介绍了iToF 技术

强光环境下的高精度深度感知

环境光过强会导致像素接收的深度

信号

饱和甚至完全失效,这是 iToF 深度

传感技术

的一大痛点。当传感器前方的场景处于强光照射下时(例如工业装配车间环境),所有

图像传感器

,尤其是采用 iToF 技术的 CMOS 图像传感器,其判断深度与距离的难度都将显著增加。

要削弱环境光的影响,需采用环境光抑制的图像处理技术。该技术巧妙运用

光学

原理与波长调制方法,将光学信号视为声学信号进行处理,从而克服物体表面光信号过饱和的问题。环境光过强会给距离与反射率的测量带来诸多挑战,而Hyperlux ID 则通过两种方式克服了这些挑战:一是在符合人眼安全标准的前提下优化照明功率;二是调节积分时间,即在设定的测量周期内,灵活调整传感器的光积分量。

消除运动伪影

采用 iToF 技术的 CMOS 图像传感器,面临的另一大挑战是消除运动伪影。运动伪影指传感器在试图捕捉运动物体时,图像中出现的失真或不真实的元素。在普通 CCD

数码

相机中,高速运动的物体在画面中会呈现为模糊影像。由于胶片相机也会产生类似的模糊效果,这种现象常被视为摄影的固有特性,甚至被用作艺术表现手法。

对于高速

光电

探测器

而言,这类本应表现为模糊的影像(例如旋转的螺旋桨叶片,或传送带另一侧高速运转的

机械

臂),可能呈现为悬浮在空中的怪异虚影。这些虚影并非真实物体,因此需要图像处理单元将其识别并忽略。

AF0130 的伪影补偿始于其全局快门技术,该技术可让传感器的所有像素同时曝光。

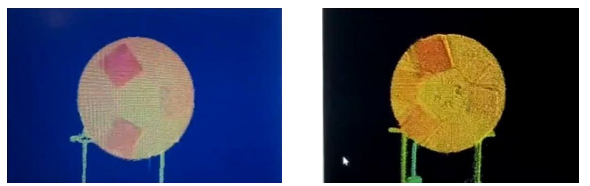

图 1. 左:搭载智能 iToF 的安森美 AF0130。右:竞品 iToF 传感器。

为了测试这种智能 iToF 技术的有效性,安森美开展了一项测试:使用一个装有三块不同厚度木块的旋转轮盘(木块颜色越深则厚度越大)进行成像。在竞品传感器拍摄的画面中,轮盘上始终呈现出六块木块的影像——这是传感器受环境光等因素影响,与光线发生异常作用而产生的光学错觉。相比之下,AF0130 拍摄的视频虽也存在轻微的光学错觉,但其每一帧画面中仅显示三块木块,只是木块会出现位置小幅偏移和交替闪烁换位的现象。

AF0130 拍摄的每一帧画面都更加贴近真实场景,基于这些画面生成的深度图,精度也远高于竞品。

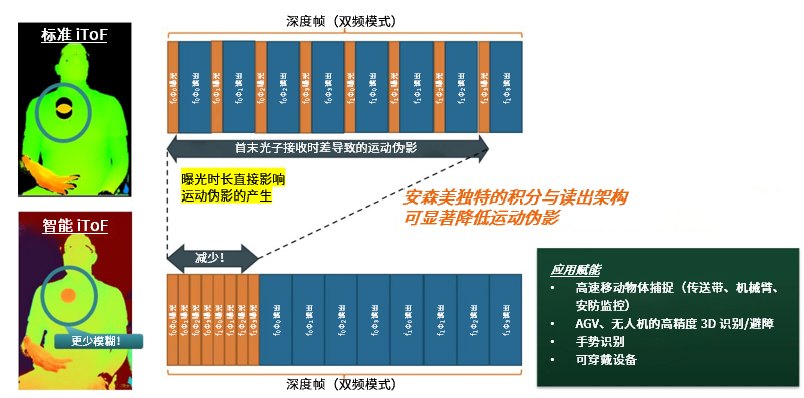

成像系统的典型帧曝光处理流程是,先将曝光数据写入存储器,然后分配时间执行读出阶段。读出阶段的任务是,将传感器采集到的像素值依次数字化并存储到存储器中。普通图像传感器被设定为曝光后立即开始读出阶段。如果传感器需要对连续八帧图像重复此过程,那么曝光间隔将过大,导致深度图各部分数据无法准确匹配。这个问题会导致图像中出现大量运动伪影,对于繁忙的城市街道或装配线传送带等实际应用场景而言,这是不可接受的。

图 2.标准 iToF 与智能 iToF 对比

AF0130 搭载的智能 iToF 技术通过先连续完成八帧曝光,再统一执行所有帧的读出操作,克服了运动伪影的难题。这一设计大大减少了运动模糊现象,显著提升了手势识别系统的可靠性,这类系统需要准确区分具有指令意义的手臂动作与模糊虚影。(各帧曝光之间仍存在微小的时间间隔,但这些间隔短到足以忽略不计。)

以下是 AF0130 典型曝光场景的计算过程:120 万像素传感器的标准成像帧率约为 29.97 帧/秒;在 MI

PI

存储总线单通道吞吐量为 1.2 Gbps 的条件下,其最优曝光时间(首光子到末光子的响应速度)为 300 µs。存储帧中每个像素为 12 位,因此,当两条 MIPI 线路同时工作时,吞吐量应该约为 2 亿像素/秒。

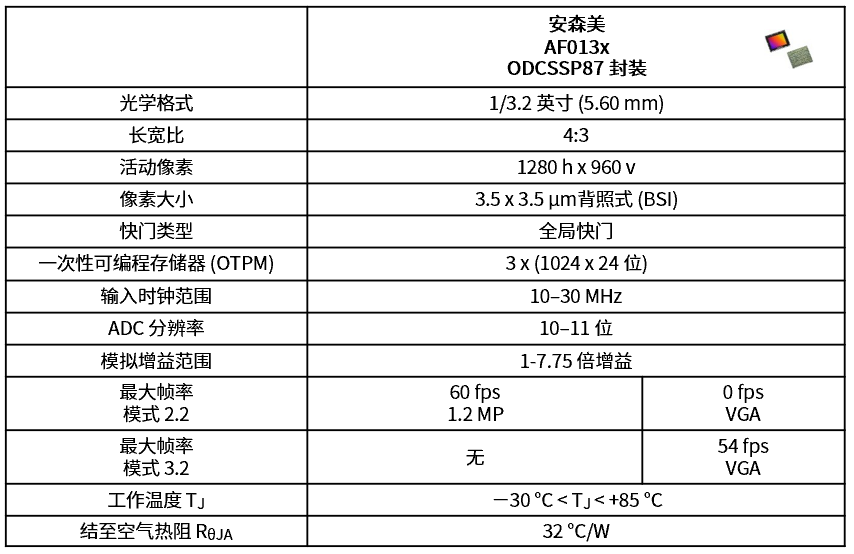

表1

一张 120 万像素的图像包含 1280 x 960 个像素,因此该图像的读出耗时为 6.1 ms。Hyperlux AF0130 可在首次读出阶段开始前,将所有曝光数据存储在传感器内。相较之下,竞品传感器会在前四帧之间穿插执行三次读出操作,因此其首光子到末光子的响应速度为 0.3 ms x 4 + 6.1 ms x 3 = 19.2 ms。

相较之下,AF0130 首光子到末光子的响应速度为 0.3 ms x 4 + 0.25 ms x 3 = 2 ms。凭借这一简单的流程调整,AF0130 在 29.97 fps 帧率下,运动性能达到了竞品的 9.6 倍。

再看另一种应用场景:假设帧率提升至约 60 fps。为支持深度处理,每个 MIPI 通道的吞吐量需要达到 2 Gbps(此处假定该条件具备可行性)。在该吞吐量下,传感器的像素处理能力可达 3.33 亿像素/秒,单帧图像的读出耗时为 3.7 ms。AF0130 首光子到末光子的响应速度为 0.1 ms x 4 + 0.25 ms x 3 = 1.15 ms。而竞品传感器的这一数值为 0.1 ms x 4 + 3.7 ms x 3 = 11.5 ms。这意味着,安森美 Hyperlux ID 系列传感器在 60 fps 的帧率下,运动性能达到了竞品的 10 倍。

利用情景配置实现灵活适配与微调

通过校准 Hyperlux ID 的全局快门,可以针对特定应用对这款图像传感器进行微调。例如,如果传感器需适配仅两米外的传送带场景,则可以将 AF013x 校准为聚焦于四米范围内的反射光信号。这类用于微调传感器工作特性的参数规格可以作为情景配置存储在传感器本地。这样一来,当应用场景发生变化时,只需切换使用对应的情景配置即可。

AF013x 还具备动态调整能力。例如,当反射物体距离过近,导致曝光强度过高、图像细节丢失时,AF013x 可自动缩短曝光时间;或者,如果全局快门原本针对远距离探测设定,而近处有物体进入画面,动态情景切换功能可让传感器立即重置参数,避免近处物体在画面中呈现为大片模糊虚影。这一功能在安防监控场景中尤为实用:例如,传感器通常针对 10 米外的大门进行参数调校,但仍能清晰捕捉在 2 米处进入画面的移动物体(即便是高速移动物体)。

降低系统复杂度与成本

对于采用 iToF 技术的标准单调制器图像传感器而言,深度感知的相关

算法

通常需要由外置

微控制器

或

FPGA

阵列来处理。而 Hyperlux ID AF0130 将这些功能直接集成到芯片内部,使组件设计不再需要以下外置器件:

- 片外微控制器或 FPGA 阵列(这类器件需要独立的

电源

树和电压轨)

- 帧存储单元(通常需要存储器

控制器

)

- 用于连接图像传感器、微控制器和存储器的高速

接口

将深度处理功能集成到图像传感器内,不仅能降低系统带宽占用与算力需求,还可简化搭载该传感器的组件设计、缩小组件尺寸,并降低组件的生产制造成本与运维成本。

Hyperlux ID 量化结果

安森美 Hyperlux ID AF0130 与 AF0131 深度传感器所实现的技术突破,可以重塑工业机器视觉组件的设计范式,使这类组件更易于生产制造、维护保养、工程开发,同时具备更高的性价比。

- AF013x 搭载的 120 万像素 BSI 全局快门,可使 CMOS 图像传感器实现超高精度的深度感知能力。

- 智能 iToF 技术与片上存储结合,可减少甚至消除运动伪影,助力需要高精度机器视觉的图像与物体识别系统类

AI

软件提升准确性。

- 片上集成算法处理功能,完全消除对外部微控制器的依赖,从而简化组件设计、缩小组件尺寸,同时降低功耗。

- 卓越的环境光抑制能力可提升传感器的无歧义测距范围,从而支持更广泛的机器视觉新应用。

- 依托安森美行业标准 Devware X 开发环境,可实现开放式软件开发与可

编程

控制,并支持自定义情景配置。

技术愿景:迈向真正的机器视觉

在需要兼顾速度与精度、但无需超远距离感知的场景中,Hyperlux ID 解决了机器视觉技术实用化与适配难题。现代机器需要“看清”自己的动作,只需在关键微秒内获取相关的深度与空间数据。曾几何时,低功耗 CMOS 技术因易受温度与噪声干扰,并不适用于这类应用场景。但如今,随着工程设计的改进与编程技术的优化,CMOS 技术不仅克服了自身的短板,更在性能上超越了 CCD 等传统技术。

随着机器视觉技术逐渐成为各类时空感知设备的标配功能,工业设备也亟需在技术性能、可靠性、供应链稳定性与技术支持服务上均能满足规模化应用需求的图像传感器。安森美提供的

元器件

产品,正致力于推动机器视觉生态朝着更简洁、更高效的方向发展。

传感器

传感器

+关注

关注

2578

文章

55527

浏览量

794011

安森美

安森美

+关注

关注

33

文章

2157

浏览量

95836

机器视觉

机器视觉

+关注

关注

166

文章

4829

浏览量

126518

原文标题:高精度+消除运动伪影!安森美Hyperlux™ ID解锁机器视觉应用新可能

文章出处:【微信号:onsemi-china,微信公众号:安森美】欢迎添加关注!文章转载请注明出处。