惠普、戴尔RTX 50笔记本集体大爆发!外星人首次杀入万元内

发布时间:2026-05-25来源:快科技

快科技5月26日消息,惠普与戴尔近日集中推出多款搭载NVIDIA RTX 50系列显卡的新品笔记本,覆盖从入门到旗舰的完整产品线。

戴尔外星人15国行版已在电商平台正式开售,这是戴尔高端品牌外星人首次杀入万元以内,使用专享优惠券后最低到手价仅8499元,创下外星人系列入门价位新低。

配置方面,外星人15采用AMD锐龙7 260处理器,搭配NVIDIA GeForce RTX 5060笔记本电脑GPU,配备16GB内存与1TB存储。

整机总性能功率可达110W,搭载偏置双风扇三热管散热系统,配备15.3英寸1920×1200分辨率165Hz刷新率屏幕。

此外,戴尔游匣G16 2026款也已同步更新,搭载Intel 酷睿 i7-14650HX处理器,显卡可选RTX 5060或RTX 5070,配备16英寸2.5K 240Hz屏幕。

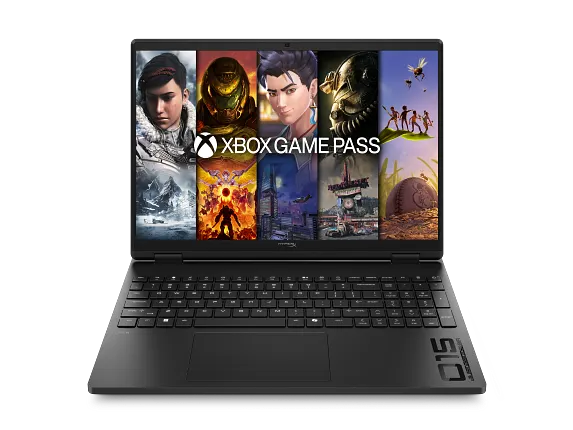

惠普方面则同步更新了HyperX Omen系列游戏本。搭载下一代英特尔酷睿Ultra 9 386H处理器及RTX 5070显卡的Omen 15已上线,最高可选32GB DDR5内存和1TB PCIe Gen5固态硬盘。

高阶旗舰领域,惠普Omen Max 16配备了RTX 5090/5080/5070 Ti等多款高端配置,顶配可选2.5K 240Hz OLED显示屏。

从性能代际来看,RTX 50系列相比上一代40系列的原生光栅性能提升幅度偏小,RTX 5060性能提升约25%至35%,5070提升约18%至25%。

不过,新一代DLSS 4.5技术带来的6倍帧生成能力,才是50系真正的代际优势。

【本文结束】如需转载请务必注明出处:快科技

责任编辑:红茶

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。