你的智能眼镜,也能养龙虾了?|AI 器物志

OpenClaw 龙虾潮爆发 2 个月,一个万物皆可龙虾的时代来了。

电脑养龙虾已经属于基操,现在手机厂商纷纷开推官方龙虾,QQ 微信也有了龙虾插件,甚至电动车也能接个龙虾。

不过,最近我发现了一个养龙虾的天选圣体——

这个叫 VisionClaw 的开源项目,可以让 AI Agent 看你所看,听你所听,能得知你的环境上下文,然后利用龙虾实现操作。

VisionClaw GitHub 页面:

https://github.com/Intent-Lab/VisionClaw

智能眼镜,成为「龙虾眼」

严格来说,VisionClaw 其实并不是用「眼镜」本体来养龙虾,毕竟智能眼镜的性能相对有限,本质上龙虾还是养在电脑上,眼镜充当的,是龙虾的「眼镜」和「耳朵」这两个角色。

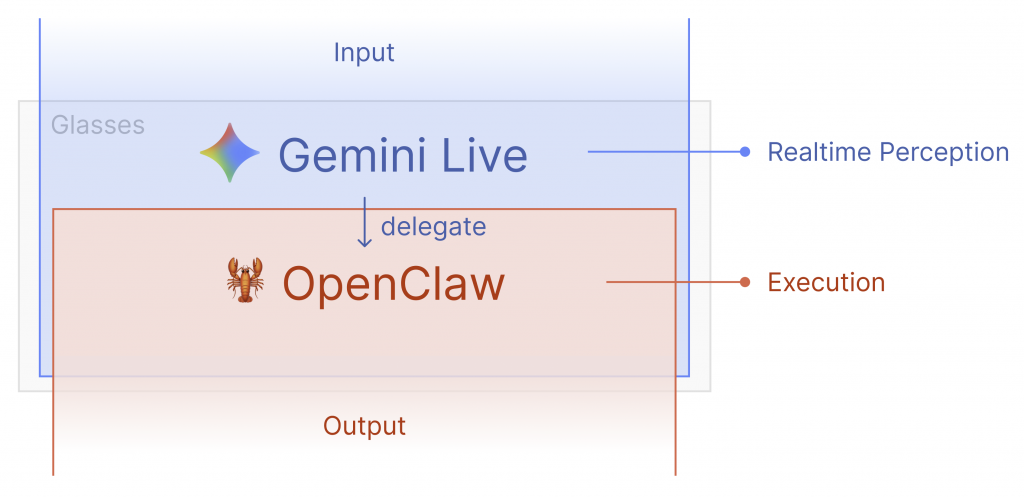

前置准备也比较简单:一个 Ray-Ban Meta 眼镜,一台 iPhone 或 Android 手机,对应的 Xcode 或者 Android Studio 开发工具,一台部署 OpenClaw 的 Mac,以及一个免费的 Gemini Live API 密钥。

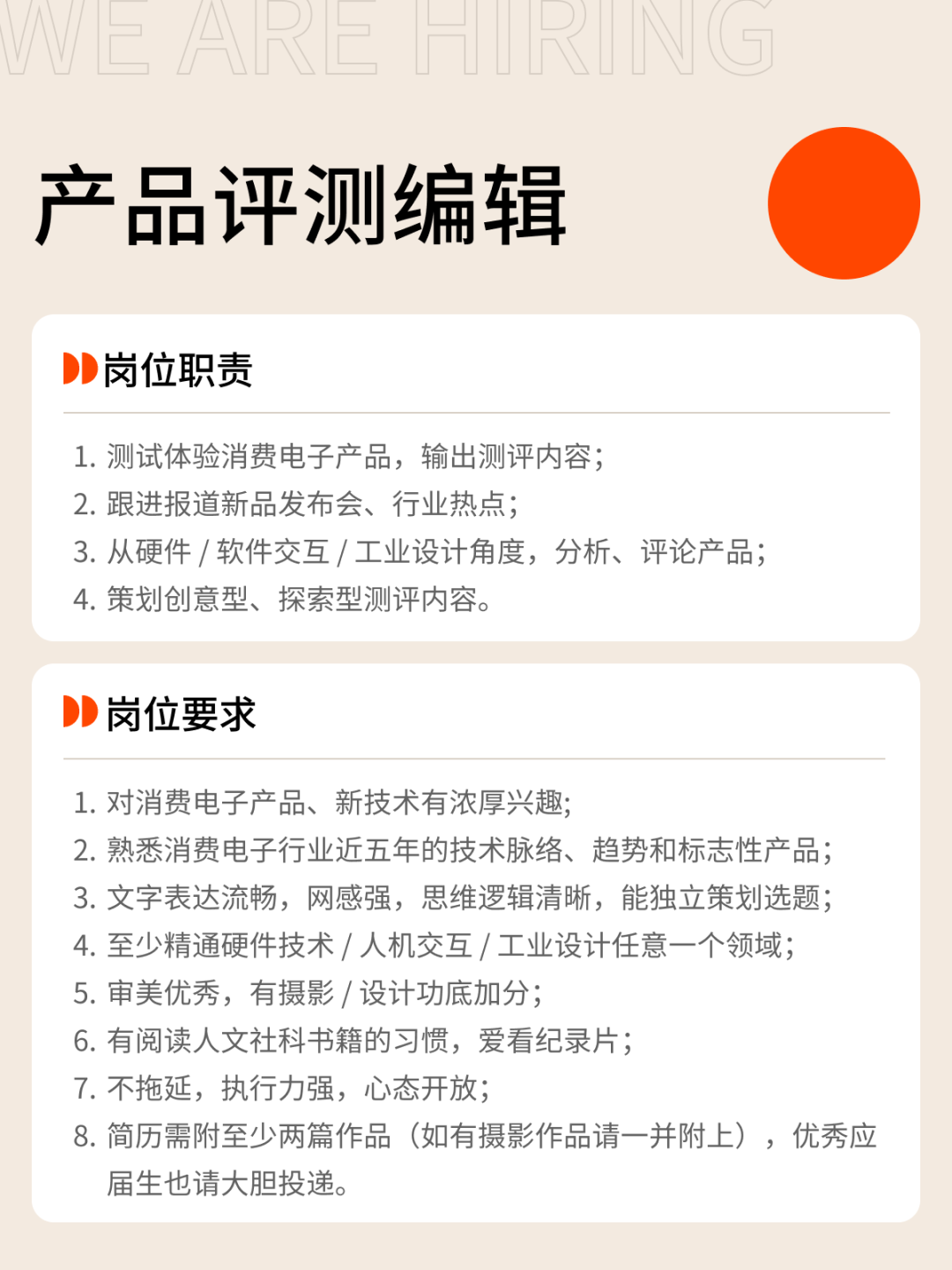

整个 VisionClaw 的架构,是一个完整的「感知-决策-行动」系统,结合了 Meta 眼镜的传感器和数据、Google Gemini 强大的多模态能力,以及 OpenClaw 的自动化执行能力。

感知层面,利用的是 Meta 的 Wearable DAT SDK(数据传输 SDK),实时获取智能眼镜摄像头画面和麦克风音频。通过 WebRTC协议,这些海量的流数据以极低的延迟传输到后端,能够一秒传输一帧画面,相当于「快照」。

Gemini Live 是 Google Gemini 的多模态能力,在手机上下载一个 Gemini 应用,就能调用摄像头和麦克风,让 Gemini 识别现实世界中的事物,据此回答用户的语音提问。

通过 Google 提供的 API,Ray-Ban Meta 也能接入这种能力,使用眼镜「感知层」捕获到的快照和录音,进行「决策」。

如果用户在电脑上部署了龙虾,可以通过网关与手机对接,Gemini 在接到用户的具体任务指令后,它就能调用 OpenClaw 多达 56 个工具和技能,去操作外部 API、网页或本地应用。

这也是这套方案真正有意思的地方,毕竟,不管是 Ray-Ban Meta 还是 Google AI 眼镜,抑或是其他品牌的 AI 智能眼镜,多模态的问答能力都基本是标配,戴着眼镜可以翻译面前的外语,或者对着食物生成菜谱。

有了 OpenClaw 之后,眼镜才从「问答」,真正升级到了「执行」,能真正「影响」你面前的现实世界。

龙虾上眼镜后,真 · AI 助手来了

生成式 AI 浪潮汹涌,「钢铁侠」与他的 AI 助手「贾维斯」成了现实的参照标杆,各类产品和理念争相靠拢,而 VisionClaw,则可能是当下最贴近这一未来愿景的存在。

作为一种「全时陪伴」的 AI 硬件,VisionClaw 眼镜在不少场合都是一个比手机更理想的入口。想象这个场景:当你在路上全神贯注驾驶,因为前方修路不得不绕行,这时,你可以直接呼出 VisionClaw,让它告诉你的朋友要迟到,Gemini 就会利用 OpenClaw,给朋友发出信息——全程,你的手没有离开方向盘,视线也没有离开路况。

这种场景,只是 VisionClaw 多模态感知能力的一种,还远非它的上限。

VisionClaw 的创始人 Xiaoan Liu 分享了一个更加具体并且有趣的用例:他面前有一瓶饮料,于是他呼出眼镜的 VisionClaw 助手,直接说「帮我把这个饮料放进我的 Amazon 购物车」,AI 首先识别出了这是一瓶魔爪草莓味能量饮料,然后操作浏览器,进入 Amazon 官网,进行搜索后将商品加购。

根据 GitHub 的页面,VisionClaw 还能实现一些相对更「科幻」的操作:比如更自然、无感的智能家居控制,戴着眼镜看向一盏灯,发出「调暗」的指令,OpenClaw 就知道该对哪盏灯进行对应的操作。

上线两个月,VisionClaw 吸引了不少极客网友的注意,一些网友认为,这种「语音 + 视觉 + 智能体操作」的方案,几乎就是 AI Agent 第一个「可用形态」。

由于项目开源的特性,VisionClaw 的能力理论上来说没有天花板,开发者可以自己加入、定制自己想要的能力。

龙虾和智能眼镜,为什么是一对天作之合

由于 VisionClaw ≈ 摄像头麦克风 + Gemini Live + OpenClaw 的架构,它其实完全可以部署在手机上。

但我认为,智能眼镜依旧是最适合 VisionClaw 的载体,并且「龙虾」OpenClaw 也需要一个像智能眼镜的容器。

龙虾究竟是什么?具体来说,它是一个部署在电脑的开源 AI 智能体,拥有极强的数据读取和自动化操作能力。

而从一个更宏观的视角去看,「龙虾」是一种理念,一个机器高度自动化的思路,重要的根本不是「OpenClaw」这个智能体本身。

「龙虾」之所以成为了一个潮流,席卷厂商、极客乃至大众,无非是因为它不止能写文章能画画,而是真的能动手能干活,更契合我们最初对「AI」的畅想——一个无所不能的助手,我们动动嘴皮子,就把事情完成了。

在电脑养龙虾,AI 只能处理计算机和互联网中的虚拟任务,虽然能力已经足够强大,但还是偏「孤岛」,无法进一步渗透生活,明明生活中的不少琐事,都很值得交给 AI 完成。

并且,如果日常中想要调用龙虾帮自己做某些事情,不得不用手机或电脑,并提供大量的上下文和指令。

比如上面提到的买饮料,用户必须要先知道这是哪一款饮料,然后告知 OpenClaw,才能让它帮忙加购,这个过程相对繁琐,还不如自己手动操作。

这些问题,刚好都能被 VisionClaw 解决。

Meta CEO 马克 · 扎克伯格一直相当看重「智能眼镜」作为 AI 载体的价值,因为它不仅可以长时间佩戴,作为一个随时就位的 AI 入口;还能通过摄像头、麦克风等环境传感器,收集用户环境上下文,作为 AI 决策的依据,它真的知道你的注意力放在了何处。

在用户现实生活上下文的支撑下,龙虾的能力范围进一步扩张,「自动化」的好处,终于也能在日常生活中得以体现。让 AI 砍掉多余的操作和步骤,极简化地实现原本多个步骤的操作,「龙虾」的意义,才真正从「工具」,转变为「伙伴」。

目前的 VisionClaw,还需要用户下达指令才能执行操作,未来很可能演变成一种更「自觉」的智能能力。

比如说,当用户读自己的体检单,眼镜不仅会将读数转化成具体的身体状况,如果发现一些潜在的疾病风险,还会主动询问用户是否需要帮忙预约医生。

VisionClaw 某种意义上就是智能眼镜愿景的「终点」。这说的并不是「VisionClaw」这个开源方案本身,因为这更多只是一个技术方向的探索方案,很难真正面向大众,它所描绘和证明的「可能性」更有价值。

智能眼镜的结局未必真的能「替代」手机,更可能的未来,就是成为手机的延伸,特别是 AI Agent 的触角和入口,通过语音交互和自动化执行的能力,减少用户掏出手机的次数。

一些智能眼镜厂商,已经发现了「龙虾眼镜」的潜力。Rokid 上线了「自定义智能体」的功能,可以接入 OpenClaw 等平台,集成调用文件系统、浏览器操作以及更多脚本能力。

去年,Meta 推出了首款带单眼显示屏的 Ray-Ban Display 眼镜,但这款产品并没有延续不带显示屏 Ray-Ban Meta 的成功,除开价格要素,使用场景偏窄是更致命的问题,大家不知道,要拿这个显示屏做什么。

在 AI Agent 的加持下,显示屏眼镜的一些生产力场景才得以成立,而 Meta 目前的 AI 能力并不能很好托举这款未来产品,需要「龙虾」这种更强大的自主能力才能助推。目前一些开发者已经在着手,将类似 VisionClaw 的能力移植到 Ray-Ban Display 上,利用好这块显示屏。

试想一下,未来戴一副具有显示屏的「龙虾眼镜」到产品发布会现场,我只要下达一个「帮我写一个上手稿件」的指令,然后上手把玩产品,Agent 就能帮我写出口播稿,我也一边能够在眼镜屏幕上浏览生成的结果,完全不需要用到电脑,而稿件完成后,还可以通过调用远程的电脑,来展开进一步的工作。

VisionClaw 也打开了一扇可能性的大门,今天有龙虾眼镜,明天可能「龙虾手表」「龙虾耳机」也安排上了,不仅能作为离用户更近的 AI 入口,其传感器也能为 Agent 带来更丰富的数据和依据。

厂商们已经在这条道路上全速奔跑。MacRumors 爆料,苹果正在开发一个「AI 胸针」,搭载摄像头和麦克风等多种传感器,与 iPhone 配合使用,为全新的 AI Siri 捕捉现实世界信息。

硬件只是载体,真正重要的是「形态」本身,哪一种形态才能完全释放出 AI 的全部能力,短期内还没有答案,至少在 VisionClaw 身上,我们看到了未来交互的潜力。