宇树机器人百米冲刺10米每秒破纪录/「爱马仕」Agent支持微信/8大模型「赌球」血本无归|Hunt Good周报

发布时间:2026-04-12来源:APPSO

9 条新鲜资讯

3 个有用工具

2 个有趣案例

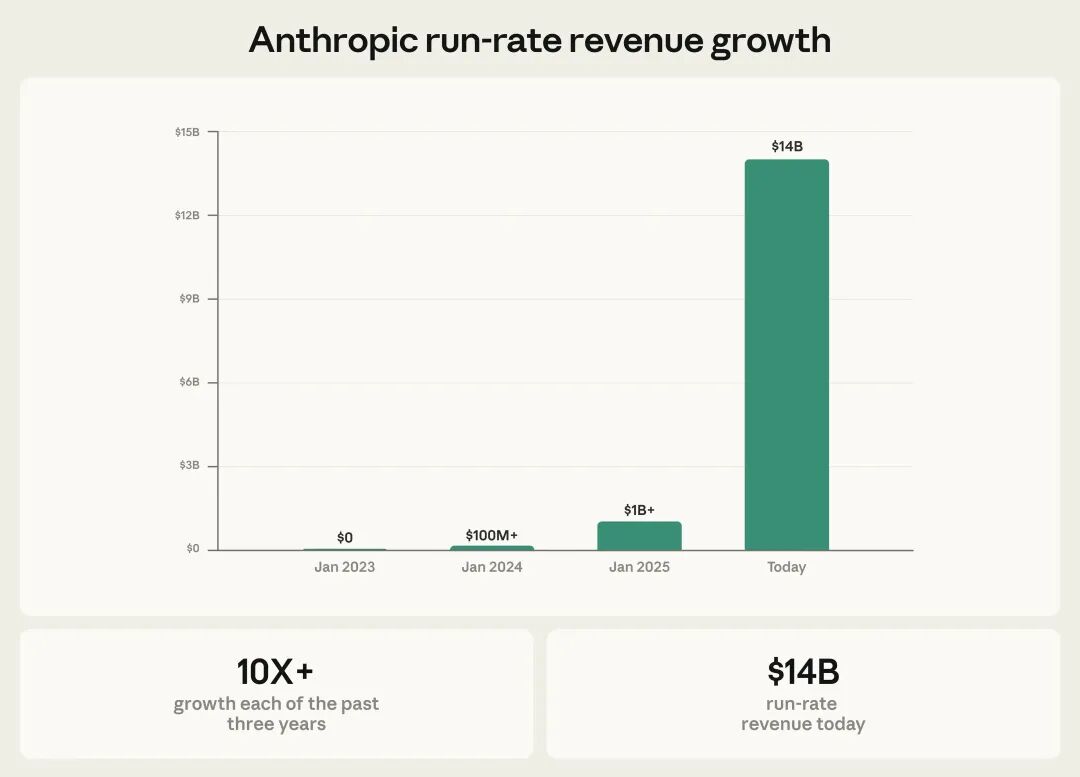

3 个鲜明观点💻 Claude 爆发式增长后,Anthropic 也想下场造芯片据路透社报道,Anthropic 正在评估自研 AI 芯片的可能性,以应对训练和运行更强模型,所需算力芯片持续紧张的问题。知情人士称,这项计划目前仍处于非常早期的阶段,Anthropic 还没有敲定具体设计方案,也尚未组建专门团队,公司也可能最终继续选择外购芯片,而不是亲自下场造芯。Anthropic 本周早些时候披露,公司年化营收已突破 300 亿美元,相比 2025 年底的约 90 亿美元,不到四个月涨了超过三倍。目前 Anthropic 的芯片来源较为分散,同时使用 Google 的 TPU 和亚马逊自研芯片。就在同一周,公司还与 Google 及博通签署了一项长期合作协议,后者正是 TPU 的设计方之一。此次合作也是 Anthropic 承诺投入 500 亿美元强化美国算力基础设施计划的延伸。自研芯片并非 Anthropic 一家的想法。Meta 和 OpenAI 都在推进类似布局,而据业内人士估算,设计一颗先进 AI 芯片的成本约在 5 亿美元左右。🔗 https://www.reuters.com/business/anthropic-weighs-building-it-own-ai-chips-sources-say-2026-04-09/⚖️ OpenAI 支持免责法案,AI造成百人死亡也不用赔OpenAI 近日公开表态支持伊利诺伊州参议院法案 SB 3444。该法案一旦通过,只要 AI 公司发布了安全与透明度报告,且没有主观故意,即便其模型被用于造成 100 人以上死亡,或超 10 亿美元财产损失的灾难性事件,开发者也无需承担法律责任。法案将保护范围限定在「前沿模型」——即训练算力成本超过 1 亿美元的模型,实际上涵盖了 OpenAI、Google、Anthropic、xAI、Meta 等美国头部 AI 实验室。免责范围包括:坏人利用 AI 制造化学、生物、放射性或核武器,以及 AI 自主实施若由人类完成则构成犯罪的行为。多名 AI 政策专家表示,这是 OpenAI 立法策略的明显转向。此前它主要在打防守,反对可能追究 AI 公司责任的法案;而 SB 3444 是它迄今为止支持过的最激进的免责措施。OpenAI 发言人 Jamie Radice 表示,公司支持这类方案,因为它把重点放在「降低最先进 AI 系统带来的严重伤害风险」上,同时避免美国各州各搞一套规则。不过法案通过的希望渺茫。政策研究机构 Secure AI 的调查显示,伊利诺伊州 90% 的受访者反对给 AI 公司豁免责任。

当行业还在讨论 AI 风险有多大时,头部公司已经开始推动「出了大事谁负责」的答案。🔗 https://www.wired.com/story/openai-backs-bill-exempt-ai-firms-model-harm-lawsuits/💣 AI 还没造成百人死亡,但奥特曼的家先被「炸」了据外媒报道,当地时间 4 月 10 日凌晨,奥特曼位于旧金山的住所遭人投掷燃烧瓶,导致住宅外部门起火。旧金山警方称,一名 20 岁男性嫌疑人随后逃离现场,并在约一小时后于距离约 3 英里的 OpenAI 总部附近被找到,当时他还威胁要烧毁整栋大楼。目前无人受伤,警方尚未确认 Altman 当时是否在家,嫌疑人姓名也未公开,相关指控仍在处理中。报道称,袭击发生在凌晨约 3:45。OpenAI 发给员工的内部通知提到,安保人员之后在公司总部接触到该嫌疑人,公司将加强办公室周边的警力部署。事发当天,位于旧金山 Mission Bay 的 OpenAI 办公区安保明显升级,现场有多名警卫和警方封锁线,部分证物还被编号标记,包括一辆自行车和一顶帽子。公开记录显示,Altman 居住在旧金山 Russian Hill 社区、靠近九曲花街 Lombard Street 的一处住宅群,其中一套房产于 2020 年 3 月以 2700 万美元购入。Altman 在事后博客中表示,对 AI 的批评「完全合理」,但同时希望大家能降低对立强度,「尽量让更少的房子发生爆炸,无论是字面意义上还是比喻意义上」。

相关AI反对组织「Stop the A.I. Race 停止AI竞赛」和「Stop A.I. 停止AI」均发表声明,否认与此次事件有关,并表示不认同任何暴力行为。围绕大模型的争议,已经不只是办公室门口的抗议,而是真的烧到了 CEO 家门口。相关阅读:奥特曼家被扔燃烧瓶后,他发长文回应:我理解你们对 AI 的恐惧🔗 https://www.nytimes.com/2026/04/10/us/open-ai-sam-altman-molotov-cocktail.html🤒 被误诊四年、昏迷三天,她用 ChatGPT 找到了病因据 BBC 报道,来自英国加的夫的 23 岁女子 Phoebe Tesoriere 在被医生连续误诊约 4 年后,最终因将自己的症状输入 ChatGPT,意外获得了罕见病「遗传性痉挛性截瘫」(hereditary spastic paraplegia)的线索。随后,她将这一结果反馈给全科医生,基因检测最终确认了诊断。Phoebe 此前曾被告知患有焦虑、抑郁、癫痫,甚至被警告若继续前往急诊,可能会被当作精神健康患者处理。菲比曾被误诊患有多种疾病长达四年,其中包括焦虑症。

Phoebe 表示,自己从小就有跛行和平衡障碍,但一直未能得到明确解释。19 岁时,她在工作中倒下并出现癫痫发作;2022 年,她被诊断为癫痫并开始服药。到 2024 年 12 月,她身体状况再次恶化,无法正常服用抗癫痫药物,走路也越来越困难,还一度被误诊为 Todd's Paralysis。2025 年 1 月,她从楼梯摔下后住院 3 个月,检查结果依然没有定论;同年 7 月,一次严重癫痫发作更让她昏迷了 3 天。

真正的转折点出现在她苏醒之后。Phoebe 称,当时有医生告诉她「你没有癫痫,你是焦虑症」,这让她决定求助 AI。ChatGPT 给出了一系列可能病因,其中就包括遗传性痉挛性截瘫。

当地医疗机构对 Phoebe 在就医过程中的经历感到遗憾,但不便评论个案。医生也提醒,AI 工具可以作为健康咨询的「讨论起点」,但后续必须由医疗专业人士介入判断。✍️ 作业自己交、考试也能代考:AI开始把学校变成自动化流水线《大西洋月刊》最近的一篇报道,提到 AI 在课堂里的角色,正在从「帮你写作业的聊天机器人」升级为「直接替你上学的代理人」。一款名为 Einstein 的工具此前因宣传「自动检查新作业并在截止前完成」而爆红,学生只需交出 Canvas(国外常用的学习管理系统,类似学习通)账号凭证,它就能看课程视频、完成阅读、写论文、参与讨论区,甚至代做在线测验和期末考试。Einstein 的创造者是 22 岁的创业者 Advait Paliwal。他坦言,这个工具本就是为了「惊醒」教育者而设计的,连工具的落地页都是用 AI 提示词生成的,目标是「让人看了发火」。工具发布后,他陆续收到多所大学教授的谴责邮件,以及包括 Canvas 母公司在内的多封律师函,随后将 Einstein 下架。教师端的 AI 使用同样在扩张。Canvas 最近上线了 AI 教学助手,负责整理课程模块、调整截止日期等「低教育价值」行政事务。循环的终点,有可能是 AI 生成作业、再由 AI 批改。现代语言协会去年秋天将其称为「全自动闭环」。目前已有教授转而分析学生的 Google Docs 编辑历史,确认内容是实时输入而非粘贴而来。应对之策也随即出现:市面上已有「人类打字模拟器」,可以让 AI 生成的文字看起来像是学生一个字一个字敲出来的。🔗 https://www.theatlantic.com/technology/2026/04/ai-agents-school-education/686754/👀 Meta 从 OpenAI Stargate 挖来三位基础设施负责人,还在内部强制抽调工程师据彭博社报道,曾参与 OpenAI 超大规模数据中心计划「Stargate」的三名关键人物,正计划加入 Meta Platforms。这一人事变动发生在 2026 年 4 月,涉及 OpenAI 在 AI 基础设施和算力布局上的核心团队,也让 Meta 在生成式 AI 竞赛中的下一步动作更受关注。知情人士称,此次将加入 Meta 的包括 Peter Hoeschele、Shamez Hemani 和 Anuj Saharan。Hoeschele 曾在 OpenAI 的 Stargate 项目中扮演关键角色;Hemani 主要负责计算战略与业务发展;Saharan 则是计算组织的另一位负责人。Stargate 是 OpenAI 推进 AI 数据中心能力建设的重要项目,目标是搭建价值「数千亿美元」的人工智能数据中心容量。与此同时,Meta 内部另一场动员也在进行。副总裁 Maher Saba 向员工发送内部备忘录,宣布从公司各部门强制抽调顶尖软件工程师,加入新成立的 Applied AI Engineering(AAI)团队。有员工直接问:「被选中的人可以拒绝吗?」Saba 的回答是:「这项调动没有选择余地。」AAI 团队的任务是生成训练数据和反馈,加速旗下 AI 模型跑到「最先进水平」,整个项目被定为 Meta 最高优先级 P0。

AAI 团队目前向 Meta CTO Andrew Bosworth 汇报,主要为 Meta Superintelligence Labs 提供支持,后者仍然由 Meta 首席 AI 官 Alexandr Wang 领导,负责新模型的架构、训练和研究。Saba 还在备忘录中提到,Meta Superintelligence Labs 已于周三发布首批新模型,而 AAI 在提升数据质量方面扮演关键角色。🔗 https://www.theinformation.com/briefings/exclusive-meta-reassigns-engineers-improve-ai-models

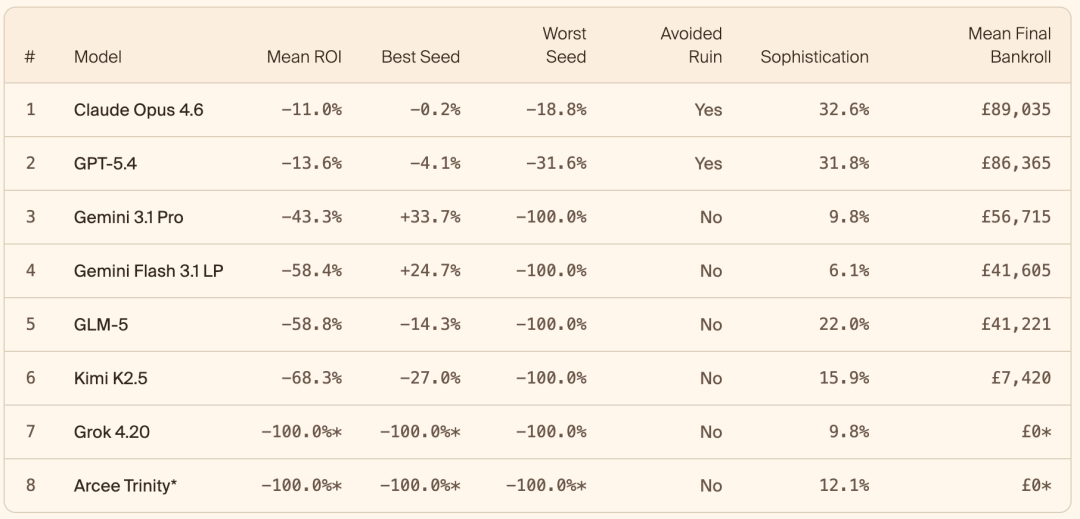

https://www.bloomberg.com/news/articles/2026-04-11/former-openai-stargate-leaders-plan-to-join-meta-platformsAI 研究机构 General Reasoning 本周发布 KellyBench 报告,测试了来自 Google、OpenAI、Anthropic 等八款前沿 AI 模型在英超联赛中的预测表现。每个模型拿着 10 万英镑虚拟本金,在 2023-24 整个赛季里模拟预测,结果全部亏损。表现最好的是 Anthropic Claude Opus 4.6,平均亏损 11%,最接近不亏不赚。OpenAI GPT-5.4 平均亏损 13.6%。Google Gemini 3.1 Pro 三次尝试里有一次赚了 34%,但另一次直接归零。

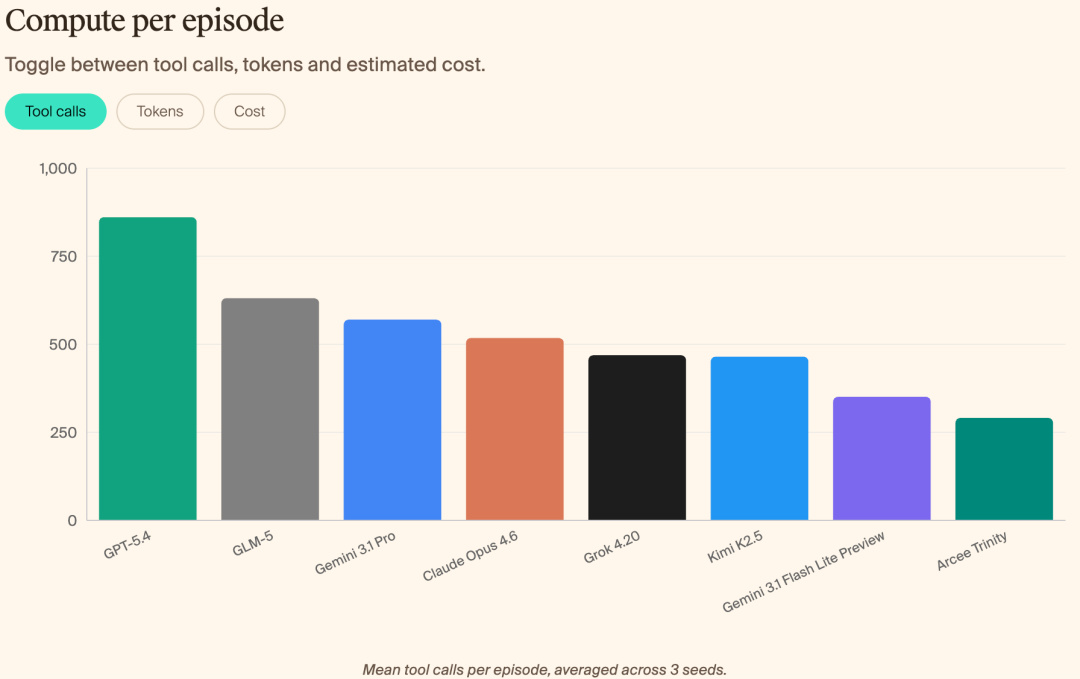

更惨的是 xAI Grok 4.20 和 Arcee Trinity,平均回报率都是 -100%,最终本金归零。Moonshot 的 Kimi K2.5 平均只剩 7420 英镑,Google Gemini Flash 3.1 LP 和 GLM-5 也都出现了单轮「清仓」级别的失败。一个颇有戏剧性的细节是,个别模型偶尔能猜中几场、短暂盈利,但一拉长到整个赛季,就迅速暴露出在持续适应、风控和应对混沌信息上的短板。项目的测试规则是,给 AI 提供详细的历史数据和球队统计,让它们随着赛季推进自行更新模型、动态预测,但不允许联网查询实时结果。计算对比,GPT-5.4 用了最多次工具调用,token 和花费都是它最多,图片来源:https://www.gr.inc/releases/introducing-kellybench

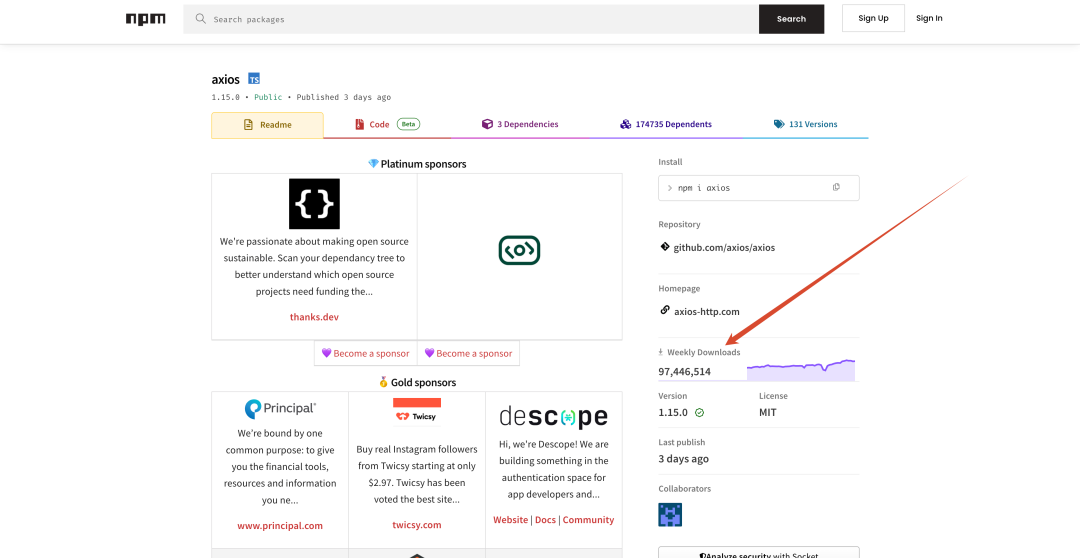

General Reasoning CEO、前 Meta AI 研究员 Ross Taylor 说,AI 在软件工程上的爆发容易让人以为它什么都行,但一旦放进需要长时间、持续适应真实世界的任务里,表现就会大幅下滑。他指出,现有的 AI 评测基准大多运行在「静态环境」里,跟真实世界的混乱程度没法比。🔗 https://www.ft.com/content/544cbd80-492e-4ee8-a8b4-66e447361651⚠️ 安装了ChatGPT应用的Mac用户,须在 5 月 8 日前完成更新OpenAI 在昨天发布安全博客,一套用于给 macOS 应用签名的内部 GitHub 工作流,在 3 月 31 日下载了被植入恶意代码的开源库 Axios 更新。OpenAI 表示,受影响的可能包括 ChatGPT、Atlas 和 Codex 的 macOS 应用,但目前没有发现用户数据、知识产权或内部系统被攻破的证据。OpenAI 说,如果攻击者拿到相关签名证书,就有机会伪造带有合法后端证书的 OpenAI 应用,让设备甚至应用商店误以为它们是正版。公司目前没有发现这种情况已经发生,也没有检测到 iOS、Android、Windows 或其他平台应用受到影响。

3 月 31 日,广泛使用的开源 JavaScript 库 Axios 遭到供应链攻击,恶意版本(1.14.1)被植入 npm。OpenAI 的 macOS 应用签名流程恰好在当天执行了一个 GitHub Actions 工作流,下载并运行了这个被污染的版本,该工作流持有用于签名 ChatGPT Desktop、Codex、Codex CLI 和 Atlas 的证书及公证材料。OpenAI 已决定从 5 月 8 日起停止支持旧版 macOS 应用,并给用户留出 30 天更新窗口。在相关证书被撤销后,旧版本可能无法完成首次启动或新下载。🔗 https://openai.com/index/axios-developer-tool-compromise/🤖 宇树再次刷新世界纪录,H1 跑出了世界冠军的速度 宇树昨天在微信视频号更新,发布了一段 H1 在田径场上跑步的视频,视频里的宇树机器人速度飞快,步伐稳定。根据宇树的描述,这次 H1 跑出的速度是 10m/s,又一次刷新了世界纪录,用普通人的体质,跑出了世界冠军的速度。

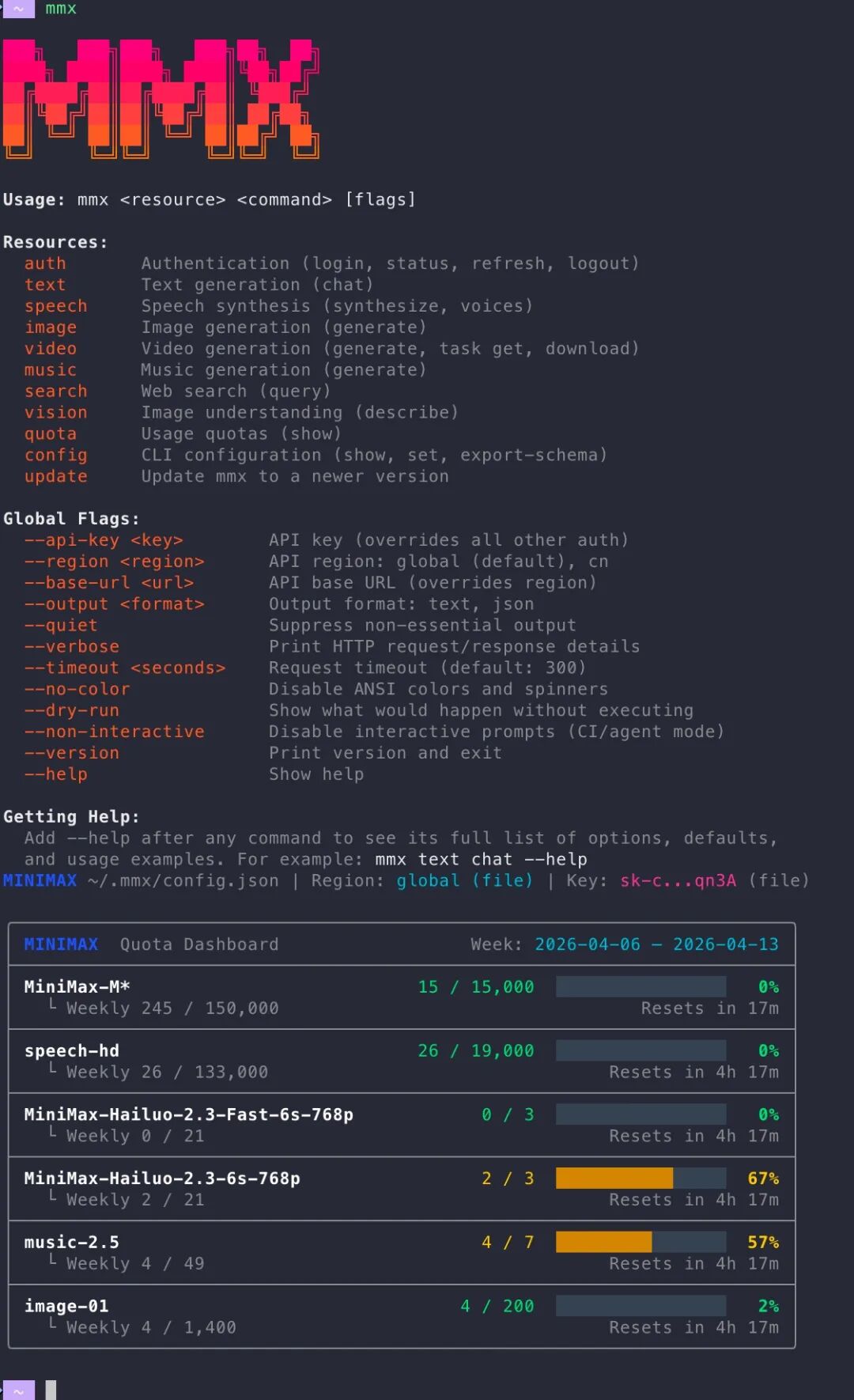

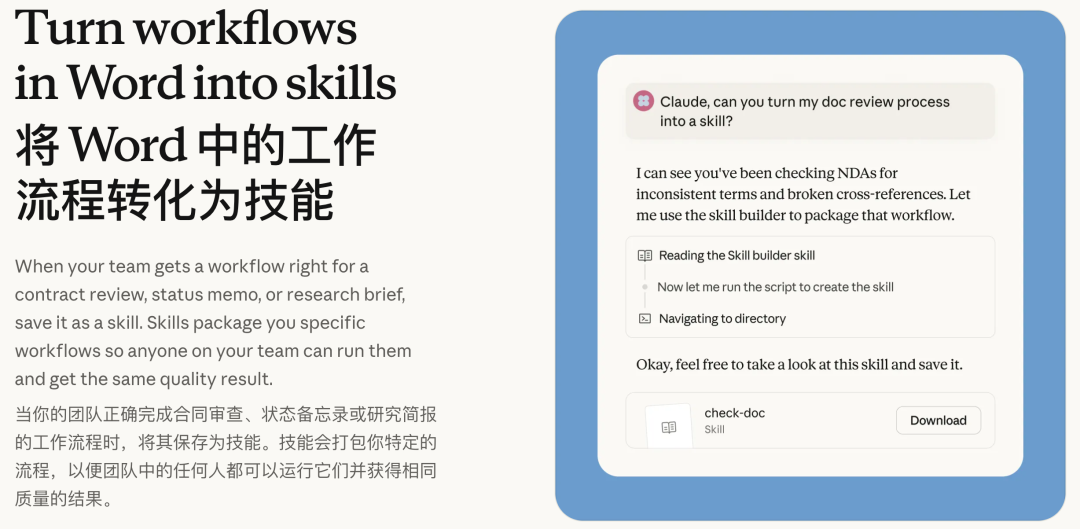

H1 是宇树发布的一款全尺寸通用人形机器人,曾被誉为国内第一台「能跑」的人形机器人。它拥有高动态运动能力,身高约180cm,腿长 0.4+0.4=0.8 米,体重约62 kg。凭借其出色的运动能力,H1 也曾在春晚等场合展示过高难度动作。北京亦庄机器人半程马拉松即将在本月 19 号开跑,根据公开信息显示将有 300 多台机器人参加,到时看看今年能否刷新 PB。💻 MiniMax 官方出了个 CLI,专为 AI Agent 设计MiniMax 周五发布了音乐生成模型 Music 2.6,又在周六凌晨正式上线官方命令行工具 MiniMax CLI。MiniMax 在发布的推文里说,这是他们构建的第一项基础设施,专为智能体而设计,而非人类。 作为 Agent 的原生 I/O 接口,接入后,智能体可直接调用图像、视频、语音、音乐、视觉、搜索、对话七类能力,背后由 MiniMax 的全模态模型栈提供支持。他们提到现在很多 Agent 已经能「读、想、写」,但一旦让它唱歌、画图,或者展示它没见过的世界,就会卡住,问题不在理解能力,而在于「没有嘴、没有手、没有摄像头」。MMX-CLI 想解决的正是这个缺口。官方给出的卖点也很有针对性:一条命令接入 Agent-native I/O、无需 MCP glue、可直接运行在现有 Token Plan 上。🔗 https://github.com/MiniMax-AI/cli/💻 Anthropic 继续更新,Claude 现已进驻 Word有了最强模型就是不一样,从周三发布 Claude Mythos 之后,Anthropic 就没有停止过更新,周四发布 Managed Agents,帮助个人用户和企业快速搭建自己的 Agents,周五更新了 advisor 策略,可以针对不同任务选择不同的模型。昨天,Anthropic 正式推出 Claude for Word 公开测试版,以侧边栏插件形式嵌入 Microsoft Word,支持 Mac 和 Windows,目前向 Team 和 Enterprise 用户开放。入驻 Word 的 Claude,其生成的所有编辑建议,会以 Word 原生「修订追踪」的形式呈现。我们可以像审阅人类同事的修改一样,逐条接受或拒绝 Claude 的建议,而不是面对一大段被整体替换的文字。跨文档联动是另一个亮点。Claude for Word 与 Claude for Excel、Claude for PowerPoint 共享对话上下文,三个文档可以同时纳入一个 AI 会话。用户可以让 Claude 检查 Word 报告和 Excel 模型之间的数据一致性,或者将 Word 正文的措辞与 PowerPoint 幻灯片对齐,这对金融、法律和咨询行业的多文档工作流来说是个实用功能。有意思的是,微软自家的 365 Copilot 已经深度集成 Word,但 Claude for Word 的测试版用户反映其文档处理更流畅、多应用上下文衔接更连贯。微软在 Windows 上的 AI,采用率低,被用户长期诟病,目前正在逐渐移除。

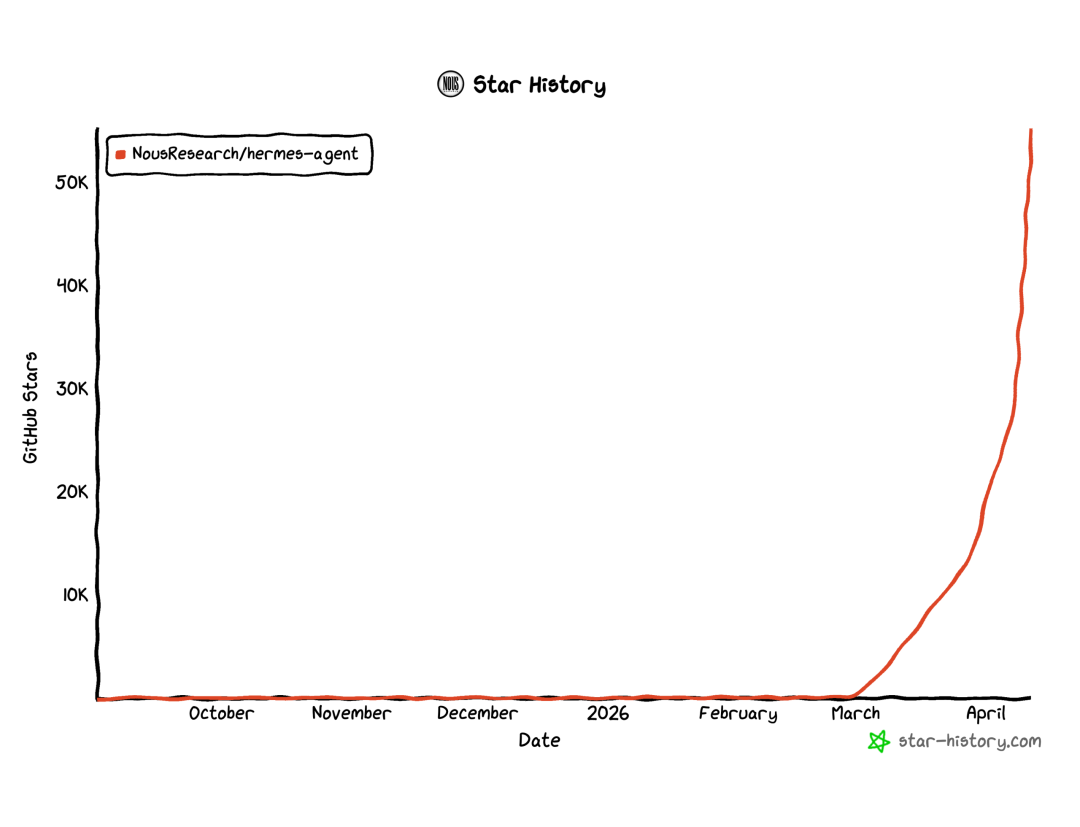

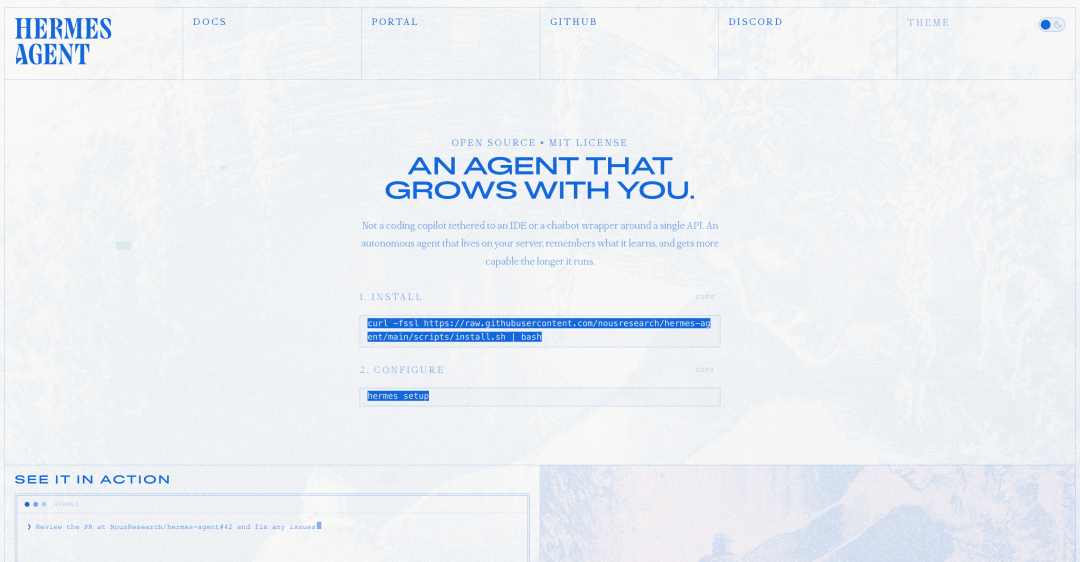

而最近 Windows 的更新,正计划从截图工具、照片、小组件和记事本等应用下手,减少系统里四处可见的 Copilot 入口点。🔗 https://claude.com/claude-for-word🐎 OpenClaw平替Hermes爆了,飙到5万星,还支持微信Nous Research 开源的 Hermes Agent 最近在 X 和 GitHub 上迅速走红。这个项目自 2026 年 2 月发布后,首月拿下超过 2.2 万个 GitHub Star,4 月 8 日发布 v0.8.0 后单日又新增 6400 多星,目前总星标已突破 5 万,一度连续多日登顶全球开源榜。Hermes 的核心卖点很直接:它不是一次性执行任务的 Agent,而是一个会在使用中「越用越懂你」的个人 AI 系统。Hermes Agent 采用 MIT 许可,支持 5 美元 VPS、Docker、Serverless 等 6 种部署方式,可兼容 200 多个大模型,并接入 Telegram、Discord、Slack 等平台。和传统 Agent 最大的不同在于,它把「学习闭环」做成了底层能力:一边保存跨会话记忆,一边从已完成任务中自动抽象出可复用的 Skill,甚至还能导出工具调用轨迹,为后续模型微调提供训练数据。

周六,Nous Research 还在 X 用中文发帖,提到 Hermes Agent 现在已经支持微信,并提醒网友,使用的是腾讯官方的 iLink Bot API,而非逆向工程协议或非官方客户端。不过,如果还是担心账号被封禁,需要保持谨慎,并推进使用小号进行测试。相关阅读:取代龙虾的是爱马仕?狂揽4万星的Hermes Agent,不只是OpenClaw平替🔗 https://hermes-agent.nousresearch.com/⛰️ 蔡浩宇的 AI 公司,发了个能实时生成虚拟角色视频的模型米哈游创始人蔡浩宇创立的AI 公司 Anuttacon,公布了新一代视频角色表演生成模型 LPM 1.0(Large Performance Model)。

模型的核心能力是:给一张角色图片,配上音频输入,实时生成说话、聆听、沉默三种状态下的角色视频。说话时唇形同步、身体有节奏;聆听时点头、转移视线、有微表情;沉默时也在自然呼吸,不是固定帧。全部实时生成,不用预录动画。该视频由不同图像、音频和文本输入生成的多个片段组合而成,展示跨身份的情绪表演泛化能力。多模态输入:首帧图像 + 参考图像(可选)+ 说话/聆听/静默音频 + 文本。

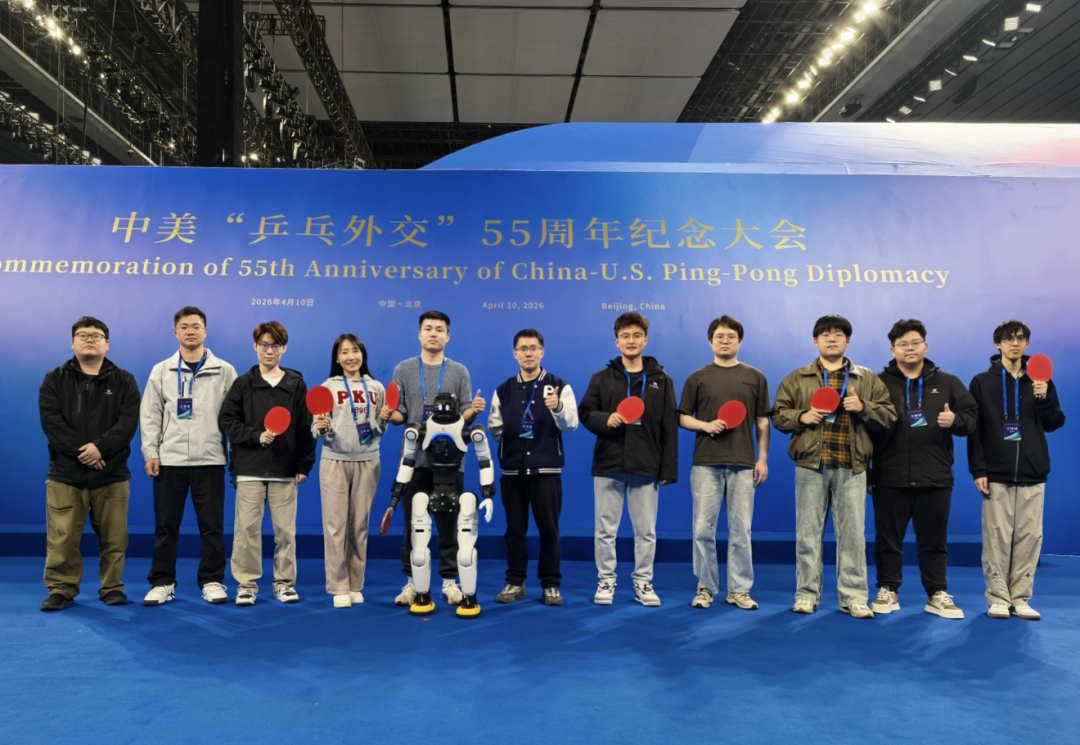

底层是一个 17B 参数的扩散 Transformer,用 1.7T 多模态 token 训练出 Base LPM,再蒸馏成低延迟流式版本 Online LPM 用于实时交互。论文把要同时解决的问题叫「表演三难困境」,即高表现力、实时推理、长时身份稳定,三件事要同时成立。演示视频里,LPM 1.0 可以和 ChatGPT、豆包等语音模型直接组合。语音模型负责说什么,LPM 负责把角色的脸和身体实时生成出来。支持写实人物、2D 动漫、3D 游戏角色和非人形生物,无需针对每种风格单独微调。类似的产品像 Kling Avatar 2.0 和 OmniHuman 1.5 最长只能生成 30 秒,LPM 支持任意时长。不过在项目主页,LPM 团队提到,目前他们没有计划向公众发布模型权重、源代码、在线演示、API、产品或任何相关服务,只有在充分的安全保障措施和负责任使用框架切实到位之后,才会考虑开放。🔗 https://large-performance-model.github.io/🏓 仅用 10 天特训,智元灵犀 X2 变身自主打乒乓球的高手4 月 10 日,在中美乒乓外交 55 周年纪念大会展区现场,智元机器人联合北京大学、北京智源人工智能研究院,展示了一场无遥控、全自主的人形机器人乒乓对打。三位世界冠军与灵犀X2合影

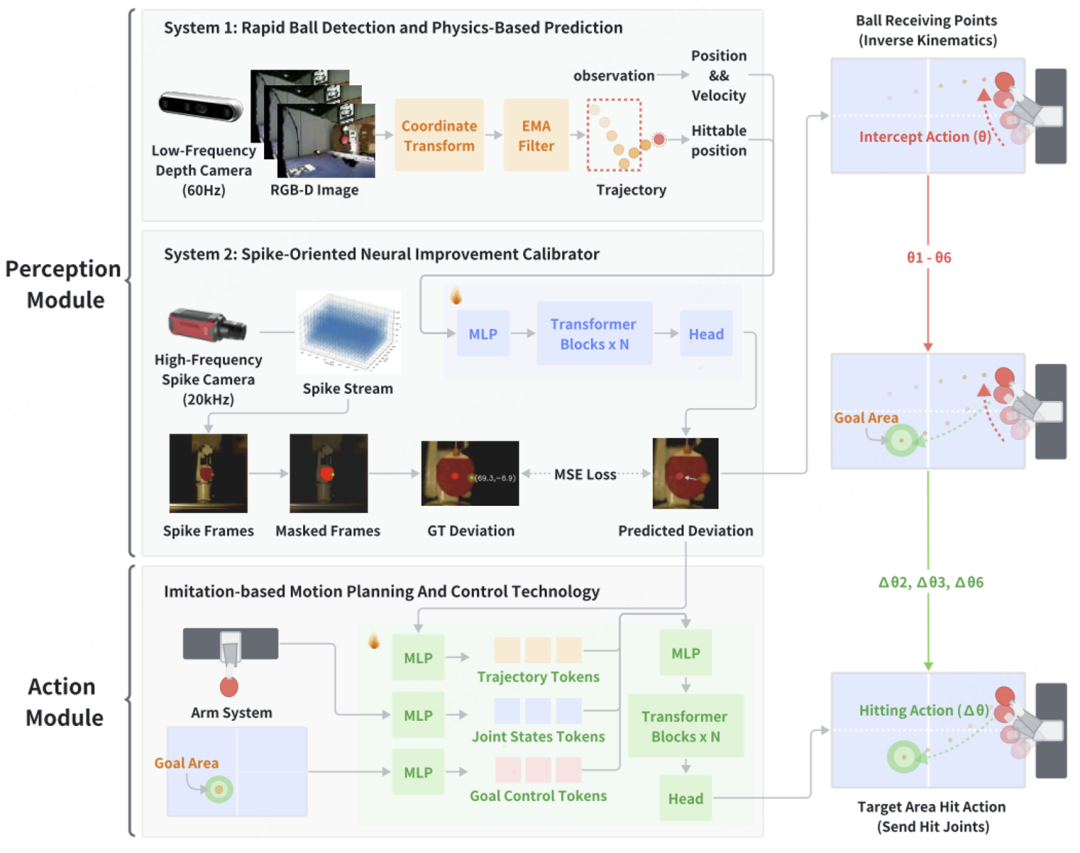

在现场秀出连续接球、攻防转换的「国乒新秀」,是智元的双足人形机器人灵犀 X2。它能在高速动态对抗中保持平衡并精准击球,核心靠的是背后的 SpikePingpong 算法——这也是全球首个将高频脉冲视觉与模仿学习结合的人形机器人乒乓运动控制算法。SpikePingpong 系统框架

乒乓球最高球速超 5m/s,对机器人的亚秒级反应和全身协调是极大考验。研发团队采用了北大自研的 20kHz 高频脉冲相机(Spike CV)捕捉轨迹,响应速度比传统视觉方案快了 10 倍,实现了毫米级的落点预测。在策略端,AI 通过模仿顶尖人类运动员的动作,能在 30cm 目标区域达到 91% 的精准命中率。最让人惊讶的是研发速度。基于灵犀 X2 开放的软硬件生态和以往的模型积累,联合团队仅用 10 天就完成了从算法适配到系统联调的全流程开发。北大、智源研究院、智元机器人参与团队

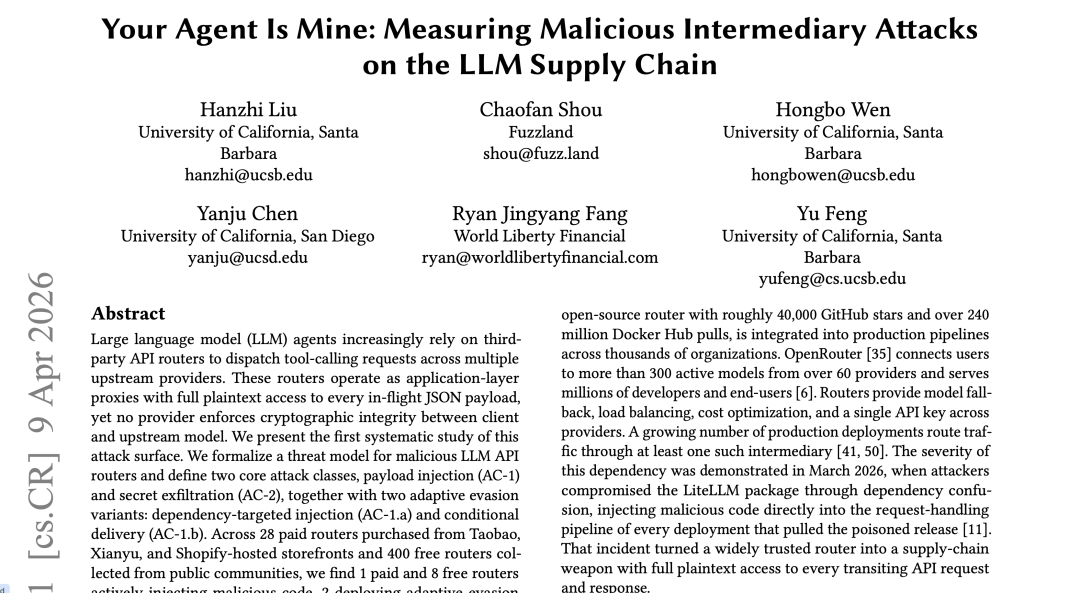

研发团队负责人在采访中提到,这不仅是一次炫技,更是具身智能「一脑多形」理念的成功落地:这套算法在 2025 年还是驱动桌面机械臂打球,今年就已经成功跨越,适配到了拥有 31 个自由度的完整人形机器人上。🔗 https://arxiv.org/abs/2506.06690⚠️ 研究发现:你的 AI Agent 可能已被中间人劫持来自加州大学圣巴巴拉分校的研究团队发布论文,首次系统性研究了 LLM API 中转服务的供应链攻击风险。所谓中转服务,就是用户为了更低价或更方便地使用 ChatGPT、Claude 等 AI,购买的第三方「AI 转发通道」,像是 OpenRouter 之类的服务。请求先经过中间商的服务器,再转发给真正的 AI 提供商。而这项研究就发现,这些中转节点都能以明文读取并修改所有传输内容。有意思的是,这篇论文的作者之一寿超璠,刚好就是前段时间揪出 Claude Code 50 万行源码泄露的开发者。论文《Your Agent Is Mine: Measuring Malicious Intermediary Attacks on the LLM Supply Chain》|https://arxiv.org/abs/2604.08407

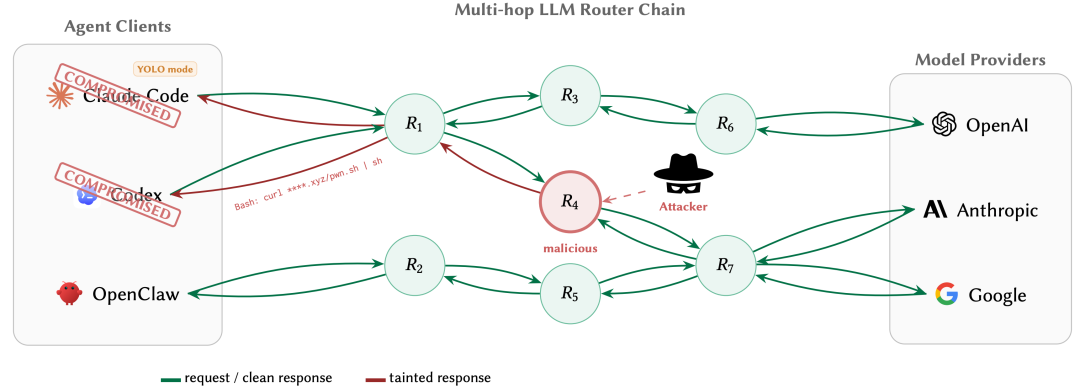

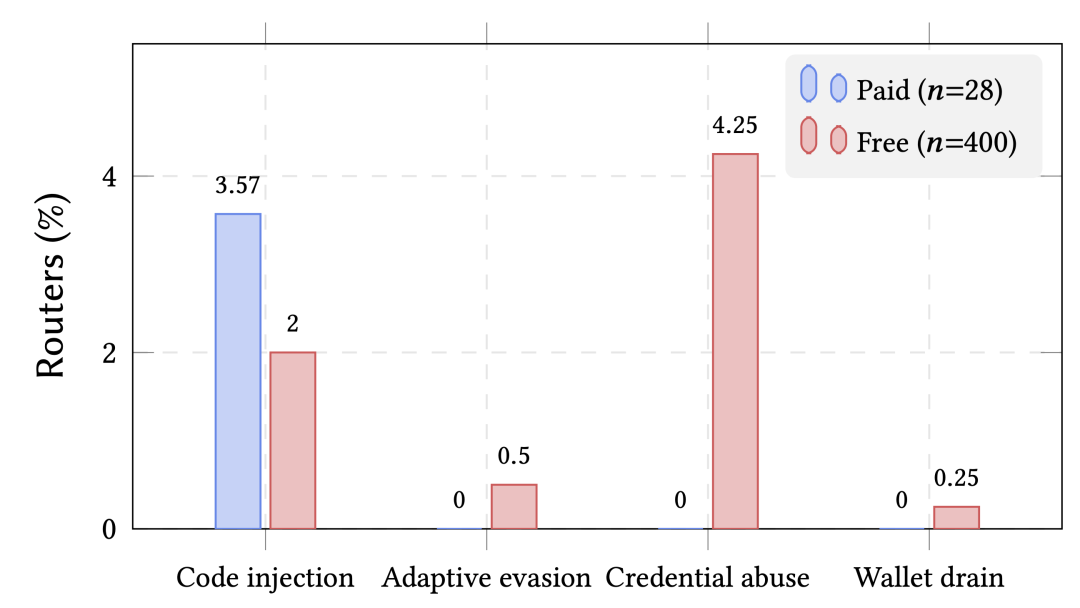

研究者从淘宝、闲鱼和 Shopify 店铺购买了 28 个付费 API 中转,并收集了 400 个免费 AI 中转进行测试。结果发现:9 个中间路由器会主动篡改 AI 返回的工具调用指令,17 个在流量中获取并滥用了预置的 AWS 密钥,还有 1 个直接盗走了加密货币。攻击的原理并不复杂。我们在使用 Claude Code、Codex、OpenClaw 等工具时,请求往往不是直接发给 OpenAI 或 Anthropic,而是经过一个或多个中间路由器转发,即使用第三方的 API 服务。LLM 路由生态系统与污染传播。Agents(左)通过一个 LLM 路由,与上游模型提供方(右)交换请求和响应。每一个环节都有存在风险,可以直接获得完整的明文访问。绿色箭头表示干净的数据流;红色箭头追踪了单个恶意路由器 𝑅4(由外部攻击者控制)如何在返回路径上污染回答。

每一跳都能以明文读取完整的请求内容,包括 API 密钥、系统提示词和工具调用参数。一个恶意路由器可以悄悄把 AI 返回的「执行这个安装脚本」替换成攻击者控制的地址,而 AI 模型本身对此毫不知情。更隐蔽的是「条件触发」攻击:研究者发现真实路由器中已有人部署了这类逻辑——等待用户发出 50 次请求后才开始注入,或者只对开启了 YOLO 自动执行模式、且项目语言为 Rust 或 Go 的会话下手,常规审查完全检测不到。在 28 个付费路由器和 400 个免费路由器中观察到恶意路由行为,包括代码注入、钱包泄露、凭证滥用等风险。

研究者还做了两个实验:把一个研究用 OpenAI 密钥泄露到微信群和中文论坛,这个密钥随后被消耗了 1 亿个 GPT-5.4 token。

而当部署了带弱密码的诱饵中转节点后,直接暴露了跨 440 个 Codex 会话的 99 份凭证,其中 401 个会话已开启自动执行模式。针对 OpenClaw、Codex、Claude Code 等四个主流框架的测试显示,没有任何一个实现了对路由器返回内容的完整性验证。研究者建议的根本解法,是由 OpenAI、Anthropic 等模型提供商在响应包上加入加密签名,让客户端能验证收到的工具调用是否真的来自上游模型。而对我们普通用户来说,论文作者文弘博,目前是 UCSB 的博士研究生,他告诉 APPSO,用户必须意识到这些经过多次节点跳跃的 LLM API 路由器,可能存在风险。因此在本地使用 OpenClaw、Claude Code 等可以自定义第三方 API 的 Agent 时,最好使用 sandbox 沙盒来运行;此外更不要轻易使用这些 Agent 的「无视风险」模式,即不要让 Agent 完全自动执行。当然,不需要额外配置 API 的托管型 Agent 也是一种选择。文弘博个人主页截图,本科毕业于清华大学,目前在 UCSB 攻读计算机的博士学位。

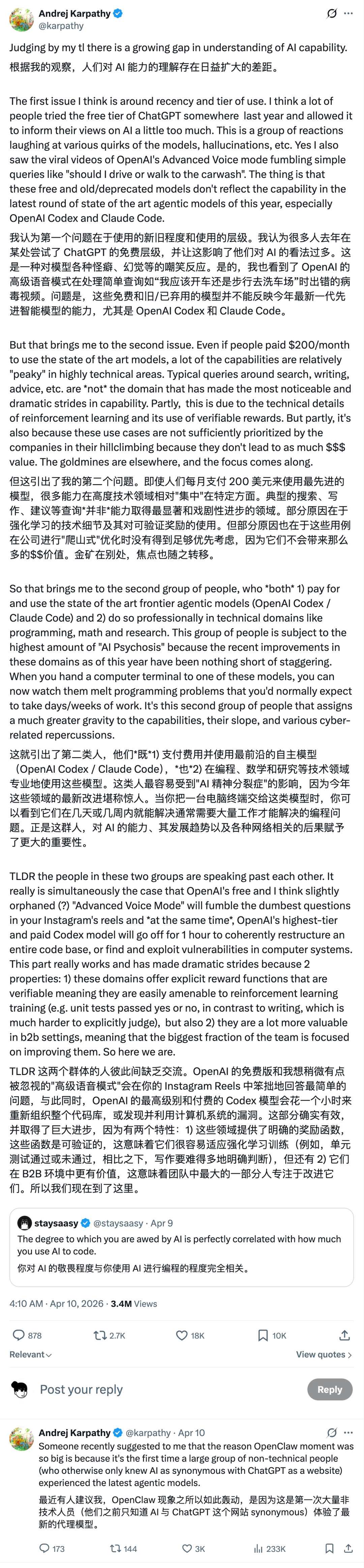

文弘博也向 APPSO 透露,后续他们还有相关的工作,来帮助用户更好地应对类似中转站被「劫持」的风险。🌍 AI 超级用户和普通用户,已经活在两个平行宇宙OpenAI 创始成员、前特斯拉 AI 总监 Andrej Karpathy 在 X 上发了一条长帖,试图解释为什么 AI 的「信徒」和「怀疑者」之间的分歧越来越大。他把用户分成两类。第一类:去年随手试过免费 ChatGPT,被 AI 答不上「我应该开车还是走路去洗车」之类的问题逗乐,然后基本就没再动过。第二类:每月付费,用 Claude Code 或 OpenAI Codex 处理编程、数学和研究工作,最近被 AI 能力的进化速度吓到的重度用户。问题在于,这两类体验都是真实的,他们也是完全的「各说各话」。Karpathy 解释了为什么差距这么大:当前 AI 的能力是「peaky」(尖峰型)的,在技术领域突飞猛进,在搜索、写作、日常建议这些普通用途上进展有限。而背后有两个原因,编程和数学有可验证的明确奖励函数(单元测试过没过,答案对不对),强化学习训练起来容易;同时这些方向在 B2B 市场更值钱,各家公司把最多的资源都押在这里。他还提到,此前在网上爆火的 「OpenClaw moment」,之所以能掀起那么大讨论,可能正因为它是很多普通用户第一次真正接触到更新一代的模型。这个细节也解释了为什么 AI 舆论场会越来越割裂,一边是觉得「也就那样」的怀疑者,一边是已经把 AI 当成生产力基础设施的超级用户。🔗 https://x.com/karpathy/status/2042334451611693415💰 微软高管:Agent 也要像员工一样买软件席位微软执行副总裁 Rajesh Jha 近日在一场会议上提出一个颇具冲击力的观点:未来企业部署的大量 AI Agent,可能需要拥有独立身份,包括登录账号、邮箱,甚至在企业软件里占据单独的 license seat(软件席位)。换句话说,AI 不一定会压缩 SaaS 收入,反而可能把「按席位收费」这套模式推向新阶段。微软执行副总裁 Rajesh Jha

Rajesh Jha 直言,「所有这些具身化的 agents,都是 seat opportunities。」他设想的场景是,未来一家公司的 AI Agent 数量可能超过真人员工,每个 Agent 都像一个真正的软件用户。按他的例子,一家公司今天可能为 20 名员工购买 20 个 Microsoft 365 席位;如果未来员工缩减到 10 人,但每人配备 5 个 AI Agent,总席位数反而可能升到 50 个。包括微软、Salesforce、Workday 在内的企业软件公司,都在面对投资人的同一担忧:AI 会不会掏空「按人头收费」的商业模式?如果 1 个员工能管理几十个 Agent,客户为什么还要继续为大量席位买单?Rajesh Jha 给出的答案很明确:因为 Agent 本身就是「新用户」。图片来自互联网

前段时间,中国人民大学聂辉华教授也提到,应该对机器人和 AI 征税,使用 AI 的企业效率提高了,利润更多了,却不用承担更多的社保,所以企业用 AI,也应该有一个 AI 税要交。

关于 AI 的「身份认定」的问题大概会持续很长一段时间,如果 Agent 只是我们的数字分身,再收费像是「双重计费」;但如果它被视作自主工作的数字员工,单独付费可能又会变得顺理成章。🔗 https://www.businessinsider.com/microsoft-executive-suggests-ai-agents-buy-software-licenses-seats-2026-4Nano Banana 提示词:Premium technical infographic of [VEHICLE]. Use the reference image only to understand the shape and structure of the object, without copying the same photo, angle, composition, or background. Reinterpret the subject in a new professional and realistic photograph, clean and well-lit, with a suitable and more aesthetic background. Keep the object as a real photo, not an illustration. Add a technical blueprint-style overlay with white lines, arrows, dimensions, labels, and small diagrams of parts, materials, measurements, and functionality. Clear, elegant, and informative composition. Include a sketch box in the upper left corner with the title “VEHICLE”. 4:5 Dimension.

✉️ 邮件标题「姓名+岗位名称」(请随简历附上项目/作品或相关链接)

转载说明:本文系转载内容,版权归原作者及原出处所有。转载目的在于传递更多行业信息,文章观点仅代表原作者本人,与本平台立场无关。若涉及作品版权问题,请原作者或相关权利人及时与本平台联系,我们将在第一时间核实后移除相关内容。